- •1. Парная регрессия и корреляция

- •1.1. Оценка параметров, оценка адекватности модели

- •1.2. Виды нелинейной регрессии. Оценка параметров модели.

- •1.3. Коэффициент эластичности как характеристика силы связи фактора с результатом

- •1.4. Анализ гетероскедастичности

- •2. Множественная регрессия и корреляция

- •2.1. Нормальная линейная модель множественной регрессии

- •2.2. Традиционный метод наименьших квадратов для многомерной регрессии (ols)

- •2.3. Парный, частный и множественный коэффициент корреляции

- •3. Моделирование одномерных временных рядов

- •3.1. Основные понятия и определения

- •3.2. Требования к исходной информации

- •3.3. Этапы построения прогноза по временным рядам

- •4. Типичные примеры анализа моделей Задача 1

- •Задача 3

- •Задача 4

- •Задача 5

- •Задача 6

- •Задача 7

- •Задача 8

- •5. Задания для выполнения контрольных работ Вариант 1

- •Вариант 2

- •Вариант 3

- •Вариант 4

- •Вариант 5

- •Вариант 6

- •Вариант 7

- •Вариант 8

- •Вариант 9

- •Вариант 10

- •Приложение 1 Статистико-математические таблицы

- •Критические значения t-критерия Стьюдента при уровне значимости 0,10; 0,05; 0,01 (двухсторонний)

- •Критические значения корреляции для уровневой значимости 0,05 и 0,01

- •Значения статистик Дарбина-Уотсона для 5%-го уровня значимости

- •Критические границы отношения rs на 5% уровне значимости

- •Содержание

2. Множественная регрессия и корреляция

2.1. Нормальная линейная модель множественной регрессии

Естественным обобщением линейной регрессии с двумя переменными является многомерная регрессионная модель (multiple regression model) или модель множественной регрессии:

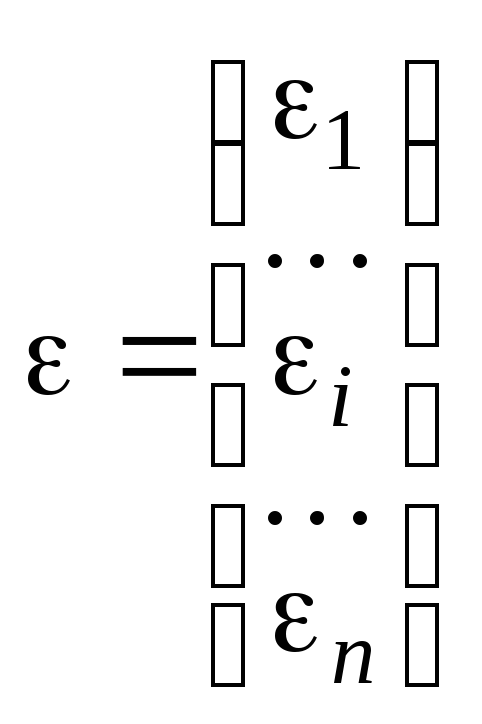

![]() (27)

(27)

где уi – значение признака-результата (зависимой переменной) для i-го наблюдения; хji – значение j-го фактора (независимей или объясняющей переменной) (j = 1;т) для i-го наблюдения; i – случайная составляющая результативного признака для i-го наблюдения; b0 – свободный член, который формально показывает среднее значение у при х1 = х2 = ... = = хт = 0; bj – коэффициент «чистой» регрессии при j-м факторе (j=1,m).

Коэффициент регрессии характеризует среднее изменение признака-результата у с изменением соответствующего фактора хj. на единицу, при условии, что прочие факторы модели не изменяются и фиксированы на средних уровнях.

Обычно для многомерной регрессионной модели делаются следующие предпосылки.

1.

![]() – детерминированные (нестохастические)

переменные.

– детерминированные (нестохастические)

переменные.

,

(i

= 1,

n)

– математическое ожидание случайной

составляющей равно 0 в любом наблюдении.

,

(i

= 1,

n)

– математическое ожидание случайной

составляющей равно 0 в любом наблюдении. ,

(i

= 1,

n)

– теоретическая дисперсия случайной

составляющей; постоянна для всех

наблюдений.

,

(i

= 1,

n)

– теоретическая дисперсия случайной

составляющей; постоянна для всех

наблюдений. – отсутствие

систематической связи между значениями

случайной составляющей в любых двух

наблюдениях.

– отсутствие

систематической связи между значениями

случайной составляющей в любых двух

наблюдениях.Часто добавляется условие:

,

т. е.i

– нормально

распределенная случайная величина.

,

т. е.i

– нормально

распределенная случайная величина.

Модель линейной множественной регрессии, для которой выполняются данные предпосылки, называется нормальной линейной регрессионной (Classical Normal Regression model).

В матричной форме нормальная (классическая) регрессионная, модель имеет вид:

![]() , (28)

, (28)

где Y – случайный вектор-столбец размерности (n1) наблюдаемых значений результативного признака; X – матрица размерности (n(m+1)) наблюдаемых значений факторных признаков. Добавление 1 к общему числу факторов т учитывает свободный член b0 в уравнении регрессии. Значения фактора х0 для свободного члена принято считать равным единице; b – вектор-столбец размерности ((т+1)1) неизвестных, подлежащих оценке параметров модели (коэффициентов регрессии); – случайный вектор-столбец размерности (n1) ошибок наблюдений.

Факторы, включаемые во множественную регрессию, должны отвечать следующим требованиям.

1. Они должны быть количественно измеримы. Если не обходимо включить в модель качественный фактор, не имеющий количественного измерения, то ему нужно придать количественную определенность (например, в модели урожайности качество почвы задается в виде баллов).

2. Каждый фактор должен быть достаточно тесно связан с результатом (т. е. коэффициент парной линейной корреляции между фактором и результатом должен существенно отличаться от нуля).

3. Факторы не должны сильно коррелировать друг с другом, тем более находиться в строгой функциональной связи (т. е. они не должны быть интеркоррелированны).

2.2. Традиционный метод наименьших квадратов для многомерной регрессии (ols)

Основная задача регрессионного

анализа заключается в нахождении по

выборке объемом n

оценки неизвестных

коэффициентов регрессии

![]() модели или вектора b.

модели или вектора b.

Оценка параметров многомерной

модели, как и в случае парной регрессии,

осуществляется обычно традиционным

методом наименьших квадратов (МНК).

Согласно данному методу, в качестве

оценки вектора 1

принимают вектор b,

который минимизирует

сумму квадратов отклонений наблюдаемых

значений yi

от рассчитанных по модели

![]() .

.

В матричной форме функционал S будет записан так:

![]() (29)

(29)

МНК-оценки в матричной форме находят по формулам:

![]() ,

где

,

где . (30)

. (30)

Оценим с помощью МНК параметры

линейной двухфакторной модели:

![]() ,i=1;

n. Для этого минимизируем

функционал:

,i=1;

n. Для этого минимизируем

функционал:

![]() (31)

(31)

Функционал S является функцией трех переменных b0, b1, b2. Чтобы найти экстремум функции нескольких переменных, нужно взять ее частные производные по этим переменным и приравнять их нулю:

![]() ,

,

![]() ,

,

![]() .

.

Получим следующую систему нормальных линейных уравнений:

(32)

(32)

Параметры этой системы могут быть найдены, например, методом К. Гаусса, либо методом итераций.

Для сравнения влияния на зависимую

переменную различных объясняющих

переменных используют стандартизированные

коэффициенты регрессии

![]() и коэффициенты эластичностиEj(j= 1, 2, …,n):

и коэффициенты эластичностиEj(j= 1, 2, …,n):

![]() ;

;![]() . (33)

. (33)

Стандартизированный коэффициент

регрессии

![]() показывает, на сколько величинSyизменится в среднем зависимая переменнаяупри увеличении толькоj-й

объясняющей переменной наSxj.

Коэффициент эластичностиEjпоказывает, на сколько процентов (от

средней) изменится в среднемупри

увеличении толькохjна 1%.

показывает, на сколько величинSyизменится в среднем зависимая переменнаяупри увеличении толькоj-й

объясняющей переменной наSxj.

Коэффициент эластичностиEjпоказывает, на сколько процентов (от

средней) изменится в среднемупри

увеличении толькохjна 1%.