- •Основные понятия.

- •1. Безусловная оптимизация (многомерные функции)

- •1.1 Методы первого порядка (градиентные методы)

- •1.1.1. Градиентный метод с постоянным шагом

- •1.1.2. Выпуклые функции и множества

- •Теорема

- •Определение.

- •Без доказательства

- •2.Теорема:

- •1.2. Градиентные методы (продолжение)

- •1.2.1. Градиентный метод с дроблением шага.

- •1.2.2. Метод наискорейшего спуска.

- •Без доказательства

- •1.2.3. Масштабирование

- •1.3. Метод Ньютона.

- •1.4. Многошаговые ( двухшаговые ) методы.

- •1.3.1. Метод тяжелого шарика

- •1.3.2. Метод сопряженных градиентов

- •1.3.3. Модификация Полака-Ривьера

- •1.5. Квазиньютоновские методы

- •1.6. Методы нулевого порядка (методы прямого поиска)

- •1.6.1. Методы аппроксимации

- •Метод покоординатного спуска

- •1.6.3. Метод симплексов (Нелдера-Мида)

- •1.6.4. Метод Пауэлла (сопряженных направлений)

- •1.7. Методы прямого поиска в задачах одномерной минимизации.

- •1.7.1. Метод квадратичной интерполяции.

- •1.7.2. Метод дихотомии ( половинного деления.).

- •1.7.3. Метод «золотого» сечения.

- •1.7.4. Метод Фибоначчи.

- •2. Условная минимизация.

- •2.1 Задача нелинейного программирования.

- •2.1.1. Ограничения типа равенства.

- •2.1.2. Ограничения типа неравенств.

- •2.2. Задача выпуклого программирования

- •2.3. Методы условной минимизации.

- •2.3.1. Метод проекции градиента.

- •2.3.2. Метод условного градиента.

- •2.3.3. Метод модифицированной функции Лагранжа.

- •2.3.4. Метод штрафных функций.

- •2.4. Двойственность звп

- •2.4.1. Двойственность злп

- •3. Линейное программирование

- •3.1. Основные понятия

- •3.2. Геометрическая интерпретация злп.

- •3.3. Условие оптимальности для злп.

- •3.4. Базис и базисное решение.

- •3.5. Симплекс - метод решения злп.

- •3.6 Транспортная задача

- •3.5.1. Построение первоначального опорного плана.

- •3.5.2. Построение оптимального плана. Метод потенциалов.

- •4. Решение переборных задач.

- •4.1. Метод ветвей и границ.

- •4.1.1. Задача о коммивояжере.

- •4.2. Динамическое программирование.

- •4.2.1. Абстрактная схема.

- •4.2.2. Вывод уравнения Беллмана.

- •4.2.3. Методика применения функции Беллмана для решения исходной задачи.

- •4.2.4. Примеры задач динамического программирования

- •5. Вариационное исчисление (ви)

- •5.1. Уравнение Эйлера-Лагранжа.

- •5.1.1. Частные случаи уравнения Эйлера-Лагранжа.

- •5.1.2. Задача о брахистохроне.

- •5.2. Вариационные задачи на условный экстремум.

- •5.2.1. Модельные задачи на условный экстремум.

- •6. Принцип максимума Понтрягина ( на примере задачи оптимального управления ).

- •6.1. Принцип максимума в задаче о быстродействии.

- •Список литературы

Без доказательства

1.2.3. Масштабирование

Пусть

f(x)

имеет вид:![]() ,

где ai>0

сильно различаются между собой.

Поверхности уровней функции вытянуты

вдоль тех осей xi,

которым соответствуют малые ai.

,

где ai>0

сильно различаются между собой.

Поверхности уровней функции вытянуты

вдоль тех осей xi,

которым соответствуют малые ai.

Для более эффективного применения градиентных методов необходимо превращение поверхностей уровня в круги

x0

x0

Заменой

переменных

![]() можно

добиться того, чтобы в новых переменныхyi

поверхности уровней стали сферами. Для

этого достаточно принять

можно

добиться того, чтобы в новых переменныхyi

поверхности уровней стали сферами. Для

этого достаточно принять

![]() (тогда

все коэффициенты квадратичной формы-

единицы).

(тогда

все коэффициенты квадратичной формы-

единицы).

В

случае, когда f(x)

не квадратичная, а достаточно гладкая

функция общего вида выбирают![]() :

:

![]()

Это диагональные элементы матрицы вторых производных. Это преобразование не превратит поверхности уровня в сферы, но в некоторых случаях позволит уменьшить их вытянутость. Гарантировано исправить вид функции f(x) можно, если учесть все, а не только диагональные элементы матрицы вторых производных и преобразования координат вида:

![]()

1.3. Метод Ньютона.

Разложим f(x) в ряд Тейлора до 2-го слагаемого включительно:

![]() (*)

(*)

![]() -

вектор

-

вектор

![]() -

матрица Гессе, матрица вторых производных.

-

матрица Гессе, матрица вторых производных.

Будем

рассматривать квадратичную аппроксимацию

f(x),

тогда получим (*)

без

![]() то есть предполагаем, что f(x)

квадратичная форма. Эта форма имеет

единственную точку min,

который является корнем уравнения f

’(x)=0.

то есть предполагаем, что f(x)

квадратичная форма. Эта форма имеет

единственную точку min,

который является корнем уравнения f

’(x)=0.

В данном случае:

![]() Метод

Ньютона

Метод

Ньютона

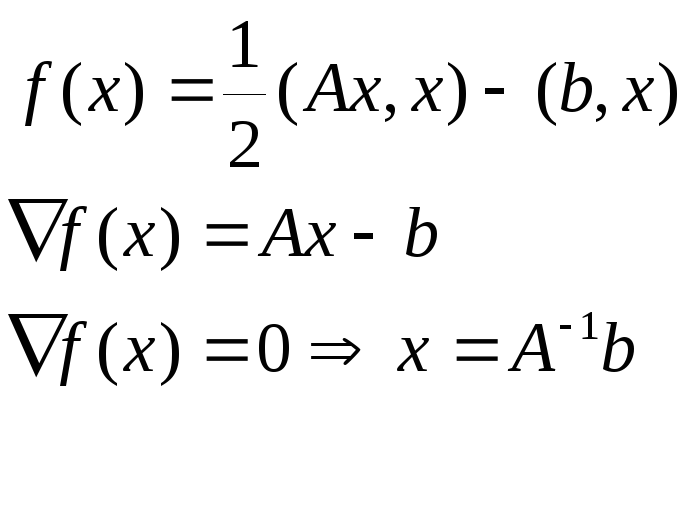

Пример:

Сделаем одну итерацию метода Ньютона для квадратичной функции

Этот пример показывает связь решения системы уравнений Ax-b = 0 и поиска минимума соответствующей функции f(x).

![]() =

A

- матрица вторых производных.

=

A

- матрица вторых производных.

Одна итерация метода Ньютона:

![]()

Но это точка минимума квадратичной функции. Таким образом для квадратичной функции метод Ньютона сходится за один шаг (матрица А должна быть положительно определена и симметрична, значения собственных чисел (растянутость) не играют роли).

Точка х1 гораздо ближе к х* , чем в градиентных методах, но надо вычислить матрицу Гессе и обратить ее. Градиентный метод медленнее, но без дополнительных вычислений.

Оценим скорость сходимости метода Ньютона:

Теорема (о скорости сходимости метода Ньютона):

Пусть

f(x)

дважды дифференцируема, матрица

![]() удовлетворяет условию

удовлетворяет условию

Липшица

с константой L

:

![]()

f(x) сильно выпукла: 0 l I 2 f(x) и начальное приближение удовлетворяет условию:

![]() (есть

требования к начальным условиям)

(есть

требования к начальным условиям)

Тогда метод Ньютона сходится к х* с квадратичной скоростью

![]()

Доказательство:

Известно, что:

1)![]()

Если

на g’(x)

удовлетворяет условию Липшица

![]() ,

то

,

то

Применим

это отношение к 2

f(x),

тогда

Применим

это отношение к 2

f(x),

тогда

Пусть x = xk и

Дано

![]() (см.

условие) тогда:

(см.

условие) тогда:

![]()

Таким

образом

![]() .

.

Пусть

q1=

![]() (обозначим). Выразим полученное неравенство

черезf(x0)

(обозначим). Выразим полученное неравенство

черезf(x0)

![]()

![]()

.........................................................................

![]()

Для сильно выпуклых функций известно

Тогда

Теорема доказана.

Если начальные условия не удовлетворяют требованиям теоремы, то метод может не сходиться.

Понятие о скорости сходимости

Пусть метод обеспечивает выполнение следующего неравенства

,

где d-

наибольшее из чисел, для которых

выполняется это условие, тогда d-

скорость сходимости метода.

,

где d-

наибольшее из чисел, для которых

выполняется это условие, тогда d-

скорость сходимости метода.

Если

обозначить k

=

,

тогда скорость сходимости

,

тогда скорость сходимости

d

=

![]() ,

при k0

(k

).

,

при k0

(k

).

Пусть k+1q k, 0 q 1. Для этого случая d =1- геометрическая скорость. Для метода Ньютона k+1= const k2 d =2 - поэтому скорость называется квадратичной.

Сравнительная таблица достоинств и недостатков градиентного метода и метода Ньютона:

|

Метод |

Достоинства |

Недостатки |

|

градиентный метод |

1. Глобальная сходимость, т.е. слабые требования на исходные данные, точка х0 может быть далека от х*. 2. Слабые требования к f(x), только f’(x) нужна 3. Относительная простота вычислений |

1. Медленная скорость сходимости (геометрическая сходимость, скорость сходимости d = 1). |

|

метод Ньютона |

1. Быстрая сходимость (квадратичная) |

|

Полезен метод Ньютона в случае квадратичной функции (сходится за один шаг).

Число обусловленности локального min.

Пусть

![]() - поверхности уровнейf(x).

- поверхности уровнейf(x).

Рассмотрим следующую величину

Очевидно, что у окружности r=1, а у эллипса r>1 (увеличивается с увеличением растянутости).

Определение:

Числом

обусловленности точки локального min

называется

![]() .

Это число дает основание для выбора

метода.

.

Это число дает основание для выбора

метода.

Определение:

Говорят, что точка локального min плохо обусловлена, если число обусловленности велико, и хорошо обусловлена, если оно близко к 1.

Пример.

Пусть f(x) = 1/2 (Ax, x). А - диагональная матрица. Тогда число обусловленности есть отношение max диагонального элемента к min диагональному элементу.

Порядок применения методов.

На первом этапе применяются методы первого порядка, так как они обеспечивают глобальную сходимость (градиентные методы).

На

втором этапе (![]() мало) - методы второго порядка (Ньютона).

мало) - методы второго порядка (Ньютона).

Перечисленные методы являются классическими, они редко применяются в чистом виде, но служат базой для других методов. Смысл модификации метода в том, чтобы использовать достоинства обоих методов, обходя недостатки.

Известен метод Марквардта-Левенберга

![]()

Если - градиентные методы

0- метод Ньютона.