- •Глава 4 непараметрические методы

- •4.1. Введение

- •4.2. Оценка плотности распределения

- •4.3. Парзеновские окна

- •4.3.1. Общие соображения

- •4.3.2. Сходимость среднего значения

- •4.3.3. Сходимость дисперсии

- •4.3.4. Два примера

- •4.4. Оценка методом kn ближайших соседей

- •4.5. Оценка апостериорных вероятностей

- •4.6. Правило ближайшего соседа

- •4.6.1. Общие замечания

- •4.6.2. Сходимость при использовании метода ближайшего соседа

- •4.6.3. Уровень ошибки для правила ближайшего соседа

- •4.6.4. Границы ошибки

- •4.7. Правило k ближайших соседей

- •4.8. Аппроксимации путем разложения в ряд

- •4.9. Аппроксимация для бинарного случая

- •4.9.1. Разложение Радемахера - Уолша

- •4.9.2. Разложение Бахадура - Лазарсфельда

- •4.9.3. Разложение Чоу

- •4.10. Линейный дискриминант Фишера

- •4.11. Множественный дискриминантный анализ

- •4.12. Библиографические и исторические сведения

4.6.4. Границы ошибки

Хотя уравнение (33) дает точный результат, еще показательнее получить границы для Р, выраженные посредством байесовского уровня Р*. Очевидной нижней границей для Р является сам уровень Р*. Кроме того, можно показать, что при любом Р* существует множество условных и априорных вероятностей, для которых эта граница достигается. Так что в этом смысле это точная нижняя граница.

Еще

интереснее задача определения точной

верхней границы. Следующее соображение

позволяет надеяться на низкую верхнюю

границу: если байесовский уровень

небольшой, то Р(![]() |х)

близка к единице для некоторого i,

скажем i=m.

Таким образом, подынтегральное

выражение в

(33) будет

приближенно

1—Р2(

|х)

близка к единице для некоторого i,

скажем i=m.

Таким образом, подынтегральное

выражение в

(33) будет

приближенно

1—Р2(![]() |х)

2(1—Р(

|х)

2(1—Р(![]() |х)),

и поскольку

|х)),

и поскольку

Р*(е|х)=1-Р(![]() |х),

(34)

|х),

(34)

то

интегрирование по х может дать уровень,

в два раза превышающий байесовский, но

являющийся все еще низким. Чтобы получить

точную верхнюю границу, мы должны

определить, насколько большим может

стать уровень Р

ошибки правила ближайшего соседа для

заданного байесовского уровня Р*.

Таким образом, выражение

(33) вынуждает

нас задаться вопросом, насколько малой

может стать

![]() для

заданной р(

для

заданной р(![]() |х).

Записав

|х).

Записав

![]() ,

,

мы можем получить границу этой суммы, минимизируя второй член при следующих ограничениях:

1)

Р(![]() |х)0;

|х)0;

2)

![]()

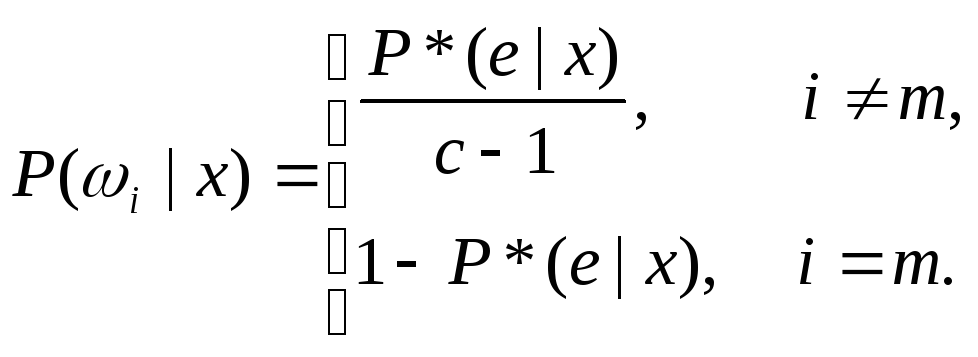

Несколько

поразмыслив, мы видим, что

![]() минимизируется,

если все апостериорные вероятности,

кроме т-й,

равны, и второе ограничение дает

минимизируется,

если все апостериорные вероятности,

кроме т-й,

равны, и второе ограничение дает

(35)

(35)

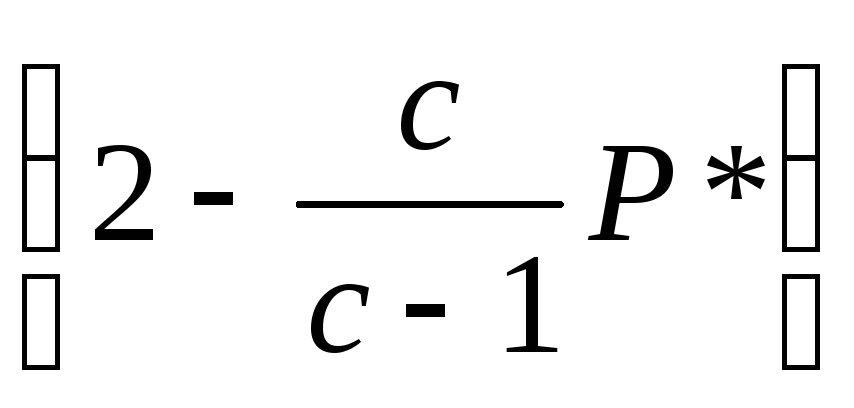

Таким образом,

![]() (1-P*(e|x))2+

(1-P*(e|x))2+![]()

и

1-![]()

2P*(e|x)-

2P*(e|x)-![]() P*2(e|x).

(36)

P*2(e|x).

(36)

Сразу же видим, что Р2Р*, поэтому можем подставить этот результат в (33) и просто опустить второй член выражения. Однако более точную границу можно получить на основании

так что

![]()

причем равенство сохраняется тогда и только тогда, когда дисперсия Р*(е|х) равна нулю. Пользуясь этим результатом и подставляя соотношение (36) в (33), получаем желаемые границы

Р*РР* . (28)

. (28)

Легко

показать, что такая верхняя граница

достигается в случае так называемой

нулевой информации, в котором плотности

распределения p(х|![]() )

тождественны, так что Р(

)

тождественны, так что Р(![]() |х)=р(

|х)=р(![]() )

и Р*(е|х)

не зависит от х. Таким образом, границы,

заданные

(28), являются

максимально близкими в том смысле, что

для любой Р*

существуют условные и априорные

вероятности, для которых эти границы

достигаются. На рис.

4.4 графически

представлены эти границы. Байесовский

уровень Р*

может находиться в любом месте между

О и (с—1)/с.

Границы сходятся в этих двух крайних

точках. Когда байесовский уровень мал,

верхняя граница превышает его почти в

два раза. В общем значение ошибки правила

ближайшего соседа должно находиться

в заштрихованной области.

)

и Р*(е|х)

не зависит от х. Таким образом, границы,

заданные

(28), являются

максимально близкими в том смысле, что

для любой Р*

существуют условные и априорные

вероятности, для которых эти границы

достигаются. На рис.

4.4 графически

представлены эти границы. Байесовский

уровень Р*

может находиться в любом месте между

О и (с—1)/с.

Границы сходятся в этих двух крайних

точках. Когда байесовский уровень мал,

верхняя граница превышает его почти в

два раза. В общем значение ошибки правила

ближайшего соседа должно находиться

в заштрихованной области.

Поскольку Р всегда меньше или равна 2Р*, то, если имеется бесконечный набор данных и используется сложное решающее правило, можно по крайней мере в два раза сократить уровень ошибки. В этом смысле по крайней мере половина классифицирующей информации бесконечного набора данных находится по соседству.

Естественно задаться вопросом, насколько хорошо правило ближайшего соседа в случае конечного числа выборок и как быстро результат сходится к асимптотическому значению. К сожалению, ответы для общего случая неблагоприятны. Можно показать, что сходимость может быть бесконечно медленной и уровень ошибки Рn(е) даже не должен монотонно убывать с ростом п. Так же, как это происходит с другими непараметрическими методами, трудно получить какие-либо еще результаты, кроме асимптотических, не делая дальнейших допущений о вероятностных свойствах.

Рис. 4.4. Границы ошибки правила ближайшего соседа