- •2. Идентификация модели системы

- •Постановка задачи идентификации

- •Выбор формы модели идентификации

- •Линейная одномерная регрессионная модель

- •2.2.4. Проверка адекватности модели

- •Линейная множественная модель

- •Нелинейные регрессионные модели

- •А) Полиномиальная множественная регрессионная модель

- •Б) Мультипликативная регрессионная модель

- •В) Обратная регрессионная модель

- •Г) Экспоненциальная модель

- •Выбор оптимальной модели идентификации

- •А) метод группового учета аргументов (мгуа)

- •Б) метод исключений

- •Б) метод включения

- •Методы планирования эксперимента с моделями систем

- •2.3.1. Полный факторный эксперимент (пфэ)

- •Статистическая обработка результатов пфэ

- •2.3.2. Дробный факторный эксперимент (дфэ)

- •2.3.3. Интерпретация результатов

- •2.3.4. Планирование экспериментов при поиске оптимальных условий

- •3.3. Планирование второго порядка

- •3.4. Поиск оптимальной области

- •3.5. Стратегическое планирование машинных

- •3.6. Тактическое планирование

- •3.7. Анализ результатов моделирования

- •3.7.1. Проверка адекватности системы

- •3.7.2. Проверка значимости коэффициентов

- •3.7.3. Обоснованность модели

- •Контрольные вопросы

Линейная множественная модель

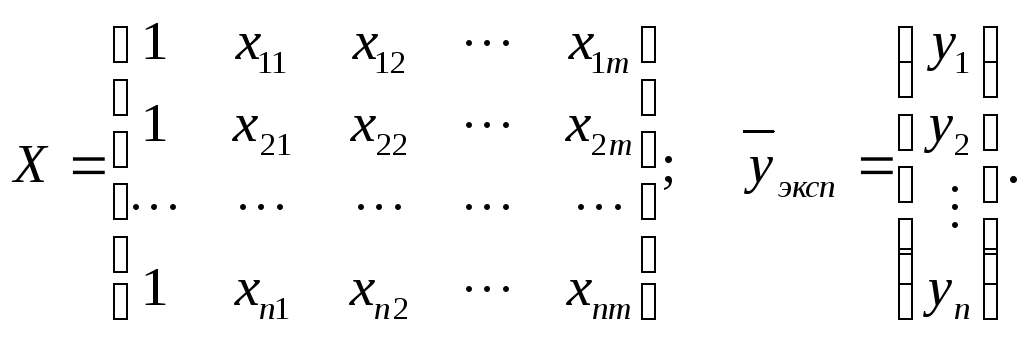

Включение в регрессионную модель новых переменных усложняет получаемые формулы и вычисления. Это приводит к целесообразности матричных обозначений. Матричное описание регрессии облегчает как теоретический анализ, так и необходимые расчетные процедуры.

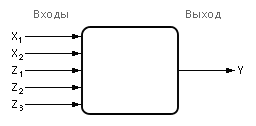

Предположим, что функциональная структура ящика снова имеет линейную зависимость, но количество входных сигналов, действующих одновременно на объект, равно m (см. рис. 2.7):

![]() .

(2.8)

.

(2.8)

Рис. 2.7. Обозначение многомерного черного ящика на схемах

Исходными

данными при оценке параметров

![]() является прямоугольная матрица входов

Х

и вектор результатов

является прямоугольная матрица входов

Х

и вектор результатов

![]()

(2.9)

(2.9)

Строки

матрицы Х

соответствуют результатам регистрации

всех наблюдаемых параметров объекта в

одном эксперименте, а столбцы содержат

результаты наблюдений за одним параметром

(фактором) во всех экспериментах. Первый

столбец матрицы Х,

состоящий из единиц, соответствует

коэффициенту модели

![]() .

.

Уравнение регрессии (2.8) в матричной форме для данных (2.9) имеет вид

![]() ,

,

где

![]() - вектор-столбец параметров модели.

- вектор-столбец параметров модели.

Применяя

метод наименьших квадратов, нужно найти

минимум суммы

![]() .

(2.10)

.

(2.10)

Учитывая,

что при транспонировании произведения

матриц получается произведение матриц,

взятых в обратном порядке, т.е.

![]() после раскрытия скобок получим:

после раскрытия скобок получим:

![]() .

(2.11)

.

(2.11)

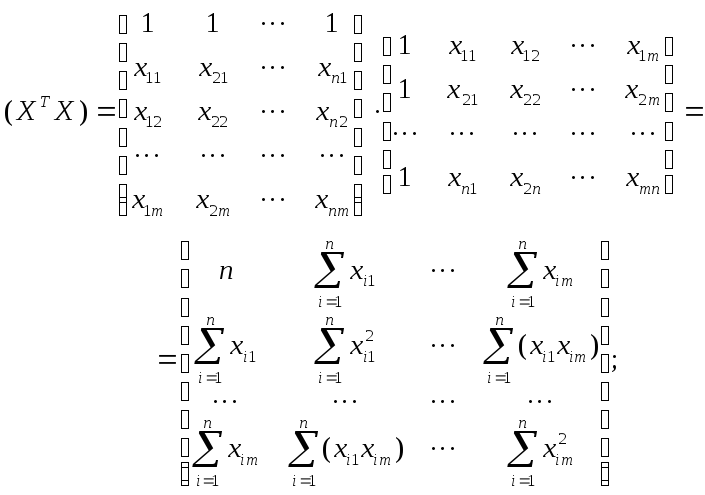

Произведение

![]() есть матрица размера

есть матрица размера

![]() ,

,

т.е. величина скалярная, следовательно, оно не меняется при транспонировании, т.е.

![]() .

.

Поэтому условие минимизации (2.11) примет вид:

![]() .

(2.12)

.

(2.12)

На

основании необходимого условия экстремума

функции нескольких переменных

![]() необходимо приравнять нулю частные

производные по этим переменным или в

матричной форме – вектор частных

производных

необходимо приравнять нулю частные

производные по этим переменным или в

матричной форме – вектор частных

производных

![]() .

.

Для вектора частных производных в курсе высшей математики доказаны следующие формулы:

![]() ,

,

где a и c – вектор-столбцы; A – симметричная матрица.

![]() .

.

Полагая

![]() ,

а матрицу

,

а матрицу![]() (она является симметричной), найдем:

(она является симметричной), найдем:

![]() ,

,

откуда

получаем систему нормальных уравнений

в матричной форме для определения

вектора

![]() :

:

![]() .

(2.13)

.

(2.13)

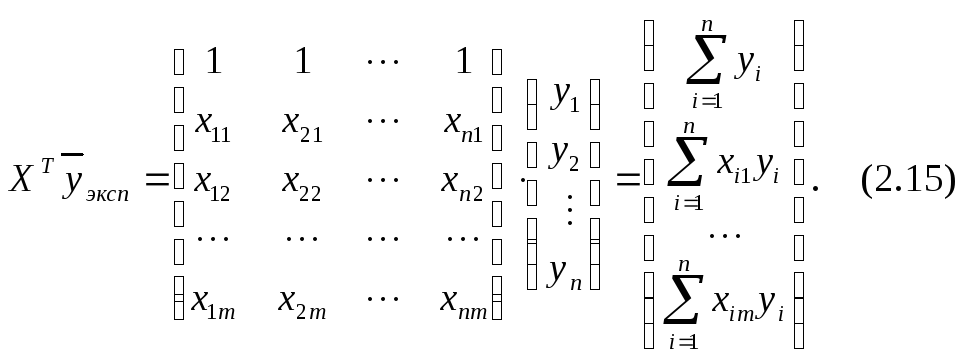

Раскроем последнее выражение

(2.14)

(2.14)

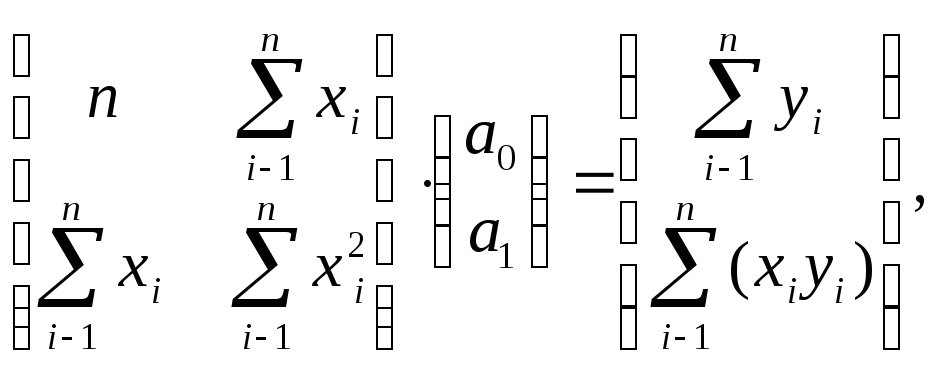

В частном случае из рассматриваемого матричного уравнения (2.13) с учетом (2.14) и (2.15) для одной переменной (m=1) нетрудно получить уже рассмотренную систему нормальных уравнений (2.7). Действительно, в этом случае матричное уравнение (2.13) принимает вид:

откуда непосредственно следует система нормальных уравнений для парной линейной регрессии.

Умножая

слева обе части уравнения (2.13) на обратную

матрицу

![]()

![]() определим искомые коэффициенты уравнения

регрессии (2.8)

определим искомые коэффициенты уравнения

регрессии (2.8)

![]() .

.

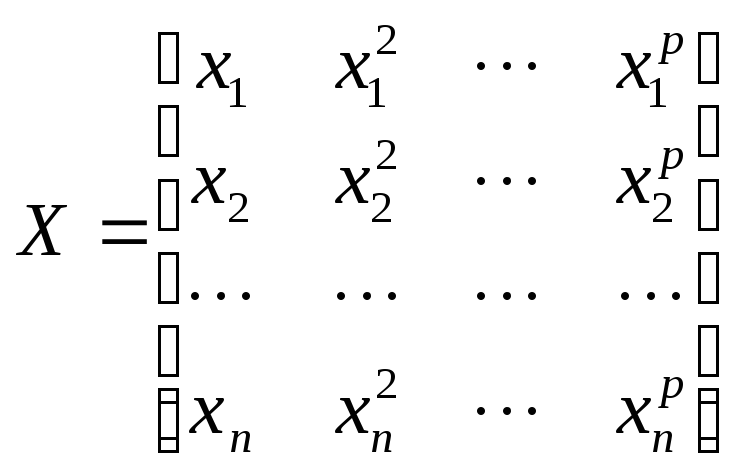

Если уравнение регрессии задано в виде полинома степени p

![]()

то матрица X называется матрицей Вандермонда и имеет следующую структуру

.

.

Нелинейные регрессионные модели

В данном разделе покажем, как нелинейная регрессионная модель может быть сведена к исследованию линейной множественной модели.

А) Полиномиальная множественная регрессионная модель

Если черный ящик имеет, например, два входа, а зависимость выхода от входов напоминает квадратичную, то целесообразно выбрать такую гипотезу:

![]() .

.

Обозначим:

![]()

![]()

![]() и

подставим эти выражения в предыдущую

формулу:

и

подставим эти выражения в предыдущую

формулу:

![]() .

.

Таким образом, данная задача сведена к линейной множественной модели. А модель черного ящика теперь выглядит так, как показано на рис. 2.8.

Рис. 2.8. Преобразованная модель черного ящика

Далее

используется метод наименьших квадратов.

Как и раньше: строится система нормальных

уравнений, и определяются значения

![]() .

.