- •Методи побудови загальної лінійної моделі

- •4.2. Специфікація моделі

- •4.3. Передумови застосування методу найменших квадратів (1мнк)

- •4.4. Оператор оцінювання 1мнк

- •4.5. Властивості оцінок параметрів

- •4.6. Коваріаційна матриця оцінок параметрів моделі

- •4.7. Прогноз залежної змінної.

- •4.8. Оцінювання прогнозних можливостей моделі

- •4.9. Побудова економетричної моделі на основі покрокової регресії

- •4.10. Коефіцієнти детермінації і кореляції

- •4.11. Частинні коефіцієнти кореляції та коефіцієнти регресії

- •4.12. Перевірка значущості та інтервали довіри

- •4.12.1. Значущість економетричної моделі. Гіпотезу про рівень значущості зв’язку між залежною і пояснювальними змінними можна перевірити за допомогою f-критерію:

- •Мультиколінеарність

- •6.2. Основні наслідки мультиколінеарності

- •1. Дисперсія і коваріація оцінок параметрів моделі різко збільшуються.

- •2. Похибки оцінок параметрів значно збільшуються, відповідно збільшуються їхні інтервали довіри.

- •6.3. Ознаки мультиколінеарності

- •6.4. Алгоритм Фаррара—Глобера

- •Гетероскедастичність

- •7.2. Наслідки гетероскедастичності

- •7.3. Методи визначення гетероскедастичності

- •1) ;2);

- •7.4. Визначення матриці s

- •7.5. Узагальнений метод найменших квадратів (метод Ейткена)

- •7.6. Прогноз

- •1. Дослідимо гетероскедастичність на основі тесту Гольфельда—Квандта.

- •61,531049,

- •58,595781.

- •Автокореляція

- •8.2. Перевірка наявності автокореляції

- •8.3. Оцінвання параметрів моделі з автокорельованими залишками

- •8.4. Прогноз

- •6.5. Методи звільнення від мультиколінеарності

6.3. Ознаки мультиколінеарності

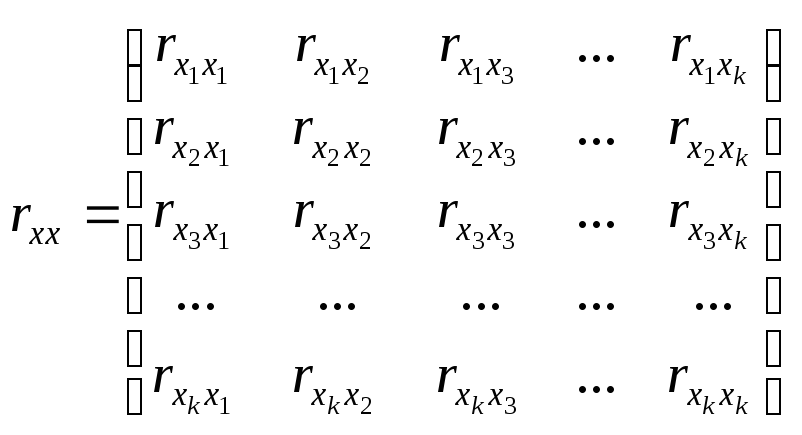

Коли серед парних коефіцієнтів кореляції пояснювальних змінних є такі, рівень яких наближається або дорівнює множинному коефіцієнту кореляції, то це означає можливість існування мультиколінеарності. Інформацію про парну кореляцію може дати симетрична матриця коефіцієнтів парної кореляції між пояснювальними змінними:

. (6.6)

. (6.6)

Проте коли до моделі входять більш як дві пояснювальні змінні, то вивчення питання про мультиколінеарність не може обмежуватись інформацією, що її дає ця матриця. Явище мультиколінеарності в жодному разі не зводиться лише до існування парної кореляції між пояснювальними змінними.

Більш

загальна перевірка передбачає знаходження

визначника (детермінанта) матриці rxx,

який є детермінантом кореляції і

позначається

![]() .

Числові значення детермінанта кореляції

задовільняють

умову:

.

Числові значення детермінанта кореляції

задовільняють

умову:

![]() .

.

Якщо

![]() ,

то існує повна мультиколінеарність, а

коли

,

то існує повна мультиколінеарність, а

коли![]() = 1,

мультиколінеарність відсутня. чим

ближче

= 1,

мультиколінеарність відсутня. чим

ближче

![]() до нуля, тим певніше можна стверджувати,

що між пояснювальними змінними існує

мультиколінеарність. Незважаючи на те,

що на числове значення

до нуля, тим певніше можна стверджувати,

що між пояснювальними змінними існує

мультиколінеарність. Незважаючи на те,

що на числове значення![]() впливає дисперсія пояснювальних змінних,

цей показник можна вважати точковою

мірою рівня мультиколінеарності.

впливає дисперсія пояснювальних змінних,

цей показник можна вважати точковою

мірою рівня мультиколінеарності.

Коли

коефіцієнт частинної детермінації

![]() ,

який обчислено для регресійних залежностей

міжk-ю

пояснювальною

змінною та рештою, має значення, близьке

до одиниці, то можна говорити про

наявність мультиколінеарності.

,

який обчислено для регресійних залежностей

міжk-ю

пояснювальною

змінною та рештою, має значення, близьке

до одиниці, то можна говорити про

наявність мультиколінеарності.

Якщо

в економетричній моделі знайдено мале

значення оцінки параметра

![]() за високого рівня частинного коефіцієнта

детермінації

за високого рівня частинного коефіцієнта

детермінації![]() і водночасF-критерій

істотно відрізняється від нуля, то це

також може свідчити про наявність

мультиколінеарності.

і водночасF-критерій

істотно відрізняється від нуля, то це

також може свідчити про наявність

мультиколінеарності.

Якщо під час побудови економетричної моделі на основі покрокової регресії введення нової пояснювальної змінної істотно змінює оцінку параметрів моделі за незначного підвищення (або зниження) коефіцієнтів кореляції чи детермінації, то ця змінна перебуває, очевидно, у лінійній залежності від інших, що їх було введено до моделі раніше.

Усі ці ознаки мультиколінеарності мають один спільний недолік: ні одна з них чітко не розмежовує випадки, коли залежність між пояснювальними змінними істотна і коли нею можна знехтувати.

6.4. Алгоритм Фаррара—Глобера

Найповніше

дослідити мультиколінеарність можна

застосувавши алгоритм Фаррара—Глобера.

Цей алгоритм має три види статистичних

критеріїв, згідно з якими перевіряється

мультиколінеарність усього масиву

пояснювальних змінних (![]() — «хі»-квадрат); кожної пояснювальної

змінної з рештою змінних (F-критерій);

кожної пари пояснювальних змінних

(t-критерій).

— «хі»-квадрат); кожної пояснювальної

змінної з рештою змінних (F-критерій);

кожної пари пояснювальних змінних

(t-критерій).

Усі ці критерії при порівнянні з їхніми критичними значеннями дають змогу робити конкретні висновки щодо наявності чи відсутності мультиколінеарності пояснювальних змінних.

Опишемо алгоритм Фаррара—Глобера.

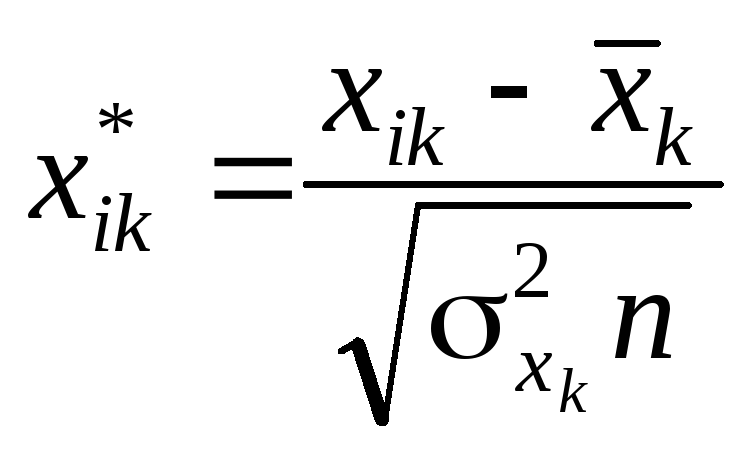

Крок 1. Нормалізація змінних.

Позначимо

вектори пояснювальних змінних

економетричної моделі через

![]() .

Елементи нормалізованих векторів

обчислимо за формулами:

.

Елементи нормалізованих векторів

обчислимо за формулами:

1) ![]() ;

2)

;

2) , (6.7)

, (6.7)

де

![]() — кількість спостережень

— кількість спостережень![]() ;

;![]() — кількість пояснювальних змінних

— кількість пояснювальних змінних![]() ;

;![]() — середнє арифметичнеk-ї

пояснювальної змінної;

— середнє арифметичнеk-ї

пояснювальної змінної;

![]() — дисперсіяk-ї

пояснювальної змінної.

— дисперсіяk-ї

пояснювальної змінної.

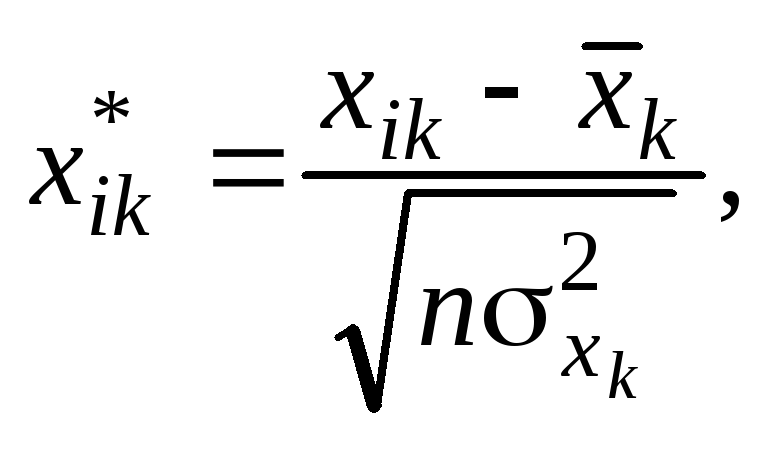

Крок 2. Знаходження кореляційної матриці згідно з двома методами нормалізації змінних:

1) ![]() ;

2)

;

2)![]() , (6.8)

, (6.8)

де

![]() —

матриця нормалізованих незалежних

(пояснювальних) змінних,

—

матриця нормалізованих незалежних

(пояснювальних) змінних,![]() —

матриця, транспонована до матриці

—

матриця, транспонована до матриці![]() .

.

Крок

3.

Визначення критерію

![]() («хі»-квадрат):

(«хі»-квадрат):

![]() , (6.9)

, (6.9)

де

![]() — визначник кореляційної матриціrxx.

— визначник кореляційної матриціrxx.

Значення

цього критерію порівнюється з табличним

при

![]() ступенях свободи і рівні значущості

ступенях свободи і рівні значущості![]() .

Якщо

.

Якщо![]() ,

то в масиві пояснювальних змінних існує

мультиколінеарність.

,

то в масиві пояснювальних змінних існує

мультиколінеарність.

Крок 4. Визначення оберненої матриці:

![]() . (6.10)

. (6.10)

Крок 5. Обчислення F-критеріїв:

![]() , (6.11)

, (6.11)

де

![]() — діагональні елементи матриціC.

Фактичні значення критеріїв порівнюються

з табличними при m – 1

і n – m

ступенях свободи і рівні значущості .

Якщо Fk

факт > Fтабл,

то відповідна k-та

пояснювальна змінна мультиколінеарна

з іншими.

— діагональні елементи матриціC.

Фактичні значення критеріїв порівнюються

з табличними при m – 1

і n – m

ступенях свободи і рівні значущості .

Якщо Fk

факт > Fтабл,

то відповідна k-та

пояснювальна змінна мультиколінеарна

з іншими.

Коефіцієнт детермінації для кожної змінної

![]() .

(6.12)

.

(6.12)

Якщо коефіцієнт детермінації наближається до одиниці, то пояснювальна змінна мультиколінеарна з іншими.

Крок 6. Знаходження частинних коефіцієнтів кореляції:

![]() (6.13)

(6.13)

де

![]() — елемент матриціC,

що міститься в k-му

рядку і j-му

стовпці;

— елемент матриціC,

що міститься в k-му

рядку і j-му

стовпці;

![]() i

i![]() — діагональні елементи матриціC.

— діагональні елементи матриціC.

Крок 7. Обчислення t-критеріїв:

.

(6.14)

.

(6.14)

Фактичні

значення критеріїв

![]() порівнюються з табличними при

порівнюються з табличними при![]() ступенях свободи і рівні значущості

ступенях свободи і рівні значущості![]() .

Якщоtkj > tтабл,

то між пояснювальними змінними

.

Якщоtkj > tтабл,

то між пояснювальними змінними

![]() і

і![]() існує мультиколінеарність.

існує мультиколінеарність.

Розглянемо застосування алгоритму Фаррара—Глобера до розв’язування конкретної задачі.

Приклад 6.1. На середньомісячну заробітну плату впливає ряд чинників. Вирізнимо серед них продуктивність праці, фондомісткість та коефіцієнт плинності робочої сили. Щоб побудувати економетричну модель заробітної плати від згаданих чинників згідно з методом найменших квадратів, потрібно переконатися, що продуктивність праці, фондомісткість та коефіцієнт плинності робочої сили як незалежні змінні моделі — не мультиколеніарні.

Вихідні дані наведені в табл. 6.1.

Таблиця 6.1

Дослідити наведені чинники на наявність мультиколеніарністі.

Розв’язання.

Крок 1. Нормалізація змінних.

Позначимо

вектори незалежних змінних — продуктивності

праці, фондомісткості, коефіцієнтів

плинності робочої сили — через

![]() .

Елементи стандартизованих векторів

обчислимо за формулою:

.

Елементи стандартизованих векторів

обчислимо за формулою:

де

n

—

кількість спостережень, n = 10;

m

—

число незалежних змінних, m = 3;

![]() — середнє арифметичне значення вектора

— середнє арифметичне значення вектора![]() ;

;![]() — дисперсія змінної

— дисперсія змінної![]() .

.

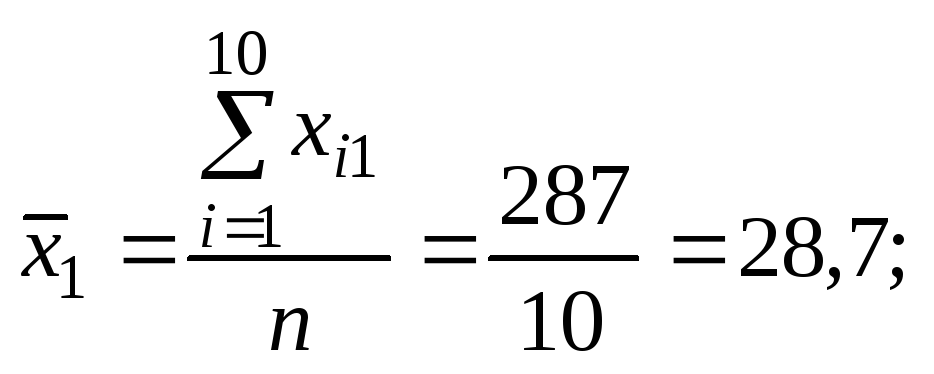

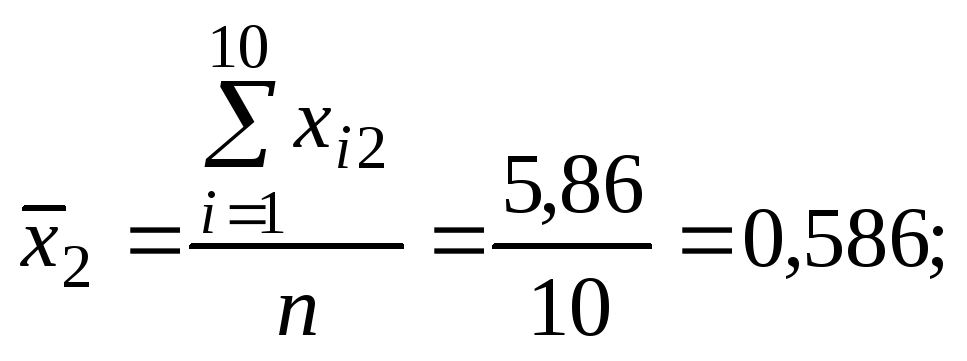

Із формули бачимо, що спочатку потрібно обчислити середні арифметичні для кожної пояснювальної змінної:

Усі

розрахункові дані для стандартизації

змінних

![]() згідно з поданими співвідношеннями

наведено в табл. 6.2.

згідно з поданими співвідношеннями

наведено в табл. 6.2.

Таблиця 6.2

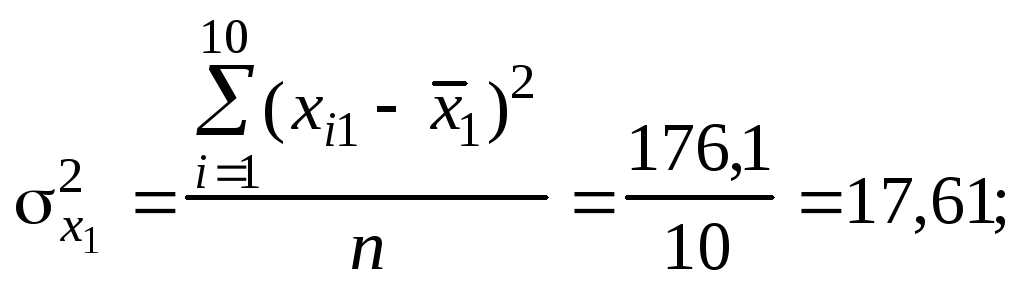

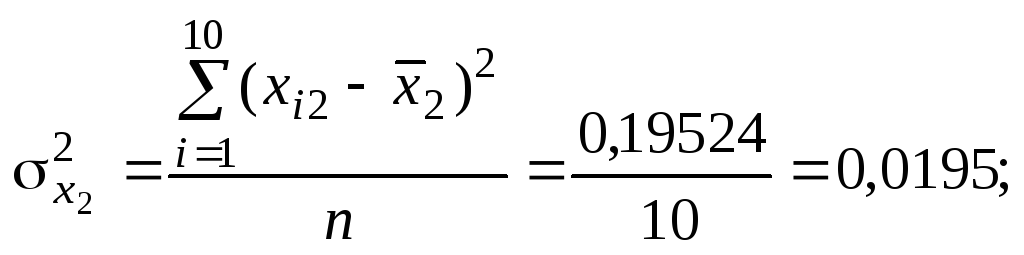

Дисперсії кожної незалежної змінної мають такі значення:

Тоді знаменник для стандартизації кожної незалежної змінної буде такий:

![]() :

:

![]()

![]() :

:

![]()

![]() :

:

![]()

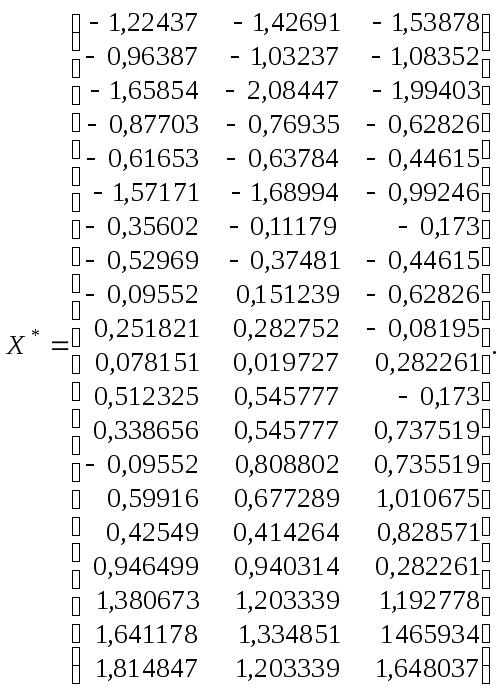

Матриця стандартизованих змінних подається у вигляді:

.

.

Крок 2. Знаходження кореляційної матриці:

![]()

де

![]() —

матриця, транспонована до

—

матриця, транспонована до![]() .

.

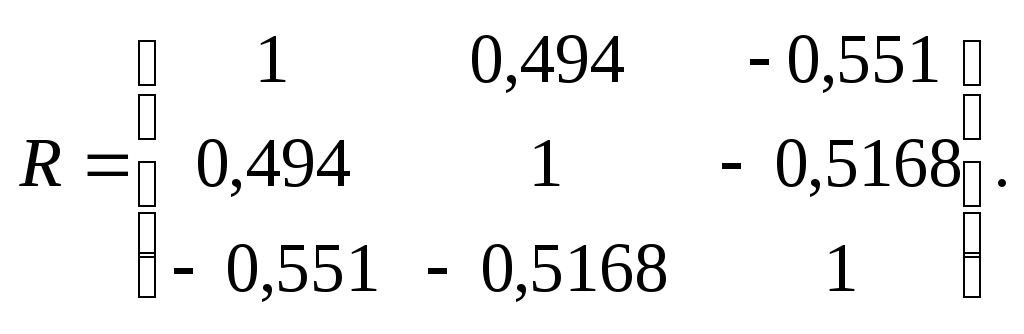

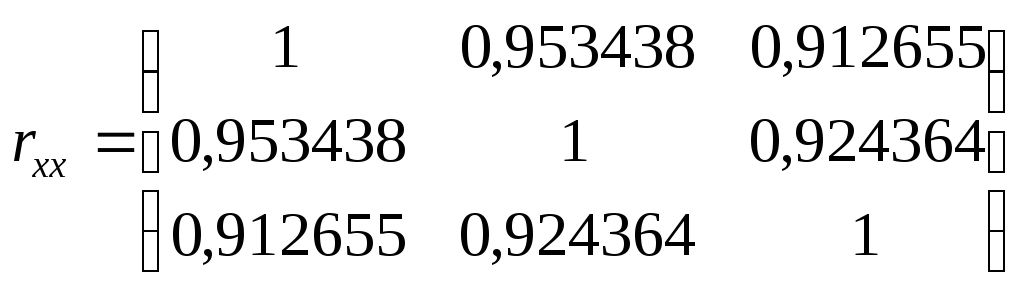

Ця матриця симетрична і має розмір 3 × 3.

Для даної задачі

Кожний

елемент цієї матриці характеризує

тісноту зв’язку однієї незалежної

змінної з іншою. Оскільки діагональні

елементи характеризують тісноту зв’язку

кожної незалежної з цією самою змінною,

то вони дорівнюють одиниці. Зауважимо,

що при знаходженні добутку матриць

![]()

![]() за рахунок зміщеності коефіцієнтів

парної кореляції числові значення

діагональних елементів можуть наближатись

до одиниці. Якщо це так, то вони заміняються

одиницями, а інші значення матриціr

збільшуються на величину, що визначається

як різниця між одиницею і діагональним

елементом.

за рахунок зміщеності коефіцієнтів

парної кореляції числові значення

діагональних елементів можуть наближатись

до одиниці. Якщо це так, то вони заміняються

одиницями, а інші значення матриціr

збільшуються на величину, що визначається

як різниця між одиницею і діагональним

елементом.

Інші елементи матриці r дорівнюють:

![]()

![]()

![]()

тобто

вони є парними коефіцієнтами кореляції

між пояснювальними змінними. Користуючись

цими коефіцієнтами, можна зробити

висновок, що між змінними

![]() існує зв’язок. Але чи можна стверджувати,

що цей зв’язок є виявленням

мультиколінеарності, а через це негативно

впливатиме на оцінку економетричної

моделі?

існує зв’язок. Але чи можна стверджувати,

що цей зв’язок є виявленням

мультиколінеарності, а через це негативно

впливатиме на оцінку економетричної

моделі?

Щоб відповісти на це запитання, потрібно ще раз звернутися до алгоритму Фаррара — Глобера і знайти статистичні критерії оцінки мультиколінеарності.

Крок

3. Обчислимо

детермінант кореляційної матриці r

і критерій

![]() :

:

а)

![]()

б)

![]()

При

ступені свободи

![]() і рівні значущості

і рівні значущості![]() = 0,01

критерій

= 0,01

критерій![]() табл

= 11,34. оскільки

табл

= 11,34. оскільки

![]() факт

<

факт

<

![]() табл,

доходимо висновку, що в масиві змінних

не існує мультиколінеарності.

табл,

доходимо висновку, що в масиві змінних

не існує мультиколінеарності.

Крок 4. Знайдемо матрицю, обернену до матриці r:

Крок 5. Використовуючи діагональні елементи матриці C, обчислимо F-критерії:

![]()

![]()

![]()

Для

рівня значущості

![]() = 0,05 і ступенів свободи

= 0,05 і ступенів свободи![]() = 7

і

= 7

і![]() = 2

критичне (табличне) значення критеріюF

= 4,74.

= 2

критичне (табличне) значення критеріюF

= 4,74.

Оскільки

F1факт < Fтабл;

F2факт < Fтабл;

F3факт < Fтабл,

то ні одна з незалежних змінних не мультиколінеарна з двома іншими.

Щоб визначити наявність попарної мультиколінеарності, продовжимо дослідження і перейдемо до кроку 6.

Ї

Крок 6. Обчислимо частинні коефіцієнти кореляції, скориставшись елементами матриці C:

![]()

![]()

![]()

Частинні коефіцієнти кореляції характеризують тісноту зв’язку між двома змінними за умови, що третя не впливає на цей зв’язок.

Порівнявши частинні коефіцієнти кореляції з парними, які було наведено раніше, можна помітити, що частинні коефіцієнти значно менші за парні. Це ще раз показує, що на підставі парних коефіцієнтів кореляції не можна зробити висновків про наявність мультиколінеарності чи її відсутність.

Крок 7. Визначимо t-критерій на основі частинних коефіцієнтів кореляції.

Табличне

значення t-критерію

при

![]() = 7

ступенях свободи і рівні значущості

= 0,05

дорівнює 1,69. Усі числові значення

t-критеріїв,

знайдених для кожної пари змінних, менші

за їх табличні значення. Звідси робимо

висновок, що всі пари незалежних змінних

не є мультиколінеарними.

= 7

ступенях свободи і рівні значущості

= 0,05

дорівнює 1,69. Усі числові значення

t-критеріїв,

знайдених для кожної пари змінних, менші

за їх табличні значення. Звідси робимо

висновок, що всі пари незалежних змінних

не є мультиколінеарними.

Отже, незважаючи на те, що між пояснювальними змінними досліджуваної моделі існує лінійна залежність, це не мультиколінеарність, тобто негативного впливу на кількісні оцінки параметрів економетричної моделі, не буде.

Якщо F-критерій більший за табличне значення, тобто коли k-та змінна залежить від усіх інших у масиві, то необхідно вирішувати питання про її вилучення з переліку змінних.

Якщо

![]() — критерій більший за табличний, то ці

дві змінні (

— критерій більший за табличний, то ці

дві змінні (![]() і

і![]() )

тісно пов’язані одною з одною. Звідси,

аналізуючи рівень обох видів критеріїв

)

тісно пов’язані одною з одною. Звідси,

аналізуючи рівень обох видів критеріїв![]() і

і![]() ,

можна зробити обгрунтований висновок

про те, яку зі змінних необхідно вилучити

з дослідження або замінити іншою. Проте

заміна масиву незалежних змінних завжди

має узгоджуватись з економічною

доцільністю, що випливає з мети

дослідження.

,

можна зробити обгрунтований висновок

про те, яку зі змінних необхідно вилучити

з дослідження або замінити іншою. Проте

заміна масиву незалежних змінних завжди

має узгоджуватись з економічною

доцільністю, що випливає з мети

дослідження.

Найпростіше позбутися мультиколінеарності в економетричній моделі можна, відкинувши одну зі змінних мультиколінеарної пари. Але на практиці вилучення якогось чинника часто суперечить логіці економічних зв’язків. Тоді можна перетворити певним чином пояснювальні змінні моделі:

а) взяти відхилення від середньої;

б) замість абсолютних значень взяти відносні;

в) стандартизувати пояснювальні змінні

і т. iн.

За наявності мультиколінеарності змінних потрібно звертати увагу й на специфікацію моделі. Іноді заміна однієї функції іншою, якщо це не суперечить апріорній інформації, дає змогу уникнути явища мультиколінеарності.

Коли жодний з розглянутих способів не дає змоги позбутися мультиколінеарності, то параметри моделі слід оцінювати за методом головних компонентів.

Приклад 6.2.(ЛАБ)На основі даних про чинники, що впливають на прибуток (табл. 6.3), дослідити їх на наявність мультиколінеарності за допомогою алгоритму Фаррара—Глобера, що містить три статистичні критерії:

2;

F-критерій;

t-критерій.

|

Прибуток, гр. од. |

Інвестиції, гр. од. |

ОВФ, гр. од. |

ФРЧ, людино-днів |

|

(у) |

(x1) |

(х2) |

(хЗ) |

|

39 |

62 |

22 |

104 |

|

41 |

65 |

25 |

109 |

|

38 |

57 |

17 |

99 |

|

42 |

66 |

27 |

114 |

|

44 |

69 |

28 |

116 |

|

49 |

58 |

20 |

110 |

|

44 |

72 |

32 |

119 |

|

45 |

70 |

30 |

116 |

|

48 |

75 |

34 |

114 |

|

51 |

79 |

35 |

120 |

|

49 |

77 |

33 |

124 |

|

54 |

82 |

37 |

119 |

|

55 |

80 |

37 |

129 |

|

57 |

75 |

39 |

129 |

|

56 |

83 |

38 |

132 |

|

54 |

81 |

36 |

130 |

|

59 |

87 |

40 |

124 |

|

61 |

92 |

42 |

134 |

|

62 |

95 |

43 |

137 |

|

64 |

97 |

42 |

139 |

Нормалізацію (стандартизацію) пояснювальних змінних моделі.

Розрахунок кореляційної матриці rxx.

Визначення детермінанта матриці rxx.

Визначення критерію 2.

Розрахунок матриці, оберненої до матриці rxx.

Визначення F-критерію.

Обчислення частинних коефіцієнтів кореляції.

Визначення t-критерію.

1. Нормалізація (стандартизація) пояснювальних змінних моделі.

Обчислимо середні арифметичні пояснювальних змінних:

,

,

![]() .

.

Визначимо стандартні відхилення:

,

,

![]() .

.

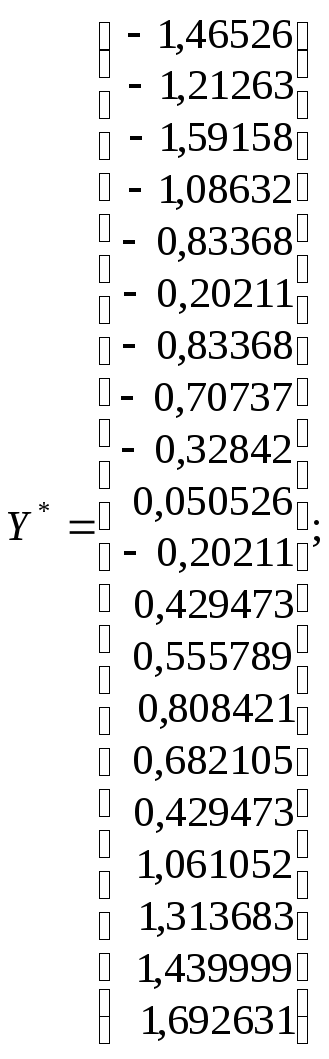

Нормалізуємо залежну та пояснювальні змінні:

![]() ;

;

![]() ;

;

2. Розрахунок кореляційної матриці нульового порядку.

![]() ,

,

де X* — матриця нормалізованих пояснювальних змінних;

![]() —матриця,

транспонована до X*.

—матриця,

транспонована до X*.

Маємо:

.

.

Парні коефіцієнти кореляції характеризують тісноту зв’язку між двома змінними. Вони можуть змінюватися в межах від – 1 до 1. У нашому випадку:

r12 = 0,953; r13 = 0,912; r23 = 0,924.

Ці коефіцієнти парної кореляції близькі до одиниці, тому можна передбачити, що всі досліджувані пояснювальні змінні є мультиколінеарними.

3. Визначення детермінанта матриці rxx:

det r = 0,012257.

Детермінант матриці rxx є точковою мірою мультиколінеарності, в нашому випадку він наближається до 0 (0,012257), а отже, мультиколінеарність існує.

4. Визначення критерію 2:

![]() ,

,

де n — кількість спостережень; m — кількість пояснювальних змінних.

Виконавши обчислення, дістанемо:

![]() ;

;

![]() ;

при

;

при![]() .

.

Фактично

обчислене значення критерію 2

порівнюємо з табличним за вибраного

рівня значущості

і даних ступенів свободи:

![]() .

.

Доходимо висновку, що

![]() >

>![]() .

.

Отже,

![]() більше за

більше за![]()

![]() ,

а це означає, що в масиві пояснювальних

змінних існує мультиколінеарний зв’язок,

саме це і простежується в нашому випадку.

,

а це означає, що в масиві пояснювальних

змінних існує мультиколінеарний зв’язок,

саме це і простежується в нашому випадку.

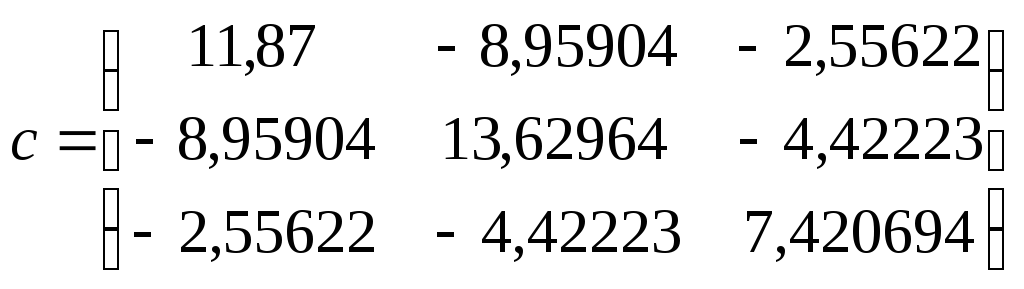

5. Розрахунок матриці, оберненої до матриці rхх:

![]() ;

;

.

.

Матриця с — симетрична, і її діагональні елементи завжди мають бути додатними.

6. Визначення F-критерію:

![]() ;

;

![]() ;

;

![]() ;

;

![]() ;

;![]() ;

;

F1 = 92,43606; F2 = 107,3519; F3 = 54,5759;

Fкрит. = 19,43704.

Коли = 0,05 і ступені свободи m – 1 = 2; n – m = 17, маємо Fкрит = 19,44.

Фактично знайдене значення F-критерію порівнюємо з таб- личним.

У нашому випадку Fфакт > Fкрит, тобто пояснювальні змінні мультиколінеарні з рештою змінних.

7. Обчислення частинних коефіцієнтів кореляції:

![]() ;

;

![]() ;

;

![]() ;

;![]() .

.

r12.3 = 0,704215; r13.2 = 0.272309; r23.1 = 0,439721.

Частинні коефіцієнти кореляції характеризують рівень тісноти зв’язку між двома змінними за умови, що решта змінних на цей зв’язок не впливає. Частинні коефіцієнти кореляції за модулем нижчі, ніж коефіцієнти парної кореляції, бо на їхній рівень не впливає решта змінних, які мають зв’язок із цими двома.

8. Визначення t-критерію:

![]() ;

;

tk1 = 8,430911; tk2 = 2,40553; tk3 = 4,161543;

tкрит = 2,109819.

Обчислені t-критерії порівнюємо з табличним за вибраного рівня значущості = 0,05 і ступенів свободи n – m = 17. Якщо tkj більше за tтабл, як у нашому випадку, то пара цих пояснювальних змінних тісно пов’язана між собою. Оскільки всі розраховані t-критерії більше від критичного, то між всіма пояснювальними змінними існує мультиколінеарність. А це означає, що метод найменших квадратів застосувати в цьому разі не можна.