- •Структура залікового кредиту курсу

- •Змістовий модуль і. Лінійні моделі множинної регресії

- •Тема 1. Основи економетричного моделювання. План (логіка)викладу і засвоєння матеріалу

- •Предмет і метод курсу.

- •Місце курсу серед дисциплін фундаментальної підготовки бакалаврів з економічних спеціальностей.

- •Задачі економетричного дослідження.

- •Особливості економетричних моделей та історія розвитку економетричних досліджень.

- •Тема 2. Загальна лінійна економетрична модель. Методи побудови та дослідження план (логіка)викладу і засвоєння матеріалу

- •2.1. Постановка та основні означення парної лінійної регресії. Метод найменших квадратів. Система оцінки параметрів економетричної моделі з двома змінними.

- •2.2. Дисперсійний та кореляційний аналіз побудованої моделі.

- •2.3. Постановка загальної лінійної моделі.

- •2.4. Передумови застосування методу найменших квадратів (1мнк).

- •Властивості оцінок параметрів.

- •1) Незміщеності; 3) ефективності;

- •2) Обґрунтованості; 4) інваріантності.

- •2.6. Перевірка моделі на якість і точність.Прогноз.

- •Дисперсійний аналіз

- •Тема 3. Поняття та методи дослідження мультіколінеарності. Гетероскедастичність, методи визначення та наслідки. План (логіка)викладу і засвоєння матеріалу

- •3.1. Поняття мультіколінеарності. Методи визначення її.

- •Методи дослідження мультіколінеарності (метод феррара-глобера).

- •Поняття гетероскедастичності. Методи її визначення.

- •Перевірка гетероскедастичності на основі критерію

- •Параметричний тест Гольдфельда—Квандта

- •Тема 4. Нелінійні моделі та часові ряди план (логіка)викладу і засвоєння матеріалу

- •4.1.Методи оцінювання параметрів моделі нелінійного виду.

- •4.2.Виробнича функція : аналіз рішення.

- •4.4. Поняття тренду. Методи дослідження динамічних рядів

- •Похідні від функцій апроксимації

- •Тема 5. Побудова економетричної моделі з автокорельованими залишками. План (логіка)викладу і засвоєння матеріалу

- •5.1.Поняття і причини виникнення автокореляції.

- •5.2.Критерій дарбіна-уотсона.

- •5.3.Критерій неймана. Критерій фон Неймана

- •5.4.Оцінка параметрів моделі з автокорельованими залишками. Метод ейткена

- •Тема 6. Моделі розподіленого лагу. Методи інструментальних змінних план (логіка)викладу і засвоєння матеріалу

- •6.1.Поняття лагу і лагових змінних.

- •Моделі розподіленого лагу (дистрибутивно – лагові моделі);

- •Авторегресійні моделі.

- •6.2.Лаги незалежних змінних лаги залежної змінної.

- •6.3.Методи оцінювання.

- •6.4.Метод ейткена. Ітеративний метод.

- •Метод Ейткена

- •6.5.Метод інструментальних змінних.

- •6.7.Оператор оцінювання вальда.

- •Тема 7. Непрямий метод найменших квадратів. Проблеми ідентифікації план (логіка)викладу і засвоєння матеріалу

- •Система одночасних структурних рівнянь. Проблеми ідентифікації

- •7.2. Рекурсивні системи

- •7.3. Непрямий метод найменших квадратів (нмнк)

- •7.4. Двокроковий метод найменших квадратів (2мнк)

- •7.5. Трикроковий метод найменших квадратів (змнк)

6.4.Метод ейткена. Ітеративний метод.

Три авторегресійних моделі - Койка, адаптивних сподівань і часткового коригування - можна подати в загальній формі:

![]() (6.21)

(6.21)

Наявність лагових залежних змінних у динамічних моделях створює певні проблеми при оцінюванні параметрів: серед пояснюючих змінних є стохастичні (залежні лагові змінні), а також існує проблема серійної кореляції залишків моделі та лагових змінних. Залежно від гіпотез щодо залишків таких моделей використовують відповідні методи оцінювання.

Гіпотеза 1. Залишки є нормально розподіленими випадковими величинами з нульовим математичним сподіванням та сталою дисперсією.

Гіпотеза 2. Залишки описуються авторегресійною схемою першого порядку:

![]() (6.22)

(6.22)

Гіпотеза 3. Залишки автокорельовані та описуються авторегресійною схемою першого порядку:

![]() (6.23)

(6.23)

Першу гіпотезу виконують лише для моделі часткового коригування; саме для неї можливе застосування звичайного МНК. Однак залежність залишків від лагової змінної yt 1 у цій моделі призводить до зміщення оцінок параметрів. Та хоча оцінки параметрів будуть завищеними, вони матимуть найменшу середньоквадратичну похибку. І після визначення величини зміщення МНК-оцінки будуть найприйнятнішими.

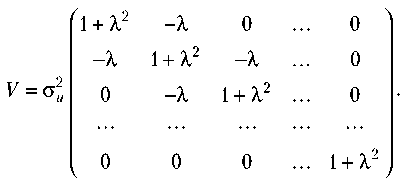

Якщо залишки моделі визначають через автокорельовані випадкові величини, то МНК-оцінки параметрів моделі також матимуть зміщення, до того ж зміщення матиме також критерій Дарбіна - Уотсона. Тому для перевірки автокореляції залишків застосовують узагальнений критерій Дарбіна - Уотсона. Оцінювання параметрів таких моделей виконують узагальненим методом найменших квадратів (методом Ейткена), в операторі оцінювання якого

![]()

коригуюча матриця має вигляд

Якщо лагову модель можна подати у вигляді

![]() (6.24)

(6.24)

то до перетворених у такий спосіб даних залежної змінної застосовують звичайний МНК. Причому, параметр X вибирають з інтервалу 0 < X < 1 так, щоб мінімізувати суму квадратів залишків.

Якщо відносно залишків моделі приймається третя гіпотеза, то параметри оцінюють за допомогою таких методів:

1) класичного МНК після попереднього перетворення вхідних даних;

2) методу Ейткена (узагальненого МНК);

3) ітераційного методу;

4) методу інструментальних змінних;

5) алгоритму Уолліса.

Метод Ейткена

Якщо відоме, то можна сформувати матрицю

і оцінити параметри моделі за методом Ейткена:

![]() ,

,

де

Така процедура наближено еквівалентна застосуванню 1МНК до моделі

![]()

відносно перетворених даних. У результаті дістаємо обгрунтовані і асимптотично ефективні оцінки параметрів, але через присутність лагового значення залежної змінної в правій частині, вони будуть зміщеними для закінчених вибірок.

Якщо значення параметра невідоме, то можна скористатись процедурою пошуку, запропонованою для гіпотези 2.

Ітеративний метод

Як альтернативу можна запропонувати ітеративний метод. Розглянемо його.

Перепишемо останнє рівняння у вигляді:

![]() . (6.25)

. (6.25)

Щоб безпосередньо оцінити всі чотири параметри мінімізацією суми квадратів відхилень для (6.25), треба розв’язувати нелінійні рівняння відносно параметрів. Якщо розбити параметри на дві множини, внісши до однієї a0, a1, a2, а до іншої — , то можна знайти умовний мінімум суми квадратів залишків для рівняння (6.25) почергово відносно кожної множини параметрів. У такому разі оцінюватимуться лінійні рівняння.

Алгоритм.

Крок 1. Вибирається деяке початкове значення = , воно підставляється в рівняння (6.25), яке відповідно спрощується.

Крок

2.

Мінімізується

сума квадратів залишків рівняння (6.25)

при фіксованому

,

в результаті одержуються оцінки

![]() ,

,

,

,

![]() .

.

Крок

3.

Підставимо значення параметрів

![]() =

,

=

,

=

,

=

,

![]() =

в модель (6.25) і визначимо параметр

=

в модель (6.25) і визначимо параметр

![]() ,

тобто застосовується 1МНК до рівняння

,

тобто застосовується 1МНК до рівняння

![]() ,

що і дозволяє знайти

.

,

що і дозволяє знайти

.

Крок

4. Задавши

![]() в моделі (6.25), знайдемо на основі 1МНК

оцінку параметрів

=

в моделі (6.25), знайдемо на основі 1МНК

оцінку параметрів

= ![]() ,

,

![]() =

= ![]() ,

=

,

= ![]() .

.

Процес продовжується доти, поки не буде досягнуто збіжності оцінок параметрів моделі на двох останніх кроках з вибраною точністю.

Двокрокова процедура

Іноді застосовується альтернативна двокрокова процедура. Розглянемо її алгоритм.

Крок

1. Параметри

моделі (6.25) оцінюються 1МНК, оскільки

залишки

![]() в ній — гомоскедастичні. При цьому

ігноруються нелінійні обмеження, які

необхідно б було враховувати при

оцінюванні. Як оцінка параметра

використовується

в ній — гомоскедастичні. При цьому

ігноруються нелінійні обмеження, які

необхідно б було враховувати при

оцінюванні. Як оцінка параметра

використовується

![]() ,

,

тобто

береться відношення коефіцієнта при

змінній

![]() до коефіцієнта при змінній

.

до коефіцієнта при змінній

.

Крок

2.

На основі

![]() перетворюється вихідна інформація

перетворюється вихідна інформація

![]() і

і

![]() ,

для якої будується модель (6.25) методом

1МНК.

,

для якої будується модель (6.25) методом

1МНК.