- •1. Информатика как наука, ее структура и мето в системе других наук.

- •2. Кодирование информации.Постановка задачи.

- •3. Формальные языки и граматики. Их классификация.

- •5.Компьютерное моделирование.

- •6Моделирование в биологии. Модели популяции, клеточные автоматы.

- •8,Задача линейного програмит-я. Методы её решения.

- •10. Динамические структуры. Линейная структура - стек. Предст в памяти пк.

- •11, Компьютерная сеть. Способы организ-ии вычисл. Основные функ-ые Эл-ты кс. Одноранговые сети на основе сервера.

- •4. Одноранговые сети и на основе сервера.

- •12. Носители для передачи инф-ии в ком. Сети.

- •13. Правила сетевого взаимодействия. Протоколы. Модель osi

- •Физический уровень

- •14.Определение искусственного интеллекта

- •15. Пролог - programming in logic

- •17. Нейронные сети.

- •18 Генетические алгоритмы. Определение. Схема классического генетического алгоритма. Области применения классических генетических алгоритмов.

- •19, Информационные системы.

- •20. Базы данных. Модели данных. Реляционная модель данных.

- •22. Целостность реляционных данных. Потенциальные, первичные и альтернативные ключи. Правило целостности объектов. Внешние ключи. Правило ссылочной целостности. Правила внешних ключей.

- •23, Реляционная алгебра. Основные операции реляционной алгебры. Язык sql.

- •24. Предмет изуч-я теор алг-мов. Алг-тм, его св-ва, необходим уточ-я пон-я алг-ма. Универсаль-е алг-ие модели.

- •25,Характеристики сложности вычисления. Временная и емкостная сложность алгоритма. Верхние и нижние оценки, асимптотические обозначения. Порядок роста.

- •26 История развития ком тех эвм, поколение эвм и классиф. Современные тенденции разв архит эвм.

- •4Е поколение: 1972-1984

- •5Е поколение: втор полов 80-х

- •6Е и последующие поколения эвм

- •27. Микропроцессор и память компа. Основной алг. Работы проца. Система прерываний.

- •29. Решение системы n линейных уравнений с n неизвестными методом Гаусса. Алгоритм решения системы для реализации на эвм.

- •30, Интерполирование: постановка задачи, геометрическая интерпретация. Интерполяционный член Ньютона Алгоритм для реализации на эвм выбранного многочлена.

- •31. Вычисл-е определ-го интеграла по одной из фор-л. Алг-м реализ-ии на эвм выбранной формулы.

17. Нейронные сети.

Нейронная сеть – раздел иск-го интеллекта, в к-м для обработки сигналов исп-ся явления, аналогичные происходящим в нейронах живых существ. История: 1943-Уильям Маккалок, У.Питтс предлож модель нейрона (нерв клеек мозга, 1949- Хебб. способы обуч нейр сети, 1969-М.Минский, С.Пейперт напис книгу «Персептроны», вней они похорон все перспект НС, нач 80х – новый рассвет НС.(нов мод нейтронов, нов структ НС, нов спос обуч).

Биол основ. (рис нейрона:тело, аксон-выход, дендриты-входы, синапс.Из тела выходят 2 вида отростков:тонкие-дендриты,долее толстые аксон,входные сигнала поступают ч/з синапсы,наход-ся на дендритах или теле.Выходной сигнал передается аксону ч/з колатералы). Принцип действ: электрохим сигн попад в тело клетки ч/з синапсы на дендритах, измен велич его энегет потенц. Один и тот-же сигн прох ч/з разн синапсы м оказ разн дейсв-е на клетку (увел или уменьш потенциал) возбужд или тормозящ дейс-е. если накопл потенц клетки превыш некотор порогов зн-е, на вых (аксоне) появл сигн, перед другим клеткам. (tсраб=1-2 мс: Е=-70 мв...+3мв). Мн-во клеток работают параллельно - быстродействие. В мозге чела – 1011 нейронов, каждый связан еще с 1000-10000 других. Поэтому несмотря на на малое быстродействие нейронов, паралелльная обработка инф-ии множеством элементовведет к горомной скорости решения задач.Большое число нейронов и свзей м/у ними увелич. надежность нейронной сети.

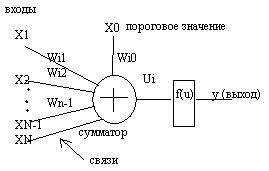

Обобщенная

модель:

W – вес нейтрона, f – фу-я активац, х0- сигн поляриз, определ-й порог срабат.

Входные сигналы хi суммир-ся в нейроне с учетом весовых коэф-тов Wij Сумма поступает на вход функционального блока f (U), вход к-го явл-ся выходным сигналом нейрона. Работа нейрона м.б. описана ф-лой:

![]() .

В зав-ти от вида ф-и активации f,

различают неск моделей нейронов.

.

В зав-ти от вида ф-и активации f,

различают неск моделей нейронов.

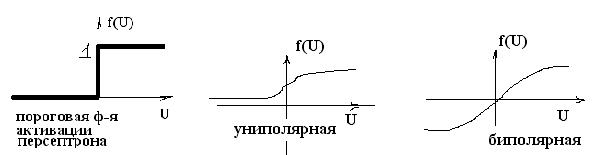

Модели:

1) персептрон f(u)={0,u<0;

1,u>=0.

(пороговая ф-я активации). 2) сигмоидальный

(ф-я актив-и непрерывная). М.б.униполярной

f(u)=1/(1+e-u)

и биполярной f(u)=tanh

(u).

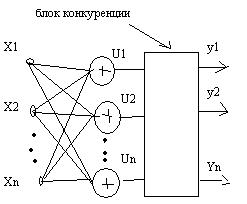

Преимущества – дифференцируемость, к-я исп-ся при обуч-и. 3) WTA-нейрон. Здесь реализ-ся простое суммирование с учетом весовых коэф-тов. На выходе группа конкурир-х нейронов имеет блок сравнения. У кого сумма больше, тот получает1, остальн – 0.

Отдельные нейроны объед-т в сети. Слой – это несколько несвяз м/у собой, нейронов, располож в одной плоск.

Однослойные сети Двуслойная сеть

![]()

![]()

может реал ф-ю XOR. Сети с 3 и более слоев могут реализов люб ф-ю.

Способы обучения-это такое измен-ие весовых коэф-ов при к-ом реал-ые сигналы на выходах сети отлич-ся от треб-х.

Виды обучения: с учителем – производится путем предъявления сети нескольких наборов сигналов, для к-х известны требуемые выходы (веса уточняются после каждого набора). 1) при нальном случ выбранном зн-ии весов Wij на вход нейрона подается обуч вектор х и расчитыв зн-е вых сигн. Уi. 2) если зн-е уi совпало с ожид-м знач di , то весов коэф Wij не изменяются. 3) если Уi не совпало, то значен весов уточняются по формуле. Wij(k+1)= Wij(k)+xj*(di-yi), k – номер цикла обучения. 4) переход к пункту 1.. Без учителя - нужный выходной сигнал неизвестен, сети пред-ся т-ко входы, веса опред-ся сетью самотоят.

Проблемы: 1) переобучения – сложно обобщить результат на новые наблюдения. 2) сеть учится тому, чему проще обучиться. Пример: система машинного зрения – автомат распозн-е танков. Сеть обучалась на картинках с танками (фото в пасмурный день) и без (солнечный день). Пока перечень картинок не менялся- -100% результат. Дали новые картинки – провал. Вместо танков сеть научилась опред-ть освещенность. Поэт при обучении след-т учитывать все особенности.

Области применения: 1) апроксимация и интерполяция (идентиф-я и распознавание) 2) Классификация и распознавание образов 3) прогнозирование (по предыдущему сост-ю предск-ся будущее) 4) системы упр-я динамическими объектами. 5) экспертные системы.