- •Полные статистики.

- •Свойства условных математических ожиданий.

- •Теорема о построении эффективных оценок

- •Алгоритм нахождения эффективных оценок

- •Неравенство Рао-Крамера. Теорема Рао-Крамера

- •Пример 1.

- •Пример 2.

- •Пример 3.

- •Лемма Неймана-Пирсона ( нерэндомизированный вариант).

- •Лемма Неймана-Пирсона ( рэндомизированный вариант).

- •Статистика

- •Критерий

- •Критерий согласия Пирсона

- •Статистика критерия

- •Правило критерия

- •28) Критерий согласия Пирсона (Хи-квадрат)

- •Поведение, когда гипотезаверна.

- •Поведение, когда гипотезаневерна.

- •Критерий проверки.

- •Границы применимости критерия на практике.

- •Доверительный интервал и примеры. Доверительный интервал.

- •Примеры

- •Общая задача дисперсионного анализа.

- •Однофакторный, двуфакторный дисперсионный анализ. Однофакторный дисперсионный анализ

- •Двуфакторный дисперсионный анализ

- •Байесовская классификация.

- •Дискриминантный анализ

Билет №1.

Теоретическая и выборочная функция распределения.

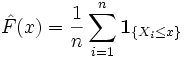

Определение выборочной (эмпирической) функции распределения: Пусть

![]() - выборка из

распределения, задаваемого функцией

распределения F(x). Будем считать, что

- выборка из

распределения, задаваемого функцией

распределения F(x). Будем считать, что

![]() - независимые случайные величины,

определённые на

- независимые случайные величины,

определённые на

некотором

пространстве элементарных исходов Ω.

Пусть

![]() .

Определим случайную величину

.

Определим случайную величину![]() следующим образом:

следующим образом:

,

,

где

![]() - индикатор события A. Таким образом

выборочная функция распределения в

точке x равна относительной частоте

элементов выборки, не превосходящих

значение x. Случайная величина

- индикатор события A. Таким образом

выборочная функция распределения в

точке x равна относительной частоте

элементов выборки, не превосходящих

значение x. Случайная величина![]() называется выборочной функцией

распределения выборки

называется выборочной функцией

распределения выборки![]() .

.

Функцию распределения F(x) наблюдаемой случайной величины ξ в этом случае называют теоретической функцией распределения.

Основные св-ва:

Пусть

зафиксирован элементарный исход

![]() .

Тогда

.

Тогда![]() является функцией распределения

дискретного распределения, задаваемого

следующей функцией вероятности:

является функцией распределения

дискретного распределения, задаваемого

следующей функцией вероятности:

![]() ,

,

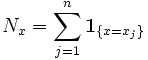

где

xi

= Xi(ω),

а

- количество элементов выборки, равных

x. В частности, если все элементы выборки

различны, то

- количество элементов выборки, равных

x. В частности, если все элементы выборки

различны, то![]() .

.

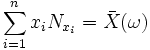

Математическое ожидание этого распределения имеет вид:

.

.

Таким образом выборочное среднее - это теоретическое среднее выборочного распределения.

Аналогично, выборочная дисперсия - это теоретическая дисперсия выборочного распределения.

Случайная

величина

![]() имеет биномиальное распределение:

имеет биномиальное распределение:

![]() .

.

Выборочная

функция распределения

![]() является несмещённой оценкой функции

распределения F(x):

является несмещённой оценкой функции

распределения F(x):

![]() .

.

Дисперсия выборочной функции распределения имеет вид:

![]() .

.

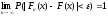

Согласно усиленному закону больших чисел, выборочная функция распределения сходится почти наверное к теоретической функции распределения:

![]() почти наверное

при

почти наверное

при

![]() .

.

Выборочная

функция распределения является

асимптотически нормальной оценкой

теоретической функции распределения.

Если

![]() ,

то

,

то

![]() по распределению

при

по распределению

при

![]() .

.

Билет №2.

Теоремы Гливенко и Калмогорова о сходимости выборочной функции.

Теорема(1.):ПустьFn(x)

– эмпирическая функция распределения

, построенная по выборкеХ=(Х1,Х2…..Хn)

из распределенияZ(ξ) –

соответствующая теоретическая функция

распределения. Тогда для любого х

(- <x<+

<x<+ )

и любого

)

и любого

.

.

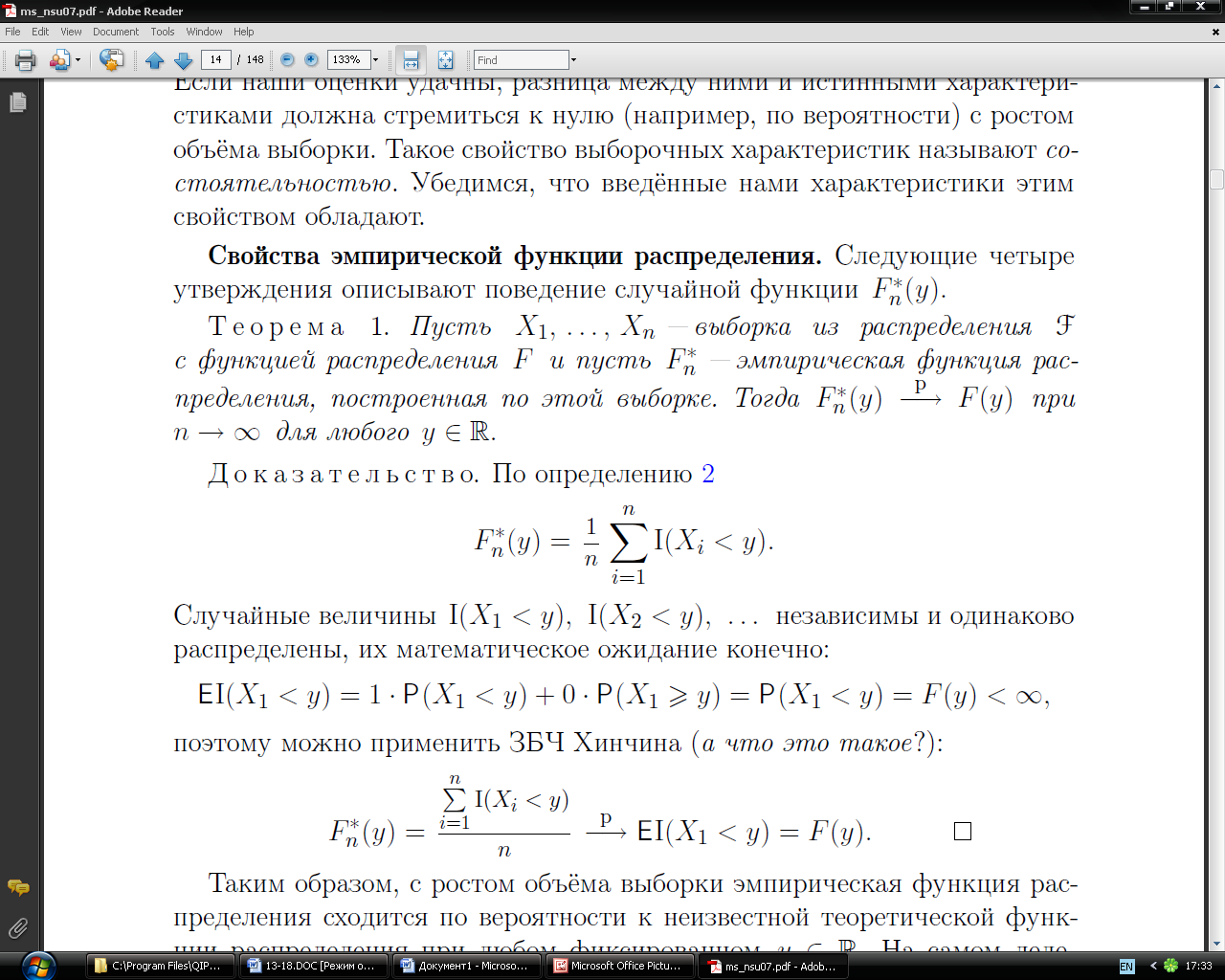

Теорема Гливенко: В условиях теоремы(1.)

Другими словами, это соотношение означает, что отклонение

эмпирической функции распределения от теоретической на всей оси с вероятностью 1 будет сколь угодно мало при достаточно большом объёме выборки.

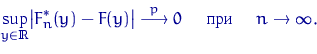

Теорема Колмогорова:Если функцияF(x) непрерывна, то при любом фиксированномt> 0

При этом предельную функцию распределения K(t) можно с хорошим приближением использовать для практических расчетов уже приn≥20.

__________________________________________________________________________

Билет №3.

Сходимость выборочных характеристик к теоретическим. Примеры

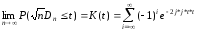

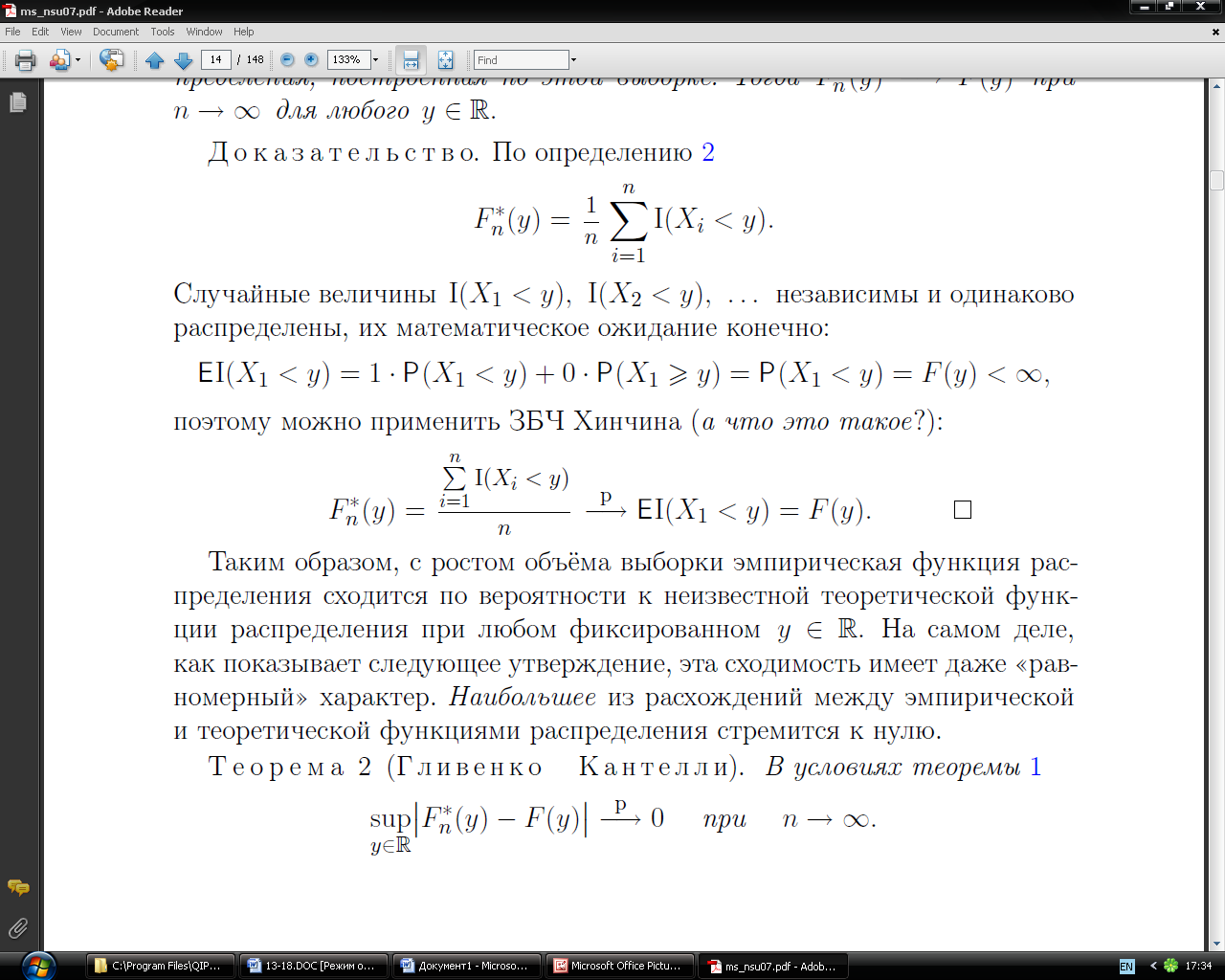

Теорема1:Пусть![]() — выборка объема

— выборка объема![]() из неизвестного распределения

из неизвестного распределения![]() с функцией распределения

с функцией распределения![]() .

Пусть

.

Пусть![]() — эмпирическая функция распределения,

построенная по этой выборке. Тогда для

любого

— эмпирическая функция распределения,

построенная по этой выборке. Тогда для

любого![]()

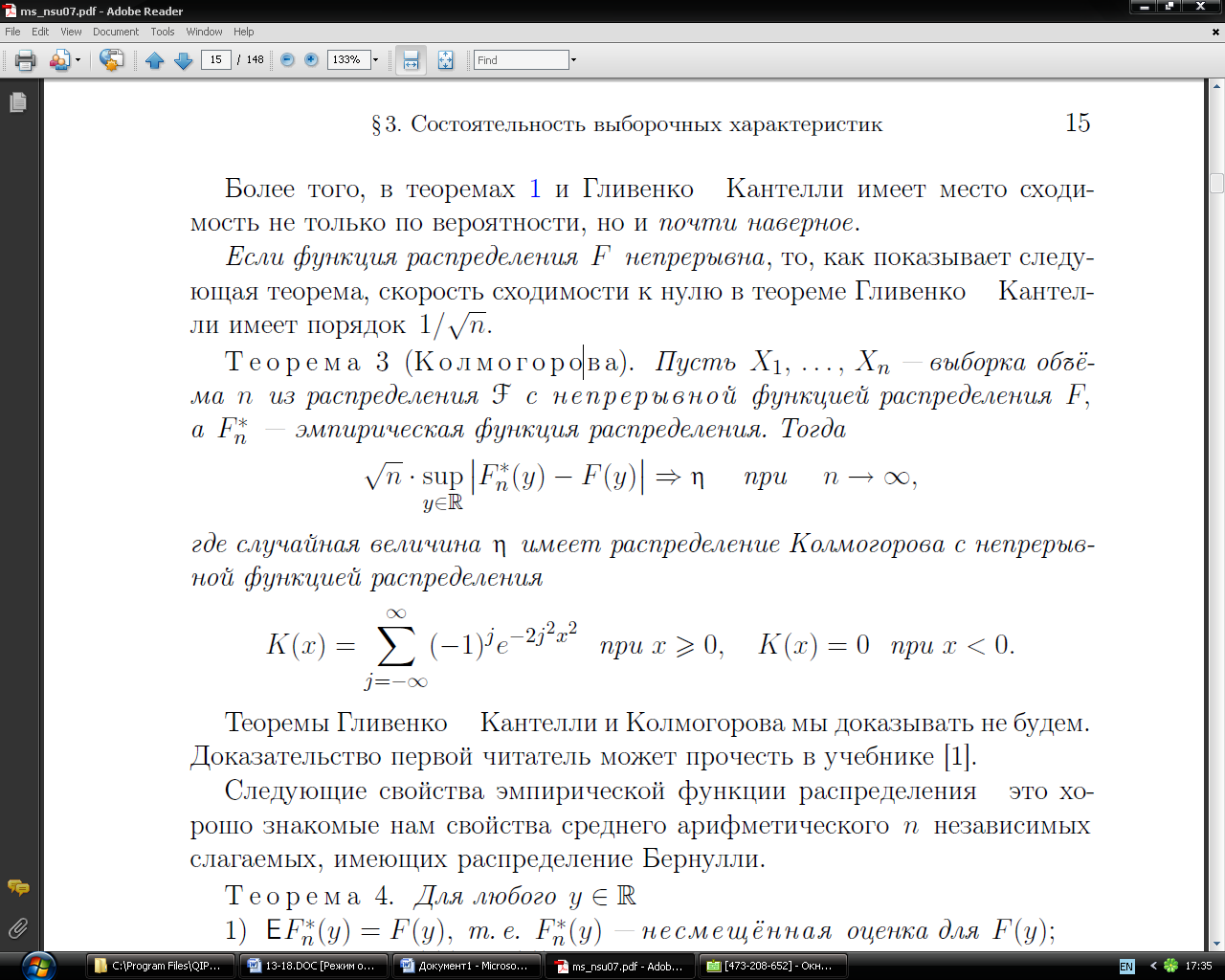

![]()

Теорема

Гливенко — Кантелли.Пусть![]() — выборка объема

— выборка объема![]() из неизвестного распределения

из неизвестного распределения![]() с функцией распределения

с функцией распределения![]() .

Пусть

.

Пусть![]() — эмпирическая функция распределения,

построенная по этой выборке. Тогда

— эмпирическая функция распределения,

построенная по этой выборке. Тогда

Более того, в условиях теорем 1 и Гливенко — Кантелли имеет место сходимость не только по вероятности, но и почти наверное.

Билет №4.

Гистограмма как выборочный аналог теоретической плотности.

Гистограммой

частот называют ступенчатую фигуру,

состоящую из прямоугольников, основаниями

которых служат частичные интервалы

длиною h, а высоты равны

отношению (плотность частоты).

(плотность частоты).

Площадь

i-го частичного прямоугольника

равна -

сумме частот вариантi-го

интервала; следовательно, площадь

гистограммы частот равна сумме всех

частот, т.е. объему выборки.

-

сумме частот вариантi-го

интервала; следовательно, площадь

гистограммы частот равна сумме всех

частот, т.е. объему выборки.

Гистограммой

относительных частот называют ступенчатую

фигуру, состоящую из прямоугольников,

основаниями которых служат частичные

интервалы длиною h, а

высоты равны отношению (плотность

относительных частот)

(плотность

относительных частот)

Билет №5.

Состоятельность, асимптотическая нормальность, асимптотическая несмещенность, асимптотическая несмещенность оценок.

Оценки

смещение которых убывает при увеличении

объема выборки и в пределе, при становятся

несмещенными.

становятся

несмещенными.

Пусть X выборка

из распределения

выборка

из распределения ,

где параметрическое множество

,

где параметрическое множество в

общем случае некоторый невырожденный

открытый интервалr-мерного

евклидова пространства

в

общем случае некоторый невырожденный

открытый интервалr-мерного

евклидова пространства .

По определению, оценка

.

По определению, оценка для

заданной параметрической функции

для

заданной параметрической функции называется

состоятельной, если при

называется

состоятельной, если при

,

т.е., каково бы ни было истинное значение

параметра

,

т.е., каково бы ни было истинное значение

параметра ,

оценка

,

оценка сходится по вероятности к истинному

значению оцениваемой функции.

сходится по вероятности к истинному

значению оцениваемой функции.

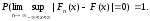

![]()

Билет №6.

Примеры несмещённых и смещённых оценок.

Определение:

Пусть

![]() — выборка из распределения, зависящего

от параметра

— выборка из распределения, зависящего

от параметра![]() .

Тогда оценка

.

Тогда оценка![]() называется несмещённой, если

называется несмещённой, если

![]() .

.

В противном

случае оценка называется смещённой, и

случайная величина

![]() называется её смещением.

называется её смещением.

Примеры:

Выборочное

среднее

![]() является несмещённой оценкой

математического ожидания Xi, так

как если

является несмещённой оценкой

математического ожидания Xi, так

как если![]() ,

то

,

то![]() .

.

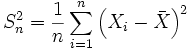

Пусть случайные величины Xiимеют конечную дисперсию DXi= σ2. Построим оценки

— выборочная дисперсия,

— выборочная дисперсия,

и

— исправленная выборочная дисперсия.

— исправленная выборочная дисперсия.

Тогда

![]() является смещённой, а S2несмещённой

оценками параметра σ2.

является смещённой, а S2несмещённой

оценками параметра σ2.

Билет №7.

асимптотическая нормальность выборочной медианы, сравнение асимптотической эффективности среднего и выборочной медианы.

Теорема

- если в некоторой окрестности

точки плотностьf(x) непрерывна

вместе с производной и

плотностьf(x) непрерывна

вместе с производной и ,

то при

,

то при :

: Эта

теорема описывает асимптотическое

поведение для больших выборок, как

говорят, средних членов вариационного

ряда, т.е. порядковых статистик

Эта

теорема описывает асимптотическое

поведение для больших выборок, как

говорят, средних членов вариационного

ряда, т.е. порядковых статистик ,

номера которых удовлетворяют условию

,

номера которых удовлетворяют условию

при

при ,

где 0<p<1. Таким образом

для больших выборок из достаточно

гладких распределений средние члены

вариационного ряда асимптотически

нормальны.

,

где 0<p<1. Таким образом

для больших выборок из достаточно

гладких распределений средние члены

вариационного ряда асимптотически

нормальны.

Для любой

оценки

,

удовлетворяющей условию:

,

удовлетворяющей условию: ,

ее асимптотическая эффективностьeff(

,

ее асимптотическая эффективностьeff( определяется как отношение нижней

границы Рао – Крамера к асимптотической

дисперсии оценки

определяется как отношение нижней

границы Рао – Крамера к асимптотической

дисперсии оценки :eff

:eff

Билет №8

Метод максимального правдоподобия: описание и примеры оценок.

Определение:

Пусть есть выборка

![]() из распределения

из распределения![]() ,

где

,

где![]() - неизвестный параметр. Пусть

- неизвестный параметр. Пусть![]() - функция правдоподобия, где

- функция правдоподобия, где![]() .

Точечная оценка

.

Точечная оценка

![]()

называется оценкой максимального правдоподобия параметра θ. Таким образом оценка максимального правдоподобия - это такая оценка, которая максимизирует функцию правдоподобия при фиксированной реализации выборки.

Примеры: Пусть

![]() - независимая выборка из непрерывного

равномерного распределения на отрезке

[0,θ], где θ > 0 - неизвестный параметр.

Тогда функция правдоподобия имеет вид

- независимая выборка из непрерывного

равномерного распределения на отрезке

[0,θ], где θ > 0 - неизвестный параметр.

Тогда функция правдоподобия имеет вид

Последнее равенство может быть переписано в виде:

где

![]() ,

откуда видно, что своего максимума

функция правдоподобия достигает в точке

,

откуда видно, что своего максимума

функция правдоподобия достигает в точке![]() .

Таким образом

.

Таким образом

![]() .

.

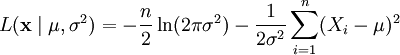

Пусть

![]() - независимая выборка из нормального

распределения с неизвестными средним

и дисперсией. Построим оценку максимального

правдоподобия

- независимая выборка из нормального

распределения с неизвестными средним

и дисперсией. Построим оценку максимального

правдоподобия![]() для неизвестного вектора параметров

для неизвестного вектора параметров![]() .

Логарифмическая функция правдоподобия

принимает вид

.

Логарифмическая функция правдоподобия

принимает вид

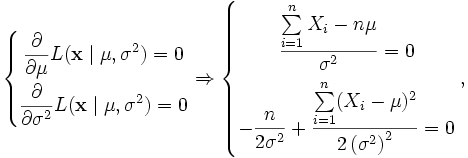

Чтобы найти её максимум, приравняем к нулю частные производные:

откуда

![]() - выборочное среднее, а

- выборочное среднее, а

![]() - выборочная дисперсия.

- выборочная дисперсия.

*26-30

Билет №11.

Достаточные статистики, критерий факторизации.

Статистика

T=T(X)(вообще

говоря, векторная) называется достаточной

для моделиF={F(x, ),

), }

(или достаточной для параметра

}

(или достаточной для параметра когда ясно, о какой модели идёт речь),

если условная плотность (или вероятность

в дискретном случае)

когда ясно, о какой модели идёт речь),

если условная плотность (или вероятность

в дискретном случае) случайного вектораX=(X1,……,Xn)

при условииT(X)=tне зависти от параметра

случайного вектораX=(X1,……,Xn)

при условииT(X)=tне зависти от параметра .

.

Это свойство

статистики Tозначает,

что она содержит всю информацию о

параметре ,

имеющуюся в выборке, и поэтому все

заключения об этом параметре, которые

можно сделать при наблюденииx,

зависят только отt=T(x).

,

имеющуюся в выборке, и поэтому все

заключения об этом параметре, которые

можно сделать при наблюденииx,

зависят только отt=T(x).

Критерий

факторизации: Для того чтобы статистикаT(X) была

достаточной для ,

необходимо и достаточно, чтобы функция

правдоподобияL(x;

,

необходимо и достаточно, чтобы функция

правдоподобияL(x; )

имела вид:

)

имела вид:

,

где множительgможет

зависеть от

,

где множительgможет

зависеть от ,

а отxзависит лишь черезT(x), множительhже от параметра

,

а отxзависит лишь черезT(x), множительhже от параметра не зависит.

не зависит.

Билет №13,14.

Полные статистики.

X,p(x,) – плотность, T – статистика

если из Ef(T(x))=0=>f(x)=0

Будем рассматривать полные достаточные статистики (ПДС), получим ограничение сверху и снизу.

Пример построения полной статистики

Если существует экспоненциальное распределение, то при определенных условиях T=(T1,…,Tn) является полной статистикой.

Надо, чтобы в Tii(),iбылоk-мерным, (1()),…,k()) отображалось вRk.

1) Схема Бернулли

Предположим, что m– число успехов, является достаточной статистикой.

возьмем m=0nf(m)Cnmpmqn-m=0q(0,1), нужно доказать, чтоf(m)=0

m=0nf(m)CnmZm=0,Z=p/q,Z(0,)

получается полином с коэффициентами = 0, т.к. Cnm0, тоf(m)=0

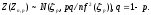

2) Распределение Пуассона

Существует объем выборки n=1, тогда

=0уберемeполучим

=0уберемeполучим =0,

для>01/k!0

=>f(k)=0

=0,

для>01/k!0

=>f(k)=0

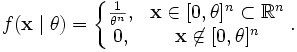

3) Равномерное распределение R(0,)

объем выборки n=1

получается

получается =>f(x)=0 с

вероятностью 1

=>f(x)=0 с

вероятностью 1

Билет №15.

Свойства условных математических ожиданий.

1. Пусть X,Y– случайные величины.

p(x,y) – плотность распределения.

Определение: условная плотность распределения, при условии, что yфиксированое

p(x/y)=p(x,y)/p(y)

p(y+y<X<x+x/y<Y<y+y)=P(x<X<x+x,y<Y<y+y)/P(y<Y<y+y)=

= =

= это можно брать в качестве условной

плотности распределения

это можно брать в качестве условной

плотности распределения

тогда мат.ожидание(условное) y-фиксированое

E(x/y)=

Рассмотрим мат.ожидание при условии, что какое-то событие A– фиксированое

E(x/A)= =

=

E(x/y) пустьA– не событие, а дискретно распределенная случайная величина, тогда

E(x/y)=E(x/A), где Y()=Y, А

Определение: Разбиением А множества называется набор подмножеств А из.

AiАj=, ij

E(x/A)=E(x/Ai), если Аi

E(x/A)=E(x/A) ||Ai() - формальное определениеEпри условии разбиения

Условное мат.ожидание обладает всеми свойствами мат.ожидания + другие свойства.

Пусть существуют 2 разбиения А и В. Пусть А>B

Мы говорим, что А является более мелким разбиением, чем Bесли любой элемент разбиенияBявляется объединением элементовA.

Пусть Bi=jAij

E(E(x/A)/B)=E(x/B)

E(E(x/B)/A)=E(x/B)

Т.е. всегда получается распределение вокруг более грубого распределения.

Доказательство:

2) Если Bi, тоE– одно и тожеyлюбогоAij, т.е.EBiне зависит от выбораAij. Получается мат.ожидание постоянной и оно равно самой постоянной.

1) E(x/Ai)=

E(x/A)=

Предположим, что Bi=jAij, построим внешнее

=

= =

= =

= =

= =E(x/B)

=E(x/B)

E(E(x/A))=Ex

Y- измеримо относительно разбиения {Y=y}А

E(XY/A)=YE(X/A)

Если E(X/A)=0, то E(X/Y)=0

Пусть существует конечное разбиение А, рассмотрим алгебру А (или -алгебру)

E(x/A)=E(x/F) мы можем по разбиению определить-алгебру и наоборот.

Можно определить мат.ожидание при условии алгебры, чтобы сохранились все свойства

Теорема: E(x/F) называется случайной величиной со следующими свойствами

АЕ(x/F)dp=Аxdpдля всехAF

E(x/F) – измеримо относительно А

Тогда определение мат.ожидания однозначно

Если взять x, то (2) свойство никогда не выполнится, х неизмеримо относительноF, т.к. измеримость однозначна.

E(x/F)<a)F

Билет №16.

Теорема о построении эффективных оценок

X, p(x,), S=S(x) – несмещенная для g(), T – ПДС, тогда S*=E(S/T) – эффективная, несмещенная, c минимальной дисперсией, оценка.

Алгоритм нахождения эффективных оценок

Ищем T – ПДС

Ищем несмещенную оценку, являющуюся функцией от Т. Она и будет несмещенной оценкой.

Доказательство: Пусть существует несмещенная оценка SпостроимS*=E(S/T), тогдаS*- оценка, т.к.T– достаточная, она несмещенная, т.к.ES*=ES(по свойствам условного мат.ожидания)

минимальная дисперсия

Пусть существует еще одна несмещенная оценка S1, построимS*=E(S1/T), но тогда по по теореме

Рао-Блекуэлла DS1>DS1*=DS*=> дисперсия любой другой оценки будет большеDS*

Осталось доказать DS1*=DS*

т.к. S*иS1*совпадают с вероятностью 1, в силу полноты.

(S*-S1*) они измеримы относительноT(т.к. мат.ожидание), т.е. являются функциями от Т. Они обе не смещены, поэтомуE(S*-S1*)=0, значит в силу полнотыS*-S1*=0 с вероятностью 1

Пример:

Экспоненциальное семейство:

(x, S2) – ПДС

=(m,2) – если хотим оценить

f(m,2) – достаточно построить несмещенную оценкуT.

Пусть x– выборка из распределения Бернулли.

xi={1,p; 0,q}i<n,=p

m– число успехов – ПДС

оценка для p– несмещенная

x=m/n– частота – функция отmиp. =>x– это эффективная оценка.

Возьмем в качестве параметра функции g(p)=p2

S2= - несмещенная оценка2

- несмещенная оценка2

но в схеме Бернулли =pq=p(1-p)=p-p2, т.е., чтобы оценитьs2надо иметь несмещенную оценкуp2,p2=m/n.

E(S2)=pp2

p-E(S2)=p2если взятьT=m/n-S2, тоET=p-p+p2=p2, т.е. это не смещенная оценка.

S2= =

= =

= =

=

T=m/n- =

= =

= =

=

получается несмещенная оценка, для p2

можно было не пользоваться S2, а взятьx2, т.к. (p=x) оценивают, тогдаp2=x2

Если мы

оцениваем pk,

то несмещенной оценкой будет

Билет №17.