- •1. Предмет теории вероятностей. Исходные понятия теории вероятностей (вероятность, испытание, событие, совместные и несовместные события).

- •2. Классификация событий (достоверные, невозможные и случайные события).

- •3. Классическое, статистическое и геометрические определения вероятности.

- •4. Элементы комбинаторики (размещения, перестановки, сочетания).

- •5. Теорема сложения вероятностей несовместных и совместных событий.

- •6. Элементарные события, полная группа событий. Противоположные события, вероятность противоположных событий.

- •7. Независимые события, умножение вероятностей независимых событий. Вероятность появления хотя бы одного события

- •8. Зависимые события, условная вероятность, умножение вероятностей зависимых событий.

- •9. Формула полной вероятности, формулы Байеса.

- •Формула Бейеса (Байеса)

- •10. Повторные испытания. Схема Бернулли.

- •11. Формула Пуассона для повторных испытаний.

- •12. Понятие случайной величины, дискретная и непрерывная случайные величины. Закон распределения вероятностей дискретной случайной величины, способы его задания.

- •13. Законы распределения дискретной случайной величины: биномиальный и Пуассона.

- •14. Статистические характеристики дискретной случайной величины.

- •15. Свойства математического ожидания дискретной случайной величины.

- •16. Свойства дисперсии дискретной случайной величины, основные формулы.

- •Свойства функции распределения вероятностей случайной величины

- •18. Функция распределения плотности вероятностей непрерывной случайной величины, ее числовые характеристики мат. Ожидание, дисперсия, среднее квадратичное отклонение.

- •19. Вероятность попадания значения непрерывной случайной в заданный интервал.

- •20. Равномерное распределение плотности вероятности непрерывной случайной величины.

- •22. Вероятность попадания значений непрерывной случайной величины в заданный интервал для нормального распределения плотности вероятностей.

- •23. Расчет вероятности заданного отклонения нормальной случайной величины. Правило трех сигм.

- •Правило трех сигм

- •26. Понятия генеральной совокупности, выборки и степени ее свободы, связных и несвязных выборок, нулевой и альтернативной гипотез.

- •Зависимые(связанные) и независимые (несвязанные) выборки

- •28. Непараметрические критерии, критерии знаков и Вилкоксона, их сходство и различия.

- •Алгоритм подсчета g – критерия знаков.

- •29. Параметрические критерии Стьюдента и Фишера, их сходство и различия.

- •30. Критерий согласия χ 2- Пирсона, его особенности и процедура принятия статист. Вывода.

8. Зависимые события, условная вероятность, умножение вероятностей зависимых событий.

Если

наступление одного события влияет

на вероятность наступления

второго события, то события называют

взаимно зависимыми. Если события А и В взаимно

зависимы, то условной вероятностью ![]() называют

вероятность события В,

принимая, что событие А уже

наступило. Условную

вероятность события P(B/A) можно

трактовать как вероятность события B,

вычисленная при

условии, что событие A произошло.

называют

вероятность события В,

принимая, что событие А уже

наступило. Условную

вероятность события P(B/A) можно

трактовать как вероятность события B,

вычисленная при

условии, что событие A произошло.

Теорема

умножения вероятностей зависимых

событий

![]()

![]()

![]()

![]()

![]() где

где ![]()

![]() -

вероятность события B при

условии, что произошло событие A.

-

вероятность события B при

условии, что произошло событие A.

9. Формула полной вероятности, формулы Байеса.

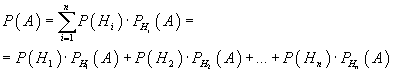

События образуют полную группу, если они в совокупности описывают все возможные несовместные друг с другом исходы некоторого испытания; сумма вероятностей событий полной группы равна 1. Предположим, что событие A может наступить лишь при появлении одного из несовместных событий (гипотез) H1, H2, ..., Hn, образующих полную группу. Тогда вероятность события A определяется как сумма произведений вероятностей каждой из гипотез на соответствующую условную вероятность события A:

Формула Бейеса (Байеса)

Предположим, что событие A может наступить лишь при появлении одного из несовместных событий (гипотез) H1, H2, ..., Hn, образующих полную группу. Событие A уже произошло. Требуется вычислить условные вероятности гипотез (при условии, что событие А произошло).

![]()

10. Повторные испытания. Схема Бернулли.

Пусть проводятся независимые испытания. Далее, вероятность наступления интересующего нас события в каждом испытании постоянна и равна p. Тогда вероятность того, что рассматриваемое событие появится ровно k раз при n испытаниях (безразлично, в каком порядке), равна

![]() В

формуле Бернулли используется число

сочетаний.

Для реализации схемы

Бернулли необходимы два условия:

1)

независимость проводимых испытаний;

2)

p = const (постоянное значение вероятности

появления события)

Наивероятнейшее

число появления события (мода) при n

испытаниях заключено в пределах np-q ≤

Mo ≤ np+p,

В

формуле Бернулли используется число

сочетаний.

Для реализации схемы

Бернулли необходимы два условия:

1)

независимость проводимых испытаний;

2)

p = const (постоянное значение вероятности

появления события)

Наивероятнейшее

число появления события (мода) при n

испытаниях заключено в пределах np-q ≤

Mo ≤ np+p,

11. Формула Пуассона для повторных испытаний.

Если при наличии схемы Бернулли число испытаний n велико, а вероятность наступления события p мала, то вместо формулы Бернулли используют формулу Пуассона:

![]()

Эта

формула дает удовлетворительное

приближение для

![]() и

и

![]() .

При больших

.

При больших

![]() рекомендуется

применять формулы Лапласа

(Муавра-Лапласа).локальная теорема:

Если

вероятность

Р

появления события А в каждом испытании

постоянна и отлична от 0 и 1, то

вероятность Pn(k)

того, что событие A

появится в n

испытаниях ровно к раз приближенно

=

рекомендуется

применять формулы Лапласа

(Муавра-Лапласа).локальная теорема:

Если

вероятность

Р

появления события А в каждом испытании

постоянна и отлична от 0 и 1, то

вероятность Pn(k)

того, что событие A

появится в n

испытаниях ровно к раз приближенно

=![]()

![]()

12. Понятие случайной величины, дискретная и непрерывная случайные величины. Закон распределения вероятностей дискретной случайной величины, способы его задания.

Случайная величина - это величина, которая в результате испытания примет одно и только одно возможное значение, наперед неизвестное и зависящее от случайных причин, которые заранее не могут быть учтены.

Дискретная случайная величина принимает конечное (или счетное) число возможных значений- xi (где i = 1.. n или i = 1 .. ∞) с определенными вероятностями. (игральные кости)

Непрерывная случайная величина может принимать все значения из некоторого конечного или бесконечного промежутка. Число возможных значений непрерывной случайной величины, независимо от величины промежутка, бесконечно. (рост человека). Законом распределения дискретной случайной величины называют соответствие между возможными значениями случайной величины и вероятностями их появления.

Рассмотрим случайную величину X, которая принимает значения x1, x2, x3 ... xn с некоторой вероятностью pi, где i = 1.. n. Сумма вероятностей pi равна 1.

x1 |

x2 |

x3 |

... |

xn |

p1 |

p2 |

p3 |

|

pn |