- •Лекция 1. История развития нейронных сетей. Определение инс, свойства инс, достоинства, недостатки. Типовые постановки задач, решаемых инс, и области их применения. Исторический аспект

- •Определение инс, свойства инс, достоинства, недостатки

- •1. Обучение

- •2.Обобщение

- •3. Абстрагирование

- •4.Применимость

- •Типовые постановки задач

- •1. Распознавание образов

- •2. Кластеризация данных

- •2.Медицина:

- •3.Авионика:

- •4.Связь:

- •5.Интернет:

- •6.Автоматизация производства:

- •7.Политические технологии:

- •8.Безопасность и охранные системы:

- •9.Ввод и обработка информации:

- •10.Геологоразведка:

- •Лекция 2.Биологический прототип. Модель искусственного нейрона. Функции активации. Классификация нейронных сетей. Основные парадигмы нейронных сетей. Биологический прототип

- •Искусственный нейрон

- •Активационные функции

- •Однослойные искусственные нейронные сети

- •Многослойные искусственные нейронные сети

- •Классификация нейронных сетей

- •1. Типы обучения нейросети

- •2. Архитектура связей

- •Нейропарадигмы

- •Лекция 3.Персептрон. Персептронная представляемость. Проблема «Исключающее или». Преодоление ограничения линейной разделимости. Обучение персептрона. Дельта-правило. Персептроны

- •Персептронная представляемость

- •Проблема функции исключающее или

- •Линейная разделимость

- •Преодоление ограничения линейной разделимости

- •Обучение персептрона

- •Трудности с алгоритмом обучения персептрона

- •Лекция 4.Сети с обратным распространением ошибки. Основной элемент сети обратного распространения. Алгоритмы обучения и функционирования.

- •Обучение сети обратного распространения.

- •Проход вперед.

- •Обратный проход.

- •Подстройка весов скрытого слоя.

- •Импульс.

- •Экспоненциальное сглаживание.

- •Трудности обучения сети обратного распространения. Паралич сети

- •Локальные минимумы

- •Размер шага

- •Временная неустойчивость

- •Слой Гроссберга.

- •Режим обучения. Обучение слоя Кохонена.

- •Предварительная обработка входных сигналов.

- •Выбор начальных значений весовых векторов.

- •Обучение слоя Гроссберга.

- •Полная структура сети встречного распространения.

- •Лекция 7. Стохастические методы обучения. Больцмановское обучение.

- •Стохастические методы обучения

- •Больцмановское обучение

- •Лекция 8.Обучение Коши. Метод искусственной теплоемкости. Комбинированный метод обратного распространения и обучения Коши. Обучение Коши

- •Метод искусственной теплоемкости

- •Комбинированный метод обратного распространения и обучения Коши

- •Лекция 9. Ассоциативные сети. Сети Хопфилда. Свойства сети Хопфилда. Статистические сети Хопфилда. Сеть Хопфилда

- •Структура сети

- •Устойчивость сети Хопфилда

- •Непрерывные сети Хопфилда

- •Статистические сети Хопфилда

- •Алгоритм обучения

- •Свойства сети Хопфилда

- •Лекция 10. Сеть Хэмминга. Двунаправленная ассоциативная память. Емкость памяти. Сеть Хэмминга

- •Структура сети

- •Алгоритм функционирования

- •Сравнение с сетью Хопфилда

- •Двунаправленная ассоциативная память

- •Функционирование сети

- •Обучение сети

- •Емкость памяти

- •Непрерывная дап

- •Адаптивная дап

- •Лекция 11. Адаптивная резонансная теория. Проблема стабильности-пластичности в инс.

- •Архитектура apt

- •Лекция 12. Функционирование и обучения сети арт. Теоремы арт. Функционирование сетей apt

- •Характеристики (теоремы) сети арт

- •Лекции 13. Проблемы реализации инс. Нейрокомпьютеры. Основные направления реализации нейросетей. Оценка производительности нейрокомпьютеров.

- •Реализация инс аппаратными средствами

- •Особенности аппаратной реализации нейросетей

- •Лекции 14. Аппаратная реализация на примере нейрочипа NeuroMatrix nm6403. Пример аппаратной реализации (нейрочип NeuroMAtrix nm6403 нтц «Модуль») Выбор и обоснование принципов построения нейрочипа

- •Архитектура нейрочипа

- •Aрхитектурныe основы построения нейросистем на базе нейрочипа

- •Лекции 15. Программная реализация нейросетей . Программная реализация нейросетей

- •Основные функциональные возможности программ моделирования нейронных сетей.

- •Формирование (создание) нейронной сети

- •Обучение нейронной сети

- •Тестирование обученной нейронной сети

- •Лекции 16. Программная реализация нейросетей на примере модели процессорного элемента NeuralWorks. Модель процессорного элемента нейропакета NeuralWorks Professional II

- •Этапы функционирования процессорного элемента.

- •Литература

Лекция 10. Сеть Хэмминга. Двунаправленная ассоциативная память. Емкость памяти. Сеть Хэмминга

Среди различных конфигураций искусственных нейронных сетей встречаются такие, при классификации которых по принципу обучения, строго говоря, не подходят ни обучение с учителем, ни обучение без учителя. В таких сетях весовые коэффициенты синапсов рассчитываются только однажды перед началом функционирования сети на основе информации об обрабатываемых данных, и все обучение сети сводится именно к этому расчету. С одной стороны, предъявление априорной информации можно расценивать, как помощь учителя, но с другой – сеть фактически просто запоминает образцы до того, как на ее вход поступают реальные данные, и не может изменять свое поведение, поэтому говорить о звене обратной связи с "миром" (учителем) не приходится. Из сетей с подобной логикой работы наиболее известны сеть Хопфилда и сеть Хэмминга, которые обычно используются для организации ассоциативной памяти.

Структура сети

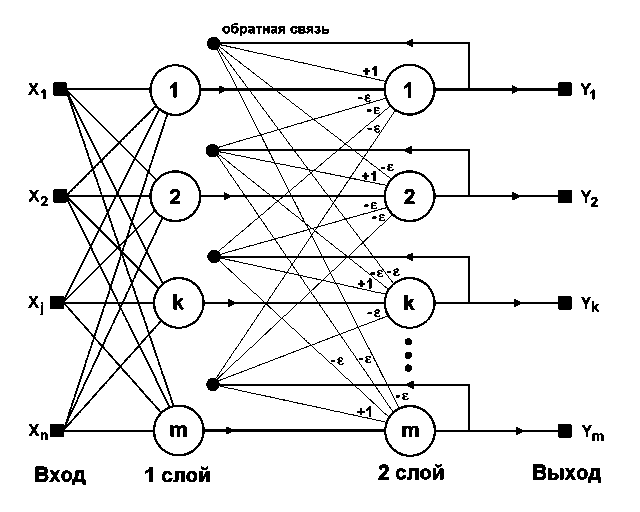

Когда нет необходимости, чтобы сеть в явном виде выдавала образец, то есть достаточно, скажем, получать номер образца, ассоциативную память успешно реализует сеть Хэмминга. Данная сеть характеризуется, по сравнению с сетью Хопфилда, меньшими затратами на память и объемом вычислений, что становится очевидным из ее структуры (рис. 26).

Сеть состоит из двух слоев. Первый и второй слои имеют по m нейронов, где m – число образцов. Нейроны первого слоя имеют по n синапсов, соединенных со входами сети (образующими фиктивный нулевой слой). Нейроны второго слоя связаны между собой ингибиторными (отрицательными обратными) синаптическими связями. Единственный синапс с положительной обратной связью для каждого нейрона соединен с его же аксоном.

Рис.26. Структура сети Хэмминга.

Идея работы сети состоит в нахождении расстояния Хэмминга от тестируемого образа до всех образцов. Расстоянием Хэмминга называется число отличающихся битов в двух бинарных векторах. Сеть должна выбрать образец с минимальным расстоянием Хэмминга до неизвестного входного сигнала, в результате чего будет активизирован только один выход сети, соответствующий этому образцу.

На стадии инициализации весовым коэффициентам первого слоя и порогу активационной функции присваиваются следующие значения:

wik = xik/2, i=0...n-1, k=0...m-1;

Tk = n / 2, k = 0...m-1.

Здесь xik – i-ый элемент k-ого образца.

Весовые коэффициенты тормозящих синапсов во втором слое берут равными некоторой величине 0 < ε < 1/m. Выход нейрона, связанный с его же входом имеет вес +1.

Алгоритм функционирования

Алгоритм функционирования сети Хэмминга следующий:

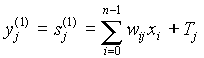

1. На входы сети подается неизвестный вектор X = {xi:i=0...n-1}, исходя из которого рассчитываются состояния нейронов первого слоя (верхний индекс в скобках указывает номер слоя):

,

j=0...m-1

,

j=0...m-1

После этого полученными значениями инициализируются значения выходов второго слоя:

yj(2) = yj(1), j = 0...m-1

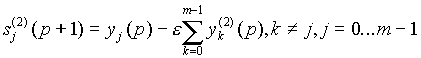

2. Вычислить новые состояния нейронов второго слоя:

и значения их выходов:

![]()

Активационная функция f имеет вид порога, причем величина F должна быть достаточно большой, чтобы любые возможные значения аргумента не приводили к насыщению.

3. Проверить, изменились ли выходы нейронов второго слоя за последнюю итерацию. Если да – перейди к шагу 2. Иначе – конец.

Из оценки алгоритма видно, что роль первого слоя весьма условна: воспользовавшись один раз на шаге 1 значениями его весовых коэффициентов, сеть больше не обращается к нему, поэтому первый слой может быть вообще исключен из сети (заменен на матрицу весовых коэффициентов).