- •37. Стеганографическое скрытие информации: основные методы и их особенности.

- •36. Обфускация по. Методы обфускации. Процесс обфускации.

- •Виды обфускации

- •21. Генерация псевдослучайных последовательностей чисел.

- •7. Энтропия объединения.

- •30. Электронно-цифровая подпись. Требования к эцп. Стандарт рб.

- •33. Криптосистема Эль-Гамаля.

- •27. Структура ключевой информации и основной шаг криптопреобразования гост 28147-89.

- •18. Сложность проблем. Pn-полная и Pn-сложная задачи.

- •22. Основные модели криптосистем.

- •12. Энтропия источника и энтропия сообщения.

- •13. Основные модели каналов связи.

- •32. Rsa. Шифрование и расшифровывание.

- •41. Шифры простой замены.

- •40. Шифрование методом гаммирования. Шифры сложной замены.

- •Режим Электронная кодовая книга.

- •Режим Сцепление блоков шифра.

- •Режим Обратная связь по шифротексту.

- •Режим Обратная связь по выходу

- •Тройной des.

- •28. Базовые циклы и основные режимы шифрования гост 28147-89.

- •24. Стандарт des: функция шифрования и алгоритм вычисления ключей. Функция шифрования в des.

- •Алгоритм вычисления ключей.

- •35. Комбинированный метод шифрования.

- •Типовой алгоритм 2

- •23. Стандарт des: особенности разработки и обобщенные схемы зашифровывания и расшифровывания.

- •Обобщенная схема зашифровывания.

- •38. Требования к криптосистемам.

- •39. Угрозы информационной безопасности и их классификация.

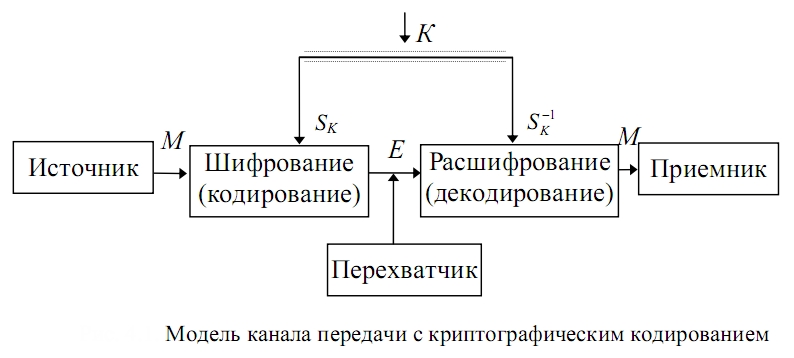

22. Основные модели криптосистем.

Источник информации генерирует открытый текст или незашифрованное сообщение M, которое должно быть передано соответствующему получателю по незащищенному каналу, за которым следит перехватчик. Для того чтобы перехватчик не смог распознать сообщение M, отправитель шифрует (кодирует) его с помощью обратимого кодирования (преобразования) Sk и получает криптограмму или шифрованный текст E = Sk(M), который отправляет получателю. Законный получатель, приняв криптограмму E, декодирует (расшифровывает) ее с помощью обратного преобразования Sk-1 и получает исходное сообщение в виде открытого сообщения M: Sk(E) = Sk-1(Sk(M)) = M. Преобразование Sk выбирается из семейства криптографических преобразований, называемых криптографической системой или общей системой.

Параметр, выбираемый в качестве отдельного преобразования, называется криптографическим ключом или просто ключом. Общая система − это набор инструкций (часть аппаратуры или программа ЭВМ), с помощью которой можно закодировать открытый текст и декодировать шифрованный текст различными способами, один из которых выбирается с помощью конкретного ключа.

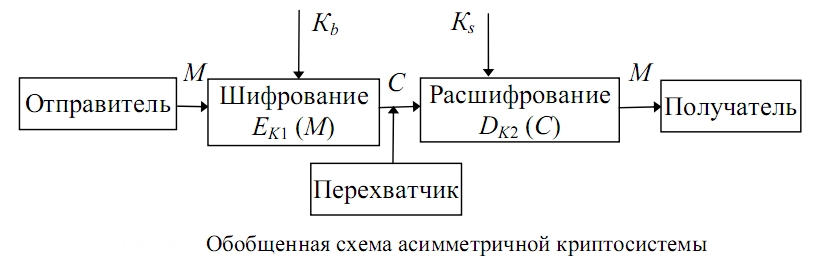

В асимметричной криптосистеме для зашифровывания данных используется один ключ, а для расшифровывания – другой ключ. Первый ключ является открытым и может быть опубликован для использования всеми пользователями системы, которые зашифровывают данные. Расшифровывание данных с помощью открытого ключа невозможно.

Для расшифровывания данных получатель зашифрованной информации использует второй ключ, который является секретным. Разумеется, ключ расшифровывания не может быть определен из ключа зашифровывания.

– В асимметричных системах нет необходимости в защищенном канале для передачи ключей, так как открытый ключ передается по незащищенному каналу.

– У симметричной скорость шифрования и расшифровки выше.

12. Энтропия источника и энтропия сообщения.

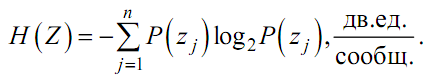

Пусть источник информации выдает дискретные сообщения Z = (z1, z2, …, zn). С помощью кодирующего устройства каждое сообщение превращается в код. Множество символов кода обозначим через X = (x1, x2, …, xm). Если исследуется канал связи, то можно не обращаться к источнику информации, а рассматривать лишь источник символов (кодирующее устройство). Тогда возникает необходимость связать свойства источника и отправителя. Эта связь возможна через энтропию. Под энтропией сообщения будем понимать количество информации, содержащееся в любом усредненном сообщении. Тогда усредненная энтропия сообщения:

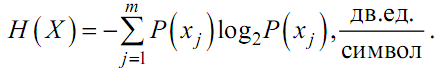

Соответственно энтропия источника или количество информации, содержащееся в одном символе сообщения:

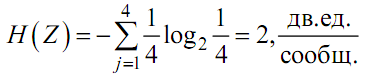

Пример. Пусть передается четыре равновероятных сообщения двоичным неизбыточным кодом. Сообщения отображаются кодом 00, 01, 10, 11. Найдем энтропию сообщения:

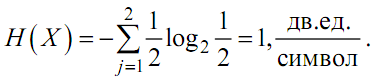

и энтропию источника

Из примера видно, что каждый символ несет одну двоичную единицу информации.

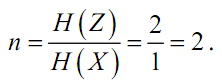

Разделим энтропию сообщения на энтропию источника и получим число элементов в коде, т.е.:

Если данное условие соблюдается, то код называется оптимальным, в противном случае в коде возникает избыточность, и он становится неоптимальным для канала без шума. Для получения оптимального кода необходимо, чтобы символы в нем встречались с равной вероятностью.