- •Тема 1. Классификация моделей.

- •Тема 1. Классификация моделей.

- •Основные признаки классификации моделей.

- •Область использования.

- •Учет в модели временного фактора.

- •Способ представления модели.

- •Тема 2. Классификация языков компьютерного моделирования.

- •Тема 3. Этапы и цели компьютерного математического моделирования.

- •Раздел 1. Задачи линейного программирования.

- •Тема 1. Математическое программирование. Общий вид задач линейного программирования.

- •Формулировка задачи.

- •Геометрическая интерпретация задачи линейного программирования.

- •Найти минимальное значение линейной функции

- •Тема 2. Графический метод решения задач линейного программирования.

- •Примеры задач, решаемых графическим методом.

- •Обобщение графического метода решения задач линейного программирования.

- •Тема 3. Симплекс - метод.

- •Каноническая задача лп на максимум.

- •Вспомогательная задача лп.

- •Алгоритм метода искусственного базиса

- •Вспомогательная задача лп.

- •Алгоритм метода искусственного базиса.

- •Тема 4. Транспортная задача.

- •4.2 Составление опорного плана.

- •4.3 Метод потенциалов.

- •Раздел 2. Теория графов.

- •Тема 1. Основные понятия теории графов.

- •Элементы множества V называются вершинами графа g (или узлами), элементы множества u-его ребрами. Вершины и ребра графа называют также его элементами и вместо VV и u u пишут Vg и ug.

- •1.2 Операции над графами.

- •1.3.Связность графов.

- •1.4 Эйлеровы графы.

- •1.5 Гамильтоновы графы.

- •Тема 2. Поиск пути в графе.

- •2.2 Путь минимальной суммарной длины во взвешенном графе с неотрицательными весами (алгоритм Дейкстры).

- •2.3 .Путь минимальной суммарной длины во взвешенном графе с произвольными весами для всех пар вершин (алгоритм Флойда).

- •2.4 Путь с минимальным количеством промежуточных вершин (волновой алгоритм).

- •2.5 Нахождение k путей минимальной суммарной длины во взвешенном графе с неотрицательными весами (алгоритм Йена).

- •Тема 3. Задачи о минимальном остове.

- •3.1 Деревья.

- •3.1 Построение минимального остовного дерева (алгоритм Краскала).

- •3.1 Деревья.

- •3.1 .Построение минимального остовного дерева (алгоритм Краскала).

- •Раздел 3. Динамическое программирование.

- •Тема 1. Метод динамического программирования.

- •1.2 Идеи метода динамического программирования

- •1.3 Выбор состава оборудования для технологической линии.

- •Исходные данные для примера

- •Тема 2. Задача инвестирования.

- •Тема 3. Замена оборудования.

- •Тема 4. Задача о загрузке.

- •4.2 Рекуррентные соотношения для процедур прямой и обратной прогонки.

- •4.3 Решение задачи о загрузке.

- •Раздел 4. Системы массового обслуживания (смо). (8 часов).

- •Тема 1. Основные понятия теории массового обслуживания.

- •Тема 2. Простейшие смо и нахождение их параметров.

- •Перечень характеристик систем массового обслуживания можно представить следующим образом:

- •2. Одноканальная смо с неограниченной очередью

- •3. Одноканальная смо с неограниченной очередью, простейшим потоком заявок и произвольным распределением времени обслуживания

- •4. Одноканальная смо с произвольным потоком заявок и произвольным распределением времени обслуживания

- •Раздел 5. Имитационное моделирование.

- •Тема 1. Простейшие задачи, решаемые методом имитационного моделирования.

- •Тема 2. Основные понятия теории Марковских процессов.

- •Тема 3. Метод Монте – Карло.

- •Раздел 6. Прогнозирование.

- •Тема 1. Основная идея прогнозирования. Методы прогнозирования

- •Тема 2.Теории экспертных оценок.

- •Раздел 7. Теория игр.

- •Тема 1. Основные понятия теории игр.

- •1. 1 Понятие об играх и стратегиях

- •Тема 2. Простейшие методы решения задач теории игр.

- •Раздел 8. Элементы теории принятия решений. (2 часа).

- •Основные понятия.

- •Принятие решений в условиях полной неопределенности

- •Принятие решений при проведении эксперимента.

- •2. Принятие решений в условиях полной неопределенности

- •2.1 Максиминный критерий Вальда.

- •Критерий равновозможных состояний.

- •3. Принятие решений при проведении эксперимента.

- •3.1. Принятие решений в условиях неопределенности.

- •3.2. Использование смешанной стратегии

- •3.3. Принятие решений в условиях риска

3.2. Использование смешанной стратегии

Стратегия S* называется смешанной, если она представлена в виде выпуклой комбинации двух других стратегий,

S* = сSm1 + (1 - с)Sm2, 0<с<1, m1, m2 {1, 2, …, t}.

Это определение базируется на понятии выпуклой комбинации точек [14]. Переход к смешанной стратегии осуществляется с целью повышения гарантированной средней полезности.

Стратегии

рассмотренного выше примера изобразим

точками на плоскости с координатами

![]() ,

,

![]() ,

i=1,3,4,7,8

(рис. 2).

,

i=1,3,4,7,8

(рис. 2).

П о

рис. 2 видно, что если взять в определенных

пропорциях стратегии S4

и S8,

то получим смешанную стратегию, лучшую

по сравнению со стратегией S7.

Проведем биссектрису I-го

координатного угла и найдем точку

пересечения ее с отрезком [S4,

S8]

–– точку

о

рис. 2 видно, что если взять в определенных

пропорциях стратегии S4

и S8,

то получим смешанную стратегию, лучшую

по сравнению со стратегией S7.

Проведем биссектрису I-го

координатного угла и найдем точку

пересечения ее с отрезком [S4,

S8]

–– точку

![]() .

.

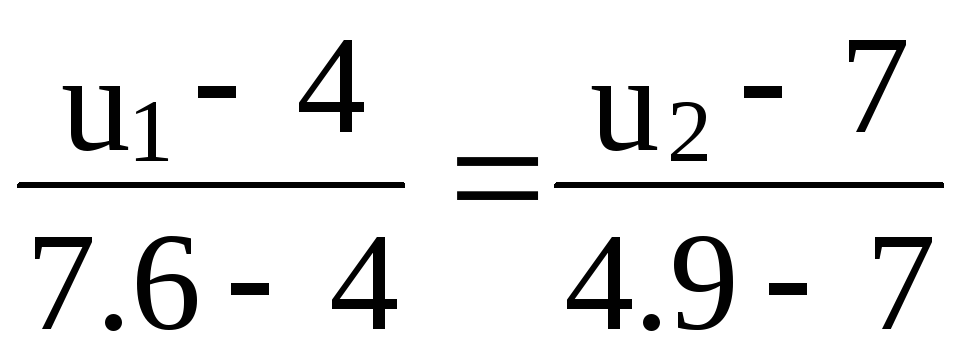

Запишем уравнение прямой, проходящей через точки S4(7.6; 4.9), S8 (4;7) ,

,

,

которое приводится к виду:

![]() .

.

Из

этого уравнения находим координаты

точки

![]() ,

для которой

,

для которой

![]() ,

,

![]() .

.

Так

как

![]() ,

то стратегия

,

то стратегия

![]() лучше стратегии S7,

гарантирующей 5.2 ед. полезности, S*>S7.

Теперь остается представить стратегию

лучше стратегии S7,

гарантирующей 5.2 ед. полезности, S*>S7.

Теперь остается представить стратегию

![]() в виде выпуклой комбинации стратегий

S4,

S8,

в виде выпуклой комбинации стратегий

S4,

S8,

S* = cS4 + (1 – c)S8, 0 < c <1. (10)

Для определения значения параметра достаточно записать уравнение (10) для абсцисс входящих в него точек,

![]()

из

которого получаем

![]() .

Тогда равенство (10) принимает вид:

.

Тогда равенство (10) принимает вид:

![]() . (11)

. (11)

Так

как

![]() ,

,

![]() ,

то в силу равенства (11) имеем

,

то в силу равенства (11) имеем

![]() .

.

Практически

смешанную стратегию S*

можно реализовать так. Если результат

эксперимента есть z2

или z3,

то используется операция a2.

Если же результат эксперимента есть

z1,

то с помощью подходящего случайного

механизма с вероятностью

![]() используется операция a1,

и с вероятностью

используется операция a1,

и с вероятностью

![]() –– операция а2.

Основой случайного механизма могут

служить 19 одинаковых карточек, на 10–и

из которых записан символ а1,

а на 9–и –– символ а2.

Из этого набора 19–и карточек случайно

выбирается одна и используется та

операция, символ, которой изображен на

этой карточке.

–– операция а2.

Основой случайного механизма могут

служить 19 одинаковых карточек, на 10–и

из которых записан символ а1,

а на 9–и –– символ а2.

Из этого набора 19–и карточек случайно

выбирается одна и используется та

операция, символ, которой изображен на

этой карточке.

3.3. Принятие решений в условиях риска

К условиям, перечисленным в подпараграфе 3.1, добавляется еще одно – значения априорных вероятностей состояний окружающей среды (природы):

p(Q1), p(Q2), ..., p(Qn). (12)

Тогда

для каждой стратегии

![]() определяется усредненная по всем

состояниям природы средняя полезность

определяется усредненная по всем

состояниям природы средняя полезность

![]() по формуле:

по формуле:

![]() (13)

(13)

U(Si,Qj)

– полезность стратегии

![]() при состоянии природы

при состоянии природы

![]() ,

которая находится по формуле (9). Затем

из множества

,

которая находится по формуле (9). Затем

из множества

![]() ,

,

![]() ,

выделяется максимальный элемент,

,

выделяется максимальный элемент,

![]() ,

,

![]() .Стратегия

.Стратегия

![]() ,

обладающая максимальной средней

полезностью

,

обладающая максимальной средней

полезностью

![]() ,

называется байесовской стратегией,

,

называется байесовской стратегией,

![]() ,

,

![]() .

.

Пусть в рассмотренном ранее примере р(Q1) = 0.6, p(Q2) = 0.4. Используя данные табл. 9. и формулу (13), вычислим среднюю полезность для каждой допустимой стратегии,

![]() =

100.6

+ 00.4

= 6,

=

100.6

+ 00.4

= 6,

![]() =

8.80.6

+ 50.4

= 6.68,

=

8.80.6

+ 50.4

= 6.68,

![]() =

7.60.6

+ 4.90.4

= 6.52,

=

7.60.6

+ 4.90.4

= 6.52,

![]() =

5.20.6

+5.60.4

=5.36,

=

5.20.6

+5.60.4

=5.36,

![]() =

40.6

+ 70.4

=5.2 .

=

40.6

+ 70.4

=5.2 .

Затем найдем наибольшее число из полученных пяти чисел,

![]()

Следовательно,

оптимальной стратегией является

стратегия

![]() ,

обладающая максимальной средней

полезностью, равной 6.68 ед.

,

обладающая максимальной средней

полезностью, равной 6.68 ед.

Заметим,

что стратегия

![]() является байесовской для конкретных

значений априорных вероятностей: р(Q1)

= 0.6, p(Q2)

= 0.4. При других значениях р(Q1),

р(Q2)

байесовской может быть и другая

стратегия. Так, при р(Q1)

= 0.5, p(Q2)

= 0.5 байесовской является стратегия

является байесовской для конкретных

значений априорных вероятностей: р(Q1)

= 0.6, p(Q2)

= 0.4. При других значениях р(Q1),

р(Q2)

байесовской может быть и другая

стратегия. Так, при р(Q1)

= 0.5, p(Q2)

= 0.5 байесовской является стратегия

![]() .

.

Проведение эксперимента в рассмотренной ситуации выгодно. Действительно, если эксперимент не проводить, то по данным табл.7 имеем:

![]()

Байесовской операцией (стратегией) является операция а1, средняя полезность которой равна 6 ед.

Для дальнейших рассуждений нам понадобиться объединить выражения (13), (9) в одно,

![]() .

.

Меняя порядок суммирования в правой части последнего равенства, получим

![]() (14)

(14)

Из этого равенства

следует, что при выборе оптимальной

стратегии

![]() максимизация

максимизация

![]() сводится к максимизации выражения в

квадратных скобках в правой части (14),

т.е. для каждого результата эксперимента

zβ

максимизация полезности Uβ(ai)

сводится к выбору такой операции

сводится к максимизации выражения в

квадратных скобках в правой части (14),

т.е. для каждого результата эксперимента

zβ

максимизация полезности Uβ(ai)

сводится к выбору такой операции

![]() ,

которая максимизирует выражение в

квадратных скобках.

,

которая максимизирует выражение в

квадратных скобках.

ЛИТЕРАТУРА.

-

Венцель Е.С. Исследование операций. Задачи, принципы, методология. - М: Наука, 1980.

-

Дегтярев Ю.П. Исследование операций. - М.: Высшая школа, 1986.

-

Корбут А.А., Финкелыптейн Ю.Ю. Дискретное программирование. -М.:Мир, 1978.

-

Кристофвдес Н. Теория графов. Алгоритмический подход. - М.: Мир, 1978.

-

Липский В. Комбинаторика для программистов. - М.: Мир, 1988.

-

Клейнрок Л. Теория массового обслуживания. - М.: Машиностроение, 1979.

-

Ивченко Г.И. и др. Теория массового обслуживания. - М. Высшая школа, 1982.

-

Шенок Р. Имитационное моделирование систем - искусство и наука.-М.: Мир, 1978.

-

Гудман С, Хидегниеми С. Введение в разработку и анализ алгоритмов. - М.: Мир, 1981.

-

Гмурман В.Е. Теория вероятностей и математическая статистика. Москва «Высшая школа» 1998.