- •Теория информационных процессов и систем

- •Санкт-Петербург

- •Содержание

- •Введение

- •Лабораторная работа № 1 Кластерный анализ

- •Задача 1. Метод k-средних.

- •Общая логика

- •Вычисления

- •Интерпретация результатов

- •Выполнение работы

- •Шаг 1. Загрузка файла данных

- •Шаг 2. Выбор метода анализа данных

- •Вывод результатов и их анализ

- •Задача 2. Иерархические алгоритмы.

- •Общая логика

- •Иерархическое дерево

- •Меры расстояния

- •Правила объединения или связи

- •Выполнение работы

- •Вывод результатов и их анализ

- •Задача 3.

- •Лабораторная работа № 2 Анализ временных рядов

- •Основные цели

- •Идентификация модели временных рядов

- •Анализ тренда

- •Анализ сезонности

- •Модель арпсс

- •Идентификация

- •Оценивание параметров

- •Оценивание модели

- •Экспоненциальное сглаживание

- •Сезонная и несезонная модели с трендом или без тренда

- •Задача 1. Определение тренда методом скользящих средних. Анализ сезонной составляющей.

- •Выполнение работы

- •Расчет сезонных индексов исходного ряда по аддитивной модели ряда

- •Расчет сезонных индексов исходного ряда по мультипликативной модели ряда

- •Задача 2. Прогнозирование по тренду и сезонной составляющей. Прогнозирование временного ряда методом экспоненциального сглаживания.

- •Выполнение работы

- •Дополнительно:

- •Задача 3.

- •Лабораторная работа № 3 Регрессионный анализ

- •Задача 1. Пошаговая регрессия.

- •Выполнение работы

- •Процедура пошаговой регрессии Backward stepwise:

- •Процедура пошаговой регрессии Forward stepwise:

- •Результаты регрессионного анализа:

- •Дисперсионный анализ:

- •Вычисление предсказанных значений доверительных интервалов:

- •Задача 2. Корреляционный анализ.

- •Выполнение работы

- •Задача 3. Нелинейная регрессия.

- •Выполнение работы:

- •Лабораторная работа № 4 Непараметрические методы математической статистики Основная цель

- •Краткий обзор непараметрических процедур

- •Выбор метода

- •Большие массивы данных и непараметрические методы

- •Задача 1. Таблицы сопряженности 22, статистики , , критерий Макнимара, точный критерий Фишера.

- •Выполнение работы

- •Задача 2. Статистика для сравнения наблюдаемых и ожидаемых частот.

- •Выполнение работы

- •Задача 3. Коэффициенты ранговой корреляции Спирмена и Кендалла.

- •Выполнение работы

- •Задача 4. Критерий серий Вальда-Вольфовица.

- •Выполнение работы:

- •Задача 5. Критерий Манна-Уитни.

- •Выполнение работы:

- •Задача 6. Однофакторный дисперсионный анализ Краскела-Уоллиса и медианный критерий.

- •Выполнение работы:

- •Задача 7. Критерий знаков. Критерий Вилкоксона для связанных пар наблюдений.

- •Выполнение работы:

- •Задача 8. Двухфакторный анализ Фридмана и коэффициент конкордации Кендалла.

- •Выполнение работы:

- •Задача 9. Q-критерий Кокрена.

- •Выполнение работы:

- •Лабораторная работа № 5 Однофакторный дисперсионный анализ

- •Цель дисперсионного анализа

- •Задача 1

- •Выполнение работы:

- •Задача 2

- •Выполнение работы:

- •Задача 3

- •Содержание отчета

- •Список литературы

- •Приложение 1 Пример оформления титульного листа лабораторной работы

Меры расстояния

Объединение или метод древовидной кластеризации используется при формировании кластеров несходства или расстояния между объектами. Эти расстояния могут определяться в одномерном или многомерном пространстве. Наиболее прямой путь вычисления расстояний между объектами в многомерном пространстве состоит в вычислении евклидовых расстояний. Если имеется двух- или трёхмерное пространство, то эта мера является реальным геометрическим расстоянием между объектами в пространстве (как будто расстояния между объектами измерены рулеткой). Однако алгоритм объединения не «заботится» о том, являются ли «предоставленные» для этого расстояния настоящими или некоторыми другими производными мерами расстояния, что более значимо для исследователя; и задачей исследователей является подобрать правильный метод для специфических применений.

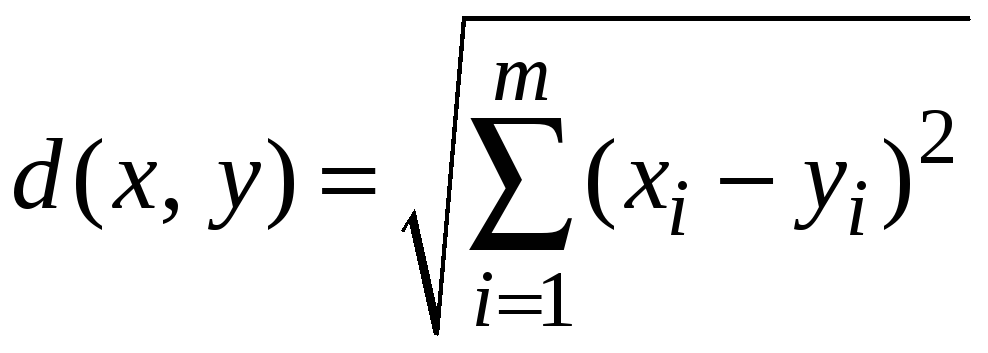

Евклидово расстояние. Это, по-видимому, наиболее общий тип расстояния. Оно попросту является геометрическим расстоянием в многомерном пространстве и вычисляется следующим образом:

.

.

Заметим, что евклидово расстояние (и его квадрат) вычисляется по исходным, а не по стандартизованным данным. Это обычный способ его вычисления, который имеет определенные преимущества (например, расстояние между двумя объектами не изменяется при введении в анализ нового объекта, который может оказаться выбросом). Тем не менее, на расстояния могут сильно влиять различия между осями, по координатам которых вычисляются эти расстояния. К примеру, если одна из осей измерена в сантиметрах, а потом она переводится в миллиметры (значения умножаются на 10), то окончательное евклидово расстояние (или квадрат евклидова расстояния), вычисляемое по координатам, сильно изменится, и, как следствие, результаты кластерного анализа могут сильно отличаться от предыдущих.

Квадрат евклидова расстояния. Иногда может возникнуть желание возвести в квадрат стандартное евклидово расстояние, чтобы придать большие веса более отдаленным друг от друга объектам. Это расстояние вычисляется следующим образом (см. также замечания в предыдущем пункте):

.

.

Расстояние городских кварталов (манхэттенское расстояние). Это расстояние является просто средним разностей по координатам. В большинстве случаев эта мера расстояния приводит к таким же результатам, как и для обычного расстояния Евклида. Однако отметим, что для этой меры влияние отдельных больших разностей (выбросов) уменьшается (так как они не возводятся в квадрат). Манхэттенское расстояние вычисляется по формуле:

.

.

Расстояние Чебышева. Это расстояние может оказаться полезным, когда желают определить два объекта как «различные», если они различаются по какой-либо одной координате (каким-либо одним измерением). Расстояние Чебышева вычисляется по формуле:

![]() .

.

Расстояние Махаланобиса. Данное расстояние учитывает корреляции между переменными.

![]() .

.

Данная мера расстояния плохо работает, если ковариационная матрица S высчитывается на всем множестве входных данных. Вообще лучше не использовать расстояние Махаланобиса если есть структура (т. е. кластеры) – тем самым в S будут внесены искажения. В то же время, будучи сосредоточенной на конкретном классе (группе данных), т. е. внутри кластера, данная мера расстояния показывает хорошие результаты.

Степенное расстояние. Иногда желают прогрессивно увеличить или уменьшить вес, относящийся к размерности, для которой соответствующие объекты сильно отличаются. Это может быть достигнуто с использованием степенного расстояния. Степенное расстояние вычисляется по формуле:

,

,

где r и p – параметры, определяемые пользователем. Параметр p ответственен за постепенное взвешивание разностей по отдельным координатам, параметр r ответственен за прогрессивное взвешивание больших расстояний между объектами. Если оба параметра – r и p, равны двум, то это расстояние совпадает с расстоянием Евклида.

Процент несогласия. Эта мера используется в тех случаях, когда данные являются категориальными. Это расстояние вычисляется по формуле:

.

.

Пиковое расстояние предполагает независимость между случайными переменными, что говорит о расстоянии в ортогональном пространстве. Но в практических приложениях эти переменные не являются независимыми. Это расстояние вычисляется по формуле:

.

.

Любую из приведенных мер расстояния можно выбирать с уверенностью лишь в том случае, если имеется информация о характере данных, подвергаемых кластеризации.