- •В. Г. Потемкин

- •Предисловие

- •Введение

- •Используемые обозначения

- •Часть 1. Ппп Neural Network Toolbox

- •1. Система matlab 6

- •1.1. Операционная среда matlab 6

- •Командное окно

- •Окно предыстории

- •Окно запуска

- •Окно текущего каталога

- •Окно рабочей области

- •Справочная подсистема

- •1.3. Демонстрационные примеры ппп nnt

- •2. Модель нейрона и архитектура сети

- •2.1. Модель нейрона

- •2.1.1. Простой нейрон

- •2.1.2. Функция активации

- •2.1.3. Нейрон с векторным входом

- •2.2. Архитектура нейронных сетей

- •2.2.1. Однослойные сети

- •2.2.2. Многослойные сети

- •2.2.3. Сети с прямой передачей сигнала

- •2.3. Создание, инициализация и моделирование сети Формирование архитектуры сети

- •Инициализация сети

- •Моделирование сети

- •3. Обучение нейронных сетей

- •3.1. Процедуры адаптации и обучения

- •Явление переобучения

- •Свойство обобщения

- •3.1.1. Способы адаптации и обучения

- •Адаптация нейронных сетей

- •Xlabel(''), ylabel('Выходыa(I)'),grid

- •Xlabel(''), ylabel('Весавходовw(I)'),grid

- •Xlabel(' Циклы'), ylabel('Ошибка'),grid

- •Xlabel(''), ylabel('Выходыa(I)'),grid

- •Xlabel(''), ylabel('Весавходовw(I)'),grid

- •Xlabel('Циклы'), ylabel('Ошибка'),grid

- •Xlabel(''), ylabel('Выходыa(I)'),grid

- •Xlabel(''), ylabel('Весавходовw(I)'),grid

- •Xlabel('Циклы'), ylabel('Ошибка'),grid

- •Обучение нейронных сетей

- •3.2. Методы обучения

- •3.2.1. Обучение однослойной сети

- •3.2.2. Обучение многослойной сети

- •Метод обратного распространения ошибки

- •Характеристика методов обучения

- •3.3. Алгоритмы обучения

- •3.3.1. Градиентные алгоритмы обучения Алгоритм gd

- •Алгоритм gdm

- •Алгоритм gda

- •Алгоритм Rprop

- •3.3.2. Алгоритмы метода сопряженных градиентов

- •Алгоритм cgf

- •Алгоритм cgp

- •Алгоритм cgb

- •Алгоритм scg

- •3.3.3. Квазиньютоновы алгоритмы Алгоритм bfgs

- •Алгоритм oss

- •Алгоритм lm

- •3.3.4. Алгоритмы одномерного поиска

- •Алгоритм gol

- •Алгоритм bre

- •Алгоритм hyb

- •Алгоритм cha

- •Алгоритм bac

- •3.3.5. Расширение возможностей процедур обучения

- •Переобучение

- •Метод регуляризации

- •Формирование представительной выборки

- •Предварительная обработка и восстановление данных

- •Пример процедуры обучения

- •4. Персептроны

- •4.1. Архитектура персептрона

- •4.2. Модель персептрона

- •Моделирование персептрона

- •Инициализация параметров

- •4.3. Процедуры настройки параметров

- •Правила настройки

- •Процедура адаптации

- •5. Линейные сети

- •5.1. Архитектура линейной сети

- •5.2. Создание модели линейной сети

- •5.3. Обучение линейной сети

- •Процедура настройки

- •Процедура обучения

- •5.4. Применение линейных сетей Задача классификации векторов

- •Фильтрация сигнала

- •Предсказание сигнала

- •Подавление шумов

- •Многомерные цифровые фильтры

- •6. Радиальные базисные сети

- •Модель нейрона и архитектура сети

- •Создание сети

- •Радиальная базисная сеть с нулевой ошибкой

- •Итерационная процедура формирования сети

- •Примеры радиальных базисных сетей

- •6.1. Сети grnn

- •Архитектура сети

- •Синтез сети

- •6.2. Сети pnn

- •Архитектура сети

- •Синтез сети

- •7. Сети кластеризации и классификации данных

- •7.1. Самоорганизующиеся нейронные сети

- •7.1.1. Слой Кохонена

- •Архитектура сети

- •Создание сети

- •Правило обучения слоя Кохонена

- •Правило настройки смещений

- •Обучение сети

- •7.1.2. Карта Кохонена

- •Топология карты

- •Функции для расчета расстояний

- •Архитектура сети

- •Создание сети

- •Обучение сети

- •Одномерная карта Кохонена

- •Двумерная карта Кохонена

- •Архитектура сети

- •Создание сети

- •Обучение сети Правила настройки параметров

- •Процедура обучения

- •8. Рекуррентные сети

- •8.1. Сети Элмана

- •Архитектура

- •Создание сети

- •Обучение сети

- •Проверка сети

- •8.2. Сети Хопфилда

- •Архитектура сети

- •Синтез сети

- •9. Применение нейронных сетей

- •9.1. Аппроксимация и фильтрация сигналов

- •9.1.1. Предсказание стационарного сигнала Постановка задачи

- •Синтез сети

- •Проверка сети

- •9.1.2. Слежение за нестационарным сигналом

- •Инициализация сети

- •Проверка сети

- •9.1.3. Моделирование стационарного фильтра

- •Постановка задачи

- •Синтез сети

- •Проверка сети

- •9.1.4. Моделирование нестационарного фильтра

- •Постановка задачи

- •Инициализация сети

- •Проверка сети

- •9.2. Распознавание образов

- •Постановка задачи

- •Нейронная сеть

- •Архитектура сети

- •Инициализация сети

- •Обучение

- •Обучение в отсутствие шума

- •Обучение в присутствии шума

- •Повторное обучение в отсутствие шума

- •Эффективность функционирования системы

- •9.3. Нейронные сети и системы управления

- •9.3.1. Регулятор с предсказанием

- •9.3.2. Регулятор narma-l2

- •9.3.3. Регулятор на основе эталонной модели

- •Часть2. Операторы, функции и команды

- •10. Вычислительная модель нейронной сети

- •10.1. Описание сети Описание архитектуры

- •Функции инициализации, адаптации и обучения

- •10.2. Описание элементов сети

- •Описание входов

- •Описание слоев

- •Описание выходов

- •Описание целей

- •Описание смещений

- •Описание весов входа

- •Описание весов слоя

- •Матрицы весов и векторы смещений

- •Информационные поля

- •11. Формирование моделей нейронных сетей

- •11.1. Модели сетей

- •11.1.1. Однослойные сети Персептрон

- •Линейные сети

- •11.1.2. Многослойные сети

- •Радиальные базисные сети

- •Самоорганизующиеся сети

- •Сети – классификаторы входных векторов

- •Рекуррентные сети

- •11.2. Функции активации

- •Персептрон

- •Линейные сети

- •Радиальные базисные сети

- •Самоорганизующиеся сети

- •Рекуррентные сети

- •11.3. Синаптические функции

- •Функции взвешивания и расстояний

- •Функции накопления

- •11.4. Функции инициализации

- •11.5. Функции адаптации и обучения Функции адаптации

- •Функции обучения

- •Градиентные алгоритмы обучения

- •Алгоритмы метода сопряженных градиентов

- •Квазиньютоновы алгоритмы обучения

- •11.5.1. Функции оценки качества обучения

- •11.6. Функции настройки параметров

- •11.6.1. Функции одномерного поиска

- •11.7. Масштабирование и восстановление данных

- •11.8. Вспомогательные функции

- •Утилиты вычислений

- •Операции с массивами данных

- •Графические утилиты

- •Информация о сети и ее топологии

- •11.9. Моделирование нейронных сетей и система Simulink Функции моделирования сети

- •11.9.1. Применение системы Simulink

- •Библиотеки блоков для моделирования нейронных сетей

- •Построение моделей нейронных сетей

- •Индексный указатель Команды, функции и операторы ппп Neural Network Toolbox

- •Предметный указатель

- •Литература Книги на английском языке:

- •Книги на русском языке:

- •Оглавление

9.3.3. Регулятор на основе эталонной модели

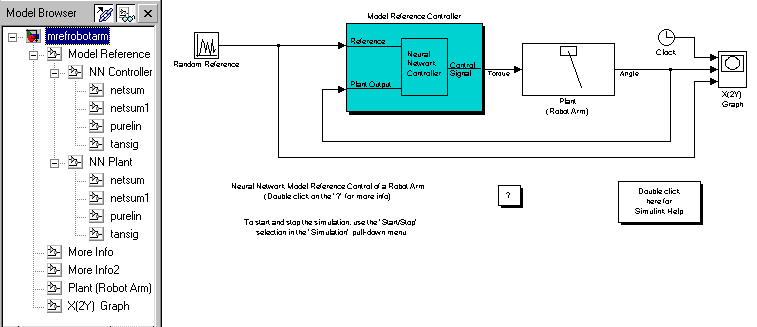

В этом разделе описана система управления с эталонной моделью, при реализации которой используются 2 нейронные сети: для регулятора и для модели объекта управления. Схема демонстрационного примера управления звеном робота показана на рис. 9.49.

Рис. 9.49

Окно Model Browserв левой части рисунка содержит перечень всех блоков, входящих в состав системы управления, представленной в виде модели системыSimulink.

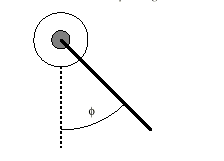

В этом демонстрационном примере цель состоит в управлении движением одного звена робота, как это показано на рис. 9.50.

Рис. 9.50

Рис. 9.50

Уравнения движения звена:

![]() (9.13)

(9.13)

где – угол поворота звена;u– момент, развиваемый двигателем постоянного тока.

Цель обучения регулятора состоит в том, чтобы движение звена отслеживало выход эталонной модели:

![]() (9.14)

(9.14)

где yr – выход эталонной модели;r– задающий сигнал на входе модели.

Соответствующая динамическая модель, реализованная в системе Simulink, показана на рис. 9.51.

Рис. 9.51

Рис. 9.51

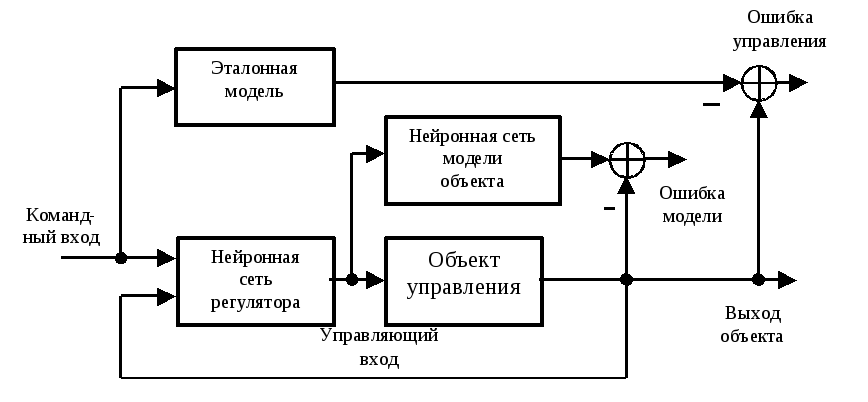

Структурная схема, поясняющая принцип построения системы управления с эталонной моделью, показана на рис. 9.52.

Рис. 9.52

В ней следует выделить эталонную модель, которая задает желаемую траекторию движения звена робота, удовлетворяющую дифференциальному уравнению (9.14), а также нейронные сети, реализующие регулятор и модель объекта управления.

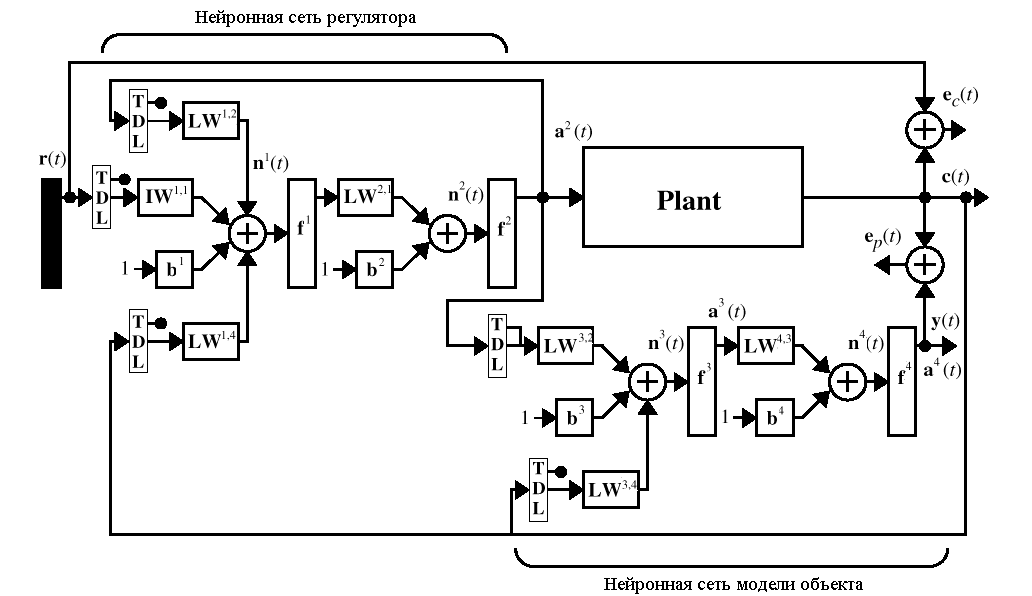

Архитектуру нейронной сети регулятора можно описать профилем 5–13–1 (5 входов, 13 нейронов скрытого слоя и 1 выход). Она показана на рис. 9.53 и имеет 2 слоя. Здесь же показана и нейронная сеть модели объекта, которая также состоит из двух слоев. Линии задержки, используемые для формирования входов нейронных сетей, имеют такт дискретности, равный 0.05 с.

Рис. 9.53

Демонстрационный пример Model Reference Control использует следующие файлы, размещенные в каталоге toolbox\nnet\nncontrol.

MAT-файлы данных:

robot1,robot2 – данные для обучения нейросетевой модели звена робота;

robot1norm,robot2norm,robot3norm– нормированные данные для обучения нейросетевой модели звена робота;

robot1ref– данные для обучения нейросетевой модели контроллера.

Обучающие функции нейронных сетей:

srchbacxc– процедура одномерного поиска на основе перебора с возвратом;

trainbfgc– модифицированная процедура алгоритмаBFGSдля расчета системы управления с эталонной моделью.

Модели Simulink:

mrefrobotarm– модель системы управления звеном робота;

mrefrobotarm2 – модель системы управления звеном робота с нормированными данными;

robotarm– динамическая модель звена робота;

robotref– эталонная модель.

Вспомогательные функции:

sfunxy2 –S-функция для вывода графиков;

nncontrolutil– утилита, обеспечивающая возможность обращения к частным функциям из системыSimulink.

Выполнить запуск демонстрационного примера можно несколькими способами:

в окне запуска приложений Launch Padвыбрать опциюDemos для ППП Neural Network Toolbox;

ввести команды mrefrobotarmилиmrefrobotarm2 в командном окне системыMATLABв зависимости от того, используется ли модель с ненормированными или нормированными данными.

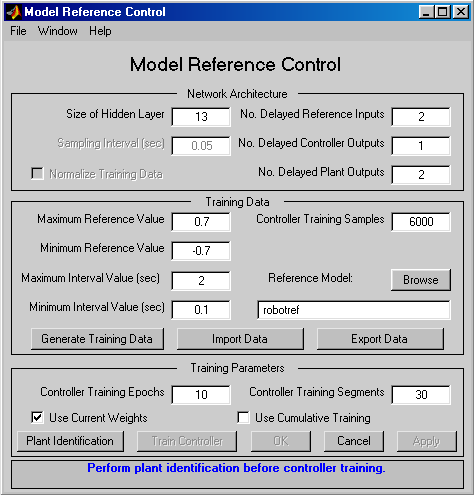

Для того чтобы начать работу, необходимо активизировать блок Model Reference Controller двойным щелчком левой кнопки мыши. Появится окно, показанное на рис. 9.54.

Рис. 9.54

Рис. 9.54

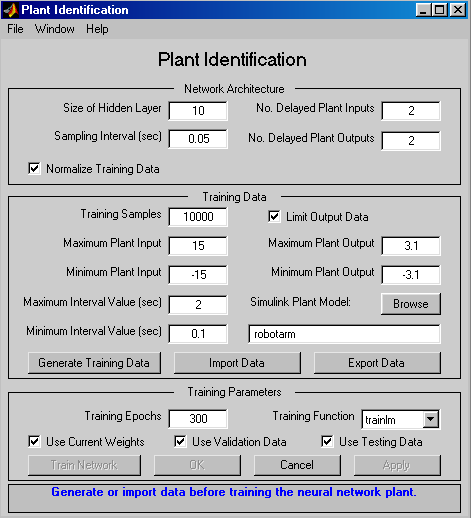

Особенность рассматриваемой системы управления заключается в том, что следует построить 2 нейронные сети: модели объекта управления и самого регулятора. Разумно начать с построения модели объекта управления и в окне, показанном на рис. 9.54, выбрать кнопку Plant Identification. При этом откроется окноPlant Identification, которое показано на рис. 9.55.

Рис. 9.55

Рис. 9.55

Для построения нейросетевой модели объекта управления следует выбрать кнопку Generate Training Data и далее следовать рассмотренной ранее процедуре идентификации. ПараметруTrainingEpochsцелесообразно установить значение, равное 50, чтобы сократить время вычислений. Если результаты идентификации вас удовлетворяют, то следует подтвердить это нажатием кнопкиAccept Data в окнеPlant Input-Output Data, в противном случае выбрать кнопкуReject Dataи затем сформировать новые данные. После этого вы вновь возвращаетесь в окноModel Reference Control (рис. 9.54).

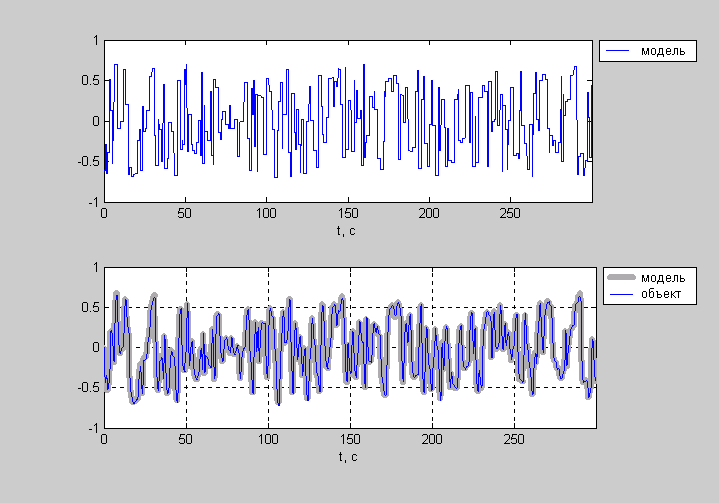

Теперь для обучения регулятора следует выбрать кнопку Generate Training Data, чтобы сгенерировать обучающие данные. Эти данные в виде графиков появятся в окне Input-Output Data for NN Model Reference Control, и вам вновь необходимо подтвердить или отвергнуть эти данные. Если данные приемлемы, то в окне Model Reference Control следует выбрать кнопку Train Controller (Обучить регулятор). После того как обучение окончено, графики выходов эталонной модели и объекта управления выводятся на экран (рис. 9.56). Обучение регулятора занимает весьма значительное время, поскольку обучение использует динамический вариант метода обратного распространения ошибки [16].

Рис. 9.56

Рис. 9.56

Если точность слежения за эталонной моделью неудовлетворительна, то можно продолжить обучение регулятора с тем же набором данных, снова воспользовавшись кнопкой Train Controller. Если для продолжения обучения необходимо использовать новый набор данных, следует воспользоваться кнопкамиGenerate DataилиImport Data, причем, если вы хотите продолжить обучение с выбранными весами, следует сделать отметку в окне контроляUse Current Weights.

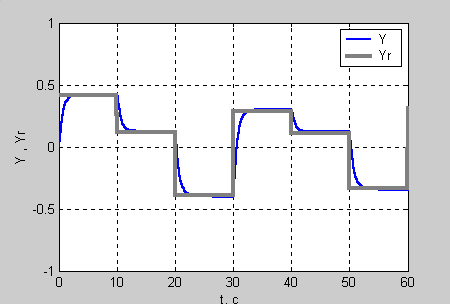

По окончании обучения регулятора нажать на клавишу OK, вернуться к модели Simulink (см. рис. 9.49) и начать моделирование, выбрав опциюStart из меню Simulation. Графики эталонного сигнала и выхода объекта управления показаны на рис. 9.57.

Рис. 9.57

Рис. 9.57

Из анализа полученных данных следует, что реакция системы на ступенчатые воздействия со случайной амплитудой носит монотонный характер и отрабатывается в пределах 3 с. Это свидетельствует о хорошем качестве регулятора ModelReferenceControllerдля управления звеном робота-манипулятора.