- •Тема 1. Основные понятия теории случайных процессов 68

- •Понятие подмножества. Свойства подмножеств.

- •Операции над множествами.

- •Дистрибутивные законы.

- •Законы Моргана.

- •Конечные множества и их элементы.

- •Понятие алгебры множеств σ – алгебры.

- •Борелевские множества. Борелевскаяσ– алгебра.

- •Выбор с возвращением.

- •Выборка без возвращения.

- •Размещения с повторениями.

- •Теория вероятностей. События и их классификация.

- •Операции над событиями.

- •Понятие вероятности.

- •Вечерняя электричка.

- •Геометрический подход.

- •Задача Бюффона.

- •Аксиоматический подход к вероятности. Вероятностное пространство. Аксиомы вероятности Колмогорова.

- •Вероятности, вытекающие из аксиом.

- •Задача о совпадениях.

- •Условная вероятность. Правило умножения вероятностей.

- •Независимость событий.

- •Задача о наилучшем выборе.

- •Расчет работоспособности цепей

- •Формула полной вероятности.

- •Задача о разорении игрока.

- •Формула вероятностей гипотез. (Формула Байеса)

- •Случайные величины.

- •Дискретные случайные величины.

- •Свойства функции распределения.

- •Биноминальное распределение (Независимые испытания по схеме Бернулли).

- •Асимптотическое представление формулы Бернулли.

- •Теорема (формула) Пуассона.

- •Локальная теорема Муавра-Лапласа.

- •Интегральная теорема Муавра-Лапласа.

- •Независимые случайные величины

- •Операции над случайными величинами:

- •Математическое ожидание

- •Свойства математического ожидания

- •Функции случайного аргумента и их мат. Ожидание.

- •Дисперсия

- •Свойства дисперсии

- •Свойства условных вероятностей и плотностей вероятностей

- •Условное математическое ожидание

- •Корреляционный момент (корреляция) двух случайных величин

- •Свойства корреляционного момента

- •Коэффициент корреляции и его свойства

- •Свойства

- •Уравнения Регрессии

- •Характеристики

- •Неравенство Чебышева

- •Нормальное распределение с параметрами (а;σ)

- •Основные свойства кривой Гаусса

- •Расчет доверительных интервалов

- •Некоторые важнейшие распределения связанные с нормальным. - распределение.

- •Распределение Стьюдента (t– распределение)

- •Распределение Фишера-Снедекора (f– распределение).

- •Закон больших чисел.

- •Теорема Чебышева.

- •Теорема Бернулли.

- •1. Биноминальное распределение.

- •2. Распределение Пуассона.

- •3. Геометрическое распределение.

- •Введение в теорию случайных процессов тема 1. Основные понятия теории случайных процессов

- •1.1. Определение случайного процесса. Основные подходы к заданию случайных процессов. Понятие реализации и сечения. Элементарные случайные процессы.

- •1.2. Некоторые классы и виды случайных процессов

- •2.2. Математическое ожидание и дисперсия случайного процесса. Среднеквадратическое отклонение

- •2.3. Корреляционная функция случайного процесса и ее свойства. Нормированная корреляционная функция

- •2.4. Взаимная корреляционная функция и нормированная взаимная корреляционная функция двух случайных процессов

- •2.5 Вероятностные характеристики суммы двух случайных величин

- •Тема 3. Элементы случайного анализа

- •3.1. Сходимость и непрерывность

- •1. Классические виды сходимости

- •2. Сходимость по вероятности

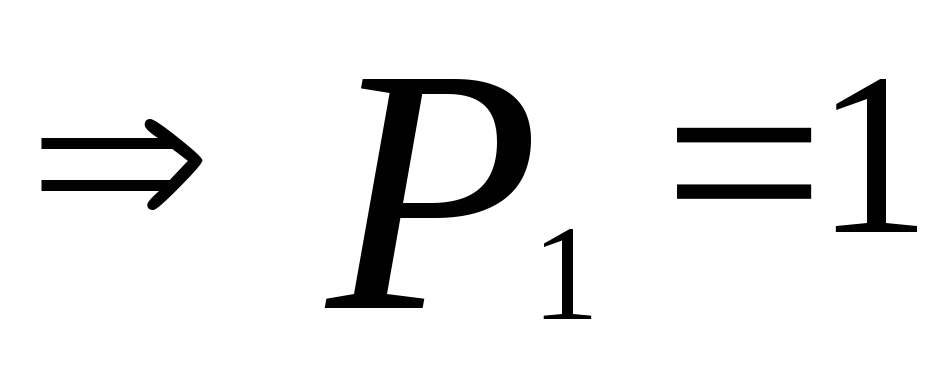

- •3. Сходимость в среднем в степени p1

- •3.3. Интеграл от случайного процесса и его свойства

- •ТеМа 4. Канонические разложения случайных процессов

- •4.1. Понятие канонического разложения случайного процесса

- •4.2. Понятие обобщенной функции. Дельта-функция Дирака. Интегральное каноническое представление случайных процессов.

- •4.3. Линейные и нелинейные преобразования случайных процессов

- •Глава 5. Стационарные cлучайные процессы

- •5.1. Понятие стационарного случайного процесса. Стационарность в узком и широком смыслах

- •5.2 Свойства вероятностных характеристик стационарного случайного процесса

- •5.3. Стационарно связанные случайные процессы. Производная и интеграл от стационарного случайного процесса

- •5.4. Эргодические стационарные случайные процессы и их характеристики

- •Эргодическая теорема Биркгофа-Хинчина

- •Для ссп с непрерывным временем, для ссп с дискретным временем.

- •Достаточные условия эргодичности

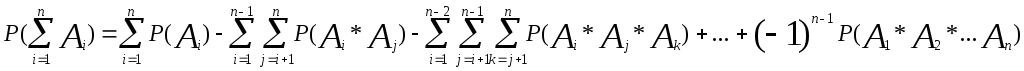

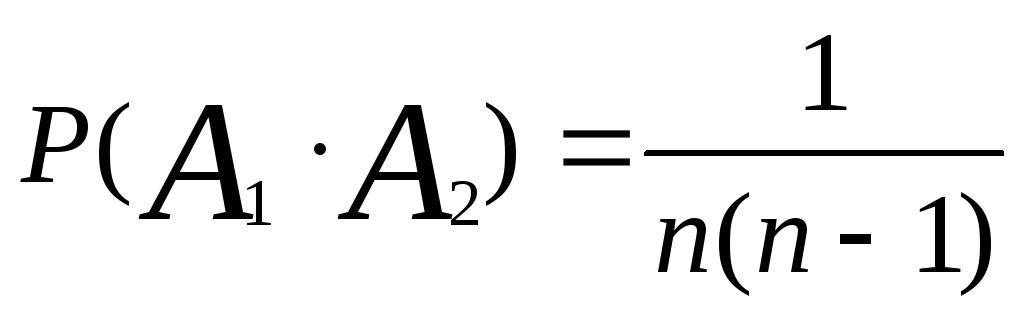

Задача о совпадениях.

Идёт экзамен по теории вероятности. Все студенты складывают свои зачетки на стол. Преподаватель наугад берет зачетку и выставляет оценку и вручает студенту. Какова вероятность, что хотя бы один студент получит свою зачетку.

![]() события попарно не совместны

события попарно не совместны

![]() i–й студент получил свою

зачетку.

i–й студент получил свою

зачетку.

![]() -

?

-

?

=

=![]()

Р(

)

=

)

= = Р(

= Р( )

=

)

=

![]()

3)

![]()

![]()

4)

![]()

![]()

При

![]()

![]()

![]()

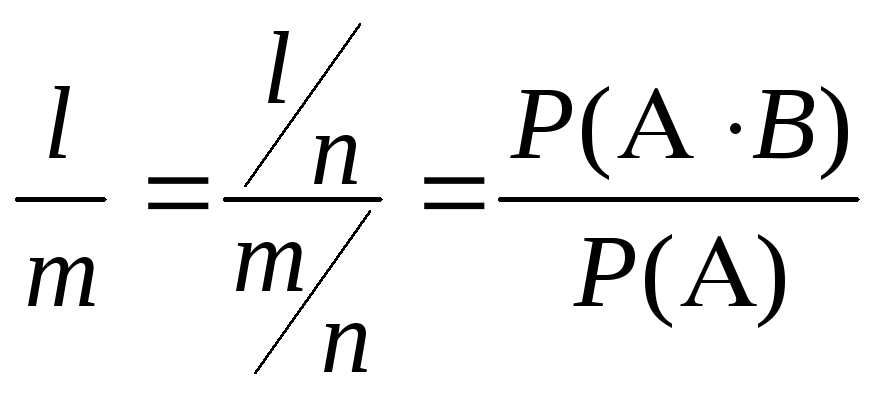

Условная вероятность. Правило умножения вероятностей.

Опр. 1: Условной вероятностью события А при условии В называется вероятность события А в предположении, что событие В состоялось.

Р(А|В);

![]() вероятность события А при условии В.

вероятность события А при условии В.

Опр. 2: Условной вероятностью события А при условии В называется отношение вероятности произведений этих событий к вероятности события В.

(если эта вероятность не равна 0)

![]()

![]()

Р(А∙В) = Р(А|B) ∙P(B) =P(B|A) ∙P(A) правило умножения вероятностей

Следствие:![]()

Замечание № 1:в рамках классического подхода условная вероятность выводится

Ω B

k l

n

P(B|A) =

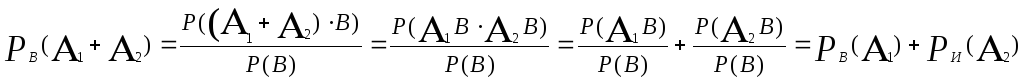

Замечание № 2:Условное вероятность

определяет новое вероятностное

пространство (Ω,

А,![]() )

)

Все свойства вероятности сохраняются

1)![]()

2)

![]()

3)

Если

![]() то

то

![]()

4)

![]()

![]()

Независимость событий.

Опр. 1: Два события называются независимыми если информация о том произошло или нет одно из них не влияет на вероятность другого.

Р(А)=

![]()

Р(В) =

![]()

Опр. 2: Несколько событий называются попарно независимыми, если каждые два из них независимы.

Опр.3:Несколько событий называются независимыми в совокупности, если они попарно независимы и каждое событие не зависит от всевозможных произведений остальных событий.

Пример:А,В,С – попарно независимы. Тогда независимы А и В, В и С,А и С. Если в совокупности, то А и В,В и С,А и С,А и ВС,В и АС,С и АВ.

Теорема 1:Если событие А и В независимы, то вероятность Р(АВ)=Р(А)∙Р(В)

Теорема 2:Если события![]() ,

независимы в совокупности, то Р(

,

независимы в совокупности, то Р(![]() )

=

)

=![]()

Пример 1:Есть 4 числа: 2,3,5,30

![]() - вытащенное число делится на 2,3,5

- вытащенное число делится на 2,3,5

![]()

1)Р(

1)Р(![]() )=Р(

)=Р(![]() )=Р(

)=Р(![]() )=

)=![]()

![]()

![]() попарно независимы

попарно независимы![]()

2)Р(![]() )=

)=![]() =

=![]()

3)![]() в совокупности зависимы

в совокупности зависимы

Пример 2:

2 6 8 6 8 1

![]()

![]()

![]()

![]()

![]()

В В![]()

![]()

А А![]()

24 24

Р(А) =![]() Р(А) =

Р(А) =![]()

Р(В)=![]() Р(В)=

Р(В)=![]()

Р(АВ)=![]() Р(АВ)=

Р(АВ)=![]()

Р(АВ)=Р(А)∙Р(В) Р(АВ)≠Р(А)∙Р(В)

Это означает, что А и В независимы Это означает, что А и В зависимы

P(A)=P(A|B) P(A)≠P(A|B)

Пример 3: 1)Имеется колода карт из 36 карт

А – вытянули пику

В – вытянули даму

Р (А)

(А)![]() Р(АВ)

= Р(А)∙Р(В) события независимы

Р(АВ)

= Р(А)∙Р(В) события независимы

Р (В)

(В)![]()

Р(АВ)![]()

2)В колоду добавили джокера

Р (А)

(А)![]() Р(АВ)

≠ Р(А)∙Р(В) события зависимы

Р(АВ)

≠ Р(А)∙Р(В) события зависимы

Р (В)

(В)![]()

Р(АВ)![]()

Замечание:при установлении независимости А и В часто используют следующий принцип: события А и В, реальные прообразы которых причинно независимы считаются независимыми и в теоретико-вероятностном смысле.

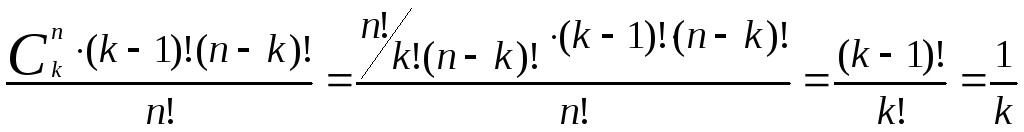

Задача о наилучшем выборе.

Имеется nпредметов разного качества. Задача заключается в том чтобы выбрать предмет наилучшего качества. Случайным образом извлекают первый предмет. На этом опыт может закончится. Если эксперимент продолжается, то остановится можно лишь в тот момент, когда вытащенный предмет лучше всех предыдущих, предположим, что предмет, извлечённый на шаге к лучше всех предыдущих. Какова вероятность, что он при этом окажется абсолютно лучшим.

А – предмет, вытащенный на шаге к наилучший

В – предмет, вытащенный на шаге к- лучший среди вытащенных

P(A|B) - ?

P(A|B)

=

![]() т.к А подмножество В

т.к А подмножество В

Р(А)=

Р(В)=

Р(А|B)=