- •Лекция 15.09 Классификация форм qrs-комплексов циклов экг

- •Алгоритм динамической кластеризации

- •Идентификация кластеров

- •Лекция 22.09 Мониторный контроль сердечной деятельности по экг

- •Предварительная фильтрация

- •Анализ уровня помех

- •Обнаружение qrs-комплекса

- •Экг при искусственной кардиостимуляции сердца

- •Вейвлеты 2 часть

- •Анализ ишемических изменений экг (st-сегмент)

- •Велоэргометрия

- •Беговая дорожка

- •Синхронное усреднение сигналов

- •Анализ экг высокого разрешения

- •Анализ вариабельности сердечного ритма

- •Параметры искусственной вентиляции легких

- •Лекция 24 ноября

- •Классификация ээг.

- •Анализ ээг (часть 3). Анализ глубины наркоза.

- •Алгоритм обучения однослойного персептрона с n входами и m нейронами:

- •Структура процесса обучения

Алгоритм обучения однослойного персептрона с n входами и m нейронами:

1) Инициализация весов и порогов небольшими случайными значениями.

2)

Подача на вход вектора

![]() и оценка выходов нейронов

и оценка выходов нейронов

3) Обновление весов в соответствии с формулой:

![]() ,

где i =1,2,..., m

– номер нейрона, di

–

желаемый выход i –го нейрона, t – номер

итерации, и η , (0< η <1) – вес шага

адаптации (обучения), y

i –

выход i –го нейрона

,

где i =1,2,..., m

– номер нейрона, di

–

желаемый выход i –го нейрона, t – номер

итерации, и η , (0< η <1) – вес шага

адаптации (обучения), y

i –

выход i –го нейрона

4) Если разность «d − yi » больше заданного порога и не превышено допустимое число итераций, переход к шагу 2, в противном случае – окончание обучения

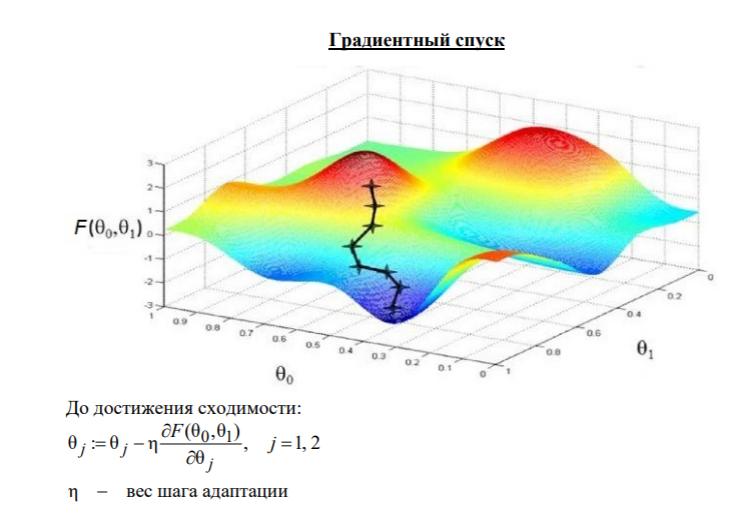

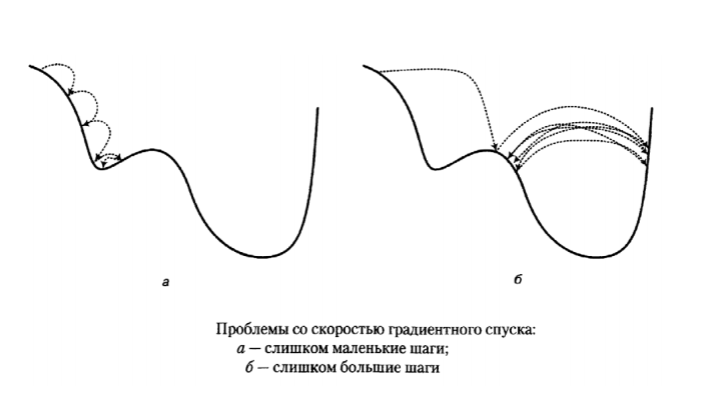

Принцип градиентного спуска.

Алгоритм обратного распространения ошибки.

1)

Инициализация весов и порогов небольшими

случайными значениями 2) Случайный выбор

входного образца

![]()

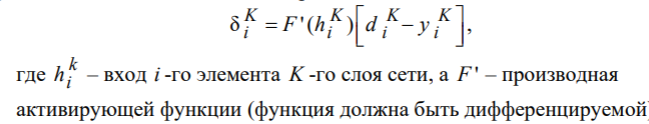

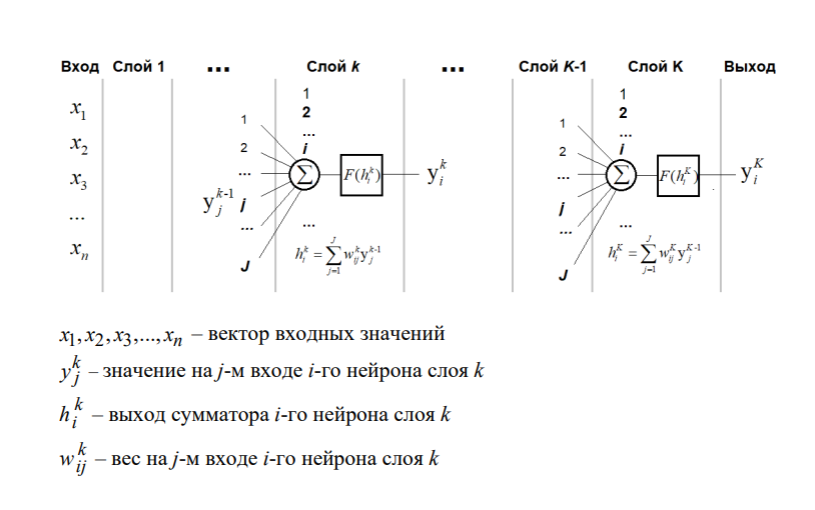

3) Расчёт прохождения сигнала через сеть

4) Расчёт для выходного слоя K разности:

5) Вычисление разности для предыдущего слоя путём распространения ошибки в обратном направлении:

![]()

6) Обновление весов с использованием:

![]()

7) Переход к шагу 2 и повторение для следующих образцов, пока ошибка в выходном слое не станет ниже заданного порога или пока не будет достигнуто максимальное допустимое число итераций.

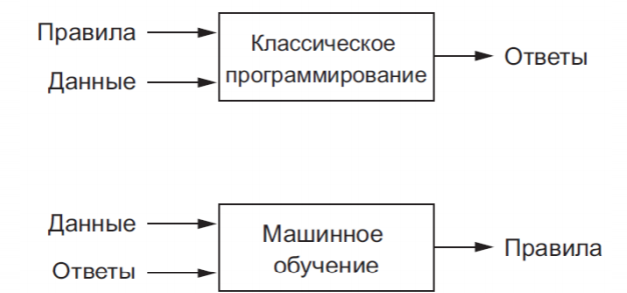

Глубокое обучение и его отличие от традиционных подходов.

Составляющие машинного обучения.

Обучающие входные данные. Образцы подлежащих распознаванию объектов

Примеры ожидаемых результатов. Формируются в результате разметки (верификации) образцов

Способ оценки качества работы алгоритма. Показатели, определяющие, насколько далеко отклоняются результаты, возвращаемые алгоритмом, от ожидаемых. Оценка используется как сигнал обратной связи для корректировки работы алгоритма. Этот этап корректировки и называется обучением

Глубокое обучение — это особый раздел машинного обучения: новый подход к поиску представления данных, делающий упор на изучение последовательных слоев (или уровней) все более значимых представлений.

Под глубиной в глубоком обучении не подразумевается более глубокое понимание, достигаемое этим подходом; идея заключается в многослойном представлении.

Количество слоев, на которые делится модель данных, называют глубиной модели. Другими подходящими названиями для этой области машинного обучения могли бы служить: многослойное обучение и иерархическое обучение.

Архитектуры глубоких ИНС и адекватные им задачи.

Векторные данные —полносвязные сети (слои Dense).

Изображения —двумерные сверточные сети.

Звуки (например, сигналы волновой формы) —одномерные сверточные сети (предпочтительно) или рекуррентные сети.

Текстовые данные —одномерные сверточные сети (предпочтительно) или рекуррентные сети.

Временные последовательности —рекуррентные сети (предпочтительно) или одномерные сверточные сети.

Другие виды последовательных данных —рекуррентные сети или одномерные сверточные сети.

Рекуррентные сети предпочтительнее, если упорядоченность данных имеет большое значение

(например, для временных последовательностей, но не для текста).

Видеоданные —трехмерные сверточные сети (если необходимо захватывать эффекты движения) или комбинация двумерной сверточной сети, действующей на уровне кадров для извлечения признаков, с последующей обработкой рекуррентной сетью или одномерной сверточной сетью для обработки получающихся последовательностей.

Объемные данные —трехмерные сверточные сети.

Слои, параметризуемые весами и объединяемые в сеть (модель)

Исходные данные и соответствующие им цели

Функция потерь, которая определяет сигнал обратной связи, используемый для обучения

Оптимизатор, определяющий, как происходит обучение