- •Лекция 3. Биологический нейрон и его кибернетическая модель.

- •Метод нейробиологии.

- •Биологический нейрон.

- •Нейронные сети.

- •Биологическая изменчивость и обучение нейронных сетей.

- •Формальный нейрон.

- •Обучение нейрона детектированию границы "черное-белое"

- •Лекция 4. Персептрон Розенблатта.

- •Персептрон Розенблатта.

- •Теорема об обучении персептрона.

- •Линейная разделимость и персептронная представляемость

- •Лекция 5. Свойства процессов обучения в нейронных сетях.

- •Задача обучения нейронной сети на примерах.

- •Классификация и категоризация.

- •Обучение нейронной сети с учителем, как задача многофакторной оптимизации. Понятие о задаче оптимизации.

- •Постановка задачи оптимизации при обучении нейронной сети

- •Лекция 6. Многослойный персептрон.

- •Необходимость иерархической организации нейросетевых архитектур.

- •Многослойный персептрон.

- •Обучение методом обратного распространения ошибок.

- •Лекция 7. Другие иерархические архитектуры.

- •Звезды Гроссберга

- •Принцип Winner Take All (wta) - Победитель Забирает Все - в модели Липпмана-Хемминга.

- •Карта самоорганизации Кохонена.

- •Нейронная сеть встречного распространения.

- •Лекция 8. Модель Хопфилда.

- •Сети с обратными связями

- •Нейродинамика в модели Хопфилда

- •Правило обучения Хебба

- •Ассоциативность памяти и задача распознавания образов

- •Лекция 9. Обобщения и применения модели Хопфилда.

- •Модификации правила Хебба.

- •Матрица Хебба с ортогонализацией образов.

- •Отказ от симметрии синапсов.

- •Алгоритмы разобучения (забывания).

- •Двунаправленная ассоциативная память.

- •Детерминированная и вероятностная нейродинамика.

- •Применения сети Хопфилда к задачам комбинаторной оптимизации.

- •Лекция 10. Неокогнитрон Фукушимы.

- •Когнитрон: самоорганизующаяся многослойная нейросеть.

- •Неокогнитрон и инвариантное распознавание образов.

- •Лекция 11. Теория адаптивного резонанса.

- •Дилемма стабильности-пластичности восприятия.

- •Принцип адаптивного резонанса.

- •Нейронная сеть aрt-1.

- •Начальное состояние сети.

- •Фаза сравнения.

- •Фаза поиска.

- •Обучение сети арт.

- •Теоремы арт.

- •Дальнейшее развитие арт: архитектуры арт-2 и арт-3. Нерешенные проблемы и недостатки арт-1.

- •Сети арт-2 и арт-3.

- •Лекция 12. Черты современных архитектур.

- •Черты современных архитектур.

- •Сегодняшний день нейронауки.

- •Программное и аппаратное обеспечение. Нейро-эвм.

Неокогнитрон и инвариантное распознавание образов.

Новая работа Фукушимы была опубликована в 1980 г. НЕОКОГНИТРОН хотя и имеет много общих черт с его прародителем КОГНИТРОНОМ, но одновременно он претерпел значительные изменения и усложнения, в соответствии с появлением новых нейробиологических данных (Hubel D.H., Wiesel T.N., 1977, и др.).

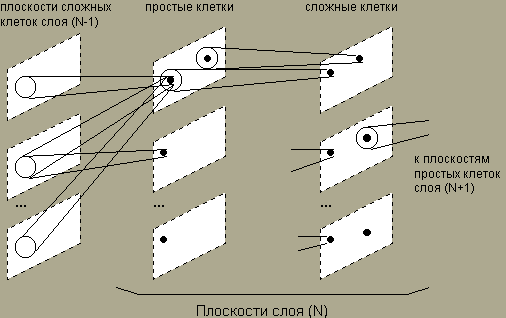

НЕОКОГНИТРОН состоит из иерархии нейронных слоев, каждый из которых состоит из массива плоскостей. Каждый элемент массива состоит из пары плоскостей нейронов. Первая плоскость состоит из так называемых простыхнейроклеток, которые получают сигналы от предыдущего слоя и выделяют определенные образы. Эти образы далее обрабатываютсясложныминейронами второй плоскости, задачей которых является сделать выделенные образы менее зависимыми от их положения.

Нейроны каждой пары плоскостей обучаются реагировать на определенный образ, представленный в определенной ориентации. Для другого образа или для нового угла поворота образа требуется новая пара плоскостей. Таким образом, при больших об'емах информации, НЕОКОГНИТРОН представляет собой огромную структуру с большим числом плоскостей и слоев нейронов.

Простые нейроны чувствительны к небольшой области входного образа, называемой рецептивнойобластью (или что тоже самое, областью связей). Простой нейрон приходит в возбужденное состояние, если в его рецептивной области возникает определенный образ. Рецептивные области простых клеток перекрываются и покрывают все изображение. Сложные нейроны получают сигналы от простых клеток, при этом для возбуждения сложного нейрона достаточно одного сигнала от любого простого нейрона. Тем самым, сложная клетка регистрирует определенный образ независимо от того, какой из простых нейронов выполнил детектирование, и, значит, независимо от его расположения.

По мере распространения информации от слоя слою картинка нейронной активности становится все менее чувствительной к ориентации и распололожению образа, и, в определенных пределах, к его размеру. Нейроны выходного слоя выполняют окончательное инвариантное распознавание.

Рис. 10.3. Общая схема НЕОКОГНИТРОНА. Области связей показаны большими белыми кружками, а области конкуренции - маленькими темными.

Обучение НЕОКОГНИТРОНА аналогично уже рассмотренному обучению КОГНИТРОНА. При изменяются только синаптические веса простых клеток. Тормозящие нейроны вместо средней активности нейронов в области связей используют квадратный корень из взвешенной суммы квадратов входов:

![]()

Такая формула для активности тормозящей клетки менее чувствительна к размеру образа. После выбора простого нейрона, веса которого будут обучаться, он рассматривается в качестве представителя слоя, и веса всех остальных нейронов будут обучаться по тем же правилам. Таким образом, все простые клетки обучаются одинаково, выдавая при распознавании одинаковую реакцию на одинаковые образы.

Для уменьшения об'ема обрабатываемой информации решептивные поля нейронов при переходе со слоя на слой расширяются, а число нейронов уменьшается. В выходном слое на каждой плоскости остается только один нейрон, рецептивное поле которого покрывает все поле образа предыдущего слоя. В целом функционирование НЕОКОГНИТРОНА происходит следующим образом. Копии входного изображения поступают на все плоскости простых клеток первого слоя. Далее все плоскости функционируют параллельно, передавая информацию следующему слою. По достижении выходного слоя, в котором каждая плоскость содержит один нейрон, возникает некоторое окончательное распределение активности. На результат распознавания указывает тот нейрон, активность которого оказалась максимальной. При этом существенно разным входным изображениям будут соответствовать разные результаты распознавания.

НЕОКОГНИТРОН успешно проявил себя при распознавании символов. Нужно отметить, что структура этой сети необычайно сложна, и об'ем вычислений очень велик, поэтому компьютерные модели НЕОКОГНИТРОНА будут слишком дорогими для промышленных приложений. Возможной альтернативой является, конечно, переход на аппаратные или оптические реализации, однако их рассмотрение находится за рамками этой книги.