- •Введение.

- •История развития, исследования в области ии.

- •Математические основы нл.

- •Выбор функции принадлежности:

- •Нечеткие алгоритмы.

- •Методы нечеткого логического вывода.

- •Методы дефаззификации

- •Методология проектирования экспертных систем.

- •Обобщенная структура основных этапов разработки прототипов эс.

- •Некоторые сведения о мозге.

- •Модель искусственного нейрона.

- •Определение искусственной нейронной сети.

- •Модели нс.

- •Понятие обучения.

- •Процедура обучения.

- •Классификация нейронных сетей

- •Типовые структуры и решаемые задачи

- •Сети Кохонэна Обучение «без учителя»

- •4.1. Традиционный способ

- •4.2. Метод выпуклой комбинации

- •4.3. Модифицированные алгоритмы

- •Основные этапы нейросетевого анализа

- •Генетические алгоритмы

- •Гибридные интеллектуальные системы

Классификация нейронных сетей

Классы нейронных сетей называются нейропарадигмами(НП).

Каждая НП характеризуется:

Составляющими их нейронами

количество входов

функция активации

Типов графа межнейронных связей

прямые

перекрестные

обратные

Способом формирования весов связей, т.е. алгоритмом обучения

С учителем

Без учителя

Смешанный

Пример: Эффективность решения задач с применением с применением нейронных сетей зависит от правильности выбора нейропарадигмы, а также имеющихся в базе данных примеров для обучения.

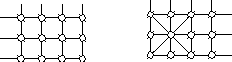

Нейронные сети классифицируются следующим образом:

I. С точки зрения топологии

П

олносвязные

олносвязные

Классический пример- сеть Хопфильда

Многослойные

а) полносвяные

б) частично полносвязные

2. С обратными связями( рекурентные)

Пример: сеть Элмана

Сеть Жордана(обратные связи через слой)

3. Слабосвязные

Пример: сеть Кохонена – самоорганизующиеся карты

II. По типам структур нейронов:

1. Гомогенные

Функции активации всех нейронов одинаковые

2. Гетерогенные

Функции активации всех нейронов разные

III. По видам сигналов, которыми оперируют нейронные сети

Бинарные(от 0 до 1)

Сигналовые- оперируют действительными числами.

IV. По методу обучения

Обучение с учителем

Обучение без учителя

Смешанные

Существуют уже заранее известные структуры нейросетей, которые более эффективно решают определенные типы задач.

Типовые структуры и решаемые задачи

|

Тип обучения Тип связей |

Обучение «с учителем» |

Обучение «без учителя» |

|

Без обратной связи |

Многослойные Персептрон(классификация, аппроксимация) |

Карты Кохонэна, соревновательные сети(кластеризация) (сжатие данных) |

|

С обратной связью |

Рекуррентные аппроксиматоры(предсказание временных рядов) |

Сети Хольфильда(кластеризация, оптимизация, ассоциативная память) |

Лекция 8.

Сети Кохонэна Обучение «без учителя»

Сети Кохонэна предназначены для решения задач кластеризации.

Постановка задачи кластеризации

Дано:

![]()

где n- номер объекта

m- номер признака

Каждый объект характеризуется вектором:

![]()

Найти: ядра кластеров количества K

C=![]()

![]()

Т.е построить некую функцию L(p), которая позволяет определить номер кластера по номеру объекта. Причем, построение должно вестись на основе следующего критерия: минимизация всех внутриклассовых расстояний.

![]() (1)

(1)

Где первая сумма- это сумма по всем объектам, а вторая- по всем кластерам.

Алгоритм кластеризации:

1. Задается количество кластеров и начальные значения ядер кластеров.

![]()

Способы начального задания значений:

случайными числами

одинаковыми числами

по некоторым эвристическим правилам, которые основаны на предварительном анализе данных(на основе главных компонент)

2. Фиксируются постоянно ядра кластеров

![]()

Ищется разбиение l(p) объектов на кластеры, исходя из критерия (1).

3. Фиксируются постоянно разбиения

l(p)= const

![]()

Корректируются ядра кластеров

![]() ,

таким образом, что:

,

таким образом, что:

![]() (2)

(2)

Результатом выполнения является новый набор ядер.

Шаги 2,3 повторяются до тех пор, пока (1) перестанет изменятся, то есть, стабилизируется.

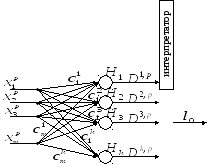

Преобразование этого алгоритма для реализации его в нейросетевом базисе:

Определим количество входов и выходов в нейросети

Количество входов = количеству признаков одного объекта;

Входным вектором

будет являться

![]() ;

;

Количество выходов это количество кластеров (К);

Преобразуем основной критерий (1):

![]()

С учетом знака “-” критерий D будет максимизироваться:

![]() (3)

(3)

Псевдокод алгоритма:

Цикл 1: для p=1,n

Цикл 2: для l=1,k

![]()

конец l

Находим

![]() :max

:max

![]()

Структура нейросети для реализации алгоритма

Сеть однослойная(слой Кохонэна). Каждый нейрон слоя Кохонэна с помощью своих весовых коэффициентов запоминает координаты ядра кластера и отвечает за отнесение объектов к этому кластеру.

Интерпретатор- выбирает максимальное значение среди всех выходов и выдает номер этого выхода, который является номером кластера.

Сеть Кохонэна может работать в двух режимах:

соответствует выдаче номера кластера

производится нормировка всех выходов и тогда выходы

рассматриваются как вероятности принадлежности объекта к тому или иному кластеру.

В псевдокоде самый внутренний цикл: (цикл по i)- это один нейрон в

слое Кохонэна. Цикл по l- весь слой Кохонэна, цикл по p в структуре нейросети не реализуется, а реализуется в процессе обучения.

Обучение сети Кохонэна

Шаг 1:

инициализация весов(т.е. присваиваем

начальные значения всем

![]() в сети).

в сети).

Шаг 2: подаем на вход вектор из обучающей выборки.

Шаг 3:

![]() ,

находится

,

находится![]() и

максимальный

и

максимальный![]() ,

т.е. максимальный номер “победившего

нейрона”.

,

т.е. максимальный номер “победившего

нейрона”.

Шаг 4: корректировка весов сети Кохонэна