- •Введение.

- •История развития, исследования в области ии.

- •Математические основы нл.

- •Выбор функции принадлежности:

- •Нечеткие алгоритмы.

- •Методы нечеткого логического вывода.

- •Методы дефаззификации

- •Методология проектирования экспертных систем.

- •Обобщенная структура основных этапов разработки прототипов эс.

- •Некоторые сведения о мозге.

- •Модель искусственного нейрона.

- •Определение искусственной нейронной сети.

- •Модели нс.

- •Понятие обучения.

- •Процедура обучения.

- •Классификация нейронных сетей

- •Типовые структуры и решаемые задачи

- •Сети Кохонэна Обучение «без учителя»

- •4.1. Традиционный способ

- •4.2. Метод выпуклой комбинации

- •4.3. Модифицированные алгоритмы

- •Основные этапы нейросетевого анализа

- •Генетические алгоритмы

- •Гибридные интеллектуальные системы

Гибридные интеллектуальные системы

ЭС

Вероятностные вычисления(сети Баейса)

НЛ

НС

Объединение ГА и НС

COGANN(Combination of G.A. and N.N.)

Виды объединений:

Независимое

НС и ГА применяются ля решения одной и той же задачи классификации.

(многослойный персептрон, МП, SOM, ГА, KNN)

k- means nearest neighbour

Вспомогательное

О ба

метода применяются последовательно,

причем первый метод применяется для

подготовки данных, которые затем

используются во втором методе.

ба

метода применяются последовательно,

причем первый метод применяется для

подготовки данных, которые затем

используются во втором методе.

а) НС->ГА

НС используется для формирования исходной популяции

б) ГА->НС

ГА используется для инициализации весов и выбора скорости обучения

Равноправное

Один метод используется для реализации какого-либо другого метода

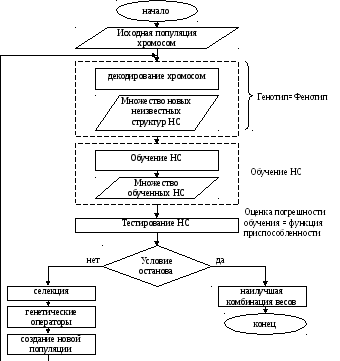

а) Применение ГА для обучения НС

Задача оптимизации,

где

![]() решается

путем применения ГА:

решается

путем применения ГА:

Достоинства:

Позволяет избежать “ловушек”

может применятся для функций, для которых градиент найти либо невозможно, либо сложно

б) ГА используется для выбора топологии(архитектуры сети)

В этом случае в качестве хромосомы выступает код архитектуры сети

Существует 2 способа кодирования:

Непосредственное.

Составляется матрица связей, на основании нее строится хромосома.

Недостаток: увеличение длины хромосомы при увеличении количества нейронов.

Косвенное

Кодируются важнейшие параметры архитектуры сети: количество нейронов и связи

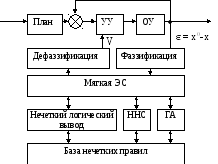

НЭС с НС и ГА

Применяются для настройки параметров функции принадлежности, для извлечения правил.

ННС- нечеткие нейронные сети

Этот вид сетей предназначен для реализации нечетких правил на базе НС. Такой подход позволяет компенсировать один из главных недостатков НС, который состоит в том, что ответ НС является непрозрачным, сама НС- черный ящик: объяснить ответ невозможно.

Этот подход позволяет реализовать функцию объяснения для НС.

Идея:

Е сли

сли![]() и

и![]() ,

то

,

то![]()

Либо деление

интервала на подинтервал, либо

![]() -срез

-срез

ННС- это четкая НС прямого распространения сигнала, которая построена с использованием И, ИЛИ нейронов.

И нейрон:

![]()

ИЛИ нейрон:

![]()

Назначение ННС: извлечение знаний

Мягкая ЭС- это ЭС, которая обладает особенностями:

Используются статические данные, которые интерпретируются, как обучающие выборки для ННС

В этой ЭС знания представлены в виде:

Лингвистической переменной

Нечеткой продукции обученных НС

с) решается задача редукции, то есть оптимизация множества извлеченных правил с помощью ГА

МЭС = НЭС + ННС + ГА