- •1. Информатика.

- •. Структура информатики

- •2. Информация. Передача информации. Информационные каналы.

- •3. Классификация информации. Методы получения информации. Свойства информации.

- •По способу восприятия

- •По форме представления

- •По предназначению

- •Свойства информации

- •4. Измерение информации. Меры информации. Подходы к определению количества информации.

- •5. Системы счисления. Перевод целых числе из десятичной системы в двоичную и обратно.

- •Существуют позиционные и непозиционные системы счисления.

- •Системы счисления, используемые при работе с эвм Двоичная система счисления

- •6. Арифметические операции в позиционных системах счисления.

- •История возникновения пк. Поколения компьютеров. Архитектура фон Неймана.

- •8. Аппаратное обеспечение пк

- •12. Память компьютера, озу, пзу, сменные носители.

- •13. Устройства для постоянного хранения и переноса информации

- •9. Процессор. Материнская плата. Жесткий диск

- •Состав материнской платы

- •Устройства ввода-вывода

- •Матричные (игольчатые) принтеры

- •Струйные принтеры (Ink Jet)

- •Лазерные принтеры

- •14. Программное обеспечение пк. Назначение. Типы

- •15. Системное программное обеспечение. Операционные системы.

- •Сервисное программное обеспечение

- •18. Файловая система пк.

- •19. Компьютерная графика. Растровая графика. Векторная графика.

- •16. Вредоносные программы. Классификация

- •21. Безопасность информации.

- •Основные понятия

- •Классификация угроз информационной безопасности

- •22. Правовые основы информационной безопасности. Шифрование. Эцп

- •Глава 28. «Преступления в сфере компьютерной информации» содержит три статьи:

- •20. Алгоритмизация и программирование

- •Базовые алгоритмические структуры (типы алгоритмов)

- •Чем отличается программный способ записи алгоритмов от других

- •23. Компьютерные сети. Топология сетей

- •Основные понятия

- •Аппаратные средства

- •Топология локальных сетей

- •Аппаратные средства

- •Беспроводные сети.

- •26. Эталонная модель osi

- •Физический уровень

- •Канальный уровень

- •Сетевой уровень

- •Транспортный уровень

- •Сеансовый уровень

- •Прикладной уровень

- •Краткие итоги

- •25. Стек протоколов tsp/ip

- •21. Понятие ip-адреса. Классы сетей. Адресация компьютеров

- •Три схемы адресации узлов.

- •Сетевая маска

- •27. Internet. Сервисы Internet.

- •Пространство доменных имен

- •Сервисы Интернет

4. Измерение информации. Меры информации. Подходы к определению количества информации.

Люди обмениваются информацией в форме сообщений. Сообщение — это форма представления информации в виде речи, текстов, жестов, взглядов, изображений, цифровых данных, графиков, таблиц и т.п.

Одно и то же информационное сообщение (статья в газете, объявление, письмо, телеграмма, справка, рассказ, чертёж, радиопередача и т.п.) может содержать разное количество информации для разных людей — в зависимости от их предшествующих знаний, от уровня понимания этого сообщения и интереса к нему.

В информатике используются различные подходы к измерению информации:

Содержательный подход к измерению информации. Сообщение – информативный поток, который в процессе передачи информации поступает к приемнику. Сообщение несет информацию для человека, если содержащиеся в нем сведения являются для него новыми и понятными Информация - знания человека ? сообщение должно быть информативно. Если сообщение не информативно, то количество информации с точки зрения человека = 0. (Пример: вузовский учебник по высшей математике содержит знания, но они не доступны 1-класснику)

Алфавитный подход к измерению информации не связывает кол-во информации с содержанием сообщения. Алфавитный подход - объективный подход к измерению информации. Он удобен при использовании технических средств работы с информацией, т.к. не зависит от содержания сообщения. Кол-во информации зависит от объема текста и мощности алфавита. Ограничений на max мощность алфавита нет, но есть достаточный алфавит мощностью 256 символов. Этот алфавит используется для представления текстов в компьютере. Поскольку 256=28, то 1символ несет в тексте 8 бит информации.

Алфавит — упорядоченный набор символов, используемый для кодирования сообщений на некотором языке.

Мощность алфавита — количество символов алфавита.

Двоичный алфавит содержит 2 символа, его мощность равна двум.

Сообщения, записанные с помощью символов ASCII, используют алфавит из 256 символов. Сообщения, записанные по системе UNICODE, используют алфавит из 65 536 символов.

Вероятностный подход к измерения информации. Все события происходят с различной вероятностью, но зависимость между вероятностью событий и количеством информации, полученной при совершении того или иного события можно выразить формулой которую в 1948 году предложил Шеннон.

В вычислительной технике применяются две стандартные единицы измерения: бит (binary digit) и байт (byte). Если сообщение уменьшило неопределеность знаний ровно в два раза, то говорят, что сообщение несет 1 бит информации.

1 бит — объем информации такого сообщения, которое уменьшает неопределенность знания в два раза.

Для измерения информации используется и более крупные единицы:

Единицы измерения информации в вычислительной технике |

||||

1 бит |

|

|

||

1 байт |

8 бит |

|

||

1 Кбайт (килобайт) |

210 байт = 1024 байт |

1 тыс. байт |

||

1 Мбайт (мегабайт) |

210 Кбайт = 220 байт |

1 млн. байт |

||

1 Гбайт (гигабайт) |

210 Мбайт = 230 байт |

1 млрд. байт |

||

|

Количество информации – число, адекватно характеризующее разнообразие (структурированность, определенность, выбор состояний и т.д.) в оцениваемой системе. Количество информации часто оценивается в битах, причем такая оценка может выражаться и в долях бит (так речь идет не об измерении или кодировании сообщений). |

|

||

В настоящее время получили распространение подходы к определению понятия "количество информации", основанные на том, что информацию, содержащуюся в сообщении, можно нестрого трактовать в смысле её новизны или, иначе, уменьшения неопределённости наших знаний об объекте. Эти подходы используют математические понятия вероятностии логарифма.

Мера информации – критерий оценки количества информации. Обычно она задана некоторой неотрицательной функцией, определенной на множестве событий и являющейся аддитивной, то есть мера конечного объединения событий (множеств) равна сумме мер каждого события.

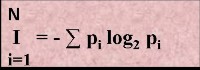

Подходы к определению количества информации. Формулы Хартли и Шеннона. Американский инженер Р. Хартли в 1928 г. процесс получения информации рассматривал как выбор одного сообщения из конечного наперёд заданного множества из N равновероятных сообщений, а количество информации I, содержащееся в выбранном сообщении, определял как двоичный логарифм N.

Допустим, нужно угадать одно число из набора чисел от единицы до ста. По формуле Хартли можно вычислить, какое количество информации для этого требуется: I = log2100 6,644. Таким образом, сообщение о верно угаданном числе содержит количество информации, приблизительно равное 6,644 единицы информации. Приведем другие примеры равновероятных сообщений:

Определим теперь, являются ли равновероятными сообщения "первой выйдет из дверей здания женщина" и "первым выйдет из дверей здания мужчина". Однозначно ответить на этот вопрос нельзя. Все зависит от того, о каком именно здании идет речь. Если это, например, станция метро, то вероятность выйти из дверей первым одинакова для мужчины и женщины, а если это военная казарма, то для мужчины эта вероятность значительно выше, чем для женщины. Для задач такого рода американский учёный Клод Шеннон предложил в 1948 г. другую формулу определения количества информации, учитывающую возможную неодинаковую вероятность сообщений в наборе.

Легко заметить, что если вероятности p1, ..., pN равны, то каждая из них равна 1 / N, и формула Шеннона превращается в формулу Хартли. Помимо двух рассмотренных подходов к определению количества информации, существуют и другие. Важно помнить, что любые теоретические результаты применимы лишь к определённому кругу случаев, очерченному первоначальными допущениями. |

В качестве единицы информации Клод Шеннон предложил принять один бит (англ. bit — binary digit — двоичная цифра).

Бит в теории информации — количество информации, необходимое для различения двух равновероятных сообщений (типа "орел"—"решка", "чет"—"нечет" и т.п.). В вычислительной технике битом называют наименьшую "порцию" памяти компьютера, необходимую для хранения одного из двух знаков "0" и "1", используемых для внутримашинного представления данных и команд. |

Бит — слишком мелкая единица измерения. На практике чаще применяется более крупная единица — байт, равная восьми битам. Именно восемь битов требуется для того, чтобы закодировать любой из 256 символов алфавита клавиатуры компьютера (256=28).

Широко используются также ещё более крупные производные единицы информации:

|

1 Килобайт (Кбайт) = 1024 байт = 210 байт, |

|

1 Мегабайт (Мбайт) = 1024 Кбайт = 220 байт, |

|

1 Гигабайт (Гбайт) = 1024 Мбайт = 230 байт. |

В последнее время в связи с увеличением объёмов обрабатываемой информации входят в употребление такие производные единицы, как:

|

1 Терабайт (Тбайт) = 1024 Гбайт = 240 байт, |

|

1 Петабайт (Пбайт) = 1024 Тбайт = 250 байт. |

Информационный объем сообщения (информационная емкость сообщения) – количество информации в сообщении, измеренное в битах, байтах или производных единицах (Кбайтах, Мбайтах и т. д.).