- •21,Аппроксимация функций. Адалайн. Паде-нейрон.

- •22,Нейрон с квадратичным сумматором.

- •23,Нейроны типа wta.

- •24.Реализация

- •25.Многослойные нейронные сети. Виды сетей.

- •26,Оценка способности нейронной сети решить задачу. Константа Липшица.

- •27,Рекуррентные сети

- •Автоассоциативная сеть Хопфилда

- •28,Обучение сети Хопфилда по правилу Хебба

- •29,Обучение сети Хопфилда методом проекций

- •30,Сеть Хемминга

26,Оценка способности нейронной сети решить задачу. Константа Липшица.

Рассматриваются только сети, все элементы которых непрерывно зависят от своих аргументов. Предполагается, что все входные данные предобработаны так, чтобы все входные и выходные сигналы сети лежали в диапазоне приемлемых входных сигналов [a,b].

Нейронная

сеть вычисляет некоторую вектор-функцию

F

от

входных сигналов. Эта функция зависит

от параметров сети. Обучение сети

состоит в подборе такого набора

параметров сети, чтобы величина

![]() была

минимальной.

была

минимальной.

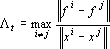

Для того чтобы нейронная сеть могла хорошо приблизить заданную таблично функцию f, необходимо, чтобы реализуемая сетью функция F при изменении входных сигналов с xi

на xj могла изменить значение с fi на fj. Очевидно, что наиболее трудным для сети должно быть приближение функции в точках, в которых при малом изменении входных сигналов происходит большое изменение значения функции. Таким образом, наибольшую сложность будет представлять приближение функции f

в

точках, в которых достигает максимума

выражение

.

Для аналитически заданных функций

величина

.

Для аналитически заданных функций

величина

называется

константой Липшица. Исходя из этих

соображений, можно дать следующее

определение сложности задачи.

называется

константой Липшица. Исходя из этих

соображений, можно дать следующее

определение сложности задачи.

Сложность

аппроксимации таблично заданной

функции f,

которая в точках xi принимает

значения ![]() ,

задается выборочной оценкой константы

Липшица, вычисляемой по следующей

формуле 1:

,

задается выборочной оценкой константы

Липшица, вычисляемой по следующей

формуле 1:

Оценка является оценкой константы Липшица аппроксимируемой функции снизу.

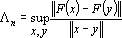

Для

того, чтобы оценить способность сети

заданной конфигурации решить задачу,

необходимо оценить константу Липшица

сети и сравнить ее с выборочной оценкой.

Константа Липшица сети вычисляется по

следующей формуле 2:

27,Рекуррентные сети

Отдельную группу нейронных сетей составляют сети с обратной связью между различными слоями нейронов. Это так называемые рекуррентные сети. Их общая черта состоит в передаче сигналов с выходного либо скрытого слоя на входной слой.

Благодаря

обратной связи при подаче сигнала на

входы сети в ней возникает переходной

процесс, который завершается формированием

нового устойчивого состояния,

отличающегося в общем случае от

предыдущего. Если функцию активации

нейрона обозначить

,

где

,

где

-

это взвешенная сумма его возбуждений,

то состояние нейрона можно определить

выходным сигналом

-

это взвешенная сумма его возбуждений,

то состояние нейрона можно определить

выходным сигналом

.

.

Рекуррентной сети можно поставить в соответствие энергетическую функцию Ляпунова

.

.

Изменение

состояния какого либо нейрона

инициализирует изменение энергетического

состояния сети в направлении минимума

ее энергии вплоть до его достижения. В

пространстве состояний локальные

энергетические минимумы

представлены точками стабильности,

называемыми аттракторами из-за тяготения

к ним ближайшего окружения. Благодаря

наличию аттракторов, рекуррентные сети

могут быть использованы как устройства

ассоциативной памяти.

представлены точками стабильности,

называемыми аттракторами из-за тяготения

к ним ближайшего окружения. Благодаря

наличию аттракторов, рекуррентные сети

могут быть использованы как устройства

ассоциативной памяти.

Ассоциативная память играет роль системы, определяющей взаимную зависимость векторов. В случае, когда на взаимозависимость исследуются компоненты одного и того же вектора, говорят об автоассоциативной памяти. Если же взаимозависимыми оказываются два различных вектора, можно говорить о памяти гетероассоциативного типа. К первому классу относится сеть Хопфилда, а ко второму – сеть Хемминга и сеть типа BAM (Bidirectional Associative Memory – двунаправленная ассоциативная память).

Задача ассоциативной памяти сводится к запоминанию обучающих векторов, чтобы при представлении нового вектора система могла сгенерировать ответ – какой из запомненных ранее векторов наиболее близок к вновь поступившему образу. Часто в качестве меры близости отдельных множеств применяется расстояние Хемминга.

При

использовании двоичных значений (0,1)

расстояние Хемминга между двумя

векторами

и

и

определяется в виде

определяется в виде

.

.

При биполярных значениях элементов обоих векторов расстояние Хемминга рассчитывается по формуле

.

.

Мера

Хемминга равна числу несовпадающих

компонент векторов двух векторов, она

равна нулю, когда

.

.