- •Ответы на зачет по из (Питолин)

- •1. Классы задач, решаемые искусственными нейронными сетями

- •2. Биологический нейрон как прототип искусственного нейрона

- •3. Математическая модель искусственного нейрона

- •4. Функция активации. Сигмоидальная функция активации.

- •5. Основные этапы нейросетевого анализа

- •6. Топологии инс

- •7. Многослойные сети. Классификация многослойных инс

- •8. Классификация инс по различным признакам.

- •9 Математическая постановка нейросетевого анализа данных

- •10 Оценка количества нейронов в скрытых слоях инс. Теорема о полотне.

- •11. Общая схема процесса обучения инс.

- •15. Алгоритм обратного распространения ошибки. Общее описание.

- •16. Математическое описание алгоритма обратного распространения ошибки для однослойной сети.

- •17. Математическое описание алгоритма обратного распространения ошибки для двухслойной сети.

- •18. Особенности функционирования алгоритма обратного распространения ошибки.

- •19. Геометрическая интерпретация алгоритма обратного распространения ошибки.

- •20. Переобучение и обобщение.

- •21. Обучение без учителя. Алгоритм Хебба.

- •22. Обучение без учителя. Алгоритм обучения Кохонена.

- •23. Геометрическая интерпретация алгоритма обучения Кохонена.

- •24. Персептроны

- •25. Проблема «исключающее или» и пути ее решения

- •26. Инс встречного распространения. Функционирование сети.

- •27. Инс встречного распространения. Обучение сети.

- •28. Инс Хопфилда.

- •29. Инс Хемминга.

- •30. Классификация и сравнительный анализ пакетов прикладных программ нейросетевого моделирования

- •31. Общие принципы построения нейрокомпьютеров

- •32. Элементная база нейровычислений

21. Обучение без учителя. Алгоритм Хебба.

Главная черта, делающая обучение без учителя привлекательным, - это его «самостоятельность». Процесс обучения, как и в случае обучения с учителем, заключается в настройке весов сети. Подстройка весов может проводиться только на основании информации, доступной в нейроне, т. е. его состояния и уже имеющихся весовых коэффициентов. Исходя из этого соображения и, что более важно, по аналогии с известными принципами самоорганизации нервных клеток, построены алгоритмы обучения Хебба.

Сигнальный метод обучения Хебба заключается в изменении весов по следующему правилу:

![]()

где oj(q-1) - выходное значение j-гo нейрона слоя (q-1), oj(q) - выходное значение i-го нейрона слоя q; wij - весовой коэффициент синапса, соединяющего эти нейроны, - коэффициент скорости обучения. При обучении по данному методу усиливаются связи между возбужденными нейронами.

Полный алгоритм обучения с применением вышеприведенной формулы выглядит следующим образом:

1. На стадии инициализации всем весовым коэффициентам присваиваются небольшие случайные значения.

2. На входы сети подается входной образ, и сигналы возбуждения распространяются по всем слоям согласно принципам классических сетей прямого распространения (feedforward), т.е. для каждого нейрона рассчитывается взвешенная сумма его входов, к которой затем применяется активационная (передаточная) функция нейрона, в результате чего получается его выходное значение.

3. На основании полученных выходных значений нейронов по приведенной формуле производится изменение весовых коэффициентов.

4. Цикл с шага 2, пока выходные значения сети не застабилизируются с заданной точностью. Применение этого нового способа определения завершения обучения, отличного от использовавшегося для сети обратного распространения, обусловлено тем, что подстраиваемые значения синапсов фактически не ограничены.

На втором шаге цикла попеременно предъявляются все образы из входного набора.

22. Обучение без учителя. Алгоритм обучения Кохонена.

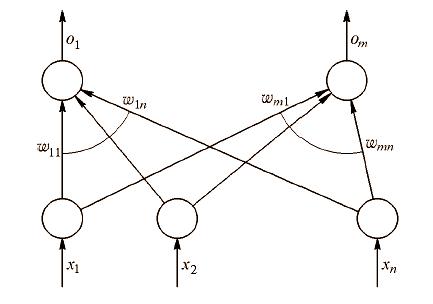

Алгоритм Кохонена предусматривает самообучение по правилу «победитель забирает все». Структура сети, реализующей данное правило, представлена на рис. 1.10.

Критерий подстройки весов сети (все векторы весов должны быть нормализованы, т.е. иметь единичную длину) выглядит следующим образом:

![]()

где индекс r обозначает нейрон-победитель, соответствующий вектору весов wr, который ближе всех расположен к (текущему) входному вектору х.

Поскольку с учетом того, что

![]()

![]()

![]()

процедура нахождения wr эквивалентна решению оптимизационной задачи

![]()

Рис. 1.10. Структура сети Кохонена

Так как скалярное произведение wiTx с учетом ||wi|| = 1 представляет собой проекцию вектора х на направление вектора wi ,то нейрон-победитель определяется по тому вектору весов, чье направление ближе всего к направлению х (на рис. 1.11 таким является вектор w2).

После выявления нейрона-победителя его выход устанавливается равным единице (у остальных нейронов устанавливаются нулевые выходы), а веса корректируются так, чтобы уменьшить квадрат величины рассогласования ||х - wr||2.

Алгоритм обучения (без учителя) Кохонена может быть описан следующим образом.

1. Задаются случайные нормализованные по длине векторы wi

2. Начало цикла обучения; ввод очередного вектора входов х.

3. Определение нейрона-победителя, корректировка вектора его весов и задание единичного выхода:

![]()

4. Нормализация найденного вектора:

![]()

5. Задание значений для остальных нейронов:

![]()

6. Проверка выполнения правила останова (в качестве такогоправила можно принять, например, стабилизацию векторов весов на каких-то значениях); если оно не выполнено - продолжение цикла обучения (переходом к шагу 2), в противоположном случае - переход к шагу 7. 7. Конец обучения.