- •1. События и их классификация. Классическое определение вероятности

- •2. Элементы комбинаторики: перестановки, сочетания, размещения, правило умножения и правило сложения

- •3. Действия над событиями. Соотношения между событиями

- •4. Теорема сложения вероятностей несовместных событий.

- •5. Теорема сложения вероятностей совместных событий.

- •6. Частота события и ее свойства. Статистическое определение вероятности.

- •7. Условная вероятность. Теорема умножения вероятностей. Вероятность появления хотя бы 1 события

- •8. Формула полной вероятности. Формулы Байеса

- •9. Повторные независимые испытания. Формула Бернулли. Наивероятнейшее число появления события

- •10. Повторные независимые испытания. Формула Пуассона

- •11. Повторные независимые испытания. Локальная и интегральная теорема Лапласа

- •12. Понятие случайной величины и ее функции распределения. Свойства функции распределения

- •13. Дискретные случайные величины. Числовые характеристики (математическое ожидание, дисперсия, среднее квадратическое отклонение, начальные и центральные моменты, асимметрия и эксцесс)

- •14. Биномиальный закон распределения

- •15. Распределение Пуассона

- •16. Непрерывные случайные величины. Плотность распределения. Числовые характеристики (математическое ожидание, дисперсия, среднее квадратическое отклонение)

- •17. Равномерное распределение. Вероятность попадания случайной величины в заданный интервал

- •18. Показательное распределение. Вероятность попадания случайной величины в заданный интервал

- •Характеристики

- •19. Нормальное распределение. Вероятность попадания в заданный интервал нормальной случайной величины. Правило 3-х сигм

- •20. Функции случайных величин

- •21. Понятие системы случайных величин. Закон распределения двумерной случайной величины. Функция распределения двумерной случайной величины

- •22. Понятие о законе больших чисел. Неравенства Маркова и Чебышева

- •23. Теоремы Чебышева и Бернулли. Центральная предельная теорема

- •24. Цепи Маркова. Применение Марковских цепей в экономике

- •25. Выборочный метод. Основные понятия. Полигон и распределения. Эмпирическая функция распределения.

- •26. Оценка параметров по выборке. Понятие несмещённости, состоятельности и эффективности оценки

- •27. Основные характеристики генеральной и выборочной совокупностей

- •28. Связь между характеристиками генеральной и выборочной совокупностей.

- •29. Точечные и интервальные оценки. Доверительная вероятность и доверительный интервал.

- •30. Доверительный интервал для оценки мат.Ожидания нормального распределения

- •31. Понятие корреляционной зависимости. Корреляционная таблица. Линейная корреляция

- •32. Метод наименьших квадратов для определения параметров линейной регрессии

- •33. Статистическая гипотеза. Основные понятия

- •34. Уровень значимости и мощность критерия. Этапы проверки стат.Гипотезы

- •Этапы проверки статистических гипотез

- •35. Проверка гипотезы о значимости выборочного коэффициента корреляции

- •36.Проверка гипотезы о нормальном распределении генеральной совокупности. Критерий согласия Пирсона

- •37. Основные понятия дисперсионного анализа

30. Доверительный интервал для оценки мат.Ожидания нормального распределения

Пусть

CВ

Х распределена нормально т. е. ген. с-ть

– нормально распределенная CВ

с переменными:

![]() и

и

![]() .

Для нормальной СВ Х с переменными

и

имеет место ф-ла вер-ти отклонения

нормальной СВ:

.

Для нормальной СВ Х с переменными

и

имеет место ф-ла вер-ти отклонения

нормальной СВ:

![]() .

.

В

нашем случае:

,

=>0,

(х)=![]() ,

СВ Х=

,

СВ Х=![]() .

Тогда получаем

.

Тогда получаем

![]() .

Зададим доверительную вероятность ,

тогда

.

Зададим доверительную вероятность ,

тогда

![]() .

Это вероятность того, что выборочная

характеристика

отличается от ген средней

.

Это вероятность того, что выборочная

характеристика

отличается от ген средней

![]() по абсолютной величине меньше чем на

,

тогда имеем:

по абсолютной величине меньше чем на

,

тогда имеем:

![]() →

ty=

→

ty=![]() .

Рассмотрим =

.

Рассмотрим =![]() - точность оценки (предельная ошибка

выборки). Получим интервал:

- точность оценки (предельная ошибка

выборки). Получим интервал:

![]() на этом интервале с надежностью(доверит

вероятностью)

находится неизвестная вероятная средняя

Примечание:

если

0

неизвестна,

ее заменяют приближенно исправленной

стат дисперсией

на этом интервале с надежностью(доверит

вероятностью)

находится неизвестная вероятная средняя

Примечание:

если

0

неизвестна,

ее заменяют приближенно исправленной

стат дисперсией

![]() S

S

(Если

отбор бесповторный, то мера точности

имеет вид: =![]() )

)

31. Понятие корреляционной зависимости. Корреляционная таблица. Линейная корреляция

Если изменение одной из случайных величин влечет изменение среднего другой случайной величины, то стат.зависимость называют корреляционной. Сами случайные величины, связанные коррреляционной зависимостью, оказываются коррелированными.

Корреляционную зависимость Y от X можно описать с помощью уравнения вида: yx=f(x) (1)

где yx - условное среднее величины Y, соответствующее значению x величины X, а f(x) некоторая функция. Уравнение (1) называется выборочным уравнением регрессии Y на X. Функцию f(x) называют выборочной регрессией Y на X, а ее график – выборочной линией регрессии Y на X.

Совершенно аналогично выборочным уравнением регрессии X на Y является уравнение: xy=φ(y)

Пусть величина Х в выборке принимает значения x1, x2,....xm, где количество различающихся между собой значений этой величины, причем в общем случае каждое из них в выборке может повторяться. Пусть величина Y в выборке принимает значения y1, y2,....yk, где k - количество различающихся между собой значений этой величины, причем в общем случае каждое из них в выборке также может повторяться. В этом случае данные заносят в таблицу с учетом частот встречаемости. Такую табл. с группированными данными называют корреляц-ой.

Если две случайные величины Х и Y имеют в отношении друг друга линейные функции регрессии, то говорят, что величины Х и Y связаны линейной корреляционной зависимостью.

32. Метод наименьших квадратов для определения параметров линейной регрессии

Выбрав вид функции регрессии, т.е. вид рассматриваемой модели зависимости Y от Х (или Х от У), напр/, линейную модель yx=a+bx, необходимо определить конкретные значения коэффиц. модели.

При различных значениях а и b можно построить бесконечное число зависимостей вида yx=a+bx т.е на координатной плоскости имеется бесконечное количество прямых, нам же необходима такая зависимость, которая соответствует наблюдаемым значениям наилучшим образом. Таким образом, задача сводится к подбору наилучших коэффициентов. Линейную функцию a+bx ищем, исходя лишь из некоторого количества имеющихся наблюдений. Для нахождения функции с наилучшим соответствием наблюдаемым значениям используем метод наименьших квадратов.

Обозначим: Yi - значение, вычисленное по уравнению Yi=a+bxi. yi - измеренное значение, εi=yi-Yi - разность между измеренными и вычисленными по уравнению значениям, εi=yi-a-bxi.

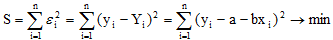

В методе наименьших квадратов требуется, чтобы εi, разность между измеренными yi и вычисленными по уравнению значениям Yi, была минимальной. Следовательно, находим коэффициенты а и b так, чтобы сумма квадратов отклонений наблюдаемых значений от значений на прямой линии регрессии оказалась наименьшей:

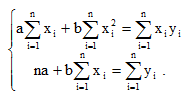

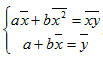

Исследуя на экстремум эту функцию аргументов а и с помощью производных, можно доказать, что функция принимает минимальное значение, если коэффициенты а и b являются решениями системы:

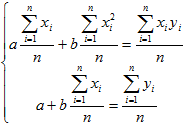

Если разделить обе части нормальных уравнений на n, то получим:

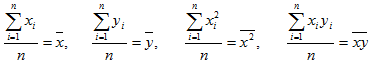

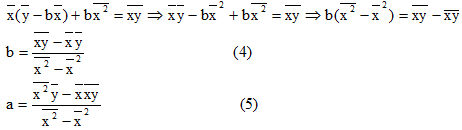

Учитывая,

что

Получим

,

отсюда

,

отсюда

![]() ,

подставляя значение a в первое уравнение,

получим:

,

подставляя значение a в первое уравнение,

получим:

При этом b называют коэффициентом регрессии; a называют свободным членом уравнения регрессии и вычисляют по формуле:

Полученная прямая является оценкой для теоретической линии регрессии. Имеем:

![]()