- •Постановка задачи классификации (с учителем)

- •Решение задачи многоклассовой классификации одним классификатором

- •Решение задачи многоклассовой классификации независимыми бинарными классификаторами.

- •I. Обзор методов классификации с учителем

- •2 . Линейное расстояние (манхеттенская мера) тоже выражение что и (п.1) но для общего случая

- •3. Обобщенное степенное расстояние Минковского

- •4. Взвешенное Эвклидово расстояние

- •5. Расстояние Махаланобиса

- •1. Компонентный анализ и 2. Выделение главных компонент

- •1. Компонентный анализ

- •2. Размерность пространства дискриминационных функций q

Курс … 2 семестр Раздел: дискриминантный и факторный анализ.

Введение

Общее и различия в постановке задач кластерного, факторного,

регрессионного и дискриминантного анализа

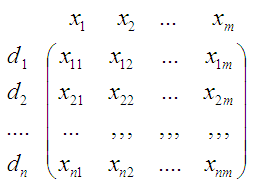

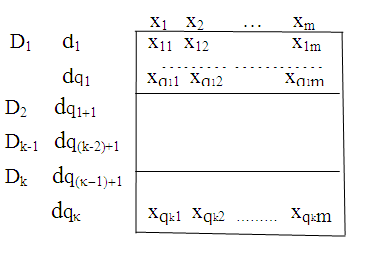

Общее: задачи каждой из перечисленных дисциплин опираются на анализ матрицы данных – матрицы наблюдений.

Ее часто обозначают Х

Это матрица значений (по столбцам) - регрессоров или признаков х1 х2 …xm.

Но в этой матрице, наравне с столбцами х - признаки, участвуют строки d - объекты, - пэтому мы должны бы считать ее не только матрицей признаков х характеризующих объекты d но и матрицей объектов d содержащих в себе определенные значения признаков х.

То есть в

“матрице

признаков”

Х

То есть в

“матрице

признаков”

Х

признаки х характеризуют объекты d

признак х1 на объект d1 принимает значение х11,

признак х1 на объект d2 принимает значение х12

…………………………………………………..

признак хm на объект dn принимает значение хnm

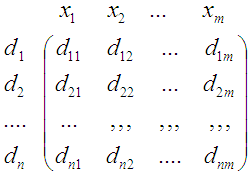

И рассматривая ее же как “матрицу

объектов”

D

рассматривая ее же как “матрицу

объектов”

D

- здесь объекты d характеризуют признаки х

- объект d1 на признаке х1 принимает значение d11,

- объект d1 на признаке х2 принимает значение d12

………………………………………………..

объект dn на признаке хm принимает значение dnm.

Поэтому надо бы ее обозначать нейтральной буквой, не Х, не D а например Z.

Ну пусть будет Х – мы так привыкли, но имеем в виду, что эта матрица Х состоит равноправно из

столбцов - признаков х и строк – объектов d и анализировать Х возможно, исходя из пространства столбцов х – признаков и

исходя из пространства строк d – объектов.

Напомню, что мы уже применяли такой подход в регрессионном анализе получая интерпретации решений и в пространстве переменных и в пространстве точек.

Если это все что нам дано - то есть мы не имеем значения вектора У, который мы в РА трактовали как выход, то

* анализ тесноты связей в Х естественно может сводится к

анализу тесноты связей в 1. строках - объектах

2. столбцах – признаках.

вопросы о структуре (направлении) связей, – более сложные вопросы - решаем в рамках статистичемкого причинно-следственного анализа И так (различия)

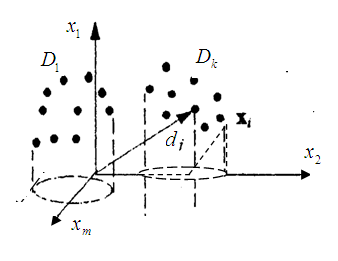

1 .

первый

анализ

-степени близости строк

(объектов

d)

проводится в пространстве

признаков

и это будут группы

объектов Di

– и вы сразу

узнали тему кластерного

анализа

которым только что занимались.

.

первый

анализ

-степени близости строк

(объектов

d)

проводится в пространстве

признаков

и это будут группы

объектов Di

– и вы сразу

узнали тему кластерного

анализа

которым только что занимались.

Именно этот аппарат позволяет выделять естественные группировки объектов которые могут реально соответствовать каким-то интерпретируемым классам.

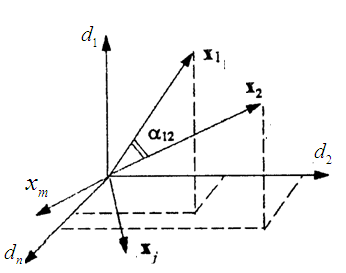

2. второй тип анализа -степени близости признаков – проводится в пространстве объектов и результатом будут группировки (по тесноте связи) признаков. Тесноту связи определяют высокие значения парной корреляции

В пространстве объектов такие близкие связанные признаки будут образовывать пучки с не сильно отличающимися направляющими

косинусами между ними.

Обычно у каждой такой группы признаков существует общая причина влияющая на их вариации причем, латентная, то есть не присутстующая в нашем наборе признаков.

Ее, эту причину, и называют фактором.

Предметом ФА является поиск и попытки восстановления этих общих, для найденных групп признаков, и до сих пор нам неизвестных, переменных - факторов.

Интересно что в факторном анализе существуют несколько техники – одна из них R-техника,основанная на анализе и выявлении общности признаков и нахождении факторов , другая Q-техника - аналогичные подходы и алгоритмы только относительно объектов.

Получается, что Q-техника, по сути, – это методы факторного анализа, примененные в целях кластеризации. Вот такая трактовка для методов ФА как инструмента Кл. анализа. Верно и обратное – специальные методы КлАнализа могут быть рассмотрены для анализа переменных и с этой точки зрения оценены для механизмов ФА.

-------

Если в добавок к нашей матрице Х задан выходной вектор У

![]()

в виде значений относительной, абсолютной, интервальной переменных - то это предмет регрессионного (индуктивного) анализа и моделирования. Об этом мы уже говорили в 1 семестре.

А вот если если выходной вектор – назовем его здесь d, задан в виде значений категориальной (порядковая или номинальная или дискретная фиктивная) переменной, группирующих объекты матрицы Х в классы - то на лицо постановка задачи классификации с учителем.

То есть, задача

классификации с учителем возникает,

когда нам заданы группы или классы

![]()

![]() перечнем объектов

перечнем объектов

![]() подряд по классам:

подряд по классам:

![]() -

-![]() ,

,

![]()

![]() ,….,.

,….,.

![]()

![]() )

)

Вот тогда вознакает классическая задача обучени с учителем которой занимается дисциплина

Классификация с “Учителем” или “Распознавание образов”

Дисциплина занимается построением классификаторов У по заданной обучающей выборке Х для использования, затем, при определении класса новых объектов.

------------------

К слову – на практике мы проведем исследовательскую последовательную работу с выданным вам по вариантам матрицам наблюдений пациентов. Матрица данных по 75 признакам и характеризует состояние пациентов которым делали оперции протезирования клапанов сердца и операции аортокоронарного шунтирования.и фиксирует осложнения (норма, развитие серд недостаточности, наруш мозгового кровообращения, комби)

Вы должны убедится насколько естественные группировки (по рез. кластерного анализа) соответствуют выделенным нами классам осложнений, и должны найти подклассы если они есть.

Далее протащим нашу матрицу через дискриминантный анализ и факторный анализ.

Но начинаем работу с того чтобы выяснить не группируются ли в нашей матрице данные еще как нибудь, кроме как по выделенным нами классам. Именно в существовании подклассов часто возникают проблемы РО.

Пример

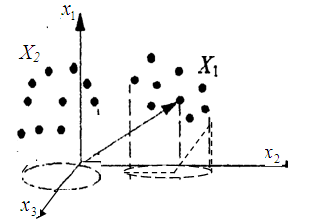

Основная гипотеза методов РО исходит того что пространство признаков подобрано целесообразно и поэтому концентрпрует в себе различия классов – а значит и отличия их средних. Поэтому основная гипотеза РО – гипотеза компактности классов в Х.

Но что же происходит при наличии подклассов – см самый неприятный вариант.

Здесь средние классов совпадают и применяемый алгоритм должен строить сложную нелинейную границу. Если же выделить подклассы то задачу можно решить линейными границами.

Поэтому ваш кластерный анализ проводится сначала в полной матрице (важно – совпадут группировки по кластерам с нашими известными классами – если нет, то какие будут отличия и насколько значимы будут они) а затем проанализировать тоже самое но в каждом классе отдельно – не наблюдаются ли у нас явные подклассы

Затем прогоним данные через ЛР и получите бинарные классификаторы

Затем тоже дискриминантным анализом,

И завершим все поверкой как группируются наши признаки в этой задаче – то есть проведем факторный анализ. (логичнее было бы это сделатьв начале - до ЛГ и ДА но …..не играет особой роли)

Особо любопытные попробуют провести клиссификацию уже не в исходном пространстве а в пространстве факторов (и канонических ДФ построенных на факторах)

Это наша программа максимум на практических занятиях – и в сумме эта работа будет Вашей иллюстрацией к вопросам на экзамене.

Начнем теперь с Этапа постановки задачи.

Постановка задачи классификации (с учителем)

1.

Задан факт

существования некоторого множества

классов

![]() ,

представляющих собой

конечные или бесконечные множества

объектов :

,

представляющих собой

конечные или бесконечные множества

объектов :

![]()

![]() …..

…..![]() .

.

2.

известен факт, что множества

![]() Æ

при

Æ

при

![]() (*) !

(*) !

3.

Нам

классы

![]() задаются как их приближения

задаются как их приближения

![]() через усеченные множества объектов, им

принадлежащих

через усеченные множества объектов, им

принадлежащих

![]() ,

,![]() ,…,

,…,![]() или

или![]() ,

,![]() ,…,

,…,![]() (**)

(**)

где

![]()

![]() ,….,

,….,

![]()

Очевидно что ввиду

(*) для любых подмножеств удовлетворяющих

(**) должно выполнятся

![]() Æ

при

(***) !

Æ

при

(***) !

4 .

Предполагается что данные объекты,

описываются в конечномерном пространстве

.

Предполагается что данные объекты,

описываются в конечномерном пространстве

![]() вектором признаков

вектором признаков

![]() что образует в пространстве

что образует в пространстве

![]() соответствующие множества

соответствующие множества

![]() .

.

Н еобходимо

на основании обучающих подмножеств

построить наилучшее правило классификации

произвольного объекта из исходных

множеств

еобходимо

на основании обучающих подмножеств

построить наилучшее правило классификации

произвольного объекта из исходных

множеств

![]() .

.

Многообразие алгоритмов сводится к следующему

– как сформировать понимание наилучшести в конкретных условиях информативности Х, свойств распределений Х, ущерба от неправильной классификации.

Если с иформативностью все в порядке – то будет оправдыватся основная гипотеза лежащая в основе практически всех методов анализа матриц данных = гипотеза о компактности классов:

– в целесообразно подобранном признаковом пространвтве Х элементы классов чем-то похожи и образуют компактные сгущения. Если данная гипотеза нарушается – возникают проблемы для распознающих алгоритмов.

Особенности условий вероятностной и детерминированных

постановок задачи классификации с учителем

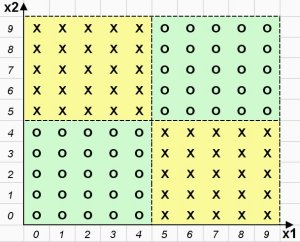

В зависимости от свойств распределений объектов в пространстве Х применяют или детерминированные (в том числе логические) или вероятностные подходы

- детерминмрованные: лин/нелин разделяющие границы, алгоритмы по близости к центрам классов …

- вероятностные – то же самое, но с учетом вероятностей нахождения объектов в классах.

- Логические

(F(if,then(x,a))

– если доминирует логика в расположении

классов а не компактность:

Логические

(F(if,then(x,a))

– если доминирует логика в расположении

классов а не компактность:

Когда же целесообразно применять первые а когда вторые. Рассмотрим общие и различающиеся предпосылки для применения дет. и вероятн. подходов.

Детерминированная постановка |

Вероятностная постановка |

|

Общие условия |

||

1. Задается пространство признаков х1 х2 …..хm в котором характеризуются объекты 2. Количество классов задано (К) и каждый класс задается соответствующим перечнем объектов. Перечень представлен матрицей значений признаков. 3.!!!! По определению, каждый предъявляемый объект может принадлежать исключительно одному из К классов (важно – так как дальнейшие ньюансы двух постановок именно в этой части формализации задачи) то есть пересечения множеств Æ при * Необходимо найтии правило, наилучшим образом решающее задачу классфикации |

||

Различные условия |

||

А. Детерминированная постановка |

Б. Вероятностная постановка |

|

1.Пространство признаков признается полным – то есть достаточным для однозначного определения принадлежности к классу

2. Шум в данных допускается, но он недостаточен для нарушения механизма однозначности классификации в имеющемся пространстве признаков

( гармония с п.3. общих условий) |

1.При справедливости

признается возможность неполноты пространства признаков Х – то есть наличия информационной недостаточности для однозначного определения принадлежности к классу ( отсюда необходимость вероятностного механизма классификации). Это означает пересечения областей классов в Х (при этом см п.3 общих условий) – и необходимо принимать решение о классе по вероятности то есть разные объекты (имена разные) с равными значениями признаков могут сидеть в разных классах 2.Пусть пространство признаков есть исходно полным то есть достаточным для однозначной классификации – однако реальные условия наблюдения, измерения признаков в условиях шумов искажают их значения в той степени что области “заселения” классов в данном пространстве признаков все равно пересекаются То есть, для двух различных (по имени) объектов находящихся в одной точке признакового пространства возможна принадлежность к разным классам.(при этом см п.3 общих условий). НО в результате мы будем находить непересекающиеся по вероятности области классов в Х , приводя их, все равно к Æ |

|

Однако даже при выбранном варианте постановки – детерм. или вероятн. применяют различные схемы к решению задач классификации.

Что имеется в виду. Упрощенно возможно рассмотреть 3 варианта схемы.

Схемы решения задач классификации

Одну и ту же многоклассовую задачу возможно решать

1. Непосредственно, как многоклассовую, - одним решающим правилом

2. Как ряд независимых задач с разделением классов на подгруппы:

наиболее известный способ – “один против всех”, “группировки по 2” и т.д.

3. с помощью систем связанных решающих правил

Расмотрим их последовательно