- •Предмет и задачи статистики.

- •Основные этапы развития государственной статистики в России.

- •Принципы организации современной государственной статистики в Российской Федерации.

- •Основные требования к составлению и оформлению таблиц. Абсолютные величины в статистике, их виды и единицы измерения.

- •Применение графического метода в статистике.

- •Графическое отображение измерения явлений во времени и в пространстве.

- •7. Статистические показатели и их виды.

- •8. Относительные величины в статистике их назначение , виды и единицы измерения

- •9. Средняя величина и принципы применения средних величин.

- •10. Расчет средней арифметической величины. Свойства средней арифметической. Средняя арифметическая простая

- •Средняя арифметическая взвешенная

- •Средняя арифметическая для интервального ряда

- •Средняя арифметическая обладает целым рядом свойств, которые более полно раскрывают ее сущность и упрощают расчет:

- •Дисперсия. Виды дисперсий

- •Среднее квадратическое (стандартное) отклонение. Коэффициент вариации

- •14,Понятие вариации. Относительные показатели вариации.

- •15, Мода, медиана и другие показатели вариационного ряда.

- •Показатели дифференциации

- •16. Ряды динамики. Их основные элементы и классификация.

- •17. Основные показатели анализа рядов динамики.

- •18. Понятие о рядах динамики и правила их построения.

- •19. Способы проверки ряда динамики на наличие тренда.

- •20. Методы определения тенденции временного ряда.

- •21. Исследование сезонных колебаний в рядах динамики.

- •22. Индексы и их виды.

- •23. Общие индексы и принципы их построения.

- •24. Индексы средних величин.

- •25. Территориальные индексы: сущность и методы построения.

- •26. Статистическое исследование взаимосвязей.

- •27. Назначение корреляционного анализа. Коэффициенты корреляции.

- •Линейная корреляция

26. Статистическое исследование взаимосвязей.

27. Назначение корреляционного анализа. Коэффициенты корреляции.

Существующие между явлениями формы и виды связей весьма разнообразны по своей классификации. Предметом статистики являются только такие из них, которые имеют количественный характер и изучаются с помощью количественных методов. Рассмотрим метод корреляционно-регрессионного анализа, который является основным в изучении взаимосвязей явлений.

Данный метод содержит две свои составляющие части — корреляционный анализ и регрессионный анализ. Корреляционный анализ — это количественный метод определения тесноты и направления взаимосвязи между выборочными переменными величинами. Регрессионный анализ — это количественный метод определения вида математической функции в причинно-следственной зависимости между переменными величинами.

Для оценки силы связи в теории корреляции применяется шкала английского статистика Чеддока: слабая — от 0,1 до 0,3; умеренная — от 0,3 до 0,5; заметная — от 0,5 до 0,7; высокая — от 0,7 до 0,9; весьма высокая (сильная) — от 0,9 до 1,0. Она используется далее в примерах по теме.

Линейная корреляция

Данная корреляция характеризует линейную взаимосвязь в вариациях переменных. Она может быть парной (две коррелирующие переменные) или множественной (более двух переменных), прямой или обратной — положительной или отрицательной, когда переменные варьируют соответственно в одинаковых или разных направлениях.

Если

переменные — количественные и равноценные

в своих независимых наблюдениях

![]() при

их общем количестве

,

то важнейшими эмпирическими мерами

тесноты их линейной взаимосвязи являются

коэффициент прямой корреляции знаков

австрийского психолога Г.Т.Фехнера

(1801-1887) и коэффициенты парной, чистой

(частной) и множественной (совокупной)

корреляции английского статистика-биометрика

К.Пирсона (1857-1936).

при

их общем количестве

,

то важнейшими эмпирическими мерами

тесноты их линейной взаимосвязи являются

коэффициент прямой корреляции знаков

австрийского психолога Г.Т.Фехнера

(1801-1887) и коэффициенты парной, чистой

(частной) и множественной (совокупной)

корреляции английского статистика-биометрика

К.Пирсона (1857-1936).

Коэффициент

парной корреляции знаков Фехнера

определяет согласованность

направлений в индивидуальных отклонениях

переменных

и

![]() от

своих средних

от

своих средних

![]() и

и

![]() .

Он равен отношению разности сумм

совпадающих (

.

Он равен отношению разности сумм

совпадающих (![]() )

и несовпадающих (

)

и несовпадающих (![]() )

пар знаков в отклонениях

)

пар знаков в отклонениях

![]() и

и

![]() к

сумме этих сумм:

к

сумме этих сумм:

![]()

Величина

Кф изменяется от -1 до +1.

Суммирование в (1) производится по

наблюдениям

,

которые не указаны в суммах ради

упрощения. Если какое-то одно отклонение

![]() или

или

![]() ,

то оно не входит в расчет. Если же сразу

оба отклонения нулевые:

,

то оно не входит в расчет. Если же сразу

оба отклонения нулевые:

![]() ,

то такой случай считается совпадающим

по знакам и входит в состав

.

,

то такой случай считается совпадающим

по знакам и входит в состав

.

Коэффициенты парной, чистой (частной) и множественной (совокупной) линейной корреляции Пирсона, в отличие от коэффициента Фехнера, учитывают не только знаки, но и величины отклонений переменных. Для их расчета используют разные методы. Так, согласно методу прямого счета по несгруппированным данным, коэффициент парной корреляции Пирсона имеет вид:

![]()

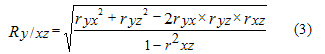

Этот коэффициент также изменяется от -1 до +1. При наличии нескольких переменных рассчитывается коэффициент множественной (совокупной) линейной корреляции Пирсона. Для трех переменных x, y, z он имеет вид

Этот

коэффициент изменяется от 0 до 1. Если

элиминировать (совсем исключить или

зафиксировать на постоянном уровне)

влияние

![]() на

и

,

то их "общая" связь превратится в

"чистую", образуя чистый (частный)

коэффициент линейной корреляции Пирсона:

на

и

,

то их "общая" связь превратится в

"чистую", образуя чистый (частный)

коэффициент линейной корреляции Пирсона:

![]()

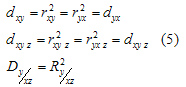

Этот коэффициент изменяется от -1 до +1. Квадраты коэффициентов корреляции (2)-(4) называются коэффициентами (индексами) детерминации — соответственно парной, чистой (частной), множественной (совокупной):

Каждый из коэффициентов детерминации изменяется от 0 до 1 и оценивает степень вариационной определенности в линейной взаимосвязи переменных, показывая долю вариации одной переменной (y), обусловленную вариацией другой (других) — x и y. Многомерный случай наличия более трех переменных здесь не рассматривается.

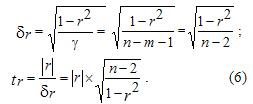

Согласно

разработкам английского статистика

Р.Э. Фишера (1890-1962), статистическая

значимость парного и чистого (частного)

коэффициентов корреляции Пирсона

проверяется в случае нормальности их

распределения, на основании

![]() -распределения

английского статистика В.С. Госсета

(псевдоним "Стьюдент"; 1876-1937) с

заданным уровнем вероятностной значимости

-распределения

английского статистика В.С. Госсета

(псевдоним "Стьюдент"; 1876-1937) с

заданным уровнем вероятностной значимости

![]() и

имеющейся степени свободы

и

имеющейся степени свободы

![]() ,

где

—

число связей (факторных переменных).

Для парного коэффициента

,

где

—

число связей (факторных переменных).

Для парного коэффициента

![]() имеем

его среднеквадратическую ошибку

имеем

его среднеквадратическую ошибку

![]() и

фактическое значение

-критерия

Стьюдента:

и

фактическое значение

-критерия

Стьюдента:

Для

чистого коэффициента корреляции

![]() при

расчете его

вместо

(n-2) надо брать

при

расчете его

вместо

(n-2) надо брать

![]() ,

т.к. в этом случае имеется m=2 (две факторные

переменные x и z). При большом числе n>100

вместо (n-2) или (n-3) в (6) можно брать n,

пренебрегая точностью расчета.

,

т.к. в этом случае имеется m=2 (две факторные

переменные x и z). При большом числе n>100

вместо (n-2) или (n-3) в (6) можно брать n,

пренебрегая точностью расчета.

Если tr > tтабл. , то коэффициент парной корреляции — общий или чистый является статистически значимым, а при tr ≤ tтабл. — незначимым.

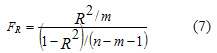

Значимость коэффициента множественной корреляции R проверяется по F — критерию Фишера путем расчета его фактического значения

При

FR > Fтабл.

коэффициент R считается значимым с

заданным уровнем значимости a и имеющихся

степенях свободы

![]() и

и

![]() ,

а при Fr≤

Fтабл — незначимым.

,

а при Fr≤

Fтабл — незначимым.

В совокупностях большого объема n > 100 для оценки значимости всех коэффициентов Пирсона вместо критериев t и F применяется непосредственно нормальный закон распределения (табулированная функция Лапласа-Шеппарда).

Наконец, если коэффициенты Пирсона не подчиняются нормальному закону, то в качестве критерия их значимости используется Z — критерий Фишера, который здесь не рассматривается.