- •1).Теоретико-множественные операции над расплывчатыми множествами

- •2)Расплывчатое включение и расплывчатое равенство множеств

- •5). Расплывчатые высказывания и операции над ними.

- •6) . Расплывчатые логические формулы и их свойства

- •7) . Сложные нечеткие высказывания

- •8) . Нечеткая и лингвистическая переменные

- •9) Построение функций принадлежности нечетких множеств.

- •10) Задача о нечетких интервалах.

- •11). Данные и знания.

- •12). Исчисление высказываний. Синтаксис и семантика.

- •13) .Вывод в логике предикатов

- •14) .Методы решения задач исчисления предикатов

- •15). Сетевые модели представления данных

- •16). Продукционные модели представления знаний

- •17). Вывод на знаниях.

- •18). Онтологии. Модель онтологии.

- •19). Задачи, решаемые с помощью онтологии.

- •20). Основные технологии баз знаний. Система операция для работы со знаниями

- •21) Комплексные операции для работы со знаниями. Анализ структурной семантики.

- •Анализ семантических зависимостей.

- •22) Структура экспертной системы. Экспертные системы

- •Структура экспертной системы

- •Диалоговый компонент экспертной системы

- •23) Интерпретатор экспертной системы

- •24) Компонент приобретения знаний экспертной системы. Когнитивные карты.

- •27). Экспертные оценки. Основные типы шкал и методы проведения экспертизы.

- •(3) Методы экспертного оценивания

- •28). Методы обработки экспертной информации.

- •29.) Структура системы нечеткой логики

- •30). Нечеткий вывод на основе правила композиции.

- •31). Модель нейрона Мак-Каллока и Питтса. Модель формального нейрона.

- •32).Модель персептрона Розенблата.

- •33) Линейные многослойные нейронные сети

- •34). Радиальные нейронные сети

- •Решение проблемы линейности

- •Обобщенная структура радиальной сети рбф

- •35.Дискретная (Рекурентная) сеть Хопфилда

- •36). Двунаправленная ассоциативная память

- •37) Сеть Хэмминга.

- •38) .Рекурентная сеть Эльмана

- •39). Персептронная сеть с обратной связью rmlp.

- •40).Гибридные нейронные сети. Нейросетевые элементы нечетких систем.

- •Нейросетевая реализация нечетких отношений

- •41). Нейросетевая модель нечеткого композиционного вывода.

- •42). Нечеткие элементы нейросетевых систем

- •43). Семантическое эквивалентирование.

- •44). Задача о диверсификации портфеля ценных бумаг

- •45). Элементы характеризационного анализа

- •Преобразование графа в двудольный

30). Нечеткий вывод на основе правила композиции.

Системы нечеткой логики основаны на нечетких продукционных правилах

А- маленькие

В- большие

Множество чисел

Х= Y=

Y=

А=

B=

31). Модель нейрона Мак-Каллока и Питтса. Модель формального нейрона.

Нейрон – клетка, которая обрабатывает информацию.

Нейронной сетью называется динамическая система, состоящая из совокупности связанных между собой элементарных процессоров, называемых формальными нейронами.

Формальный нейрон – элементарный процессор, используемый в узлах нейронной сети.

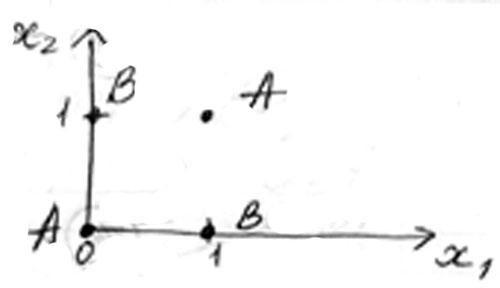

f – функция активации.

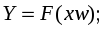

32).Модель персептрона Розенблата.

|

|

0 |

1 |

|

0 |

A |

B |

|

1 |

B |

A |

Линейные персептроны не разрешают проблему линейности, которая делит плоскость на 2 полуплоскости. Двухслойный персептрон:

33) Линейные многослойные нейронные сети

Нейронная сеть – динамическая система, состоящая из совокупности связанных между собой элементарных процессоров, называемых формальными нейронами (элементарный процессор, используемый в узлах нейронной сети).

Многослойные

сети могут образовываться каскадами

слоев. Выход одного слоя является входом

для последующего слоя.

- сигмоида

- сигмоида

Из ассоциативного закона умножения матриц следует, что в случае линейных функций активности можно найти однослойный вариант сети, дающий тот же результат, что и многослойный, но при этом нелинейные проблемы не решаются.

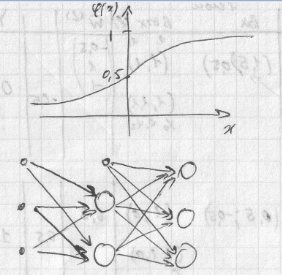

34). Радиальные нейронные сети

х1

х2

1

0

0

I

II

y

φ1

φ2

ci

cj

xj

P1

dj

Можем разбить на сегменты P.

Сеть с радиальными базисными функциями позволяет решить задачу линейности, то есть разбиения плоскости на сегменты с помощью введения нелинейных сегментов.

Путем введения активной функции φ

Матрица весовых коэффициентов:

1.

|

x1 |

x2 |

φ1 |

φ2 |

y |

|

0 |

0 |

0,135 |

1 |

0 |

|

0 |

1 |

0,368 |

0,368 |

1 |

|

1 |

0 |

0,368 |

0,368 |

1 |

|

1 |

1 |

1 |

0,135 |

0 |

2.

3.

4.

Решение проблемы линейности

Имеется P

областей.

(0,135, 1)

В скрытом слое должно быть P нейронов, соединенных связями Wi

Обобщенная структура радиальной сети рбф

+

+

+

+

+

x1

x2

xN

1

φ1

φ2

φ3

φk

W0

W1

W2

Wk

W3

y

X=(x1,...,xN)

Для каждого K

должна реализовываться функция

Использование K скрытых нейронов, соединенных связями с весами Wi с выходными линейными нейронами, означает формирование выходных сигналов путем суммирования взвешенных значений соответствующих базисных функций.

Если возьмем следующую матрицу:

,

,

где

определяет

радиальную функцию с центром в точке

xi

с пришедшим

вектором xj

определяет

радиальную функцию с центром в точке

xi

с пришедшим

вектором xj

,

где j

определяется по числу входных элементов.

,

где j

определяется по числу входных элементов.

d1

d2

dk

...

K