- •1 Информация. Понятие информации. Концепции информации

- •2 Информация. Свойства информации

- •3 Информация. Дополнительные свойства информации

- •4 Информация. Формы сигналов

- •5 Информация. Количество информации, равновероятностные события. Энтропия

- •6 Информация. Количество информации, неравновероятностные события. Энтропия

- •7 Информация. Количество информации, Алфавитный подход к измерению информации

- •8 Кодирование числовой и графической информации

- •9 Кодирование текстовой информации и звука

- •10 Информатика. Меры количества информации

- •11 Основные функции компьютера. Схема работы компьютера

- •12 Команда, схема взаимодействия. Выполнение команды

- •13 Системы счисления (основание, полином, понятие разряда, длина числа)

- •14 Перевод чисел из одной системы счисления в другую

- •15 Перевод чисел из любой системы счисления в десятичную и наоборот

- •16 Перевод чисел из двоичной системы счисления в шестнадцатеричную и наоборот

- •17 Выполнение арифметических операций в различных системах счисления (сдвиг в право, сдвиг влево)

- •18 Прямой код. Обратный код. Назначение и свойства обратного кода

- •19 Дополнительный код. Назначение и свойства дополнительного кода

- •20 Арифметические операции над числами с фиксированной точкой в двоичном коде

- •21 Арифметические операции над числами с плавающей точкой в двоичном коде

- •22 История развития вычислительной техники

- •23 Представление информации в памяти эвм. Представление целых чисел

- •24 Представление информации в памяти эвм. Числа с плавающей точкой

- •25 Основные блоки пк

- •26 Основные функциональные характеристики пк

- •27 Монитор, его характеристики, виды мониторов

- •28 Системный блок, его устройство

- •29 Процессор, устройства, основные параметры

- •30 Клавиатура, принципы работы

- •31 Память компьютера, внутренняя память

- •32 Память компьютера, внешняя память

- •33 Мышь, принцип действия

- •34 Сканеры, основные характеристики, классификация

- •Основные характеристики сканеров.

- •Классификация сканеров.

- •35 Принтеры, основные характеристики, классификация

- •36 Плоттер

- •37 Архитектура эвм, схема устройств

- •38 Архитектура эвм, многопроцессорная архитектура

- •39 Поколения эвм

- •40 Основные понятия программного обеспечения. Классификация программных продуктов по сфере использования

- •41 Категории специалистов, занятых разработкой и эксплуатацией программ

- •42 Классификация программных продуктов по сфере использования. Системное по

- •43 Классификация программных продуктов по сфере использования. Прикладные программы

- •44 Инструментарий технологии программирования. Процесс разработки программ

- •2. Этап проектирования:

- •3. Этап кодирования:

- •4. Этап отладки и тестирования:

- •5. Этап эксплуатации и сопровождения:

- •45 Схема процесса создания загрузочного модуля

- •46 Классификация инструментария технологии программирования

- •47 Локальные средства разработки программ

- •48 Основные принципы построения эвм (по фон Нейману)

- •49 Операционная система. Функции ос

- •50 Организация файловой структуры

- •Fat – таблица размещения файлов.

- •51 Размещение информации на диске (создание файла, каталога) Создание и именование файлов

- •Создание каталогов (папок)

- •52 Fat– таблица размещения файлов fat – таблица размещения файлов.

- •Размещение fat таблицы на гибком диске

- •53 Структура каталога, структура fat- таблицы

- •54 Особенности ос Windows

- •55 Программы оболочки. Назначение и основные возможности

- •56 Основные типы окон ocWindows, их особенности

- •57 Текстовый процессор, его возможности

- •58 Процессор электронных таблиц, его возможности

- •59 Компьютерные вирусы, их характеристика и виды вирусов, основные меры по защите от компьютерных вирусов

- •60 Программы защиты от компьютерных вирусов, виды программ и их характеристики. Основные меры по защите от компьютерных вирусов

3 Информация. Дополнительные свойства информации

Дополнительные свойства информации:

Атрибутивное – это неотрывность информации от физического носителя и языковая природа информации.

Хотя информация неотрывна от физического носителя и имеет языковую природу она не связана жестко ни с конкретным носителем, ни с конкретным языком.

а) Дискретность – содержащаяся в информации сведения и знания дискретны, то есть характеризуют отдельные данные, характерности и свойства конкретных объектов.

б) Непрерывность. Информация имеет свойства сливаться с уже зафиксированной и накопленной ранее, способствуя поступательному развитию и накоплению.

2) Прогматические

а) Включают в себя смысл и новизну, что характеризует перемещение информации в социальных комуникациях, выделяет ту или иную ее часть, которая нова для потребителя.

б) Полезность – информация, уменьшающая неопределенность сведений об объекте.

в) Ценность – Различна для различных потребителей и пользователей.

г) Кумулятивность. Характеризует накопление и хранение информации.

3) Динамическое. Характеризует динамику развития информации во времени.

4 Информация. Формы сигналов

Формы сигналов:

а) Неприрывные(аналоговые). Аналоговым сигналом называется, если его параметр в заданных пределах может принимать любые промежуточные значения.

б) Прерывистые(дискретные). Дискретным называется сигнал, если его параметр в заданных пределах принимает отдельное фиксированное значение. Замена точного значения его приближенной дискретной величиной при условии, что два ближайших дискретных значения могут различаться не на сколь угодно малую величину, а лишь на конкретную минимальную величину квант, называется квантование, обратный процесс, называется сглаживание.

5 Информация. Количество информации, равновероятностные события. Энтропия

Формула Хартли, выведенная из вероятностно-статистического подхода К.-Э. Шеннона N=2i, i=log2N, где i – количество информации (в битах), N – количество информационных сообщений (событий). В одном случае рассматриваются равновероятностные события, в другом – мощность алфавита.

Количеством информации называют числовую характеристику сигнала, отражающую степень неопределенности, которая исчезает после получения данного сигнала. Эту меру неопределенности к теории информации называют энтропия.

Энтропия – мера внутренней неупорядоченности системы.

Уменьшая неопределенность мы получаем информацию.

6 Информация. Количество информации, неравновероятностные события. Энтропия

Для

не равновероятностных событий применяют

следующую формулу:![]() ,

где I-это количество информации, р-

вероятность события.

,

где I-это количество информации, р-

вероятность события.

Вероятность события выражается в долях единицы и вычисляется по формуле: р=К/N, где К- величина, показывающая , сколько раз произошло интересующее событие, N –общее число возможных исходов какого-то процесса.

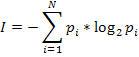

Существует

общая формула вычисления количества

информации для событий с различными

вероятностями. Эту формулу в 1948 г.

Предложил американский учёный Клод

Шеннон. Количество информации в этом

случае вычисляется по формуле:

где

I-

количество информации;

где

I-

количество информации;

N- количество возможных событий4

Рi-вероятность отдельных событий.

Количеством информации называют числовую характеристику сигнала, отражающую степень неопределенности, которая исчезает после получения данного сигнала. Эту меру неопределенности к теории информации называют энтропия.

Энтропия – мера внутренней неупорядоченности системы.

Уменьшая неопределенность мы получаем информацию. \