- •1. Предмет и метод статистики

- •1.1 Возникновение и определение статистики

- •1.2. Предмет статистики и особенности статистики как науки

- •1.3. Статистические закономерности

- •1.4. Признаки

- •1.5. Метод статистики

- •1.6. Организация государственной статистики в рф

- •2. Средние величины

- •3. Статистическое наблюдение

- •3.1. Понятие статистического наблюдения. Этапы его проведения

- •3.2. Методологические вопросы статистического наблюдения

- •3.3. Основные организационные формы, виды и способы статистического наблюдения

- •Статистическое наблюдение

- •3.4. Статистическая отчетность

- •3.5. Требования, предъявляемые к данным стат. Наблюдения

- •3 Этап сн: подготовка данных к обработке

- •4. Вариационные ряды и их характеристика

- •4.1. Вариация массовых явлений

- •4.2. Построение вариационного ряда. Виды рядов. Ранжирование данных

- •4.3. Определение числа групп и величины интервала

- •4.4. Плотность распределения

- •4.5. Графическое изображение вариационного ряда

- •4.6. Структурные средние

- •Мода распределения

- •Медиана распределения

- •4.7. Другие структурные характеристики вариационного ряда Квартили и децили распределения

- •4.8. Показатели размера и интенсивности вариации

- •4.9. Свойства дисперсии и способы ее расчета

- •4.10. Дисперсия альтернативного признака

- •4.11. Виды дисперсий и правило их сложения

- •4.12. Закономерности распределения

- •4.13. Закон нормального распределения

- •4.14. Моменты распределения

- •4.15. Асимметрия распределения

- •4.16. Эксцесс распределения

- •5. Статистическая сводка. Группировка данных наблюдений. Таблицы

- •5.1. Статистическая сводка

- •5.2. Группировка данных

- •5.3. Определение числа групп и величины интервалов

- •5.4. Виды группировок

- •Типологические группировки

- •Структурные группировки

- •Аналитические группировки

- •5.5. Классификации

- •5.6. Сопоставимость статистических группировок

- •5.7. Статистические таблицы

- •6. Выборочное наблюдение и его организация

- •6.1. Выборочное наблюдение. Принципы теории выборки

- •6.2. Ошибки репрезентативности. Ошибки выборки

- •6.3. Определение необходимого объема выборки

- •6.4. Виды отбора единиц в выборочную совокупность

- •6.5. Малая выборка

- •6.6. Моментные наблюдения

- •7. Статистические показатели

- •7.1. Сущность статистических показателей

- •Границы объекта:

- •Статистический показатель

- •7.2. Классификация статистических показателей

- •7.3. Абсолютные показатели

- •7.4. Относительные показатели

- •8. Статистические методы изучения взаимосвязи между явлениями

- •8.1. Понятие корреляционной зависимости

- •8.2. Методы выявления корреляционной связи

- •Метод группировок

- •8.3. Изучение связи между двумя атрибутивными (качественными, описательными) признаками

- •8.4. Измерение связи по таблицам взаимной сопряженности

- •8.5. Измерение тесноты связи между порядковыми переменными

- •8.6. Показатели тесноты связи между двумя количественными признаками

- •Линейный коэффициент корреляции

- •8.7. Определение уравнения регрессии между двумя переменными

- •8.8. Теоретическое корреляционное отношение

- •8.9. Множественная корреляция

- •9. Ряды динамики

- •9.1. Понятие о рядах динамики. Их виды

- •9.2. Сопоставимость уровней ряда.

- •9.3. Основные показатели рядов динамики

- •Методы выявления основной тенденции в рядах динамики

- •Выявление и измерение сезонных колебаний

- •Измерение колеблемости в рядах динамики

- •Автокорреляция в рядах динамики

- •Определение уравнения авторегрессии

- •Элементы прогнозирования

- •10. Виды и способы построения индексов

- •10.1. Понятие об индексах. Их виды

- •10.2. Агрегатные индексы

- •1. Агрегатный индекс физического объема.

- •2. Агрегатный индекс цен

- •10.3. Средние индексы из индивидуальных

- •1. Индекс физического объема

- •2. Индекс цен

- •10.4. Индексы переменного и постоянного составов. Индекс структурных сдвигов

- •Iпост .

- •10.5. Цепные и базисные индексы

- •10.6. Определение роли отдельных факторов в динамике результативных показателей

- •10.7. Территориальные индексы

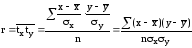

8.6. Показатели тесноты связи между двумя количественными признаками

Связь между количественными признаками измеряется через их вариацию. Измерить зависимость (связь) между двумя коррелируемыми величинами – значит определить, насколько вариация результативного признака обусловлена вариацией факторного признака.

В качестве показателей тесноты связи между количественными признаками, кроме коэффициента Фехнера, наиболее часто используются линейный коэффициент корреляции, коэффициент корреляции рангов, коэффициент конкордации, а также эмпирическое и теоретическое корреляционное отношение.

Линейный коэффициент корреляции

Линейный коэффициент корреляции r применяется для оценки тесноты связи при линейной зависимости.

Как и коэффициент

Фехнера, линейный коэффициент вариации

может быть построен на основе отклонений

индивидуальных значений признаков

и

и от их средних величин. Но в отличие от

коэффициента Фехнера в линейном

коэффициенте корреляции учитываются

не только знаки, но и значения отклонений

(х–

от их средних величин. Но в отличие от

коэффициента Фехнера в линейном

коэффициенте корреляции учитываются

не только знаки, но и значения отклонений

(х– )

и (y–

)

и (y– ).

Чтобы обеспечить соизмеримость отклонений

признаков

).

Чтобы обеспечить соизмеримость отклонений

признаков и

и по абсолютным размерам и единицам

измерения, рассчитывают их нормированные

отклонения:tx

= (x–

по абсолютным размерам и единицам

измерения, рассчитывают их нормированные

отклонения:tx

= (x– )/x;

ty

= (y–

)/x;

ty

= (y– )/y

,

)/y

,

где x, y – средние квадратические отклонения признаков х и y.

Линейный коэффициент

корреляции представляет собой среднюю

величину из произведения нормированных

отклонений по обоим признакам:

.

.

Числитель последней

формулы, деленный на

,

представляет собой среднее произведение

отклонений значений двух признаков от

их средних, называемое ихковариацией:

,

представляет собой среднее произведение

отклонений значений двух признаков от

их средних, называемое ихковариацией:

Следовательно,

можно сказать, что линейный коэффициент

корреляции представляет собой частное

от деления ковариации между

и

и на произведение их средних квадратических

отклонений.

на произведение их средних квадратических

отклонений.

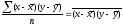

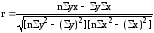

Для упрощения расчетов линейного коэффициента корреляции пользуются преобразованной формулой:

.

.

Линейный коэффициент

вариации можно рассчитать и по формуле:

,

,

где

- коэффициент регрессии в уравнении

связи (см. ниже).

- коэффициент регрессии в уравнении

связи (см. ниже).

Коэффициент

корреляции принимает значения от -1 до

+1, показывая не только тесноту, но и

направление связи. Знак "+" указывает

на прямую зависимость между результативным

и факторным признаками, знак «–» – на

обратную зависимость между ними. Если

r=0, то связь между признаками отсутствует.

Чем ближе r к единице, тем теснее связь

между рассматриваемыми признаками.

Если

,

то это означаетфункциональную

зависимость между

,

то это означаетфункциональную

зависимость между

и

и .

.

8.7. Определение уравнения регрессии между двумя переменными

Применение корреляционно-регрессионного метода анализа явлений начнем с оценки парной корреляции и построения однофакторной модели зависимости результативного признака от факторного в виде уравнения корреляционной связи. Уравнение корреляционной связи часто называют уравнением регрессии, показывающим вид зависимости среднего значения результативного признака от факторного.

Определить уравнение регрессии – значит по эмпирическим данным математически описать изменения взаимно коррелируемых величин.

Уравнение регрессии можно назвать теоретической линией регрессии. Рассчитанные по уравнению регрессии значения результативного признака называются теоретическими.

Аналитическая связь между результативным и факторным признаками может описываться уравнениями:

прямой

a0

+ a1x

;

a0

+ a1x

;

гиперболы

a0

+ a1/x

;

a0

+ a1/x

;

параболы

порядка

порядка a0

+ a1x

+a2x2

;

a0

+ a1x

+a2x2

;

степенной функции  и т.д.

и т.д.

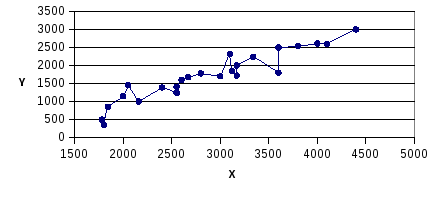

Прежде чем приступить к построению модели – уравнения регрессии, необходимо выбрать тип функции, т.е. форму корреляционной связи. Определить в каждом конкретном случае тип функции, с помощью которой можно наиболее адекватно отразить ту или иную зависимость между признаками – одна из основных задач регрессионного анализа.

Некоторые данные о форме связи можно получить из графика эмпирической линии регрессии. Если на корреляционном поле соединить точки отрезками прямой, то получится ломаная линия с некоторой тенденцией к росту или снижению, которая и называется эмпирической линией регрессии. На рис. 8.1 представлена в качестве примера эмпирическая линия регрессии заработной платы работников предприятия от их производительности труда.

y

y

Рис. 8.1. График корреляционной зависимости заработной платы (y)

и производительности труда (x)

Изломы эмпирической линии регрессии y обусловлены тем, что на результативный показатель оказывают влияние кроме х другие факторы. Если отвлечься (абстрагироваться) от влияния других факторов, кроме х, то можно сделать вывод о виде аналитической функции yx, в определенной степени отражающей характер зависимости между y и х. В данном случае можно склониться к прямолинейной форме связи.

После выбора вида зависимости приступают к расчету параметров аналитического уравнения корреляционной связи (уравнения регрессии).

Параметры находят на основе метода наименьших квадратов.

Метод

наименьших квадратов

заключается в минимизации квадратов

отклонений фактических данных y

от теоретических

(выравненных по уравнению регрессии):

(выравненных по уравнению регрессии): .

.

Для нахождения

параметров уравнения

прямой

=

а0+а1х

используется система нормальных

уравнений вида

=

а0+а1х

используется система нормальных

уравнений вида

a0n+a1x=y,

a0x+a1x2=xy,

где n – объем исследуемой совокупности (число единиц наблюдения).

Решение этой системы относительно а0 и а1 позволяет определить параметры уравнения регрессии:

;

;

.

.

Параметр

в уравнении линейной регрессии называетсякоэффициентом

регрессии.

в уравнении линейной регрессии называетсякоэффициентом

регрессии.

Коэффициент регрессии показывает, на сколько (в абсолютном выражении) изменяется значение результативного признака при изменении факторного признака на единицу.

По уравнению

регрессии можно найти выровненные

теоретические значения результативного

признака при соответствующих значениях

фактора х. Отклонения фактических

значений y от теоретических

обусловлены тем, что регрессия y строилась

только по одному фактору х, в то время

как в действительности y зависит от

множества факторов.

обусловлены тем, что регрессия y строилась

только по одному фактору х, в то время

как в действительности y зависит от

множества факторов.