- •Введение

- •Информация, сообщения, сигналы

- •Блок-схема передачи информации

- •Краткая история и примеры устройств передачи различных сообщений

- •Классификация сигналов

- •Количество информации дискретных сообщений

- •6.1 Свойства энтропии источника

- •6.1.1 Энтропия максимальна и равна:

- •6.1.2 Энтропия есть величина вещественная и неотрицательная, а так же ограниченная.

- •6.1.4 Энтропия есть величина вещественная и неотрицательная, а так же ограниченная.

- •6.2 Двоичный дискретный источник

- •Количество информации непрерывных сообщений

- •Статистически зависимые источники сообщений

- •Практические приложения теории информации

- •9.1 Сигнал и аддитивная помеха

- •9.2 Кодирование дискретных сообщений

- •9.3 Эффективное первичное кодирование

- •9.2.1 Метод укрупнения алфавита

- •9.2.2 Методы статистического кодирования

- •9.2.3 Кодирование в биологических структурах

- •Курсовая работа по теории информации

6.1 Свойства энтропии источника

6.1.1 Энтропия максимальна и равна:

Для

доказательства этого воспользуемся

методом неопределенных множителей

Лагранжа. С учетом условия нормировки,

когда

и, полагая

,

найдем экстремум функционала следующего

вида:

и, полагая

,

найдем экстремум функционала следующего

вида:

(7)

(7)

Дифференцируя

по

![]() ,

и приравнивая производные нулю, получаем

,

и приравнивая производные нулю, получаем

(8)

(8)

Отсюда

следует, что

и не зависит от номера

и не зависит от номера

,

что может быть только при равенстве

всех

,

что может быть только при равенстве

всех

,

а значит

,

а значит

.

.

Подставляя эту величину, вычислим:

(9)

(9)

Утверждение 6.1.1 доказано!

6.1.2 Энтропия есть величина вещественная и неотрицательная, а так же ограниченная.

Первые

два утверждения следуют из определения

энтропии и очевидного неравенства:

Для

доказательства третьего рассмотрим

слагаемое

.

При

.

При

результат очевиден. При

результат очевиден. При

имеем

имеем

.

Раскроем неопределенность по правилу

Лопиталя, положив

:

.

Раскроем неопределенность по правилу

Лопиталя, положив

:

(10)

(10)

Утверждение 6.1.2 доказано!

6.1.3 Энтропия максимальна и равна: Hmax = logb N

Для доказательства этого воспользуемся методом неопределенных множителей Лагранжа.

С учетом условия нормировки, когда , и, полагая b = e, найдем экстремум функционала следующего вида:

(11)

Фактически, мы должны найти значение лямбда, при котором определенный функционал будет иметь точку экстремума.

Дифференцируя по pi, и приравнивая производные к нулю, получаем:

(12)

(12)

Отсюда следует, что и не зависит от номера i, что может быть только при равенстве всех pi, а значит pi = 1/N.

Подставляя эту величину, вычислим:

(13)

Энтропия как среднее значение количества информации будет равна данному выражению.

Мы доказали, что энтропия максимальна в том случае, когда все события равновероятны и при этом энтропия равна логарифму от числа всех возможных сообщений.

6.1.4 Энтропия есть величина вещественная и неотрицательная, а так же ограниченная.

Первые два утверждения следуют из определения энтропии как среднего значения и очевидного неравенства: 0 ≤ pi ≤ 1.

Для доказательства третьего рассмотрим слагаемое – pi ∙ logb pi

При pi = 1 результат очевиден и равен 0.

При pi → 0 имеем: – 0 ∙ logb 0=0 ∙ logb ∞

Получаем неопределенность и запишем с изменением знака данное выражение.

Раскроем неопределенность по правилу Лопиталя, положив b = e:

(14)

(14)

Согласно правилу Лопиталя, для нахождения предела переходим к рассмотрению отношения предела первых производных. После преобразований убеждаемся, что и в этом случае значение энтропии равно нулю.

Таким образом, имеем важные характеристики для энтропии, а именно, энтропия вещественна, неотрицательна, ограничена.

Исследуя

свойства энтропии, интересно рассмотреть,

как ведут себя элементы, входящие в

состав суммы, определяющей энтропию. А

именно как ведет себя выражение

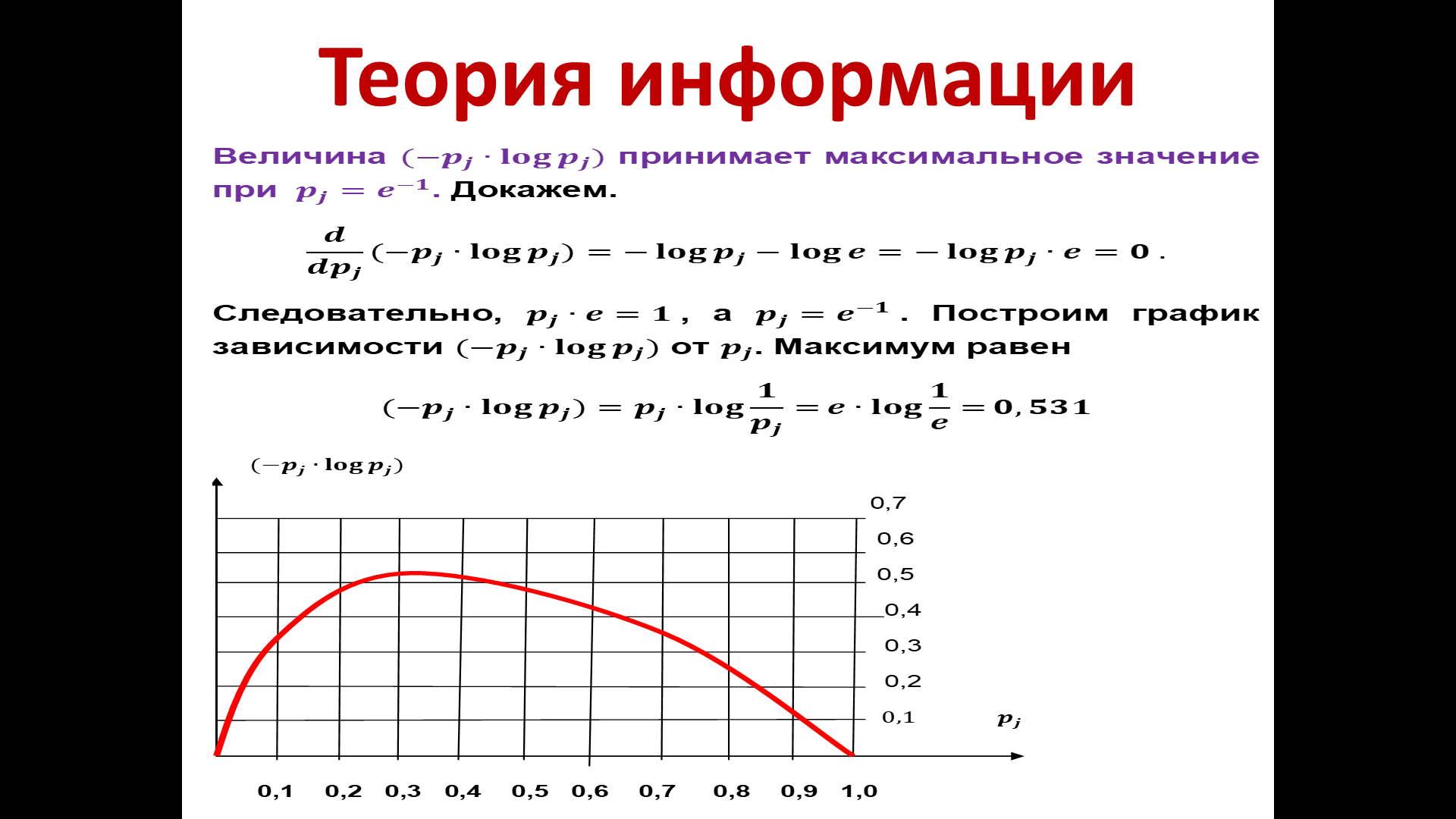

6.1.5 Докажем, что величина (– pj ∙ log pj) принимает максимальное значение при pj = e – 1

Доказательство простое - возьмем производную от этого выражения и приравняем к нулю.

(15)

(15)

Вывод:

и, следовательно, pj

= e

– 1

и, следовательно, pj

= e

– 1

Для

наглядности построим график зависимости

этого произведения(–

pj

∙ log

pj)

от

.

.

Рисунок 14 - График зависимости произведения (– pj ∙ log pj) от .

Свой максимум выражение достигает при pj = e – 1

Максимум равен:

Данные исследования интересны тем, что изучая источники сообщений, мы понимаем, при каких условиях получаем определенные значения энтропии и при каких условиях она максимальна.