- •Глава 1. Теория вероятностей 3

- •1.2 Перестановки, размещения и сочетания

- •§2. Классическое определение вероятности

- •2.1 Определение и примеры

- •2.2 Критика классического определения

- •§3. Дискретное вероятностное пространство

- •§4. Геометрическая вероятность

- •§5. Парадоксы Бертрана

- •§6. Аксиоматика Колмогорова

- •6.1 Аксиомы событий

- •6.2 Аксиомы вероятности

- •6.3 Свойства вероятности

- •§7. Условная вероятность. Независимость

- •§8. Формула полной вероятности. Формула Байеса

- •§9. Схема Бернулли

- •9.1 Основные определения и примеры

- •9.2 Предельные теоремы в схеме Бернулли

- •§10. Случайные величины и их распределения

- •10.1 Введение

- •10.2 Функция распределения случайной величины

- •10.3 Наиболее употребительные распределения. Замена переменных

- •§11. Распределение случайного вектора (совместное распределение)

- •11.1 Основные определения

- •11.2 Плотность распределения случайного вектора при замене переменных

- •§12. Математическое ожидание случайной величины

- •12.1 Основные определения

- •12.2 Интеграл Лебега (интеграл по вероятностной мере)

- •12.3 Свойства математического ожидания

- •§13. Дисперсия случайной величины

- •§14. Примеры вычисления математического ожидания и дисперсии

- •§15. Производящие функции

- •15.1 Основные определения

- •15.2 Свойства

- •15.3 Примеры задач

- •§15. Коэффициент корреляции

- •§16. Многомерное нормальное распределение

- •16.1 Основные определения

- •16.2 Плотность распределения двумерного нормального вектора

- •16.3 Примеры задач

- •§17. Неравенство Чебышева

- •19.2 Закон больших чисел Бернулли

- •§20. Характеристические функции

- •20.1 Определение и свойства

- •20.2 Примеры

- •§21. Центральная предельная теорема

- •21.1 Доказательство цпт

- •21.2 Усиление закона больших чисел (збч Хинчина)

- •§22. Типичные задачи

- •§23. Условное математическое ожидание

- •23.1 Основные определения

- •23.2 Методы вычисления. Примеры

- •23.2.1 Дискретный случай

- •23.2.2 Непрерывный случай

- •23.3 Свойства

- •23.4 Исследование нормального случайного вектора

- •§24 Цепи Маркова

- •24.1 Основные определения. Формула Чепмена–Колмогорова

- •24.2 Классификация состояний

- •24.3 Период марковской цепи

- •24.4 Предельная теорема для переходных вероятностей марковских цепей

- •24.5 Возвратность цепей Маркова

- •§25 Типичные задачи, 2

§25 Типичные задачи, 2

Теория: Доказать критерий возвратности для цепей Маркова.

Обозначим через fnвероятность вернуться в состояниеiнаn-м шаге при условии, что на предыдущих шагах возврата не произошло:

![]() .

.

Тогда для возвратного состояния iсправедливо

![]() .

.

Введем un — вероятность находиться вi-м состоянии наn-м шаге:

![]() .

.

Запишем производящие функции

![]() .

.

Если

![]() ,

оба ряда сходятся, т.к.fn,un≤ 1.

,

оба ряда сходятся, т.к.fn,un≤ 1.

Заметим, что для возвратного состояния

![]()

Легко проверить следующий факт:

![]() .

.

(он вытекает из формулы полной вероятности. Вероятность вернуться в i-е состояние наn-м шаге равна вероятности впервые вернуться (заnшагов), либо вернуться заn−1 шагов и один шаг находиться вi-м состоянии и т.д.)

Отсюда следует (по формуле умножения рядов), что

![]() т.е.

т.е.![]() .

.

Следовательно,

![]()

Теперь устремим z→

1. Если цепь возвратна, тоF(z)

→ 1, аU(z)

→ ∞. Но приz→1U(z)

имеет вид![]() .

И наоборот, если ряд изunрасходится, то знаменатель 1 –F(z)

равен нулю, и цепь возвратна.

.

И наоборот, если ряд изunрасходится, то знаменатель 1 –F(z)

равен нулю, и цепь возвратна.

Теория: условное математическое ожидание и условное распределение одного подвектора нормального вектора относительно другого.

Дан вектор

![]() ,

,

где xиy— подвектора вектораz. Условное математическое ожидание одного подвектора относительно другого:

![]() ,

,

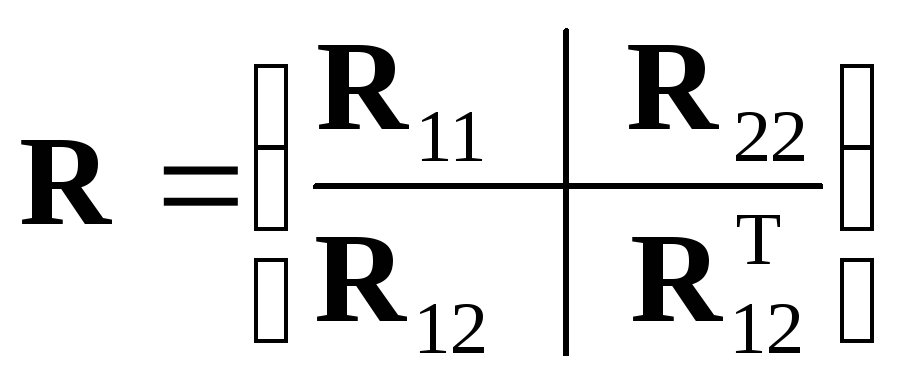

где Ey— матожиданиеy,Ex— матожиданиеx,R— блочная ковариационная матрица:

.

.

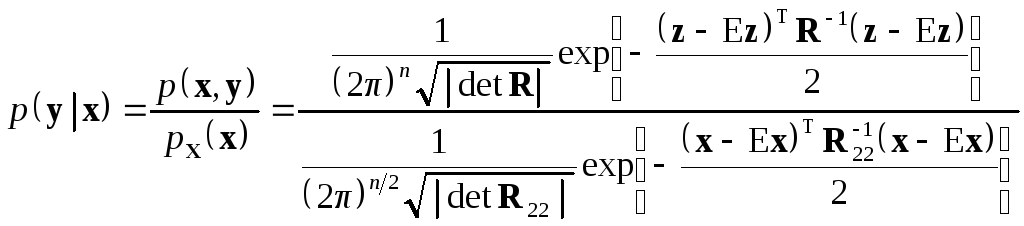

Условное распределение

.

.

Теория: многомерный нормальный вектор

По определению, если X0— стандартный многомерный нормальный вектор, тоX=AX0+b(вектор, полученный аффинным преобразованием12X0).

![]() ,

,

где EX— вектор математических ожиданий,R— ковариационная матрица,n— размерность вектора.

Теория: свойства производящих функций

![]()

1)

![]() .

.

2)

![]() .

.

3)

![]()

![]()

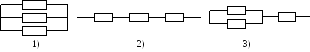

Задача: даны 3 электрические цепи:

Вероятность выхода из строя каждого их приборов равна p= 0,1.

Найти вероятность того, что хотя бы одна из цепей проводит ток.

Решение.

![]() .

.

Задача: игральная кость бросается до первого четного числа очков.X— количество бросков. Найти производящую функцию, математическое ожидание и дисперсию.

Решение. Производящая функция

![]()

Математическое ожидание:

![]()

Дисперсия:

![]()

![]()

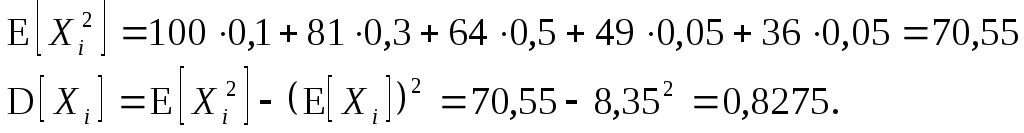

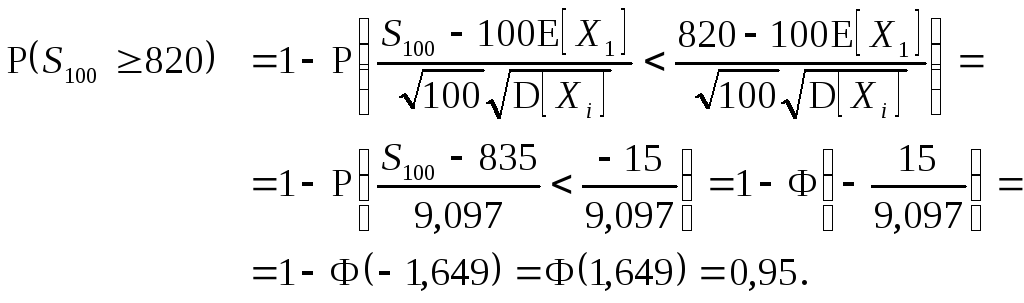

Задача: при выстрелах по мишени вероятность попасть в «десятку» равна 0,1, в 9 — 0,3, в 8 — 0,5, в 7 — 0,05, в 6 — 0,05. Сделано 100 выстрелов. Какова вероятность того, что стрелок набрал не менее 820 очков?

Решение. Введем случайную величинуXi — количество очков, набранных стрелком наi-м шаге. Ее ожидаемое значение

![]() .

.

Найдем дисперсию:

Суммарное количество очков равно

![]() .

.

Искомая вероятность по ЦПТ

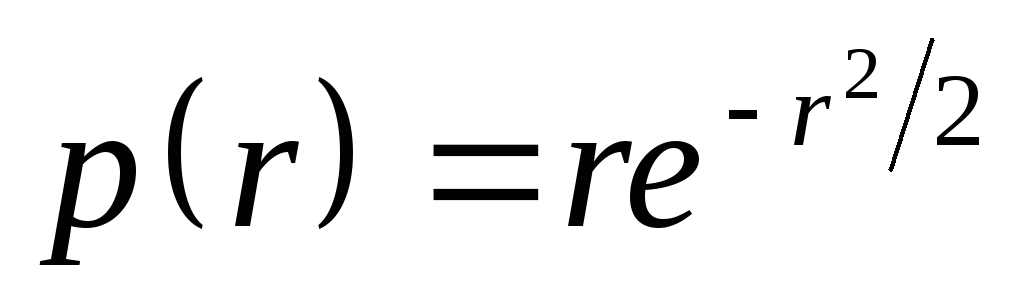

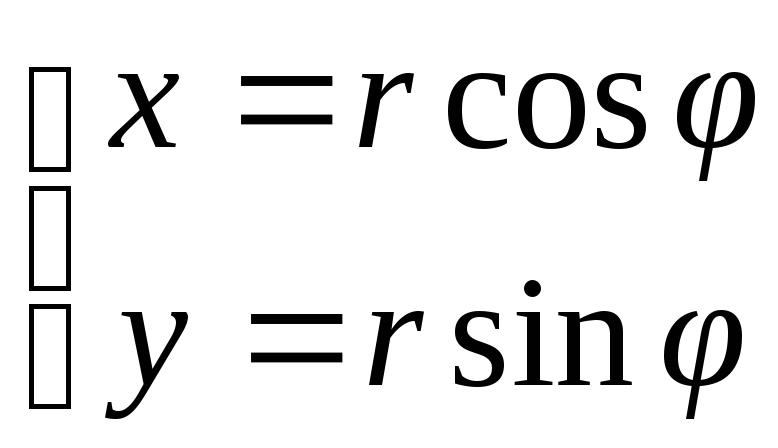

Задача: Корабельная пушка с равной вероятностью может выстрелить в любом направлении. Дальность полета не зависит от направления и распределена с плотностью

.

Найти двумерную плотность распределения

координат (X,Y)

падения снаряда.

.

Найти двумерную плотность распределения

координат (X,Y)

падения снаряда.

Решение. Это задача на преобразование случайных векторов. Поскольку расстояниеrне зависит от углаφ, плотность совместного распределения равна

![]() .

.

Выполним преобразование

,

,

его якобиан, как известно, равен r. Нам потребуется якобиан обратного преобразования — он равен 1/r. Получим для новой плотности распределения:

![]()

Таким образом, координаты независимы между собой, и каждая имеет стандартное нормальное распределение.

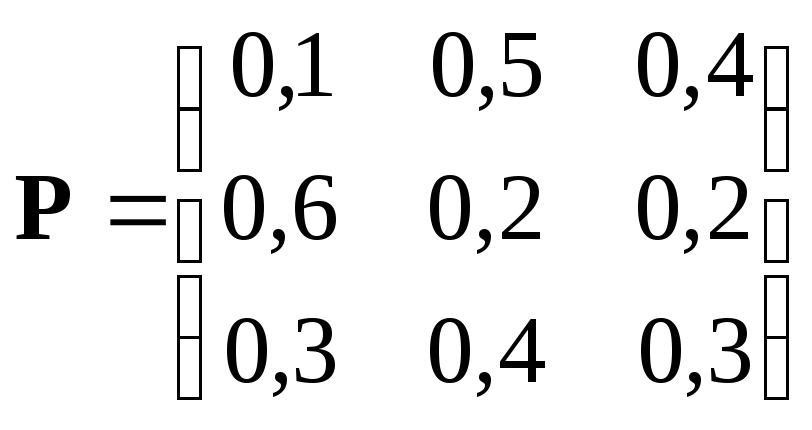

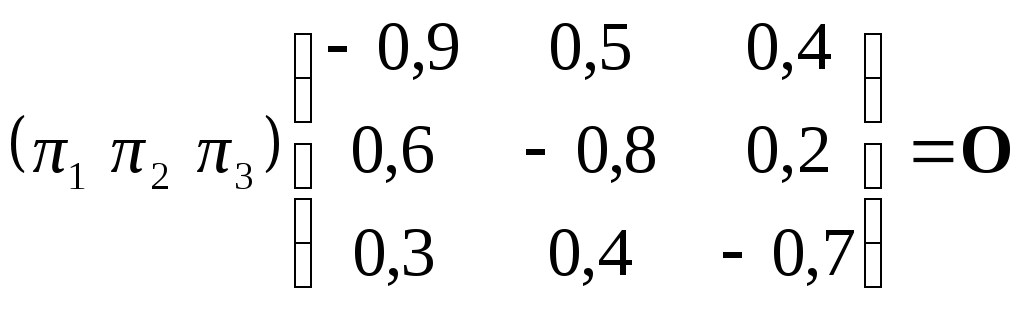

Задача: имеется Марковская цепь с матрицей

.

.

Найти предельное распределение перехода за nшагов (т.е., стационарное распределение).

Решение. Обозначим стационарное

распределение за![]() ,

тогда справедливо

,

тогда справедливо

![]() ,

,

где Oесть нулевая матрица. Упрощаем:

,

,

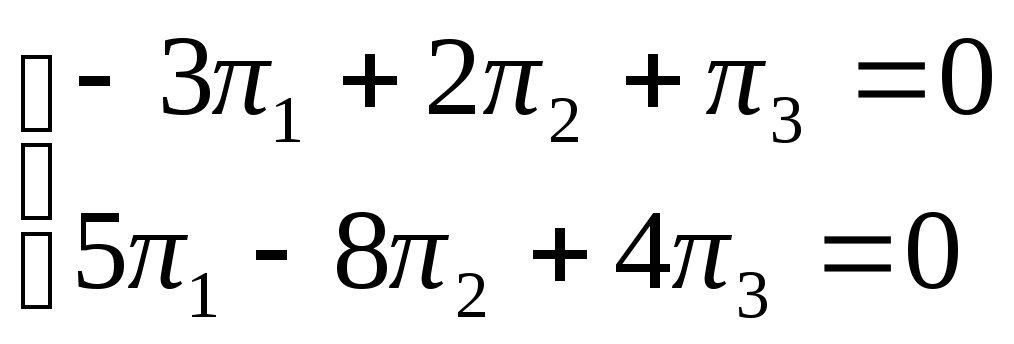

что равносильно системе уравнений

,

,

откуда

.

.

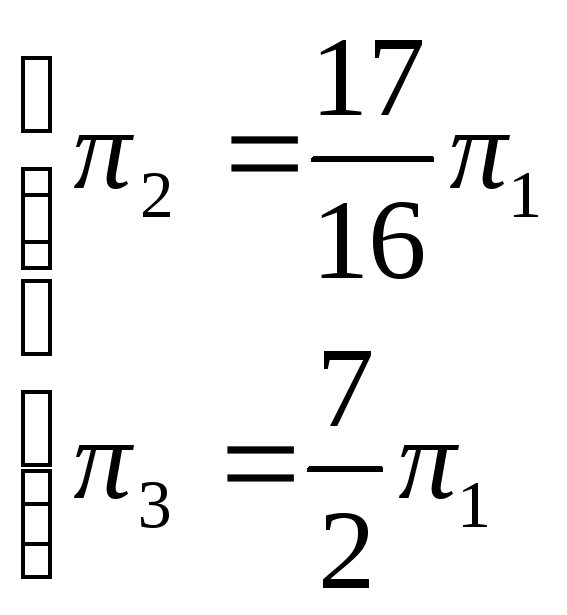

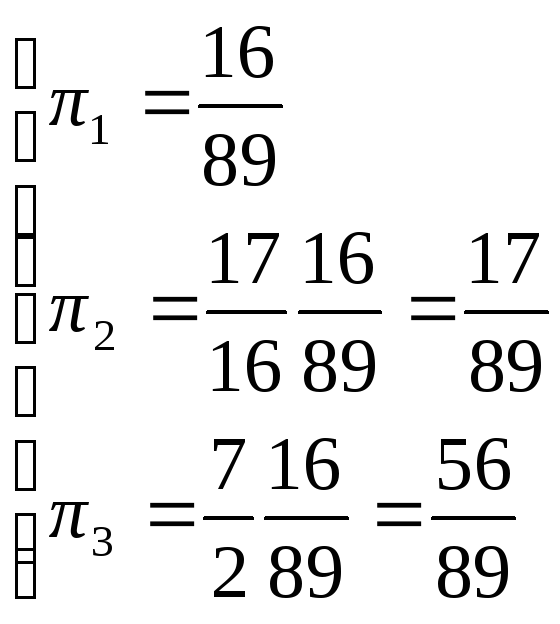

Поскольку

![]() есть распределение, то

есть распределение, то![]() ,

т.е.,

,

т.е.,

![]() .

.

Окончательно получаем:

.

.

1Т.е., вероятность каждого события равна 1/n.

2Из предыдущего §.

3То есть, операции над множествами.

4В том числе и конечное.

5Можно очевидным образом обобщить это

определение наnсобытий. СобытияA1,A2,

…,Anназываются взаимно независимыми, если

для любого множества индексов![]() выполняется равенство:

выполняется равенство:

![]() .

.

6Разумеется, справедливо и обобщение. Более того, одним из экзаменационных заданий является доказательство этого факта для большего числа событий.

7Мы используем дискретное определение вероятности.

8Применяется, когда вероятность успехаpвесьма мала (порядка 1/n), аλ< 10.

9Имеет стандартное нормальное распределение. Далее будем обозначать нормальное распределение с параметрамиaиσкакN(a,σ), а равномерное с параметрамиaиb— какU(a,b).

10Почему берется квадрат отклонения? Потому чтоE[X–EX] =EX–E[EX] =EX–EX= 0 («приращения и убыли значений случайной величины по сравнению с ожидаемым значением взаимно уничтожаются»). А модуль отклонения брать неудобно.

11Это условие излишне, так как следует из первого. Однако с таким допущением доказательство становится проще.

12Невырожденным.