- •Глава 1. Теория вероятностей 3

- •1.2 Перестановки, размещения и сочетания

- •§2. Классическое определение вероятности

- •2.1 Определение и примеры

- •2.2 Критика классического определения

- •§3. Дискретное вероятностное пространство

- •§4. Геометрическая вероятность

- •§5. Парадоксы Бертрана

- •§6. Аксиоматика Колмогорова

- •6.1 Аксиомы событий

- •6.2 Аксиомы вероятности

- •6.3 Свойства вероятности

- •§7. Условная вероятность. Независимость

- •§8. Формула полной вероятности. Формула Байеса

- •§9. Схема Бернулли

- •9.1 Основные определения и примеры

- •9.2 Предельные теоремы в схеме Бернулли

- •§10. Случайные величины и их распределения

- •10.1 Введение

- •10.2 Функция распределения случайной величины

- •10.3 Наиболее употребительные распределения. Замена переменных

- •§11. Распределение случайного вектора (совместное распределение)

- •11.1 Основные определения

- •11.2 Плотность распределения случайного вектора при замене переменных

- •§12. Математическое ожидание случайной величины

- •12.1 Основные определения

- •12.2 Интеграл Лебега (интеграл по вероятностной мере)

- •12.3 Свойства математического ожидания

- •§13. Дисперсия случайной величины

- •§14. Примеры вычисления математического ожидания и дисперсии

- •§15. Производящие функции

- •15.1 Основные определения

- •15.2 Свойства

- •15.3 Примеры задач

- •§15. Коэффициент корреляции

- •§16. Многомерное нормальное распределение

- •16.1 Основные определения

- •16.2 Плотность распределения двумерного нормального вектора

- •16.3 Примеры задач

- •§17. Неравенство Чебышева

- •19.2 Закон больших чисел Бернулли

- •§20. Характеристические функции

- •20.1 Определение и свойства

- •20.2 Примеры

- •§21. Центральная предельная теорема

- •21.1 Доказательство цпт

- •21.2 Усиление закона больших чисел (збч Хинчина)

- •§22. Типичные задачи

- •§23. Условное математическое ожидание

- •23.1 Основные определения

- •23.2 Методы вычисления. Примеры

- •23.2.1 Дискретный случай

- •23.2.2 Непрерывный случай

- •23.3 Свойства

- •23.4 Исследование нормального случайного вектора

- •§24 Цепи Маркова

- •24.1 Основные определения. Формула Чепмена–Колмогорова

- •24.2 Классификация состояний

- •24.3 Период марковской цепи

- •24.4 Предельная теорема для переходных вероятностей марковских цепей

- •24.5 Возвратность цепей Маркова

- •§25 Типичные задачи, 2

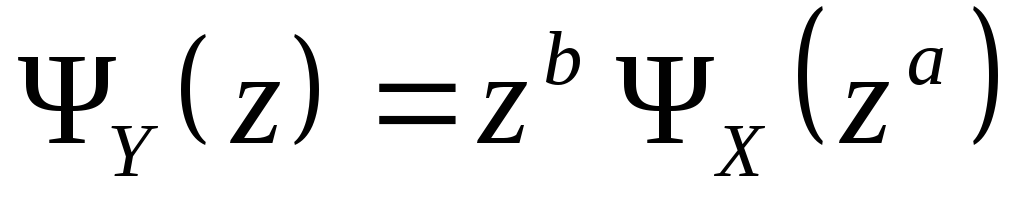

§15. Производящие функции

15.1 Основные определения

Иногда для вычисления математических ожиданий степеней случайной величины X(центральных моментоввеличиныX) бывает удобно использоватьпроизводящие функции.

Пусть некоторая случайная величина Xпринимает лишь целые неотрицательные значения. Тогдапроизводящей функциейтакой величины называют функцию

![]() .

.

Такая функция существует для всех

![]() ,

так как

,

так как

![]() .

.

На самом деле (доказывать мы этого не будем), Ψ(z) — аналитическая функция, и, стало быть, можно интегрировать и дифференцировать ряд почленно.

15.2 Свойства

Согласно формуле для коэффициентов степенного ряда,

![]() .

.

Отсюда следует важный факт: производящая функция однозначно определяет случайную величину, т.к. все pnопределены однозначно.

Доказательство. По правилу дифференцирования степенных рядов,

![]() .

.

По правилу дифференцирования степенных рядов,

![]() .

.

Отсюда легко видеть, что при z= 1

![]() .

.

В частности,

![]()

Точно таким же способом можно находить произвольные моменты случайной величины.

При линейном преобразовании Y=aX+b:

.

.

Доказательство.

![]() .

.

Если X,Y — независимые случайные величины, то

.

.

Доказательство.

![]() .

.

15.3 Примеры задач

Ψ(z) = 1/4 (1 +z)2. Найти распределение случайной величиныX.

Решение.

Несимметричная монета бросается до первого выпадения орла. Вероятность выпадения орла P(X= 1) =p, решки —P(X= 0) =q= 1 –p.Y — число бросков. ВычислитьEY, DY, ΨY.

Решение.

Случайная величина Xимеет распределение Пуассона с параметромλ:

![]()

Найти Ψ(z), первые три момента и доказать, что сумма независимых случайных величин с одинаковым распределением Пуассона также будет иметь распределение Пуассона.

Решение.

Теперь выполним доказательство. Рассмотрим производящую функцию для суммы 2 независимых случайных величин XиY:

![]() .

.

Вывод: сумма тоже имеет распределение Пуассона, но с параметромλ. Заметим, что также нетрудно доказать (по индукции), что сумма изnслагаемых, имеющих одинаковое распределение Пуассона с параметромλ, имеет распределение Пуассона с параметромnλ.

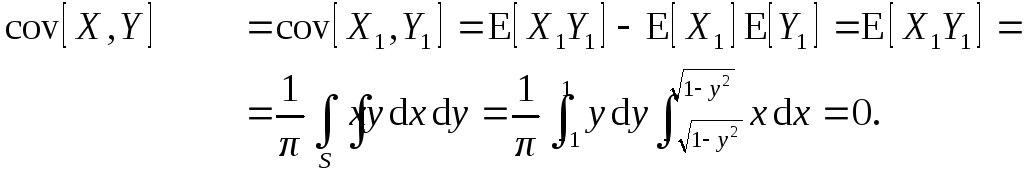

§15. Коэффициент корреляции

Для двух случайных величин XиYвведемковариацию cov[X,Y] — меру зависимости между ними:

cov[X, Y] = E[(X − EX)(Y – EY)].

Свойства ковариации

Инвариантность к сдвигу:

cov[X − a, Y − b] = cov[X, Y], a, b = const.

Доказательство.

cov[aX, bY] = ab cov[X, Y].

Доказательство. Сначала упростим запись ковариации:

Полученное выражение несколько более понятно, чем определение ковариации. Действительно, если две случайные величины независимы, математическое ожидание их произведения равно произведению математических ожиданий (следовательно, ковариация равна нулю).

Теперь произведем замену /.{X→aX,Y→bY}, тогда

![]()

cov[X, Y] = E[XY] – E[X] E[Y]. См. доказательство в пункте 2).

Если X,Y— независимые случайные величины,cov[X,Y] = 0. С учетом 3)

Доказательство.cov[X,Y] =E[XY] –E[X] E[Y] =E[X] E[Y] –E[X] E[Y] = 0.

Внимание! Обратное неверно. Существуют зависимые случайные величины, для которыхcov[X,Y] = 0. Например, возьмем X ~ N(0,1), Y = X 2. Тогда

Результат 0 получился из-за того, что под знаком интеграла стоит нечетная функция. Совершенно очевидно, что XиY— зависимые величины. Тем не менее их ковариация равна нулю.

Важное свойство:

![]() .

.

Доказательство. По определению дисперсии,

![]() .

.

Поскольку дисперсия не зависит от сдвига, будем считать E[X+Y] = 0. Тогда

![]()

Для решения многих задач удобнее использовать коэффициент корреляции— нормированную ковариацию:

![]() .

.

Свойства корреляции

Инвариантность относительно сдвига:

r[X+a,Y+b] =r[X,Y].

Доказательство. Так как дисперсия и ковариация инвариантны относительно сдвига, то и корреляция инвариантна относительно сдвига.

r[aX, bY] = sgn[ab] · r[X, Y]

Доказательство.

Симметричность(очевидно):

r[X, Y] = r[Y, X]

−1 ≤ r[X,Y] ≤ 1, причем еслиabs[r[X,Y]] = 1, то междуXиYимеется линейная зависимость:Y=aX+b. Еслиr[X,Y] = 1,a> 0; еслиr[X,Y] = −1,a< 0.

Доказательство.

![]()

Пусть r = 1, тогда

![]()

Теперь пусть r = −1, тогда

![]()

Задачи

Случайный вектор (X,Y) равномерно распределен в круге (x − 1)2 + (y − 2)2= 1. НайтиEX, EY, DX, r[X, Y].

Решение. Произведем замену переменных /.{X→X1+ 1,Y→Y1+ 2}:

Согласно произведенной замене, EX=EX1+ 1,EY=EY1+ 2;DX=DX1,DY=DY1. Отсюдаr[X,Y] =r[X1,Y1]. Плотность распределения

.

.

Пояснение. Простейшим примером совместного распределения двух случайных величин является двумерноеравномерное распределение на множестве A. Пусть задано ограниченное множествоAс площадьюσ. Оно определяется как распределение пары (X,Y), задаваемое с помощью следующей совместной плотности:

.

.

Математическое ожидание X1

![]() .

.

Аналогично, EY1= 0. По формулам замены,EX= 1,EY= 2.

Ковариация

Дисперсия

Известно, что DX= 1,DY= 4,r[X,Y] = 1/2. Найтиr[2X+Y+ 1,X+ 2Y].

Решение. Так какcovнезависима от сдвига,

r[2X + Y + 1, X + 2Y] = r[2X + Y, X + 2Y].

Найдем ковариацию и дисперсии:

Тогда

![]()