- •Глава 1. Теория вероятностей 3

- •1.2 Перестановки, размещения и сочетания

- •§2. Классическое определение вероятности

- •2.1 Определение и примеры

- •2.2 Критика классического определения

- •§3. Дискретное вероятностное пространство

- •§4. Геометрическая вероятность

- •§5. Парадоксы Бертрана

- •§6. Аксиоматика Колмогорова

- •6.1 Аксиомы событий

- •6.2 Аксиомы вероятности

- •6.3 Свойства вероятности

- •§7. Условная вероятность. Независимость

- •§8. Формула полной вероятности. Формула Байеса

- •§9. Схема Бернулли

- •9.1 Основные определения и примеры

- •9.2 Предельные теоремы в схеме Бернулли

- •§10. Случайные величины и их распределения

- •10.1 Введение

- •10.2 Функция распределения случайной величины

- •10.3 Наиболее употребительные распределения. Замена переменных

- •§11. Распределение случайного вектора (совместное распределение)

- •11.1 Основные определения

- •11.2 Плотность распределения случайного вектора при замене переменных

- •§12. Математическое ожидание случайной величины

- •12.1 Основные определения

- •12.2 Интеграл Лебега (интеграл по вероятностной мере)

- •12.3 Свойства математического ожидания

- •§13. Дисперсия случайной величины

- •§14. Примеры вычисления математического ожидания и дисперсии

- •§15. Производящие функции

- •15.1 Основные определения

- •15.2 Свойства

- •15.3 Примеры задач

- •§15. Коэффициент корреляции

- •§16. Многомерное нормальное распределение

- •16.1 Основные определения

- •16.2 Плотность распределения двумерного нормального вектора

- •16.3 Примеры задач

- •§17. Неравенство Чебышева

- •19.2 Закон больших чисел Бернулли

- •§20. Характеристические функции

- •20.1 Определение и свойства

- •20.2 Примеры

- •§21. Центральная предельная теорема

- •21.1 Доказательство цпт

- •21.2 Усиление закона больших чисел (збч Хинчина)

- •§22. Типичные задачи

- •§23. Условное математическое ожидание

- •23.1 Основные определения

- •23.2 Методы вычисления. Примеры

- •23.2.1 Дискретный случай

- •23.2.2 Непрерывный случай

- •23.3 Свойства

- •23.4 Исследование нормального случайного вектора

- •§24 Цепи Маркова

- •24.1 Основные определения. Формула Чепмена–Колмогорова

- •24.2 Классификация состояний

- •24.3 Период марковской цепи

- •24.4 Предельная теорема для переходных вероятностей марковских цепей

- •24.5 Возвратность цепей Маркова

- •§25 Типичные задачи, 2

§13. Дисперсия случайной величины

Дисперсиейслучайной величиныXназывается математическое ожидание квадрата отклонения этой величины от ее математического ожидания:

DX=E[X−EX]2

Интуитивно, дисперсия показывает «кучность» распределения X, т.е. близость конкретных значений случайной величины к ее математическому ожиданию10. Чем меньшеDX, тем более определено значениеX.

Свойства

DC = 0, при C = const (т.к. EC = C)

.

.

Доказательство. Действительно, изE[−EX+X]2= 0 с вероятностью 1 следует, чтоX – EX = 0 с вероятностью 1.

D[X + C] = D[X], при C = const. («инвариантность к сдвигу»)

Доказательство.D[X+C] =E[X+C–E[X+C]]2=E[X+C–EX–EC]2=

= E[X + C – EX – C]2 = E[X – EX]2 = DX.

D[CX] = C2DX, при C = const

Доказательство.D[CX] =E[CX–E[CX]]2=E[C2(X–EX)2] =

= C2 E[X − EX]2 = C2 DX.

Если XиYнезависимы, тоD[X+Y] =DX+DY.

Доказательство. Будем рассматривать вместоX — (X–EX), вместоY — (Y –EY), при этом дисперсия, очевидно, не изменится (математическое ожидание есть константа). Тогда, не умаляя общности, будем считатьEX= =EY= 0, и

D[X+Y] =E[X+Y]2=E[X 2] +E[Y 2] + 2E[XY] =E[X 2] +E[Y 2] +

+ 2E[X] E[Y] = E[X 2] + E[Y 2] = DX + DY,

где E[XY] =E[X] E[Y] справедливо лишь в предположении о независимости величинXиY.

Заметим, что при тех же условияхD[X–Y] =D[X+Y] =DX+DY, поскольку константа (−1) в (X–Y) = (X+ (−1)Y) выносится в квадрате по свойству 4).

Часто оказывается полезной следующая формула вычисления дисперсии:

DX=E[X 2] – (EX)2.

Доказательство.DX = E[X – EX]2 = E[X 2] – 2E[X EX] + E[(EX)2] =

= E[X 2] − 2(EX)2 + (EX)2 = E[X 2] – (EX)2.

Вводят также стандартное отклонение(параметр масштаба)![]() .

Откуда идет название «параметр масштаба»?

А из свойства

.

Откуда идет название «параметр масштаба»?

А из свойства![]() ,

гдеC=const— масштабный множитель (например, для

перевода измеренной величины из одних

единиц в другие).

,

гдеC=const— масштабный множитель (например, для

перевода измеренной величины из одних

единиц в другие).

§14. Примеры вычисления математического ожидания и дисперсии

14.1 Вырожденное распределение

X=const=C

EX=EC=C

DX=DC= 0

14.2 Распределение Бернулли

P(X= 0) =q,P(X= 1) =p,p+q= 1

EX=p· 1 +q· 0 =p

E[X 2] =p· 12+q· 02=p

DX=E[X 2] – (EX)2=p–p2=p(1 –p) =pq

14.3 Биномиальное распределение

![]()

Для отыскания математического ожидания

![]()

введем случайную величину

.

.

Заметим, что X= ∑Xi, аEXi=pпо п. 14.2. Тогда

![]() .

.

Так как производятся nнезависимыхиспытаний,Xiнезависимы между собой и дисперсия равна по п. 14.2

![]() .

.

14.4 Распределение Пуассона

![]()

![]() .

.

![]()

![]()

![]() .

.

![]() .

.

Вывод: параметрλв распределении Пуассона играет роль как дисперсии, так и математического ожидания.

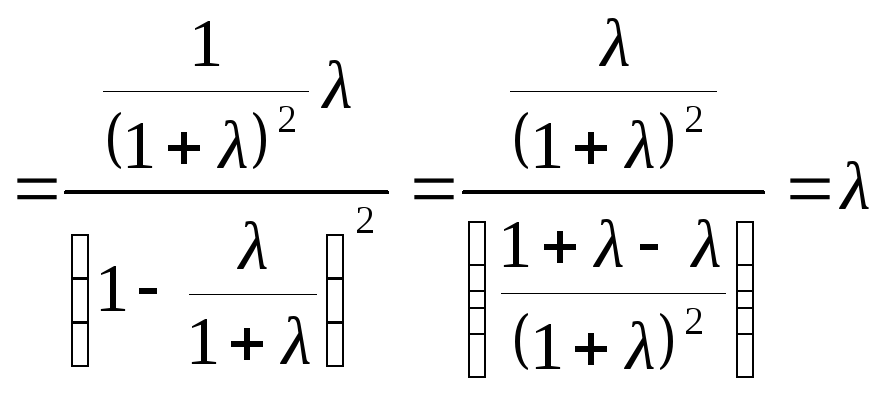

14.5 Геометрическое распределение

Заготовки по суммированию рядов

Геометрическая прогрессия:

![]() .

.

При![]() рядAможно дифференцировать

сколько угодно раз:

рядAможно дифференцировать

сколько угодно раз:

![]() ,

,![]() .

.

Отсюда

![]() .

.

При геометрическом распределении

![]()

Тогда

![]()

.

.

Аналогично,

.

.

Отсюда

DX=E[X 2] – (EX)2= 2λ2+λ–λ2=λ2+λ.

14.6 Равномерное распределение на интервале [a,b]

.

.

![]()

![]() .

.

![]() .

.

При a= 0,b= 1 (стандартное равномерное распределение)EX= 1/2,DX= 1/12.

14.7 Показательное распределение

.

.

![]() .

.

![]() .

.

![]() .

.

14.8 Симметричное показательное распределение

![]() .

.

![]() (т.к.p(x)

четная).

(т.к.p(x)

четная).

![]() .

.

14.9 Нормальное распределение

![]() .

.

14.10 Другие задачи

Имеется дискретная случайная величина Xс распределением

|

x |

0 |

π/6 |

π/2 |

5π/6 |

π |

|

p |

1/10 |

3/10 |

1/10 |

2/10 |

3/10 |

а случайная величина Y=sin X. НайтиEY,DY.

Решение. РаспределениеY имеет вид

|

y |

0 |

1/2 |

1 |

|

p |

2/5 |

1/2 |

1/10 |

Тогда

EY = 1/2 · 1/2 + 1 · 1/10 = 1/4 + 1/10 = 7/20,

E[Y 2] = 1/4 · 1/2 + 1 · 1/10 = 1/8 + 1/10 = 9/40,

DY = E[Y 2] – (EY)2 = 9/40 – 49/400 = 41/400.

На гранях тетраэдра написаны числа 1, 2, 3, 4. Тетраэдр бросают на стол. Если он падает i-й гранью, то выигрыш составляет

.

Найти ожидаемое значение выигрыша и

дисперсию, если совершено 10 бросков.

.

Найти ожидаемое значение выигрыша и

дисперсию, если совершено 10 бросков.

Решение. Введем случайную величинуX1(выигрыш при одном броске). Тогда ее математическое ожидание равно

![]() .

.

Матожидание квадрата X1

![]() .

.

Дисперсия

![]() .

.

Тогда для 10 бросков выигрыш будет равен ожидаемый сумме матожиданий выигрышей при отдельных бросках:

EX= 10EX1= 150/2 = 75.

Дисперсия при этом также увеличится в 10 раз:

DX = 10DX1 = 1290/4 = 645/2.

Пусть X,Y ~U(0,1) и независимы,Z=max(X,Y). НайтиEZ, DZ.

Решение. Функция распределения

F(z) =P(Z<z) =P(X<z,Y<z) =P2(X<z) =z2,

плотность распределения p(z) = 2z(приz[0,1]). Тогда

Распределение случайной величины задано графиком:

.

.

Найти математическое ожидание и дисперсию.

Решение.

Пусть X,Y ~N(0,1) и независимы,U=max(X,Y),V=min(X,Y). НайтиE[U−V].

Решение.

![]()

P(U < x) = P(max(X, Y) < x) = P(X < x, Y < x) = P2(X < x) = Φ2(x).

Обозначим плотность распределения Uзаq, тогда

q(x) = (Φ2(x))′ = 2Φ(x) φ(x).

Математическое ожидание Uравно

Проводя аналогичные рассуждения для

V, получим![]() .

Тогда

.

Тогда![]() .

.

Пусть X,Y ~N(0,1) и независимы, аY1=exp{2X+ 3Y}. НайтиE[Y1].

Решение. Можно было бы воспользоваться известным фактом, что линейное преобразование нормально распределенной случайной величины снова дает случайную величину с нормальным распределением. Однако в этой задаче проще поступить иначе. Т.к.XиYнезависимы, то

E[exp{2X + 3Y}] = E[exp 2X exp 3Y] = E[exp 2X] E[exp 3Y].

Теперь найдем

Последнее равенство верно в силу того, что под интегралом стоит плотность распределения N(a, 1). С учетом полученной нами формулы имеем

![]() .

.