- •Методические указания

- •Вероятностные модели в задачах теории информации

- •1.1. Случайные события. Вероятность

- •1.2. Дискретная и непрерывная случайные величины

- •1.3. Задачи

- •1.4. Контрольные вопросы

- •2. Информационная мера шеннона.

- •2.1. Количество информации и избыточность.

- •2.2. Энтропия непрерывных сообщений

- •2.3. Задачи

- •2.4. Контрольные вопросы

- •3. Условная энтропия и взаимная информация

- •3.1. Дисктретные системы передачи информации.

- •3.2. Непрерывные системы передачи информации.

- •3.3. Задачи

- •3.4. Контрольные вопросы

- •Список использованных источников

- •Значение функции

- •654600 «Информатика и вычислительная техника» и направления подготовки бакалавров 552800 «Информатика и вычислительная техника».

- •450000, Уфа-центр, к. Маркса, 12

МИНИСТЕРСТВО ОБРАЗОВАНИЯ РОССИЙСКОЙ ФЕДЕРАЦИИ

УФИМСКИЙ ГОСУДАРСТВЕННЫЙ АВИАЦИОННЫЙ

ТЕХНИЧЕСКИЙ УНИВЕРСИТЕТ

Методические указания

к практическим занятиям по курсу «Информатика»

по направлению подготовки дипломированных специалистов 654600

«Информатика и вычислительная техника» и направлению подготовки

бакалавров 552800 «Информатика и вычислительная техника»

УФА-2003

Составители: Н.И. Юсупова, О.Н. Сметанина, Г.Р. Шахмаметова.

УДК: 621.391

Методические указания «Вычислительные аспекты в задачах теории информации» к практическим занятиям по курсу «Информатика» по направлению подготовки дипломированных специалистов 654600 «Информатика и вычислительная техника» и направлению подготовки бакалавров 552800 «Информатика и вычислительная техника» / Уфимск. гос. авиац. техн. ун-т; Сост. Н.И. Юсупова, О.Н. Сметанина, Г.Р. Шахмаметова. Уфа, 2003. – 29 с.

Методические указания разработаны в помощь специалистам направления 654600 «Информатика и вычислительная техника». Могут быть использованы при изучении курса: «Информатика».

Содержатся краткие теоретические сведения по разделам курса «Вероятностные модели в задачах теории информации», «Информационная мера Шеннона», «Условная энтропия и взаимная информация». В конце каждого раздела методических указаний дан разбор решений типовых задач. Приведены упражнения и задачи для самостоятельной работы, контрольные вопросы.

Ил. 4, Табл. 3, Библ. 6 назв.

Рецензенты: Тарасова Т.Д.

Черняховская Л.Р.

СОДЕРЖАНИЕ

|

|

стр. |

|

1. Вероятностные модели в задачах теории информации 1.1. Случайные события. Вероятность 1.2. Дискретная и непрерывная случайные величины 1.3. Задачи 1.4. Контрольные вопросы |

4 4 7 12 14 |

|

2. Информационная мера Шеннона 2.1. Количество информации и избыточность 2.2. Энтропия непрерывных сообщений 2.3. Задачи 2.4. Контрольные вопросы |

16 16 17 18 20 |

|

3. Условная энтропия и взаимная информация 3.1. Дискретные системы передачи информации 3.2. Непрерывные системы передачи информации 3.3. Задачи 3.4. Контрольные вопросы |

21 21 22 24 25 |

|

Список используемых источников Примечание

1. Значение функции

Примечание 2. Указания к решению задач |

26 27 28 |

|

|

|

Вероятностные модели в задачах теории информации

1.1. Случайные события. Вероятность

Событие

- всякий факт, который в результате опыта

может произойти или не произойти.

Вероятность события - это число, которое

является мерой возможности реализации

события. Вероятность P(A)

случайного события A

заключена

в пределах![]()

Достоверное

событие U

такое, что![]()

Невозможное

событие V

такое, что

![]()

Суммой или объединением событий называется событие A, которое происходит тогда и только тогда, когда происходит, по крайней мере, одно из этих событий. Сумма обозначается

![]()

![]()

![]()

![]()

![]()

Произведением

или пересечением событий

![]() называется

такое событиеA,

которое

происходит тогда и только тогда, когда

происходят события вместе. Произведение

обозначается

называется

такое событиеA,

которое

происходит тогда и только тогда, когда

происходят события вместе. Произведение

обозначается

![]()

События

![]() образуют

полную группу событий, если в результате

опыта появляется хотя бы одно из них:

образуют

полную группу событий, если в результате

опыта появляется хотя бы одно из них:

![]()

События

A и

B

называются несовместными, если их

совместное появление невозможно:

![]()

Два

события называются противоположными,

если они несовместны и образуют полную

группу. Событие, противоположное событию

A, обозначается

![]() .

.

![]()

![]()

Когда рассматриваемый опыт имеет N равновозможных исходов, которые несовместны и составляют полную группу, вероятность события А можно рассчитать по формуле:

![]()

где m - число исходов, которые приводят к наступлению события A.

Частотой или статистической вероятностью P*(A) события A в данной серии испытаний называется отношение числа опытов n, в которых появилось событие, к общему числу N произведенных опытов:

![]()

По теореме Бернулли при большом числе опытов частота сходится по вероятности к вероятности события.

Расчеты

вероятности сложного события A

через вероятности более простых событий

![]() базируются на использовании основных

теорем теории вероятностей.

базируются на использовании основных

теорем теории вероятностей.

Теорема сложения вероятностей. Вероятность суммы двух событий равна сумме вероятностей этих событий минус вероятность их произведения:

![]()

Теорема умножения вероятностей. Вероятность совместного появления двух событий равна произведению вероятности одного из них на условную вероятность другого при условии, что первое имело место:

![]()

где

![]() -

условная вероятность событияB,

т.е. вероятность события B,

вычисленная в предположении, что имело

место событие A.

-

условная вероятность событияB,

т.е. вероятность события B,

вычисленная в предположении, что имело

место событие A.

Во

многих ситуациях событие A

может

появиться лишь как случайное следствие

одного из несовместных событий

![]() образующих полную группу. В этих случаях

безусловная вероятностьP(A)

события A

при известных вероятностях

образующих полную группу. В этих случаях

безусловная вероятностьP(A)

события A

при известных вероятностях

![]() и

и

![]() определяется по формуле полной

вероятности:

определяется по формуле полной

вероятности:

![]()

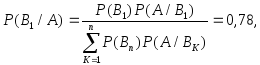

При

этих же данных можно найти значения

вероятностей событий

![]() если предположить, что событиеA

уже произошло. Задачи такого типа

решаются с помощью формулы Байеса:

если предположить, что событиеA

уже произошло. Задачи такого типа

решаются с помощью формулы Байеса:

![]()

![]()

Рассмотрим несколько примеров.

Пример 1. В последовательности из N двоичных символов имеется M единиц. При передаче данной последовательности сохраняется n символов, остальные теряются. Какова вероятность того, что среди них будет не более m единиц?

Решение.

Пусть A

- событие, состоящее в том, что среди

двоичных символов будет не более m

единиц. Событие A

произойдет

тогда, когда среди n

двоичных символов не будет ни одной

единицы (событие

![]() )

или одна единица (событие

)

или одна единица (событие![]() ),

или две (событие

),

или две (событие![]() ),

. . ., или окажетсяm

единиц

(событие

),

. . ., или окажетсяm

единиц

(событие

![]() ),

т.е.

),

т.е.

![]()

Вероятность

![]() события

события

![]() можно

рассчитать следующим образом. Общее

число возможных выборов n

символов из

N равно

числу сочетаний из N

по n,

т.е.

можно

рассчитать следующим образом. Общее

число возможных выборов n

символов из

N равно

числу сочетаний из N

по n,

т.е.

![]() .

Благоприятствующими событию

.

Благоприятствующими событию![]() являются

случаи, когда из общего числаM

единиц

сохранено ровно K,

что возможно в

являются

случаи, когда из общего числаM

единиц

сохранено ровно K,

что возможно в

![]() случаях.

На каждый из этих случаев в сохраненной

последовательности символов может быть

случаях.

На каждый из этих случаев в сохраненной

последовательности символов может быть![]() различных

комбинаций (

различных

комбинаций (![]() )

нулей. Общее число случаев, благоприятствующих

событию

)

нулей. Общее число случаев, благоприятствующих

событию![]() ,

равно

,

равно![]() .

Поэтому

.

Поэтому

![]()

По теореме сложения

![]()

Пример 2. По каналу связи с помехами передается одна из двух команд управления управления в виде кодовых комбинаций 11111 и 00000, вероятности передачи этих команд равны соответственно 0,7 и 0,3. Вероятность правильного приема каждого из символов 0 и 1 равна 0,6. Символы искажаются помехами независимо друг от друга. На выходе канала имеем кодовую комбинацию 10110. Оценить, какая команда была передана.

Решение.

Пусть A

- событие,

состоящее в приеме комбинации 10110.

Это событие может произойти только в

совокупности с одним из событий:

![]() - передавалась команда11111,

- передавалась команда11111,

![]() - передавалась команда00000.

При этом

- передавалась команда00000.

При этом

![]()

![]()

Условная вероятность приема комбинации 10110 при условии, что передавалась команда 11111 равна

![]()

![]()

![]()

![]()

![]()

Аналогично

![]()

По формуле Байеса

![]()

Сравнивая найденные результаты, заключаем, что более вероятна передача команды 11111.