- •Указатели

- •Содержание

- •Лекция 1-2: Базовые понятия ии

- •Цель преподавания дисциплины

- •Терминология

- •Философские аспекты проблемы систем ии (возможность существования, безопасность, полезность).

- •История развития систем ии.

- •Лекция 3: Архитектура и основные составные части систем ии

- •Различные подходы к построению систем ии

- •Вспомогательные системы нижнего уровня (распознавание образов зрительных и звуковых, идентификация, моделирование, жесткое программирование) и их место в системах ии

- •Лекции 4-7: Системы распознавания образов (идентификации)

- •Понятие образа

- •Проблема обучения распознаванию образов (оро)

- •Геометрический и структурный подходы.

- •Гипотеза компактности

- •Обучение и самообучение. Адаптация и обучение

- •Перцептроны

- •Нейронные сети История исследований в области нейронных сетей

- •Модель нейронной сети с обратным распространением ошибки (back propagation)

- •Нейронные сети: обучение без учителя

- •Нейронные сети Хопфилда и Хэмминга

- •Метод потенциальных функций

- •Метод группового учета аргументов мгуа Метод наименьших квадратов

- •Общая схема построения алгоритмов метода группового учета аргументов (мгуа).

- •Алгоритм с ковариациями и с квадратичными описаниями.

- •Метод предельных упрощений (мпу)

- •Коллективы решающих правил

- •Методы и алгоритмы анализа структуры многомерных данных Кластерный анализ

- •Иерархическое группирование

- •Неформальные процедуры

- •Алгоритмические модели

- •Продукционные модели

- •Режим возвратов

- •Логический вывод

- •Зависимость продукций

- •Продукционные системы с исключениями

- •Язык Рефал

- •Глава 5. Экспертные системы

- •Экспертные системы, базовые понятия

- •Экспертные системы, методика построения

- •Этап идентификации

- •Этап концептуализации

- •Этап формализации

- •Этап выполнения

- •Этап тестирования

- •Этап опытной эксплуатации

- •Экспертные системы, параллельные и последовательные решения

- •Пример эс, основанной на правилах логического вывода и действующую в обратном порядке

- •Часть 1.

- •Часть 2.

- •Часть 3.

- •Часть 4.

- •Часть 5.

- •Лекции 14-16. Машинная эволюция

- •Метод перебора, как наиболее универсальный метод поиска решений. Методы ускорения перебора.

- •Эволюция

- •Генетический алгоритм (га)

- •Как создать хромосомы?

- •Как работает генетический алгоритм?

- •Эволюционное (генетическое) программирование

- •Автоматический синтез технических решений

- •Поиск оптимальных структур

- •Алгоритм поиска глобального экстремума

- •Алгоритм конкурирующих точек

- •Алгоритм случайного поиска в подпространствах

- •Некоторые замечания относительно использования га

- •Автоматизированный синтез физических принципов действия Фонд физико-технических эффектов

- •Синтез физических принципов действия по заданной физической операции

- •Заключительные замечания

- •Слабосвязанный мир

- •Разделяй и властвуй

Алгоритм конкурирующих точек

Алгоритм конкурирующих точек в общем виде включает следующие операции.

1. По процедуре

СДС синтезируется l

(l

=

+ 0)

точек

![]() (j = 1, ...,l),

в которых определяется значение

минимизируемой функции (критерия

сравнения). Из этих l

точек отбирается

точек, имеющих наилучшие значения

критерия, которые в дальнейшем называются

основными. Запоминается наихудшее

значение критерия основных точек 0.

При этом считается, что совершен нулевой

глобальный (групповой) шаг поиска (t =

0).

(j = 1, ...,l),

в которых определяется значение

минимизируемой функции (критерия

сравнения). Из этих l

точек отбирается

точек, имеющих наилучшие значения

критерия, которые в дальнейшем называются

основными. Запоминается наихудшее

значение критерия основных точек 0.

При этом считается, что совершен нулевой

глобальный (групповой) шаг поиска (t =

0).

Таким образом, на t-м групповом шаге поиска имеем основные точки

![]() ,

(10)

,

(10)

и, соответственно, невозрастающую последовательность чисел

0, 1, …, t. (11)

2. Каждая основная точка делает шаг локального поиска, в результате чего точки (10) переходят в новую последовательность

![]() .

(12)

.

(12)

3. Синтезируется t+1 дополнительных допустимых точек, каждой из которых разрешается сделать t+1 шагов локального поиска при условии, что после каждого шага с номером (0 t) ее критерий не хуже, чем соответствующий член последовательности (11). При нарушении этого условия точка исключается и не участвует в дальнейшем поиске глобального экстремума. Таким образом, имеется q (qt+1) дополнительных точек, сделавших t + 1 шаг локального поиска:

![]() ,

(13)

,

(13)

4. Среди точек (12) и (13) отбирается точек с лучшими критериями:

![]() , (14)

, (14)

которые являются основными на (t + 1)-м групповом шаге поиска. Значение худшего критерия точек из последовательности (14) дополняет последовательность (11) числом t+1.

5. Цикл по пп. 2—4 повторяется до нахождения глобального экстремума по заданным условиям прекращения поиска. В качестве условий прекращения поиска могут быть использованы, например, выполнение заданного числа Т групповых шагов.

Считая параметры i независимыми от i, будем иметь только два настраиваемых параметра алгоритма; — число основных точек и — число дополнительных точек.

Проведенные исследования позволяют рекомендовать следующие оптимальные значения этих параметров: = 2…3, = 12…18. Для простоты реализации алгоритма можно брать постоянные значения и .

В качестве процедуры ШЛП рекомендуется использовать следующие алгоритмы поиска локального экстремума:

алгоритм случайного поиска в подпространствах;

алгоритм случайного поиска с выбором по наилучшей пробе;

алгоритм сопряженных градиентов;

алгоритм Нельдера-Мида.

Алгоритм случайного поиска в подпространствах

Рекомендуемый алгоритм случайного поиска в подпространствах можно записать в виде следующих рекуррентных выражений:

![]() ;

;

![]() при

при

![]() .

.

Здесь h — число

последовательно неудачных шагов поиска;

![]() определяется по формуле:

определяется по формуле:

где a—максимальная величина рабочего шага поиска;

![]() —вектор случайных

чисел;

—вектор случайных

чисел;

![]() — векторы приращений на (i-1)-,

i-, (i+1)-м шагах поиска;

— векторы приращений на (i-1)-,

i-, (i+1)-м шагах поиска;

![]() — векторы, описанные по формуле (1);

— векторы, описанные по формуле (1);![]() —

значения критериев качества после

осуществления на (i-1)-,

i-, (i+1)-го шагов поиска.

—

значения критериев качества после

осуществления на (i-1)-,

i-, (i+1)-го шагов поиска.

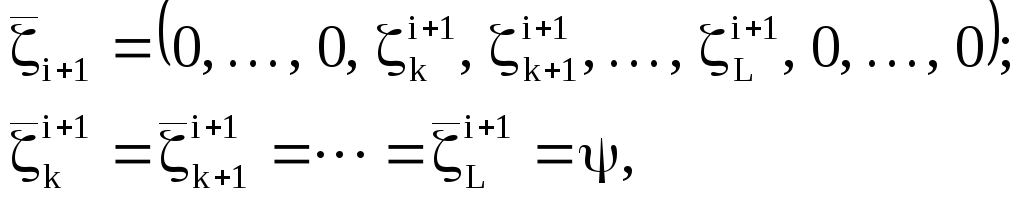

Вектор случайных чисел

где — случайное равномерно распределенное число, выбираемое из интервала [-1, 1]; k и L—случайные целые числа, распределенные на отрезке [1, n] и упорядоченные соотношением kL.

Имеются и другие модификации этого алгоритма, которые могут оказаться более эффективными.