- •0.1. Эконометрика как наука.

- •0.2. История возникновения эконометрики

- •0.3.Элементы теории вероятности.

- •0.3.1. Вероятностные характеристики случайных переменных

- •0.3.2.Законы распределения:

- •0.3.3 Условное математическое ожидание

- •0.4.Элементы математич статистики

- •0.4.1.Оценивание «хороших» св-в оценок

- •1) Состоятельность оценок

- •2) Несмещенность оценок

- •3) Эффективность оценок

- •0.4.2. Проверка гипотез и интервальное оценивание

- •1.1 Определение линейной однофакторной регрессии.

- •1.1.1.Основные понятия регрессионного анализа

- •1.1.2. Линейная однофакторная регрессия

- •1.1.3. Матричная запись линейной регрессии

- •1.1.4 Оценки параметров регрессии

- •1.1.5 Смысл коэффициента регрессии

- •1.2 Проверка адекватности ру

- •1.2.1 Показатели качества подгонки

- •1.3 Предпосылки мнк (ls)

- •1.3.1. Общие положения мнк

- •1.3.2. Выполнение первой предпосылки мнк (случайный характер остатков)

- •1.3.5 Выполнение 4-го условия мнк (отсутствие автокорреляции остатков)

- •1.3.6 Выполнение 5-го условия мнк (нормальность остатков)

- •1.4. Устранение нарушения предпосылок мнк для оценки парной регрессии

- •1.3.4. Выполнение третьей предпосылки мнк (гомоскедастичность остатков)

- •1.4.1. Автокорреляция остатков

- •1.4.2.Гетероскедастичность остатков и избавление от нее

- •1 Подход: преобразование исходных данных

- •2 Подход: применение другого метода оценивания коэф-ов регрессии.

- •3 Подход) включение дисперсии в модель

- •1.4.3. Метод максимального правдоподобия.

- •2.1 Множественная линейная регрессия

- •2.1.1. Основные понятия

- •2.1.2. Методы оценивания коэффициентов линейной многофакторной регрессии.

- •2.2.Проверка адекватности уравнений линейной множественной регрессии

- •2.2.1. Проверка качества подборки мнк.

- •2.2.2.Проверка гипотез для млр

- •2.2.3. Допущение выполнения мнк или получение «хороших» оценок

- •2.3. Мультиколлинеарность факторов

- •2.3.1. Обнаружение мультиколлинеарности

- •2.3.2 Избавление от мультиколлинеарности. Метод главных компонент

- •2.4.Учет качественных факторов

- •2.4.1.Множественные переменные

- •2.4.2. Фиктивные переменные

- •2.4.3. Структурные изменения тенденций. Тест Чоу.

- •2.4.4. Модели бинарного выбора

- •3.1.Виды нелинейной зависимости

- •3.1.1.Основные понятия

- •3.1.2. Методы оценивания линеаризуемых функций:

- •3.2.Проверка адекватности нелинейной регрессии

- •3.2.1. Показатели качества подгонки

- •3.1.3. Нелинеаризуемые функции и методы их оценки

- •1 .Квазиньютоновский

- •2.Симплекс-метод

- •3.Метод Хука-Дживса

- •3.2.2. Проверка гипотезы о значимости нелинейных моделей

- •3.2.3. Проверка выполнения условий для получения «хороших» оценок методом оценивания

- •3.3.Выбор типа зависимости

- •3.3.1. Теоретические предпосылки

- •3.3.2. Процедура Бокса – Кокса и тест Зарембеки

- •Тест Зарембеки

- •3.3.3.Производственные функции (пф)

- •3.3.4. Коэффициент эластичности

- •3.4.Спецификация и прогноз регрессионных уравнений

- •3.4.1. Информационные критерии (критерий Акайке, Шварца)

- •3.4.2. Ложная регрессия

- •3.4.3. Прогноз по регрессионным моделям. Доверительный интервал.

- •3.4.4. Применение регрессионного анализа в хеджировании

- •4.1.Понятие и виды сру

- •4.1.1. Система независимых уравнений

- •4.1.2. Системы рекурсивных уравнений

- •4.2. Структурный и приведенный виды сру

- •4.3 Идентификация модели

- •4.4 Оценка параметров сру

- •4.4.1.Кмнк.

- •4.4.2.Дмнк.

- •4.4.3.Тмнк.

- •5.8.2 Доверительный интервал в прогнозах

- •5.8.3 Общая схема прогнозирования на основе временных рядов

- •5.1 Общие положения о временных рядах

- •§ 5.2.1. Модель Брауна

- •§ 5.2.2. Модель Хольта.

- •5.2.Адаптивные модели.

- •5.2.3. Модель Хольта-Уинтерса

- •5.4Оценка тренда

- •5.4.1Параметрические методы оценки тренда

- •5.4.2. Метод скользящих средних

- •5.5 Оценка сезонной компоненты.

- •Аддитивная сезонная модель:

- •5.5.1 Оценка сезонной компоненты с помощью тригонометрических функций.

- •5.5.2. Метод сезонных индексов.

- •5.5.3. Прогнозирование сезонной компоненты

- •5.6. Моделирование стационарных случайных процессов

- •5.6.1. Авторегрессионные модели

- •Процесс Юла

- •Моделирование стационарных процессов

- •5.6.3Модель скользящей средней.

- •5.6.4Модель арсс (аrма)

- •5.6.5 Модели ap проинтегрированного скользящего среднего (арпсс).

- •Спектральный анализ Фурье.

- •5.7Спектральная плотность случайного процесса.

- •Различные параметры спектров.

- •5.8Прогнозирование временных рядов.

- •5.8.1 Адекватность математических моделей временных рядов.

- •Параметрические

- •Непараметрические

- •5.7. Периодограмма и спектрограмма

- •5.6.2.Понятие автокорреляции и частная автокорреляция

- •Следствия автокорреляции остатков

1.4. Устранение нарушения предпосылок мнк для оценки парной регрессии

- Автокорреляция остатков.

Одна из причин присутствия автокорреляции в остатках – неправильный выбор вида зависимости между переменными, т.е. необходимо изменить зависимость.

Еще один способ устранения автокорреляции остатков – введение лаговых переменных.

- Гетероскедастичность остатков

Существует несколько подходов к решению данного нарушения:

1. Преобразование исходных данных

2. Применение другого метода оценивания

3. Включение изменяющейся дисперсии в модели (актуально для временных рядов)

- Метод максимального правдоподобия

Применяется для оценки коэффициентов регрессии. Одна из важных предпосылок ММП – известность знака распределения зависимой переменной.

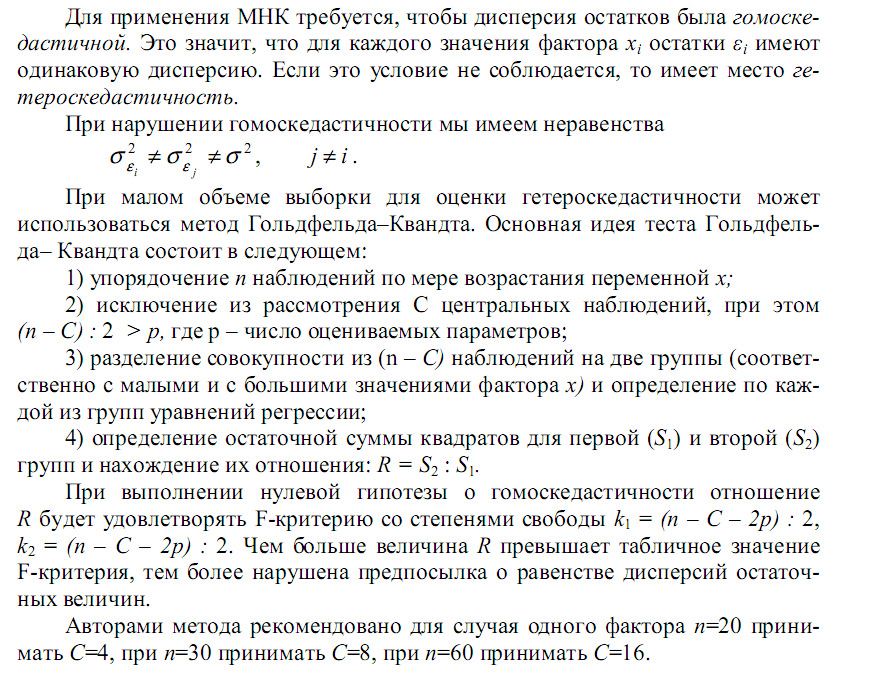

1.3.4. Выполнение третьей предпосылки мнк (гомоскедастичность остатков)

3 предпосылка МНК – проверка гомоскедастичности остатков (независимости дисперсии остатков от хi)

При проверке гомоскедастичности используют критерии Гольфельда-Квандта, Спирмена и др.

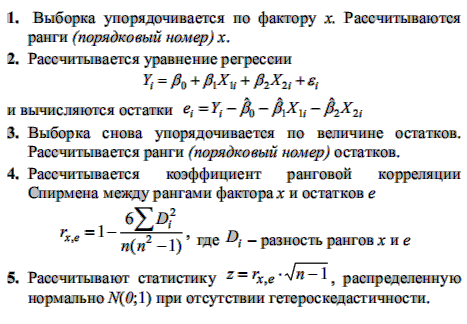

Критерий Спирмена для проверки гомоскедастичности

Тест ранговой корреляции Спирмена использует наиболее общие предположения о зависимости дисперсий ошибок регрессии от значений регрессоров.

Тест Голдфелда—Квандта применяется в том случае, если ошибки регрессии можно считать нормально распределенными случайными величинами.

Тест ранговой корреляции Спирмена и тест Голдфелда—Квандта позволяют обнаружить лишь само наличие гетероскедастичности, но они не дают возможности проследить количественный характер зависимости дисперсий ошибок регрессии от значений регрессоров и, следовательно, не представляют каких-либо способов устранения гетероскедастичности.

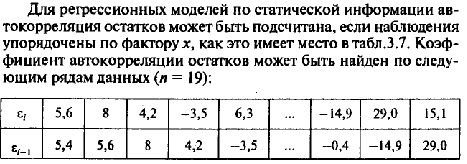

При построении регрес-х моделей важно соблюдение 4предпосылки МНК- отсутсвие автокор-ии остатков. Автокор-я ост. означает наличие корреляции м/у остатками текущ и предыдущ наблюдений. Кот м.б.определен как rEi Ej

=cov(Ei,Ej)/ сигма Ei сигма Ej,

т.е. по обычной формуле линейного коэф корреляции. Если этот коэф окажется отличным от 0, то ост-ки автокоррелированы и ф-я плотности вер-ти F(e) зависит от j-ой точки наблюдения и распределения значений остатков в др. точках наблюдения.

Отсутствие автокор-ии остаточных величин обеспечив состоят-ть и эффек-ть оценок коэф регрессии. Особенно актуально соблюдение данной предпосылки МНК при построении регрес. Моделей по рядам динамики, где ввиду наличия тенденция последующего ур. Динамич ряда зависит от своих предыд. Уровней.

1.4.1. Автокорреляция остатков

Одна из причин присутствия автокорреляции в остатках может быть неправильный выбор вида зависимости между переменными. Т.е. следует изменить зависимость. Еще один способ устранения автокорреляции остатков – введение лаговых переменных.

Лаговые переменные – переменные, которые измерены в прошлом периоде времени и участвуют в модели

При проверке наличия автокорреляции на практике руководствуются простым правилом: Расчетные значения DW, близкое к 2, свидетельствует об отсутствии автокорреляции; значение близкое к 4, свидетельствует об отрицательной автокорреляции; значение близкое к 0, о положительной автокорреляции.

Следует отметить, что тест DW можно применять при выполнении следующих условий:

1. в регрессионном уравнении есть свободный член

2. в регрессионном уравнении нет лаговых значений зависимой переменной (напр. yi-j)

Тест DW определяет лишь отсутствие автокорреляции I порядка. Про остальные порядки он ответа не дает.

Тест Брана-Годфри ее общий тест, тест DW.

Предположительно, что остатки εi можно представить в виде авторегрессионного процесса 4 порядка.

εi = ρ1 εi-1+ ρ2 εi-2 + … + ρr εi-r + ui

1)рассчитывается регрессия

![]()

т.е. в уравнении линейной регрессии подставили (?)

2)рассчитывается коэффициент детерминации R2 для (*) множественной R2

3)рассчитывается x2расч = (n-r) R2,

n – количество наблюдений, r – порядок авторегрессионного процесса εi

4)по таблице x2 – распределения находим x2 табличное со степенями свободы r.

2. Оценивается регрессия и находится оценка ρ (по МНК)

3. Зная

ρ, оцениваем ![]() и

и

![]() (

(![]() ;

;

![]()

4.

Рассчитывается регрессия между

и

по уравнению (4.3): получаются новые оценки

![]() и

и ![]()

5. Вычисляются новые отклонения расчетных значений от фактических;

6. Возвращаемся к пункту 2). Процедуру выполняют, пока отклонения, полученные в пункте 2), не совпадут с отклонениями в пункте 5) до определенной точности.

В итоге получим уравнение (4.3), в котором автокорреляции в остатках не будет.