2. Двумерный анализ данных

Теперь мы можем перейти к более сложному виду анализа, каким является двумерный анализ. Здесь рассматривается связь между двумя переменными. Мы имеем пары наблюдений, полученные на одном объекте. Это могут быть, например, результаты по двум тестам. Нас интересует, как один изучаемый признак связан с другим.

Таблица 3. Взаимосвязь между видом СМИ и характером суждений

Суждение |

Вид СМИ |

Всего |

|

Газета «Московский комсомолец» |

Экспертный журнал |

||

Рациональное (причины, анализ) |

50 (19,6) |

200 (81,6) |

250 |

Оценочное (эмоционально-нравственное) |

205 (80,4) |

45 (18,4) |

250 |

|

255 (100) |

245 (100) |

500 |

В таблице 3 два столбца (для образования) и две строки, следовательно, размерность этой таблицы 2х2. Кроме того, имеются дополнительные крайний столбец и крайняя строка (маргиналы таблицы), указывающие общее количество наблюдений в данной строке или в столбце. В правом нижнем углу указана общая сумма, т. е. общее число наблюдений в выборке.

Обычно характер взаимоотношений между переменными в небольшой таблице можно определить даже «на глазок», сравнивая числа в столбцах или строках. Еще легче это сделать, если вместо абсолютных значений стоят проценты. Чтобы перевести абсолютные частоты, указанные в клетках таблицы, в проценты, нужно разделить их на маргинальные частоты и умножить на 100. Если делить на маргинал столбца, мы получим процент по столбцу.

Например, 50/255х100 = 19,6%, т. е. 19,6% газет МК имеют рациональные суждения. Если делить на маргинал строки, то мы получим другую величину - процент по строке.

Элементарная таблица сопряженности размерности 2х2 - это минимально необходимое условие для вывода о наличии взаимосвязи двух переменных.

3) Строится диаграмма распределения.

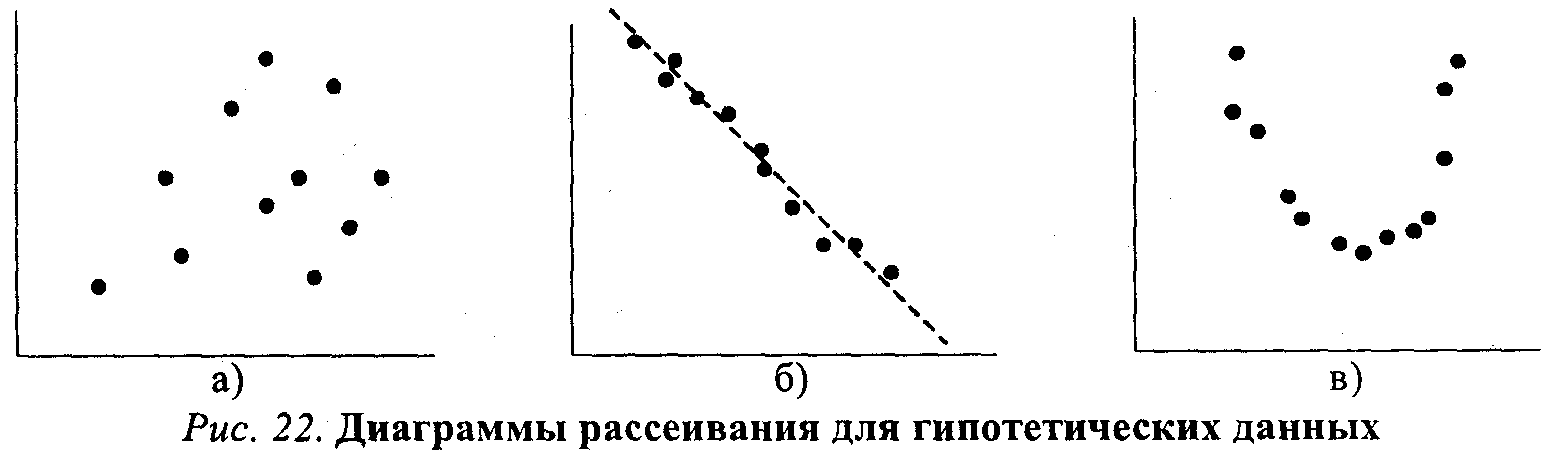

Между переменными могут существовать различные зависимости: линейные, нелинейные.

Между переменными Х и Y существует линейное отношение: если одна переменная возрастает по величине, то это же происходит и с другой. Очевидно, что чем более компактно, «скученно» располагаются точки-наблюдения вокруг пунктирной прямой линии (описывающей идеальное линейное отношение Х и Y), тем сильнее зависимость. На рисунке 22 приведены три диаграммы рассеивания.

Очевидно, что на рисунке 22а какая-либо связь между x и y попросту отсутствует. На рисунке 22б воображаемая прямая линия (отмечена пунктиром) пересекла бы диаграмму сверху вниз, из левого верхнего в правый нижний угол. Иными словами, линейная связь в этом случае имеет обратное направление: чем больше X, тем меньше зависимая переменная У.

Заметим также, что «кучность» расположения точек вдоль воображаемой прямой на рисунке 22б не очень велика, а значит и связь (корреляция) между переменными не только обратная, отрицательная, но еще и не очень сильная, умеренная.

Наконец, на рисунке 22в зависимую и независимую переменную связывает явно нелинейное отношение: воображаемый график нисколько не похож на прямую линию и напоминает скорее параболу.

Методы анализа, о которых сейчас пойдет речь, не годятся для этого нелинейного случая, так как обычная формула для подсчета коэффициента корреляции даст нулевое значение, хотя связь между переменными существует.

Существует обобщенный показатель, позволяющий оценить, насколько связь между переменными приближается к линейному функциональному отношению, которое на диаграмме рассеивания выглядит как прямая линия. Это коэффициент корреляции, измеряющий тесноту связи между переменными, т. е. их тенденцию изменяться совместно.

Само слово «корреляция» как раз и означает «взаимосвязь». Какого типа отношения возможны между двумя переменными? Ну, во-первых, признаки могут быть совершенно независимыми друг от друга. Тогда изменения одного никак не связаны с изменением другого. Мы говорим, что переменные не коррелированны между собой. Если признаки связаны, то сама связь может быть прямой или обратной.

В первом случае большим значениям одного признака соответствуют более высокие значения другого и наоборот.

Во втором случае увеличение первого признака сопровождается уменьшением второго, а уменьшение первого — увеличением второго.

Статистики говорят о положительной и отрицательной корреляции. Наконец, степень связи тоже может варьироваться от максимума, когда значения одного признака позволяют уверенно предсказывать значения другого, до ее полного отсутствия. Коэффициент корреляции отражает всю гамму возможных отношений. Его значение может варьироваться от +1 до — 1. Положительные значения указывают на прямую связь между переменными, отрицательные — на обратную. Нуль соответствует случаю отсутствия корреляции.

Пример. Предположим, что у многих людей измеряют рост и вес тела. Каждый человек описывается двумя показателями, и в результате образуются два ряда измерений. Сравнивая между собой пары измерений, мы стремимся выявить характер связи между переменными. Между ростом и весом тела существует довольно высокая положительная корреляция. Это значит, что высокий человек, как правило, весит больше, чем человек меньшего роста. Связь эта не однозначная: высокий человек может быть очень худым, а человек невысокого роста может быть очень полным. Поэтому значение коэффициента корреляции в данном случае находится где-то между 0 и +1, видимо, чуть ближе к единице.

Коэффициент корреляции по-разному вычисляется для измеренных показателей (рост, вес) и для ранжированных данных (оценки, предпочтения). Но его окончательная форма и интерпретация остаются теми же. Если данные носят качественный характер (мужчина — женщина, совершеннолетний — несовершеннолетний, работающий — пенсионер), то вместо коэффициента корреляции применяются другие меры связи, основанные на сравнении частот. Для тех случаев, когда два ряда получены с помощью разных шкал, имеются свои вычислительные процедуры. Но общая логика анализа сохраняется.

Социальные науки чаще всего имеют дело с явлениями, которые отличаются множественной детерминацией и контекстуальным характером. Поэтому необходима особая тщательность в интерпретации наблюдаемых фактов.