- •1. Определение и 2 направления развития искусственного интеллекта

- •2. Основные направления исследований в области ии

- •3)Моделирования биологических систем.

- •4. Условия для разработки и внедрения экспертных систем. Задачи, подходящие для создания экспертной системы.

- •Различие прототипов эс.

- •3. Интеллектуальные системы и признак структурированности задач.

- •Этапы проектирования эс: выбор проблемы. Коллектив разработчиков эс.

- •7. Основные программные блоки экспертной системы.

- •8. Этапы проектирования эс: оценка, стыковка и поддержка.

- •9. Различия бд и баз знаний

- •10. Продукционная модель знаний

- •11. Диагностические эс байесовского типа.

- •12. Семантические сети.

- •13. Фреймы.

- •14. Схема машины логического вывода. Особенности вывода на знаниях.

- •Стратегии получения знаний (извлечение, приобретение и формирование знаний).

- •Психологический аспект извлечения знаний.

- •Контактный слой:

- •Процедурный слой:

- •Когнитивный слой:

- •Лингвистический аспект извлечения знаний, общий код.

- •Проблема общего кода

- •Понятийная структура

- •Словарь пользователя

- •Текстологические и пассивные методы извлечения знаний.

- •Гносеологический аспект извлечения знаний, проблемы применения критериев научного знания.

- •Активные групповые методы извлечения знаний.

- •Активные индивидуальные методы извлечения знаний.

- •22. Структурирование знаний. Объектно–структурный подход и его свойства. Объектно-структурный анализ знаний о предметной области.

- •23. Алгоритм формирования поля знаний.

- •Уровни реализации моделей нейронных сетей (нс). Нейрокомпьютер. Сравнение архитектуры фон Неймана и архитектуры нейрокомпьютера.

- •Структура и свойства искусственного нейрона.

- •26. Типы нейронных сетей и типы нейронов в многослойной нс. Оценка числа нейронов в скрытых слоях.

- •27. Классы задач, решаемые нс. Примеры использования нс в различных предметных областях.

- •28. Определение и схема процесса обучения нс. От чего зависит качество обучения нс?

- •29. Алгоритм обратного распространения ошибки.

- •30. Обучение без учителя. Алгоритм Хебба.

- •Понятие самоорганизующейся нс. Настройка числа нейронов в скрытых слоях многослойной нс в процессе обучения.

- •1. Алгоритмы сокращения.

- •2. Конструктивные алгоритмы.

- •32. Нс с обратными связями (сеть Хопфилда и сеть Хемминга).

- •33. Когнитрон. Неокогнитрон.

- •34. Генетические алгоритмы. Отжиг.

- •35. Нечеткая логика. Лингвистическая переменная.

- •Основные понятия теории нечетких множеств: функция принадлежности, нечеткая переменная, нечеткое число.

32. Нс с обратными связями (сеть Хопфилда и сеть Хемминга).

Сети, имеющие соединения от выходов к входам, называются сетями с обратными связями.

В некоторых конфигурациях сетей с обратными связями предыдущие значения выходов возвращаются на входы; выход, следовательно, определяется как текущим входом, так и предыдущими выходами. По этой причине сети с обратными связями могут обладать свойствами, сходными с кратковременной человеческой памятью, сетевые выходы частично зависят от предыдущих входов.

Сеть Хопфилда. Нейронная сеть Хопфилда решает задачу восстановления по искажённому образцу ближайшего к нему эталонного.

Класс сетей Хопфилда содержит только один слой нейронов, выход каждого нейрона соединен с входами всех остальных нейронов. Обратные связи с выхода нейрона на его же вход отсутствуют.

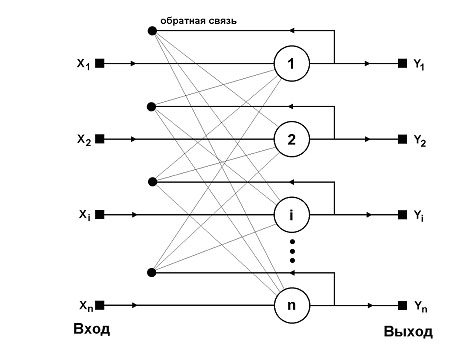

На рис. представлена структура сети Хопфилда общего вида, содержащая n нейронов.

Сети Хопфилда отличаются от других нейронных сетей следующими существенными признаками:

наличие обратных связей, идущих с выходов сетей на их входы по принципу «со всех на все»;

Расчёт весовых коэффициентов проводится на основе исходной информации перед началом функционирования сети

Сеть не нуждается в обучении

При предъявлении входного вектора сеть «сходится» к одному из заполненных в сети эталонов, представляющих множество равновесных точек, которые являются локальными минимумами функции энергии, содержащей в себе всю структуру взаимосвязей в сети.

Сеть Хопфилда может запомнить не более 0,15n образцов.

Теорема Кохена -Гроссберга, определяющая достаточное условие устойчивости сетей с обратными связями: сеть с обратными связями является устойчивой, если матрица ее весов симметрична и имеет нули на главной диагонали. (веса между слоями в этой сети могут рассматриваться в виде матрицы W, wij = wji(симметричность) и wii = 0 (нулевые элементы на диагонали)).

Для доказательства приведенной теоремы Кохена и Гроссберга используется функция энергии (функция Ляпунова):

![]()

![]()

где Е - искусственная энергия сети; wij - вес от выхода нейрона i к входу нейрона j; yj, yi - выходы нейрона I и j; xj - внешний вход нейрона j; θj – пороговое значение нейрона j.

Главное свойство энергетической функции состоит в том, что в процессе эволюции состояний нейронной сети согласно уравнению она уменьшается. Благодаря такому непрерывному стремлению к уменьшению энергия в конце концов должна достигнуть локального минимума и прекратить изменение. По определению такая сеть является устойчивой.

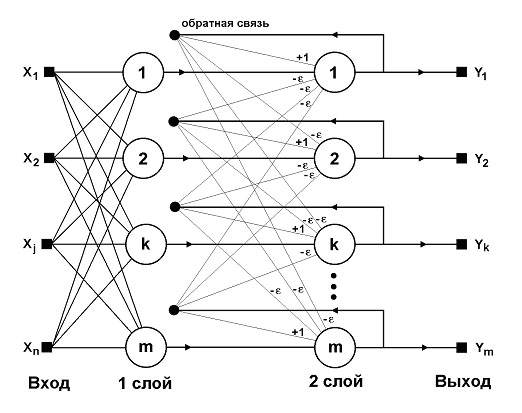

Сеть Хемминга. Искусственная нейронная сеть Хэмминга представляет собой сеть с двумя обрабатывающими слоями: первый слой - слой Хэмминга, второй слой - немного изменённая сеть Хопфилда.

Рис. Структурная схема сети Хэмминга.

В сети

Хемминга два слоя – первый и второй

слои состоят из m

нейронов и m

равно числу образцов. Нейроны первого

слоя имеют по n

входных синапсов, где - n

размерность входных векторов. Нейроны

второго слоя связаны между собой

обратными, отрицательными связями.

Обратная связь от аксона на владельца

нейрона равен +1. Суть работы состоит в

нахождении

расстояния Хемминга

от тестируемого образца до всех образцов.

Расстоянием Хемминга называется число

отличающихся битов в двух бинарных

векторах (например,

![]() - расстояние Хемминга равно 2).

- расстояние Хемминга равно 2).

Сеть должна выбрать образец с минимальным расстоянием Хемминга до поданного входного сигнала – в результате активируется один выход, отвечающий за данный эталонный образец.

При инициализации сети весовым коэффициентам первого слоя и порогу активационной функции присваиваются следующие значения:

![]() ,

i=0...n-1, k=0...m-1, где xik – i-ый элемент k-ого

образца.

,

i=0...n-1, k=0...m-1, где xik – i-ый элемент k-ого

образца.

Tk = n / 2, k = 0...m-1

Весовые коэффициенты тормозящих синапсов во втором слое берут равными некоторой величине 0 < e < 1/m. Синапс нейрона, связанный с его же аксоном имеет вес +1.