- •Часть I. Теория ошибок измерений

- •Глава 1. Элементы теории вероятностей

- •§ 1. События и их виды. Схема случаев

- •§ 2. Классическое определение вероятности

- •§ 3. Относительная частота (частость) и вероятность

- •§ 4. Теоремы сложения и умножения вероятностей

- •§ 5. Формула полной вероятности (теорема гипотез)

- •§ 6. Многократные повторные испытания. Формула бернулли

- •§ 7. Вероятнейшее число появлений события в схеме бернулли

- •§ 8. Локальная теорема лапласа

- •§ 9. Случайные величины. Формы задания закона распределения. Функция и точность распределения. Вероятность попадания в интервал

- •§ 10. Числовые характеристики случайной величины. Математическое ожидание, дисперсия и их свойства. Моменты

- •§ 11. Нормальный закон распределения. Интеграл вероятностей. Вероятность попадания в интервал при нормальном законе распределения. Нтегральная теорема лапласа

- •§ 12. Система двух случайных величин. Совместные и частные законы распределения

- •§ 13. Корреляция. Корреляционный момент и коэффициент корреляции. Уравнение регрессии

- •§ 14. Понятие о многомерном распределении. Корреляционная матрица

- •§ 15. Математическое ожидание, дисперсия и корреляционная матрица функций случайных величин

- •Глава 2. Элементы математической статистики и теория ошибок измерений

- •§ 16. Основные понятия математической статистики

§ 13. Корреляция. Корреляционный момент и коэффициент корреляции. Уравнение регрессии

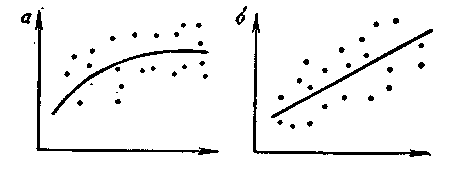

В § 12 мы познакомились с понятием вероятностной зависимости и определили ее как такую зависимость, когда с изменением случайной величины X изменяется закон распределения случайной величины Y. Как мы уже знаем, закон распределения, например, для непрерывной случайной величины задается кривой распределения у(х). В зависимости от того, что изменяем в выражении у(х) - ее вид или только некоторые числовые характеристики, - различают несколько типов вероятностной зависимости. Одним из наиболее распространенных типов такой зависимости является так называемая корреляционная зависимость, при которой с изменением х изменяется математическое ожидание у (рис. 23, а и б). Оба рисунка иллюстрируют эту зависимость, причем в первом случае изменение My происходит непрямолинейно (криволинейная корреляция), а во втором - по закону прямой линии (прямолинейная корреляция). Эту последнюю зависимость часто называют для краткости корреляцией. Если зависимость между X и Y будет установлена и выражена формулой, то ее можно использовать для надлежащей организации и обработки результатов эксперимента, например, измерений.

Рисунок 23.

Систему двух случайных величин, как и одну случайную величину, кроме задания закона совместного распределения, определяют еще числовыми характеристиками, так называемыми специальными начальными и центральными моментами порядка s, q.

![]() . (1.87)

. (1.87)

В частном случае, очевидно, имеем

(1.88)

(1.88)

В теории корреляции важнейшее значение имеет центральный смешанный момент второго порядка

![]() (1.89)

(1.89)

который называют корреляционным моментом и обозначают Kxy .

Его вычисляют по формулам

![]() (1.90)

(1.90)

![]() (1.91)

(1.91)

соответственно для прерывных и непрерывных случайных величин.

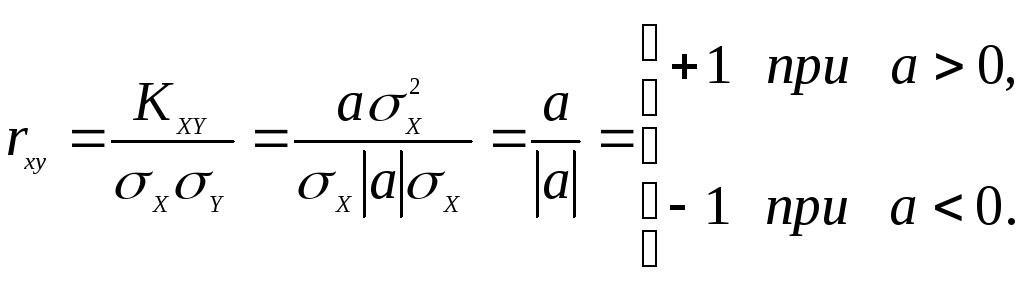

Момент Kxy как раз и характеризует силу, тесноту корреляции. Однако его значение зависит еще и от размерности случайных величин. Для того чтобы освободиться от последней, вычисляют так называемый коэффициент корреляции

![]() (1.92)

(1.92)

который численно характеризует силу корреляции в чистом виде.

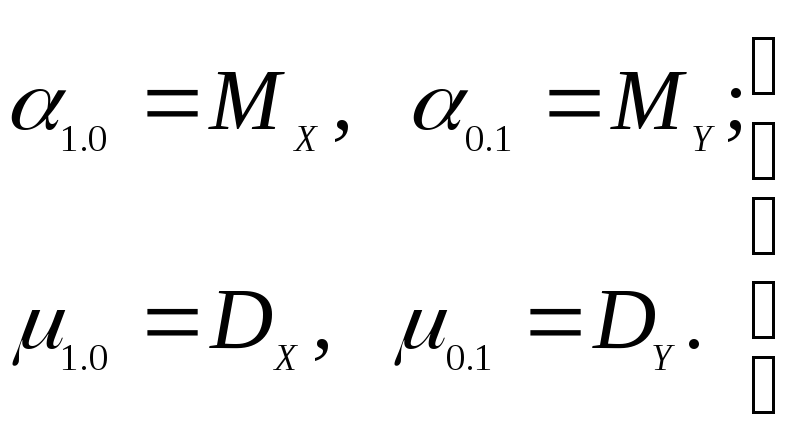

Коэффициент корреляции изменяется в пределах -1 ≤ r ≤ 1. Когда он равен +1 или -1, между х и у существует прямолинейная зависимость (рис. 24. а и б) у = ах + b.

Рисунок 24.

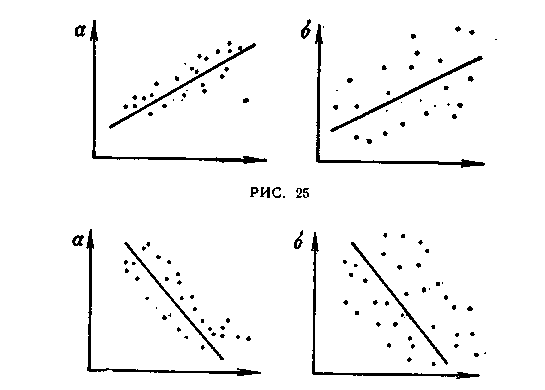

Рисунок 25.

Рисунок 26.

В случае r < 0 имеет место отрицательная корреляция с уменьшением (увеличением) X величина Y имеет тенденцию увеличиваться (уменьшаться); при r > 0 говорят о положительной корреляции- с уменьшением (увеличением) X величина Y имеет тенденцию уменьшаться (увеличиваться).

На рис. 25 показана положительная корреляция, причем в первом случае она более тесная, чем во втором (r1 > r2), а на рис. 26 — отрицательная корреляция, более тесная также в первом случае.

Если случайные величины X и Y независимы, то корреляционный момент Kxy = 0 (также с rXY = 0).

Две корреляционные случайные величины также и зависимы. Обратное утверждение не всегда имеет место, т. е. если две величины зависимы, то они могут быть как коррелированными, так и некоррелированными.

В том, что две зависимые величины могут быть некоррелированными, легко убедиться на следующем примере.

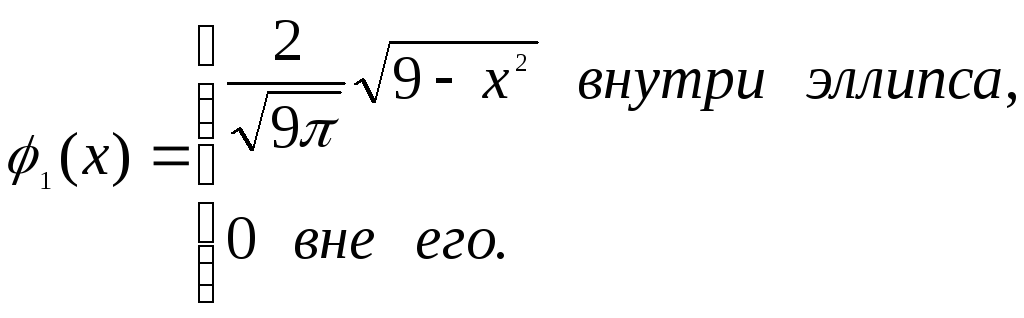

Пусть

поверхность распределения задана в

виде

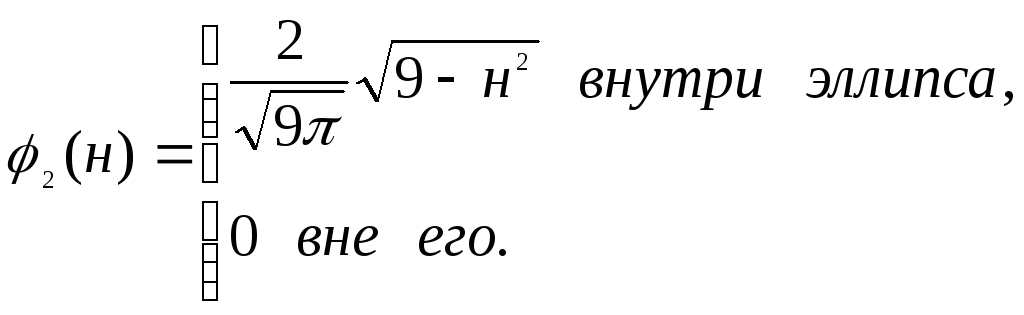

![]() внутри

эллипса

внутри

эллипса

![]() и

и

![]() вне его. Найдем корреляционный момент

по формуле

вне его. Найдем корреляционный момент

по формуле

![]() .

.

Так как плотность распределения

симметрична относительно оси Oу, то Мх = 0, аналогично MY = 0, так как плотность

симметрична относительно оси х. Поэтому

![]()

Учитывая, что f (xy) не содержит переменных, получим

![]()

Внутренний интеграл равен 0 (подынтегральная функция нечетна, пределы интегрирования симметричны относительно начала координат). Следовательно, Kxy = 0, т. е. x и у некоррелированы, однако зависимы, так как φ(xy) ≠ φ1(x) φ2(y).

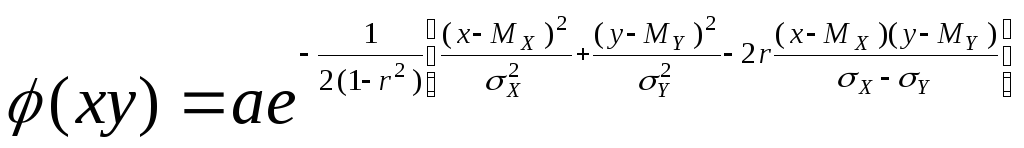

На практике часто встречаются двухмерные случайные величины, распределение которых нормально. В этом случае

,

,

где

![]() ,

а так

называемая экспонента ехр с

= еc.

,

а так

называемая экспонента ехр с

= еc.

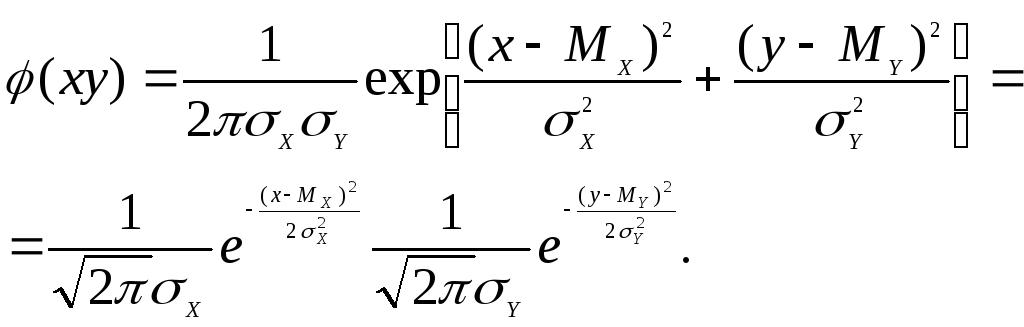

При нормальном законе распределения из некоррелированности следует и независимость х и у. В самом деле, пусть rXY = 0. Тогда

что и означает независимость случайных величин х и у.

Таким образом, если две случайные величины подчинены нормальному закону распределения, то некоррелированность и независимость понятия тождественны.

Корреляционную зависимость, кроме задания ее тесноты, необходимо характеризовать формой.

Форма прямолинейной связи между X и Y выражается в виде так называемого уравнения регрессии Y на X

![]() (1.93)

(1.93)

или

![]() (1.94)

(1.94)

где коэффициент

![]() (1.95)

(1.95)

- коэффициент регрессии у на х. На рис. 25, 26 сплошные линии являются уравнениями регрессии.

Существует уравнение регрессии х на у, имеющее вид

![]()

где

![]()

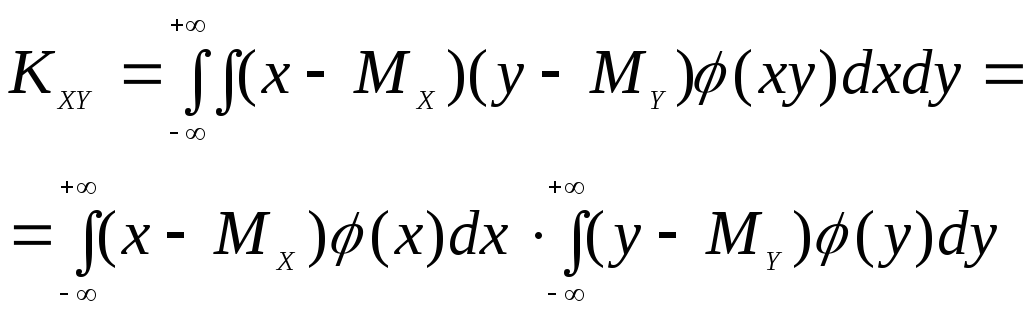

1.222. Доказать, что если случайные величины х и у независимы, то корреляционный момент Кхy = 0.

Р е ш е н и е. Воспользуемся формулой (1.91). Имеем для независимых величин

(1.96)

(1.96)

Но интегралы - сомножители в формуле (1.96) представляют собой центральные моменты первого порядка, равные нулю. Поэтому KXY = 0.

1.223. Доказать, что корреляционный момент

КXY = М [(х – МX)(у – МY)] (1.97)

можно представить в виде

КXY = МXY – МX МY (1.93)

У к а з а н и е. Раскрыть скобки в выражении (1.97) и воспользоваться свойствами математического ожидания.

1.224. Доказать, что если между величинами X и Y имеет место функциональная зависимость вида у = ах + b, то коэффициент корреляции | r | = 1.

Доказательство. Имеем МY = а МX + b.

Поэтому для корреляционного момента получим

![]()

Дисперсия DY = а2σ2 (по свойствам дисперсии (1.39 - 1.40), откуда σY = σY | a | σX. (величина а взята по модулю, так как по определению стандарт - величина всегда положительная). Поэтому

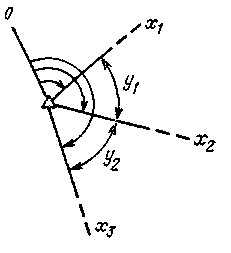

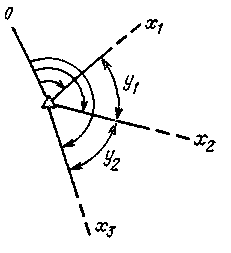

Рисунок 27.

1.225. Имеются три

независимые случайные величины

Z1,Z2

и

Z3

с известными

математическими ожиданиями

![]() и с. к. о.

и с. к. о.

![]() .

Найти коэффициент корреляции

между функциями

.

Найти коэффициент корреляции

между функциями

X = Z1 + Z2 , Y = Z1 + Z3;

и написать уравнение регрессии y на x.

Решение. Имея в виду формулы (1.92) и (1.98), находим, пользуясь свойствами математического ожидания (1.35).

![]()

![]()

![]()

![]()

![]() .

.

Поэтому

![]() на основании (1.45). Следовательно,

на основании (1.45). Следовательно,

![]()

На основании свойства дисперсии для

независимых величин имеем

![]() и

и

![]() Поэтому

Поэтому

.

.

Если

![]() , то

, то

![]()

В этом случае уравнение регрессии будет у = MY + 0,5(x - Мх) .

-

Доказать, что коэффициент корреляции между двумя углами у1 и у2, измеренными способом круговых приемов (рис. 27), равен r = - 0,5. Объяснить, что вызывает корреляцию этих углов. Построить уравнение регрессии у2 на у1 и у1 на у2.

-

Плотность распределения двухмерной случайной величины задана формулой

![]()

Найти с. к. о. σX, σY и коэффициент корреляции rxy.

Ответ: σX = √2.

1.228. Найти

коэффициент корреляции и написать

уравнение регрессии у2 на

у1, если y1

= x1 ,

у = х1

- х2, а

![]() .

.