- •Модуль 6. Обобщенный метод наименьших квадратов

- •6.1. Обобщенный метод наименьших квадратов

- •6.2. Гетероскедастичность. Взвешенный метод наименьших квадратов (Weighted Least Squares, wls)

- •Лабораторная № 6.1

- •Решение

- •6.3. Автокорреляция остатков

- •Конец примера

- •6.3.1. Статистика Дарбина - Уотсона

- •6.3.2. Применение статистики Дарбина-Уотсона для проверки гипотезы об отсутствии автокорреляции остатков

- •Пример 6.2.

- •Конец примера

- •6. Вопросы

Модуль 6. Обобщенный метод наименьших квадратов

В предыдущих разделах были рассмотрены модели парной и множественной линейной регрессии, а также задачи экономического анализа, решаемые с помощью этих моделей. Наиболее распространенным в практике статистического оценивания параметров уравнений регрессии является метод наименьших квадратов. Этот метод основан на ряде предпосылок относительно природы данных и результатов построения модели. Основные из них - это четкое разделение исходных переменных на зависимые и независимые, некоррелированность факторов, входящих в уравнения, линейность связи, отсутствие автокорреляции остатков, равенство их математических ожиданий нулю и постоянная дисперсия. Эмпирические данные не всегда обладают такими характеристиками, т.е. предпосылки МНК нарушаются. Применение этого метода в чистом виде может привести к таким нежелательным результат как смещение оцениваемых параметров, снижение их состоятельности, устойчивости, а в некоторых случаях может и вовсе не дать решения. Для смягчения нежелательных эффектов при построении регрессионных уравнений, повышения адекватности моделей существует ряд усовершенствований МНК, которые применяются для данных нестандартной природы.

6.1. Обобщенный метод наименьших квадратов

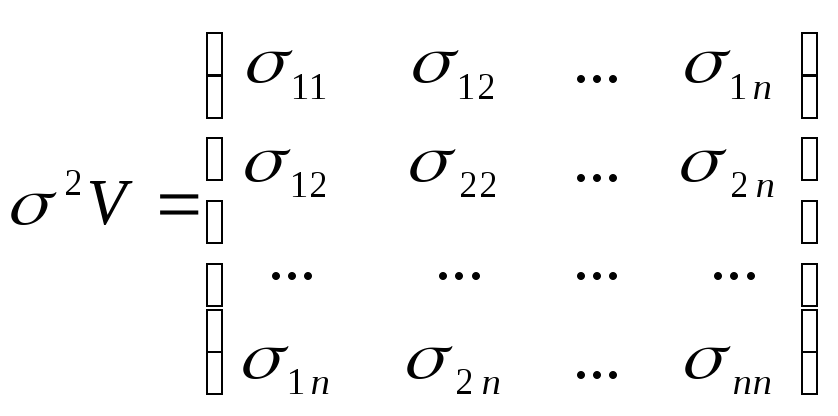

Пусть V— некоторая симметричная, положительно определенная матрица порядкапп,гдеп, как и прежде, число исходных статистических данных, т. е. объем имеющейся в нашем распоряжении выборки).

Пусть по прежнему М(i)=0 гдеi=1…n.предположим, что остатки i некоррелированы между собой, но имеют разные дисперсии. В этом случае квадратнуюматрицу ковариацийможно представить в виде симметричной положительно определенной матрицы

M[T] = 2V ( 6.0)

где cov(i, j) =ij при ij; cov(i,i)=ii – дисперсия элемента i.

Будем предполагать, что в этом соотношении число неизвестно, а матрица V известна. С точки зрения практической, прикладной последнее предположение в большинстве случаев нереалистично; однако в дальнейшем для некоторых частных случаев мы сможем отказаться от условия априорного знания матрицыV.

Задача заключается в отыскании оценок коэффициентов (см. 4.1.1.) в модели

у = Х+ , ( 6.0)

когда M[T] =2V.

Положительно определенная матрица допускает представление в виде РРТ, где матрицаРневырожденная. Поэтому запишемV= РРТ, так что

Р-1VРТ-1 =Е,( 6.0)

где Е– единичная матрица, и

(РТ)-1 Р-1= V-1 ( 6.0)

Умножим уравнение модели у = Х+ слева на матрицу Р-1, получим

у* = Х*+ * ( 6.0)

Где у*= Р-1у; Х* = Р-1Х и*= Р-1 .

Используя (6.3), легко показать, что M[**T] =2Е,

Т.е. (6.5) удовлетворяет всем предположениям обыкновенной модели наименьших квадратов. В частности (мы воспользуемся равенством (6.4)),

![]() (

0.6)

(

0.6)

Есть несмещенная линейная оценка вектора , обладающая наименьшей дисперсией и матрицей ковариаций:D[]=2(Х*ТХ*)-1=2(ХТV-1Х)-1.

Несмещенная оценка для 2может быть выведена как

![]()

Далее, если предположить, что удовлетворяет нормальному распределению, то этим же свойством будет обладать и*. Поэтомуобладает минимальной дисперсией в классе несмещенных оценок.

Оценка ,

определенная с помощью (6.6), представляет

собой оценку обобщенного метода

наименьших квадратов. Заметим, что

если мы применим к модели (6.2) обыкновенный

метод наименьших квадратов, то получим

оценку![]() ,

которая будет линейной и несмещенной,

ноне будетобладать

наименьшей дисперсией. Замена

обычного условияM(T)

=2Еусловием

(6.1) ведет к нарушению для обыкновенного

метода наименьших квадратов свойства

наименьшей дисперсии оценок.

,

которая будет линейной и несмещенной,

ноне будетобладать

наименьшей дисперсией. Замена

обычного условияM(T)

=2Еусловием

(6.1) ведет к нарушению для обыкновенного

метода наименьших квадратов свойства

наименьшей дисперсии оценок.