- •Комбинаторные формулы

- •Случайный эксперимент, элементарные исходы, события.

- •Классическое определение вероятности.

- •Статистическое определение вероятности.

- •Геометрическая вероятность

- •Непрерывное вероятностное пространство.

- •Формулы сложения вероятностей.

- •Условные вероятности.

- •Формула полной вероятности.

- •Формула Байеса

- •Повторные независимые испытания. Формула Бернулли.

- •Случайная величина, распределенная по закону Бернулли.

- •Асимптотические формулы для формулы Бернулли.

- •Дискретные случайные величины.

- •Математическое ожидание случайной величины.

- •Дисперсия случайной величины.

- •Свойства дисперсии.

- •Биномиальный закон распределения.

- •Непрерывные случайные величины.

- •Совместное распределение двух случайных величин.

- •Коэффициент корреляции.

- •Распределение Стьюдента.

- •Распределение Фишера.

- •Математическая статистика.

- •Выборочный метод.

- •Вариационный ряд.

- •Точечные оценки параметров генеральной совокупности.

- •Интервальные оценки.

- •Доверительный интервал для математического ожидания нормального распределения при известной дисперсии.

- •Доверительный интервал для математического ожидания нормального распределения при неизвестной дисперсии.

- •Доверительный интервал для дисперсии нормального распределения.

- •Задачи статистической проверки гипотез.

- •Проверка статистической гипотезы о математическом ожидании нормального распределения при известной дисперсии.

- •Проверка гипотезы о равенстве дисперсий.

- •Проверка статистической значимости выборочного коэффициента корреляции.

36

Правило 3-х I (трех “сигм”).

Пусть имеется нормально распределённая случайная величина x с математическим ожиданием, равным а и дисперсией s2. Определим вероятность попадания x в интервал (а – 3s; а + 3s), то есть вероятность того, что x принимает значения, отличающиеся от математического ожидания не более, чем на три среднеквадратических отклонения.

P(а – 3s< x < а + 3s)=Ф(3) – Ф(–3)=2Ф(3)

По таблице находим Ф(3)=0,49865, откуда следует, что 2Ф(3) практически равняется единице. Таким образом, можно сделать важный вывод: нормальная случайная величина принимает значения, отклоняющиеся от ее математического ожидания не более чем на 3s.

(Выбор числа 3 здесь условен и никак не обосновывается: можно было выбрать 2,8, 2,9 или 3,2 и получить тот же вероятностный результат. Учитывая, что Ф(2)=0,477, можно было бы говорить и о правиле 2–х “сигм”.)

Совместное распределение двух случайных величин.

Пусть пространство элементарных исходов W случайного эксперимента таково, что каждому исходу wij ставиться в соответствие значение случайной величины x, равное xi и значение случайной величины h, равное yj.

Примеры:

1.Представим себе большую совокупность деталей, имеющих вид стержня. Случайный эксперимент заключается в случайном выборе одного стержня. Этот стержень имеет длину, которую будем обозначать x и толщину—h (можно указать другие параметры—объем, вес, чистота обработки, выраженная в стандартных единицах).

2.Если результат эксперимента—случайный выбор какого–либо предприятия в данной области, то за x можно принимать объем производства отнесенный к количеству сотрудников, а за h—объем

продукции, идущей на экспорт, тоже отнесенной к числу сотрудников. В этом случае мы можем говорить о совместном распределении случайных

величин x и h или о “двумерной” случайной величине.

Если x и h дискретны и принимают конечное число значений (x – n значений, а h – k значений), то закон совместного распределения случайных величин x и h можно задать, если каждой паре чисел xi, yj (где xi принадлежит множеству значений x, а y j—множеству значений h) поставить в соответствие вероятность pij, равную вероятности события, объединяющего все исходы wij (и состоящего лишь из этих исходов), которые приводят к значениям

x = xi; h = y j.

Такой закон распределения можно задать в виде таблицы:

|

|

|

|

|

|

|

|

37 |

|

|

|

|

|

|

|

|||

|

y1 |

|

|

y2 |

|

¼ |

|

|

yj |

|

¼ |

|

yk |

|

|

|

|

|

h |

|

|

|

|

|

|

|

|

|

|

||||||||

x |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

x1 |

|

р11 |

|

|

р12 |

|

¼ |

|

|

р1j |

|

¼ |

|

р1k |

|

|

P1 |

|

¼ |

|

¼ |

|

|

¼ |

|

¼ |

|

|

¼ |

|

¼ |

|

¼ |

|

|

¼ |

(*) |

xi |

|

рi1 |

|

|

рi2 |

|

¼ |

|

|

рij |

|

¼ |

|

рik |

|

|

Pi |

|

¼ |

|

¼ |

|

|

¼ |

|

¼ |

|

|

¼ |

|

¼ |

|

¼ |

|

|

¼ |

|

xn |

|

рn1 |

|

|

рn2 |

|

¼ |

|

|

рnj |

|

¼ |

|

рnk |

|

|

Pn |

|

|

|

P1 |

|

|

P2 |

|

¼ |

|

|

Pj |

|

¼ |

|

Pk |

|

|

¼ |

|

|

|

n |

k |

= 1 |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

Очевидно |

å å p j |

|

|

|

|

|

|

|

|

|

|

|

|

|

||||

|

|

i |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

||

|

|

i =1 j =1 |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

||

Если просуммировать все рij в i–й строке, то получим |

|

|

||||||||||||||||

|

|

|

|

|

|

|

|

|

|

k |

= P |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

å pj |

|

|

|

|

|

|

||||

|

|

|

|

|

|

|

|

|

|

i |

|

i |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

j =1 |

|

|

|

|

|

|

|

|

||

вероятность того, что случайная величина x примет значение xi. Аналогично, если просуммировать все рij в j–м столбце, то получим

|

|

|

|

|

|

|

n |

P j |

|

|

|

|

|

|

|

å pj = |

|

|

|

|

|

|

|

|

i |

|

|

|

|

|

|

|

|

i =1 |

|

вероятность того, что h принимает значение y j. |

||||||||

Соответствие |

xi ® Pi |

|

(i = 1,2,¼,n) |

определяет закон распределения x, |

||||

также как соответствие yj ® P j |

(j = 1,2,¼,k) определяет закон распределения |

|||||||

случайной величины h. |

|

|

|

k |

|

|||

|

M |

|

n |

|

M |

|

|

|

Очевидно |

x |

= å x P |

, |

h |

= å yj Pj |

. |

||

|

i i |

|

j =1 |

|||||

|

|

|

i =1 |

|

|

|

|

|

Раньше мы говорили, что случайные величины x и h независимы, если pij=Pi×P j (i=1,2,¼,n; j=1,2,¼,k).

Если это не выполняется, то x и h зависимы.

В чем проявляется зависимость случайных величин x и h и как ее выявить из таблицы?

Рассмотрим столбец y1. Каждому числу xi поставим в соответствие число

1 |

|

|

pi/1= |

pi |

(1) |

P |

||

1 |

|

|

которое будем называть условной вероятностью x= xi при h=y1. Обратите внимание на то, что это не вероятность Pi события x= xi, и сравните формулу (1)

с уже известной формулой условной вероятности P(A / B) = |

P(A 1 B) . |

Соответствие |

P(B) |

|

|

xi®рi/1, (i=1,2,¼,n) |

|

38

будем называть условным распределением случайной величины x при h=y1.

Очевидно ån pi /1 = 1.

i =1

Аналогичные условные законы распределения случайной величины x можно построить при всех остальных значениях h, равных y2; y3,¼, yn ,ставя в

соответствие числу xi условную вероятность pi/j = |

pij |

ån |

p |

= 1 |

). |

|

P |

||||||

(i =1 |

i / j |

|

||||

|

j |

|

|

|

|

В таблице приведён условный закон распределения случайной величины x при h=yj

x |

|

x1 |

|

|

x2 |

|

¼ |

|

xi |

|

¼ |

|

xn |

|

pi/j |

|

p j |

|

|

p j |

|

|

|

p j |

|

|

|

pj |

|

|

1 |

|

|

2 |

|

¼ |

|

i |

|

¼ |

|

n |

|

|

|

|

Pj |

|

|||||||||||

Pj |

Pj |

Pj |

|

|||||||||||

|

|

|

|

|

|

|

|

|

|

|

Можно ввести понятие условного математического ожидания x при h = yj

|

|

|

j |

= |

1 å x pj |

||

M(x / h = y ) = å x pi |

|||||||

|

n |

|

|

|

|

n |

|

j |

|

i |

|

|

|

i =1 |

i i |

i =1 |

P j |

|

P j |

||||

Заметим, что x и h равноценны. Можно ввести условное распределение h при x=xi соответствием

yj ® |

pij |

(j = 1,2,¼,k) |

|||||

Pi |

|||||||

|

|

|

|

|

|

||

Также можно ввести понятие условного математического ожидания |

|||||||

случайной величины h при x=xi : |

|

p j |

|

|

|||

|

|

k |

1 |

k |

|||

M(h / x = x ) = |

å yj |

i |

= |

|

å yj p j |

||

|

|

||||||

i |

j =1 |

Pi |

Pi |

i |

|||

|

|

j =1 |

|||||

Из определения следует, что если x и h независимы, то все условные законы распределения одинаковы и совпадают с законом распределения x (напоминаем, что закон распределения x определяется в таблице (*) первым и последним столбцом). При этом очевидно, совпадают все условные математические ожидания М(x/h = yj) при j = 1,2,¼,k, которые равны Мx.

Если условные законы распределения x при различных значениях h различны, то говорят, что между x и h имеет место статистическая зависимость.

Пример I. Пусть закон совместного распределения двух случайных величин x и h задан следующей таблицей. Здесь, как говорилось ранее, первый и последний столбцы определяют закон распределения случайной величины x, а первая и последняя строки – закон распределения случайной величины h.

39

h |

1 |

2 |

|

3 |

|

x |

|

|

|

|

|

10 |

1/36 |

0 |

0 |

|

1/36 |

20 |

2/36 |

1/36 |

0 |

|

3/36 |

30 |

2/36 |

3/36 |

2/36 |

|

7/36 |

40 |

1/36 |

8/36 |

16/36 |

|

25/36 |

|

6/36 |

12/36 |

18/36 |

|

|

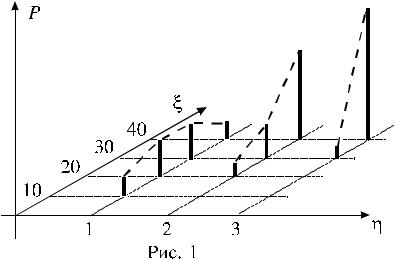

Полигоны условных распределений можно изобразить на трехмерном |

графике (рис. 1). |

Здесь явно просматри- |

вается зависимость услов- |

ного закона распределения |

x от величины h. |

Пример II. (Уже встре- |

чавшийся). |

Пусть даны две неза- |

висимые случайные вели- |

чины x и h с законами |

распределения |

x |

0 |

1 |

Р |

1/3 |

2/3 |

h |

1 |

2 |

Р |

3/4 |

1/4 |

Найдем законы распределений случайных величин a=x+h и b=x*h

a |

1 |

2 |

3 |

|

b |

0 |

1 |

2 |

Р |

3/12 |

7/12 |

2/12 |

|

Р |

4/12 |

6/12 |

2/12 |

Построим таблицу закона совместного распределения a и b.

b |

0 |

1 |

2 |

|

a |

|

|

|

|

1 |

3/12 |

0 |

0 |

3/12 |

2 |

1/12 |

6/12 |

0 |

7/12 |

3 |

0 |

0 |

2/12 |

2/12 |

|

4/12 |

6/12 |

2/12 |

|

Чтобы получить a=2 и b=0, нужно чтобы x приняла значение 0, а h приняла значение 2. Так как x и h независимы, то

Р(a=2; b=0)= Р(x=0; h=2)=Р(x=0)*Р(h=2)=1/12.

Очевидно также Р(a=3; b=0)=0.

40

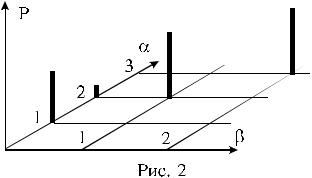

Построим полигоны условных распределений. Здесь зависимость a от b довольно близка к функциональной: значению b=1 соответствует единст-

венное a=2, значению b=2 соот-

ветствует единственное a=3, но при

b=0 мы можем говорить лишь, что a с

вероятностью 43 принимает значение 1

и с вероятностью 41 – значение 2.

Пример III.

Рассмотрим закон совместного распределения x и h, заданный таблицей

|

h |

0 |

1 |

|

|

2 |

|

|

|

|

|

|

||

|

x |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

1 |

1/30 |

3/30 |

|

|

2/30 |

|

1/5 |

|

|

|

|||

|

2 |

3/30 |

9/30 |

|

|

6/30 |

|

3/5 |

|

|

|

|||

|

3 |

1/30 |

3/30 |

|

|

2/30 |

|

1/5 |

|

|

|

|||

В этом |

|

1/6 |

3/6 |

|

|

2/6 |

|

|

|

|

h=yj)=P(x=xi)*P(h=yj), |

|||

случае |

выполняется |

условие |

P(x=xi; |

|||||||||||

i=1,2,3¼; j=1,2,3,¼ |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

Построим законы условных распределений |

|

|

|

|

|

|||||||||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

x |

|

|

|

|

1 |

|

|

2 |

|

|

3 |

|

|

ph=1 (x) = ph=2 (x) = |

|

1/5 |

|

3/5 |

|

1/5 |

|

|

|||||

|

= ph=3 (x) = ph=4 (x) |

|

|

|

|

|

||||||||

|

|

|

|

|

|

|

|

|

|

|

|

|||

Законы условных распределений не отличаются друг от друга при h=1,2,3

исовпадают с законом распределения случайной величины x.

Вданном случае x и h независимы.

Характеристикой зависимости между случайными величинами x и h служит математическое ожидание произведения отклонений x и h от их центров распределений (так иногда называют математическое ожидание случайной величины), которое называется коэффициентом ковариации или просто ковариацией.

cov(x; h) = M((x–Mx)(h–Mh)) Пусть x = {x1, x2, x3,¼, xn}, h = {y1, y2, y3,¼,yn}. Тогда

n k |

|

cov(x; h)= å å (xi - Mx)(yj - Mh)P((x = xi ) 1(h = yj )) |

(2) |

i =1 j =1

41

Эту формулу можно интерпретировать так. Если при больших значениях x более вероятны большие значения h, а при малых значениях x более вероятны малые значения h, то в правой части формулы (2) положительные слагаемые доминируют, и ковариация принимает положительные значения.

Если же более вероятны произведения (xi – Mx)(yj – Mh), состоящие из сомножителей разного знака, то есть исходы случайного эксперимента, приводящие к большим значениям x в основном приводят к малым значениям h и наоборот, то ковариация принимает большие по модулю отрицательные значения.

В первом случае принято говорить о прямой связи: с ростом x случайная величина h имеет тенденцию к возрастанию.

Во втором случае говорят об обратной связи: с ростом x случайная величина h имеет тенденцию к уменьшению или падению.

Если примерно одинаковый вклад в сумму дают и положительные и отрицательные произведения (xi – Mx)(yj – Mh)pij, то можно сказать, что в сумме они будут “гасить” друг друга и ковариация будет близка к нулю. В этом случае не просматривается зависимость одной случайной величины от другой.

Легко показать, что если

P((x = xi)∩(h = yj)) = P(x = xi)P(h = yj) (i = 1,2,¼,n; j = 1,2,¼,k), òî cov(x; h)= 0.

Действительно из (2) следует

n |

k |

|

å å xi - Mx yj - Mh P x = xi P h = yj = |

||

i =1 j =1 |

|

|

n |

xi |

k |

= å |

- Mx P x = xi × å yj - Mh P h = yj = |

|

i =1 |

|

j =1 |

= M x - Mx M h - Mh = 0 × 0 = 0

Здесь использовано очень важное свойство математического ожидания: математическое ожидание отклонения случайной величины от ее математического ожидания равно нулю.

Доказательство (для дискретных случайных величин с конечным числом значений).

n |

n |

n |

M x - Mx = å |

xi - Mx P xi = å xi P xi - Mx å P xi = Mx - Mx = 0 |

|

i =1 |

i =1 |

i =1 |

Ковариацию удобно представлять в виде

cov(x; h)=M(xh–xMh–hMx+MxMh)=M(xh)–M(xMh)–M(hMx)+M(MxMh)= =M(xh)–MhMx–MxMh+MxMh=M(xh)–MxMh

Ковариация двух случайных величин равна математическому ожиданию их произведения минус произведение математических ожиданий.

42

Легко доказывается следующее свойство математического ожидания: если x и h—независимые случайные величины, то М(xh)=МxМh. (Доказать самим,

n m

используя формулу M(xh) = å å xi yj P x = xi P h = yj )

i =1 j =1

Таким образом, для независимых случайных величин x и h cov(x;h)=0.