- •Нейронные сети в компьютерной инженерии

- •1.2. Основные типы архитектуры нейронных сетей

- •1.3 Сети прямого распространения

- •1.3.1 Однослойные сети

- •1.3.2 Многослойные сети

- •1.4 Конкурентные сети

- •1.4.4 Самоорганизующиеся карты Кохонена

- •1.5 Рекуррентные сети

- •Сеть Хопфилда

- •2.1 Проектирование нейросетевых систем

- •2.2 Основные задачи, решаемые с применением нейронных сетей

- •3.Реализация нейронных сетей

- •3.1 Программная реализация нс

- •3.2 Элементная база аппаратной реализации нс

- •3.3 Аппаратная реализация нейрокомпьютеров

- •Нейроускорители на базе плис.

- •Нейроускорители на базе каскадного соединения сигнальных процессоров

2.2 Основные задачи, решаемые с применением нейронных сетей

Нейронная сеть,

прежде всего, является универсальным

апроксиматором нелинейной векторной

функции нескольких переменных Y=f(X),

где X- входной иYвыходной вектор. Постановка многих

практических задач может быть сведена

к именно к аппроксимационному

представлению. Необходимо построить

такое отображение![]() ,

чтобы на каждый возможный входной сигналXформировался правильный

выходной сигнал в соответствии: а) со

всеми примерами обучающей выборки; б)

со всеми возможными входными сигналами,

которые не вошли в обучающую выборку

(что значительно сложнее).

,

чтобы на каждый возможный входной сигналXформировался правильный

выходной сигнал в соответствии: а) со

всеми примерами обучающей выборки; б)

со всеми возможными входными сигналами,

которые не вошли в обучающую выборку

(что значительно сложнее).

Именно поэтому, нейросети находят широкое применение при решении многих проблем, к которым относятся: аппроксимация и интерполяция, распознавание и классификация образов и изображений, сжатие данных, прогнозирование, идентификация, управление, ассоциативная память и многие другие.

В случае обучения с учителем отображение частично задается с помощью обучающей выборки – множества пар (Xi,Yi). Число этих пар (обучающих примеров), как правило, существенно меньше числа возможных сочетаний входных значений. Рассмотрим прикладные возможности НС.

Задача классификации(распознавания).

В этом случае X– некоторое представление образа (в пространстве признаков), аY– номер класса, к которому принадлежит этот образ. Для определенности предположим, что имеется набор данных, каждый из которых представляетm-мерный векторX. Таким образом, матрица исходных данных состоит изnстрок иmстолбцов. На входы сети подаются поочередно наборы данных. То есть каждый вход соответствует компоненте входного вектора. Каждый выход нейросети соответствует своему классу (дляMклассов, как правило, используетсяMвыходов). Задачей НС является разделение исходных данных на группы (классы) в некотором смысле похожих объектов (образов). Эта задача может быть решена с помощью НС различных типов, например, многослойной нейросетью с прямым распространением путем обучения с учителем. С другой стороны при решении этой задачи можно использовать сеть (или карту) Кохонена с использованием обучения без учителя. В последнее время для этих целей все чаще применяются сети радиального базиса.

В случае многослойного перцептрона количество слоев, как правило, не превышает трех. Для классификации используются выходные переменные обычно с применением двух видов кодирования: 1) бинарном; 2) 1- из M. В случае бинарного представления выходной слой содержит один нейрон, выход которого может принимать два значения (0 или 1). При использовании кодирования 1- изMкаждому классу соответствует свой нейрон, значение выхода которого равно 1 при нулевых сигналах остальных нейронов. Например, для трех классов имеем следующие коды выходов НС: (100), (010), (001). В режиме распознавания каждый из выходных нейронов имеет числовые значения в интервале от 0 до 1. Для определения класса необходимо определить, достаточно ли близки выходные значения к 0 или 1. На практике, как правило, допускается расхождение в пределах 5%, что вполне достаточно для большинства практических задач.

Как отмечалось, при классификации могут использоваться и самообучающиеся сети (или карты) Кохонена. Это подход применяется, прежде всего, для предварительного анализа данных. При этом на этапе обучения похожие в некотором смысле данные объединяются в кластеры. На этапе распознавания подаваемый входной образ относится к одному из известных классов. Следует отметить, что в том случае, когда входной вектор «не похож» на известные НС, можно сформировать для него новый класс.

Задача прогнозирования.

В задачах прогнозирования в качестве входных сигналов X используются временные ряды, представляющие значения контролируемых параметров на некотором интервале времени. В качестве выходных сигналов Y (НС) обычно выступает некоторое множество переменных, являющееся подмножеством переменных входных сигналов. Здесь целью является прогноз будущих значений переменной на основе ее предыдущих значений. Прогнозирование временных рядов часто сводится к регрессии. Следующее значение ряда прогнозируется на основе некоторого числа его предыдущих значений. При идентификации таких закономерностей, обычно применяется метод скользящих окон, который использует два окна Wi и W0 фиксированных размеров n и m, скользящих вдоль временной оси t. Для фиксированного размера окна последовательность предыдущих значений Wi0, …,Win связана с последовательностью будущих значений Wo0, …,Wom . Вид связи определяется установленными данными. Далее для поиска двух конфигураций значений могут быть использованы различные методы. При использовании НС пара Wi -> W0 принимается в качестве обучающего вектора. Оба окна скользят вдоль временного ряда с фиксировнным размером шага s. Получающиеся пары используются в качестве элементов обучающей выборки. Далее, НС обучается на этой выборке, извлекает скрытые закономерности и на этой основе строит оценку прогноза.

Применяются два основних вида прогнозирования:

Многошаговый прогноз, используемый при необходимости долгосрочного прогноза, цель которого состоит в идентификации общин тенденций и наиболее важних поворотних точек во временном ряду. При этом для предсказания временного ряда в фиксированный период используется конфигурация текучих значений. Затем прогноз снова вводится в сеть для прогнозирования следующего периода.

Одношаговый прогноз, где в отличие от предыдущего случая повторно вводить спрогнозированные ранее данные не требуется. НС предсказывает значение ряда на какой-либо момент времени и для каждого последующего прогнозного значения использует фактическую величину, а не значение, которое было предсказано ранее.

При

решении задачи

идентификации

X

и Y

представляют входные и выходные сигналы

системы. В этом случае Y=f(X)описывает

соотношение между входами и выходами

в неизвестной системе без памяти

(инвариантной во времени). Тогда обучающая

выборка – множество пар {Xi,Yi}

может быть использована для обучения

НС, которая представляет модель этой

системы. Разность (di

- yi)

между требуемым откликом di

и

фактическим выходом yi

составляет вектор ошибки сигнала ei

, который используется для определения

параметров сети при минимизации

среднеквадратичной ошибки

![]() .

.

В задачах управления входом X является множество контролируемых параметров управляемого объекта, а выход Y определяет управляющее воздействие на объект. Системы управления, в которых применяются НС, являются одной из возможных альтернатив классических методов управления.

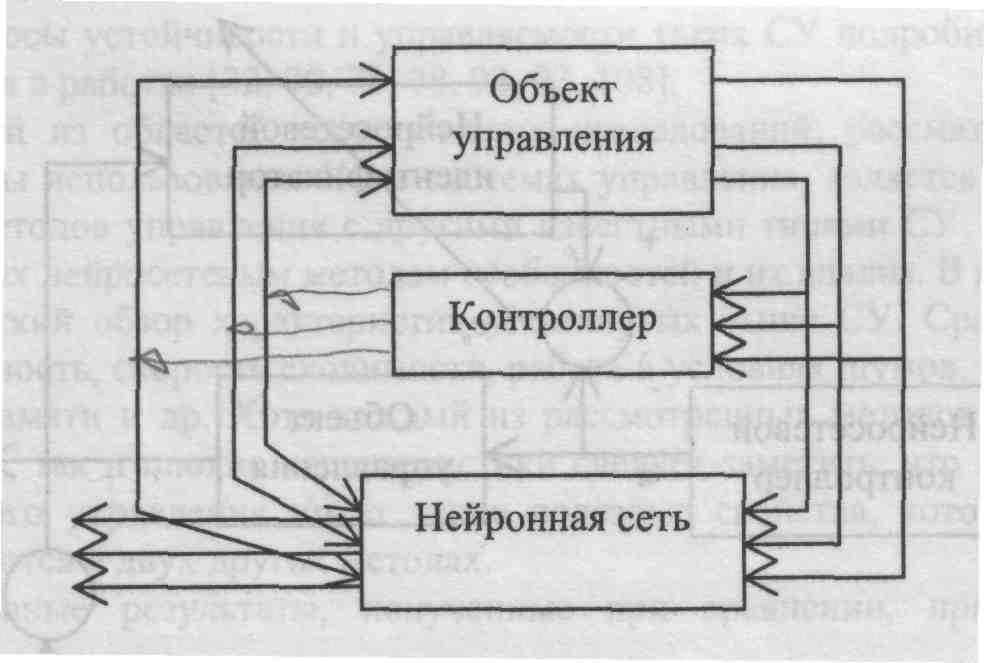

Одним из первых методов нейросетевого управления является метод предложенный Уидроу, который основан фактически на “копировании” существующего контроллера. Архитектура такой системы управления показана на рис.20 [НС в управлении??]. Автор назвал его методом построения экспертной системы за счет получения знаний

Рис. 20. Копирование существующего контроллера

Сейчас разработаны и широко используются на практике различные архитектуры нейросетевого управления. В этом случае, назначением нейросетевого контроллера является выработка адекватного управляющего сигнала управления динамикой состояний объекта ( переход от начального состояния до требуемого конечного состояния должен происходить по оптимальной траектории). Контроль состояния объекта и вид нейросетевого контроллера зависят от выбранного алгоритма обучения и структуры системы управления. Наиболее распространенными на практике являются: 1) схема прямого (непосредственного) управления; 2) схема косвенного управления. Как правило, при обучении используется метод обратного распространения.

При

использовании схемы прямого управления

параметры нейросетевого контроллера

регулируются таким образом, чтобы

уменьшить непосредственно ошибку выхода

ey

(рис.21). При этом минимизируется целевая

функция – среднеквадратичная ошибка

на выходе объекта управления

![]() .

.

Рис.21 Схема прямого управления

В случае применения схемы косвенного управления параметры объекта определяются в каждый момент времени и затем используются для оценки параметров контроллера, как показано на рис.22. К недостаткам этой схемы следует отнести то, что идентификация и управление основаны только на ошибке eu и поэтому минимизация ошибки на выходе ey не может быть гарантирована.

Рис.22 Схема косвенного управления.

Фильтрация используется для извлечения полезной информации из набора зашумленных данных. Шумы возникают по разным причинам, например, при передаче информационных сигналов через зашумленный канал или в результате измерений с помехами. Фильтры чаще всего применяются при решении следующих задач:

1) Фильтрация (filtering) - извлечение полезной информации в дискретные моменты времени t из данных, полученных из данных до момента t включительно;

2) Сглаживание (smoothing), которое отличается от предыдущей обработки тем, что при этом можно использовать данные, полученные не только до момента t, но и после него.

При моделировании фильтров задача построения фильтра фактически сводится к идентификации параметров исследуемого типа фильтра. Здесь по обучающей выборке определяются параметры фильтра, которые далее используются при фильтрации. Особый интерес представляют адаптивные фильтры, где эти параметры могут оперативно подстраиваться.

При обработке изображений также широко применяется фильтрация с применением НС. Например, разработан перспективный метод низкочастотной фильтрации, основанный на четырехслойной НС прямого распространения [Книга 7. под ред.. Галушкина, с. 10], представленной на рис. 23.

Рис.23 Фильтрация изображений

Здесь на входы НС подаются сигналы x1,x2,…,xnс помехами, а на выходах сети формируется откликy1,y2,…,ynбез помех. Суть этого подхода к фильтрации состоит в следующем. На втором слое НС выполняется дискретное преобразование Фурье, в результате которого выходу каждого нейрона второго слоя соответствует своя линия частотного спектра. На третьем слое непосредственно выполняется фильтрация в частотной области. Путем коррекции синаптических весов на следующий слой передаются выходные сигналы только тех нейронов, частоты которых входят в полосу пропускания данного фильтра. На выходном слое выполняется обратное преобразование Фурье, которое превращает спектр в отфильтрованный сигнал. Настройка третьего слоя позволяет гибко менять параметры фильтра, что позволяет выполнять фильтрацию в различных частотных областях и выполнять, например, контрастирование, выравнивание освещенности, удаление мелких локальных объектов и т.п.