- •Учреждение образования «Высший государственный колледж связи»

- •Теория электросвязи

- •Раздел 1. Основы анализа сигналов.

- •1.1. Основные элементы функционального анализа сигналов. Норма и метрика.

- •1.2 Ортогональные сигналы. Ортонормированный базис. Обобщенный ряд Фурье

- •Раздел 2. Основы спектрального анализа сигналов

- •2.1 Теоремы о спектрах

- •2.3. Спектры модулированных сигналов.

- •2.3.1 Спектры амплитудно модулированных сигналов

- •2.3.2 Спектр сигналов с угловой модуляцией

- •Раздел 3. Аналитический сигнал и преобразования Гильберта

- •3.1 Аналитический сигнал. Основные понятия и определения. Спектр аналитического сигнала.

- •3.2 Преобразования Гильберта и его свойства. Применение пре образования Гильберта.

- •Раздел 4. Основы корреляционного анализа сигналов

- •4.1. Автокорреляционная функция сигналов

- •4.2. Взаимокорреляционная функция двух сигналов

- •Раздел 5. Основные элементы цифровой обработки сигналов

- •5.1. Дискретное преобразование Фурье

- •5.2. Быстрое преобразование Фурье

- •Раздел 6. Математические модели приема сигналов на фоне помех

- •6.1. Стационарные и эргодические случайные процессы.

- •6.2. Спектральное представление стационарных случайных процессов. Теорема Винера-Хинчина

- •Раздел 7. Математические модели приема сигналов на фоне помех (окончание)

- •7.1 Типовые модели случайных сигналов

- •7.2 Узкополосные случайные сигналы

- •Раздел 8. Основные сведения о шумоподобных сигналах

- •8.1 Шумоподобные сигналы и их свойства. Применение шумоподобных сигналов.

- •Раздел 9. Основы теории разделения сигналов

- •9.1 Основные положения линейной теории сигналов.

- •9.2 Структурная схема системы многоканальной передачи информации.

- •Раздел 10. Основные положения теории передачи информации

- •10.1 Информационные характеристики дискретных сообщений и сигналов

- •10.2 Взаимная информация

- •10.3. Информация в непрерывных сигналах. Дифференциальная энтропия.

- •10.4. Пропускная способность канала связи

- •10.5. Информация в непрерывных сообщениях. Эпсилон-энтропия

- •Раздел 11. Принципы оптимальной обработки сигналов на фоне помех

- •11.1. Задача оптимального приёма дискретных сообщений

- •11.2. Элементы теории решений

- •11.3. Критерии оптимизации приёма дискретных сообщений

- •11.4 Алгоритм оптимального приёма при полностью известных сигналах. (Когерентный приём)

- •Раздел 12. Принципы оптимальной обработки сигналов на фоне помех (продолжение)

- •16.5 Реализация алгоритма оптимального приема на основе корреляторов

- •12.2 Реализация алгоритма оптимального приёма на основе согласованных фильтров. Свойства согласованного фильтра

- •12.3 Потенциальная помехоустойчивость систем с различными видами манипуляции

- •Раздел 13. Принципы оптимальной обработки сигналов на фоне помех (окончание)

- •13.1 Оптимальный прием дискретных сообщений с неопределенной фазой (Некогерентный прием).

- •13.2 Помехоустойчивость систем с различными видами дискретной модуляции при некогерентном приеме

- •13.3 Прием дискретных сообщений в каналах с замираниями

- •Раздел 14. Основы цифровой обработки сигналов

- •14.1 Основные принципы цифровой фильтрации. Характеристики и свойства цифровых фильтров.

- •14.2 Алгоритм линейной цифровой фильтрации.

- •Тема 15. Основы цифровой обработки сигналов (окончание)

- •15.1 Трансверсальные цифровые фильтры.

- •15.2 Рекурсивные цф. Устойчивость цифровых фильтров

- •Раздел 16. Введение в вейвлет-преобразования сигналов

- •16.1 Понятие вейвлет-преобразования. Основные вейвлеты, применяемые в системах связи.

- •16.2 Дискретный вейвлет-анализ.

- •16.3 Непрерывное вейвлет-преобразование

- •Содержание.

10.2 Взаимная информация

Определим теперь информацию, содержащуюся в одном ансамбле относительно другого, например, в принятом сигнале относительно переданного сообщения. Для этого рассмотрим сообщение двух дискретных ансамблей A и B, вообще говоря, зависимых. Его можно интерпретировать как пару ансамблей сообщений, либо как ансамбли сообщения и сигнала, с помощью которого сообщение передаётся, либо как ансамбли сигналов на входе и выходе канала связи и т. д. Пусть P(ak ,bl)совместная вероятность реализаций ak и bl . Cовместной энтропией ансамблей A и B будем называть:

(10.6)

(10.6)

Введём также понятие условной энтропии:

(10.7)

(10.7)

где P(ak / bl)- условная вероятность ak , если имеет место bl .

Из теоремы умножения вероятностей

следует, что

. (10.8)

. (10.8)

Для условной энтропии справедливо двойное неравенство:

(10.9)

(10.9)

Рассмотрим два крайних случая:

1.Равенство

имеет место в том случае, когда, зная

реализацию

имеет место в том случае, когда, зная

реализацию ,

можно точно установить реализацию

,

можно точно установить реализацию .

Другими словами,

.

Другими словами, содержит

полную информацию об

содержит

полную информацию об .

.

2.Другой крайний

случай, когда

имеет место, если события

имеет место, если события и

и независимые. В этом случае знание

реализации

независимые. В этом случае знание

реализации не уменьшает неопределённости

не уменьшает неопределённости ,

т.е.

,

т.е. не

содержит никакой информации об А.

не

содержит никакой информации об А.

В общем случае,

что имеет место на практике, условная

энтропия

меньше безусловной

меньше безусловной и

знание реализации

и

знание реализации снимает в среднем первоначальную

неопределённость

снимает в среднем первоначальную

неопределённость .

Естественно, назвать разность

.

Естественно, назвать разность количеством информации, содержащейся

в

количеством информации, содержащейся

в относительно

относительно .

Её называют также взаимной информацией

между

.

Её называют также взаимной информацией

между и

и и обозначают

и обозначают :

:

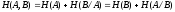

(10.10)

(10.10)

Подставляя в эту формулу значения H(A) и H(A/B) выразим взаимную информацию через распределение вероятностей:

(10.11)

(10.11)

Если воспользоваться

теоремой умножения

,

то можно записать

,

то можно записать в симметричной форме т.к.

в симметричной форме т.к. :

:

(10.12)

(10.12)

Взаимная информация

измеряется в тех же единицах, что и

энтропия. Величина

показывает, сколько мы в среднем получаем

бит информации о реализации ансамбля

показывает, сколько мы в среднем получаем

бит информации о реализации ансамбля ,

наблюдая реализацию ансамбля

,

наблюдая реализацию ансамбля .

.

Сформулируем основные свойства взаимной информации:

,

причём равенство имеет место тогда и

только тогда, когда

,

причём равенство имеет место тогда и

только тогда, когда

и

и независимы между собой

независимы между собой ,

то есть

,

то есть

содержит столько же информации

относительно

содержит столько же информации

относительно ,

сколько

,

сколько содержит относительно

содержит относительно .

Это свойство вытекает из симметрии

выражения. Поэтому можно также записать:

.

Это свойство вытекает из симметрии

выражения. Поэтому можно также записать:

(10.13)

(10.13)

3.

,

причём равенство имеет место, когда по

реализации

,

причём равенство имеет место, когда по

реализации можно точно установить реализацию

можно точно установить реализацию .

.

4.

,

причём равенство имеет место, когда по

реализации

,

причём равенство имеет место, когда по

реализации можно точно установить реализацию

можно точно установить реализацию .

.

5. Полагая

и учитывая, что

и учитывая, что получим:

получим:

(10.14)

(10.14)

Это позволяет

интерпретировать энтропию источника

как его собственную информацию, то есть

информацию, содержащуюся в ансамбле

о самом себе.

о самом себе.

Пусть

- ансамбль дискретных сообщений, а

- ансамбль дискретных сообщений, а -

ансамбль дискретных сигналов, в которые

преобразуются сообщения

-

ансамбль дискретных сигналов, в которые

преобразуются сообщения .

Тогда

.

Тогда в том и только в том случае, когда

преобразование

в том и только в том случае, когда

преобразование обратимо. При необратимом преобразовании

обратимо. При необратимом преобразовании и разность

и разность можно назвать потерей информации при

преобразовании

можно назвать потерей информации при

преобразовании .

Её называют ненадёжностью. Таким образом,

информация не теряется только при

обратимых преобразованиях.

.

Её называют ненадёжностью. Таким образом,

информация не теряется только при

обратимых преобразованиях.

Если

-

среднее время передачи одного сообщения,

то разделив на

-

среднее время передачи одного сообщения,

то разделив на формулыH(A/B)

и I(A,B)

и обозначая:

формулыH(A/B)

и I(A,B)

и обозначая:

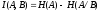

(10.15)

(10.15)

получим соответствующие

равенства для энтропии и количества

информации, рассчитанных не на одно

сообщение, а на единицу времени. Величина

называется скоростью передачи информации

от

называется скоростью передачи информации

от к

к (или

наоборот).

(или

наоборот).

Рассмотрим

пример: если

-

ансамбль сигналов на входе дискретного

канала, а

-

ансамбль сигналов на входе дискретного

канала, а -

ансамбль сигналов на его выходе, то

скорость передачи информации по каналу.

-

ансамбль сигналов на его выходе, то

скорость передачи информации по каналу.

(10.16)

(10.16)

-

производительность источника

передаваемого сигнала

-

производительность источника

передаваемого сигнала

.

.

“производительность

канала”, то есть полная собственная

информация о принятом сигнале за единицу

времени.

“производительность

канала”, то есть полная собственная

информация о принятом сигнале за единицу

времени.

Величина

представляет собой скорость “утечки”

информации при прохождении через канал,

а

представляет собой скорость “утечки”

информации при прохождении через канал,

а -

скорость передачи посторонней информации,

не имеющий отношения к

-

скорость передачи посторонней информации,

не имеющий отношения к и создаваемой присутствующими в канале

помехами. Соотношение между

и создаваемой присутствующими в канале

помехами. Соотношение между и

и зависит от свойств канала. Так, например,

при передаче телефонного сигнала по

каналу с узкой полосой пропускания,

недостаточной для удовлетворительного

воспроизведения сигнала, и с низким

уровнем помех теряется часть полезной

информации, но почти не получается

бесполезной. В этом случае

зависит от свойств канала. Так, например,

при передаче телефонного сигнала по

каналу с узкой полосой пропускания,

недостаточной для удовлетворительного

воспроизведения сигнала, и с низким

уровнем помех теряется часть полезной

информации, но почти не получается

бесполезной. В этом случае

.

Если же расширяется полоса, сигнал

воспроизводится точно, но в паузах ясно

прослушиваются “наводки” от соседнего

телефонного канала, то, почти не теряя

полезной информации, можно получить

много дополнительной, как правило,

бесполезной информации и

.

Если же расширяется полоса, сигнал

воспроизводится точно, но в паузах ясно

прослушиваются “наводки” от соседнего

телефонного канала, то, почти не теряя

полезной информации, можно получить

много дополнительной, как правило,

бесполезной информации и

.

.