VMLA-Matzokin-2012 / 2012-лекции BMLA

.pdfIII семестр. ММФ НГУ

Вычислительные методы линейной алгебры Конспект лекций

Мацокин А.М. – проф. кафедры вычислительной математики 2012 – 2013 учебный год

Предлагаем Вашему вниманию конспект лекций семестрового курса «Вычислительные методы линейной алгебры», прочитанных профессором кафедры А.М. Мацокиным для студентов второго курса механико– математического факультета Новосибирского государственного университета.

Мы надеемся, что этот конспект будет полезен студентам ММФ НГУ для более полного усвоения курса и применения методов вычислительной математики в их дальнейшей учебной, научно–преподавательской и практической деятельности.

Ограничений на использование и распространение конспекта – нет.

Любым замечаниям автор конспекта будет только рад и принимает их по адресу

E-mail: matsokin@oapmg.sscc.ru

или

E-mail: mmf@nsu.ru

Мацокин А.М. “Вычислительные методы линейной алгебры.” Конспект лекций.

Содержание |

|

|

Лекция 1. ............................................................................................................................................. |

|

5 |

Традиционные задачи линейной алгебры.................................................................................... |

|

5 |

Векторные и матричные нормы.................................................................................................... |

|

6 |

Число обусловленности ................................................................................................................. |

|

9 |

Лекция 2. Прямые методы решения линейных уравнений .......................................................... |

|

10 |

Метод исключения Гаусса – схема единственного деления.................................................... |

|

10 |

Теорема об LU разложении ......................................................................................................... |

|

11 |

Разложение Холесского ............................................................................................................... |

|

12 |

Метод квадратного корня ............................................................................................................ |

|

12 |

Лекция 3. ........................................................................................................................................... |

|

14 |

Метод исключения с выбором главного элемента по столбцу................................................ |

|

14 |

Матрица перестановок............................................................................................................. |

|

14 |

Элементарная матрица перестановок..................................................................................... |

|

14 |

Выбор главного элемента по столбцу. ................................................................................... |

|

14 |

Метод вращений решения системы уравнений......................................................................... |

|

16 |

Элементарная матрица вращения ........................................................................................... |

|

16 |

k –ый шаг метода вращений ................................................................................................... |

|

16 |

Сведение системы уравнений к системе с двухдиагональной матрицей с помощью матриц |

||

вращения ....................................................................................................................................... |

|

17 |

1-ый шаг .................................................................................................................................... |

|

17 |

k -ый шаг................................................................................................................................... |

|

17 |

Система с двухдиагональной матрицей ................................................................................. |

|

18 |

Лекция 4. ........................................................................................................................................... |

|

19 |

Метод отражений решения системы уравнений ....................................................................... |

|

19 |

Матрица отражения.................................................................................................................. |

|

19 |

k –ый шаг метода отражений.................................................................................................. |

|

19 |

Решение системы с вырожденной матрицей ............................................................................. |

|

20 |

HR –разложение с перестановками столбцов матрицы A ................................................ |

|

20 |

Совместность системы с вырожденной матрицей ................................................................ |

|

21 |

Применение HR –разложения с перестановками столбцов для решения совместной |

|

|

системы ..................................................................................................................................... |

|

21 |

Метод прогонки решения систем с трехдиагональной матрицей ........................................... |

|

22 |

Лемма Гершгорина (о локализации собственных значений)................................................... |

|

25 |

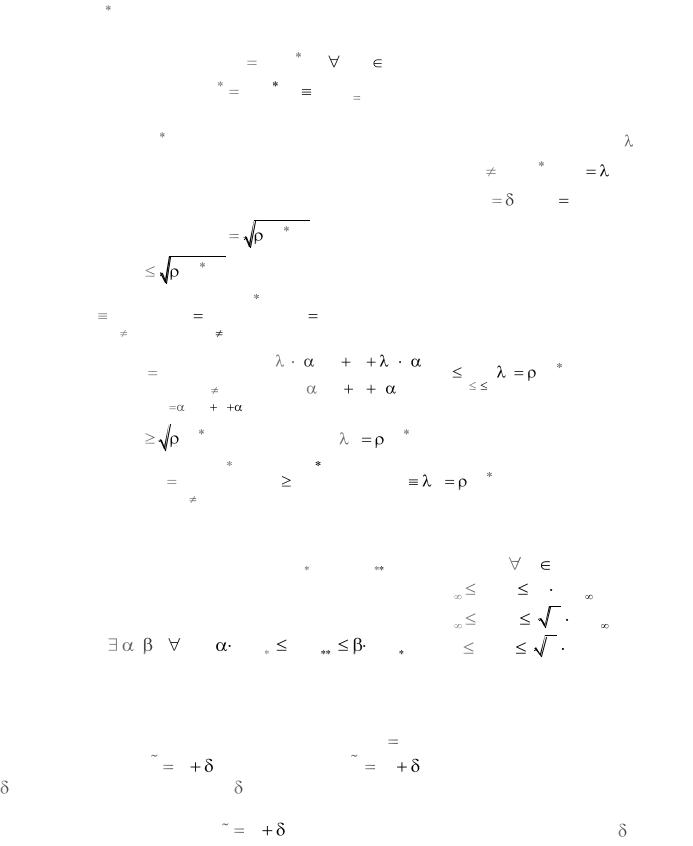

Лекция 5. Итерационные методы решения линейных уравнений............................................... |

|

27 |

Пример и основные определения ............................................................................................... |

|

27 |

Пример: ..................................................................................................................................... |

|

27 |

Одношаговый (двухслойный) итерационный метод решения Ax |

b : ............................ |

27 |

Стационарный одношаговый итерационный метод решения Ax |

b : ............................. |

27 |

Условия сходимости стационарного итерационного метода .................................................. |

|

28 |

Достаточные условия:.............................................................................................................. |

|

28 |

Необходимое и достаточное условие сходимости стационарного итерационного метода |

||

.................................................................................................................................................... |

|

28 |

Стационарный итерационный метод...................................................................................... |

|

28 |

Асимптотическая скорость сходимости ................................................................................ |

|

29 |

Лекция 6. ........................................................................................................................................... |

|

32 |

Метод Якоби ................................................................................................................................. |

|

32 |

Сходимость в случае диагонального преобладания по строкам ......................................... |

|

32 |

Сходимость в случае диагонального преобладания по столбцам ....................................... |

|

32 |

3

Мацокин А.М. “Вычислительные методы линейной алгебры.” Конспект лекций.

Необходимое и достаточное условие сходимости метода Якоби в случае симметричной

матрицы с положительной главной диагональю .................................................................. |

33 |

||||

Метод Зейделя (Гаусса–Зейделя, Некрасова) |

............................................................................ |

34 |

|||

Лекция 7. ........................................................................................................................................... |

|

|

|

|

37 |

Функционал ошибки .................................................................................................................... |

|

|

|

37 |

|

Метод полной релаксации ........................................................................................................... |

|

|

|

38 |

|

Метод неполной релаксации ....................................................................................................... |

|

|

40 |

||

Оценка сходимости методов релаксации................................................................................... |

|

42 |

|||

Предварительные замечания ................................................................................................... |

|

|

42 |

||

Пример........................................................................................................................................... |

|

|

|

|

44 |

Лекция 8. ........................................................................................................................................... |

|

|

|

|

47 |

Градиент, метод наискорейшего спуска .................................................................................... |

|

47 |

|||

Градиент функции f (z) : Rn |

R ..................................................................................... |

|

47 |

||

Градиент функции f (z) |

|| z || С2 |

: Rn .................................................................. |

R |

47 |

|

Выбор матрицы C ................................................................................................................... |

|

|

|

48 |

|

Метод наискорейшего спуска ................................................................................................. |

|

|

48 |

||

Метод минимальных невязок...................................................................................................... |

|

|

48 |

||

Метод простой итерации ............................................................................................................. |

|

|

|

49 |

|

Предварительные замечания ................................................................................................... |

|

|

49 |

||

Метод простой итерации ......................................................................................................... |

|

|

|

50 |

|

Оптимальный выбор параметра |

метода ........................................................Ричардсона |

50 |

|||

Оценки сходимости МНС и ММН ............................................................................................. |

|

|

51 |

||

Лекция 9. Метод Ричардсона с чебышевскими параметрами...................................................... |

53 |

||||

Предварительные замечания ....................................................................................................... |

|

|

53 |

||

Построение полинома Sm, |

( ), Sm, (0) |

1 , наименее уклоняющегося от нуля на |

|

||

интервале [ , |

] .......................................................................................................................... |

|

|

|

56 |

Полином Чебышева.................................................................................................................. |

|

|

|

56 |

|

Полином Sm, |

( ) .................................................................................................................. |

|

|

|

57 |

Норма полинома Sm, ( |

) ..................................................................................................... |

|

|

58 |

|

Формулы m -циклического метода Ричардсона ..................с чебышевскими параметрами |

59 |

||||

Численная неустойчивость двучленных формул ................................метода Ричардсона |

59 |

||||

Трехчленные формулы реализации метода ......................................................Ричардсона |

60 |

||||

Лекция 10. ......................................................................................................................................... |

|

|

|

|

62 |

Метод сопряженных градиентов ................................................................................................ |

|

|

62 |

||

Предварительные замечания ................................................................................................... |

|

|

62 |

||

Минимизация функционала .................................................................................................... |

|

|

63 |

||

Построение A –ортогонального базиса ................................................................................. |

|

64 |

|||

Метод сопряженных градиентов ............................................................................................ |

|

|

65 |

||

Трехслойные формулы метода сопряженных ...................................................градиентов |

66 |

||||

Лекция 10 (продолжение). ............................................................................................................... |

|

|

|

67 |

|

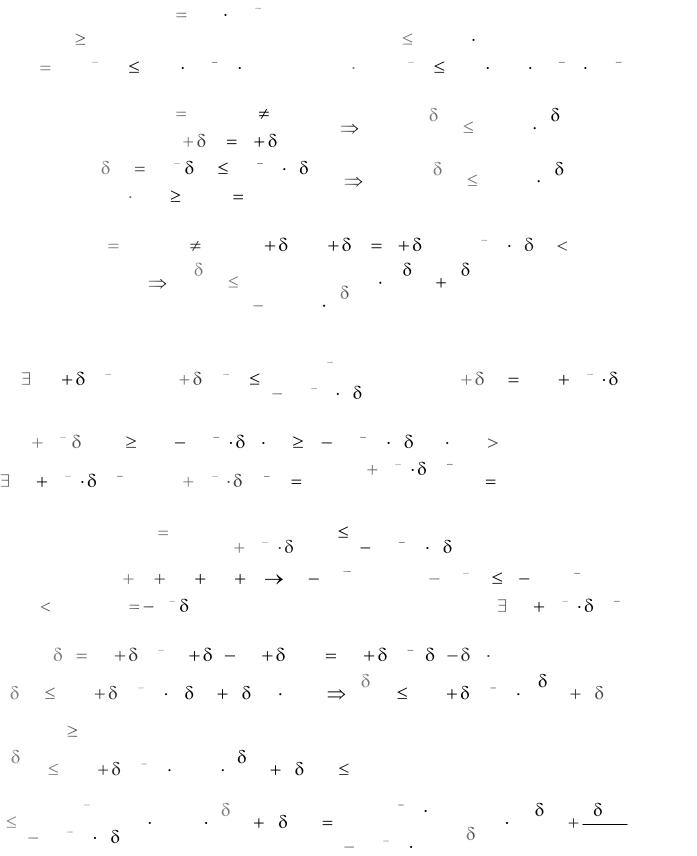

Переобусловливатель................................................................................................................... |

|

|

|

67 |

|

Метод простой итерации с переобусловливателем .............................................................. |

67 |

||||

Метод наискорейшего спуска с переобусловливателем ...................................................... |

69 |

||||

Метод сопряженных градиентов с переобусловливателем.................................................. |

70 |

||||

Положительно определенные матрицы ..................................................................................... |

|

72 |

|||

Лекция 11. Проблема собственных значений................................................................................ |

|

73 |

|||

Корректность задачи на собственные значения ........................................................................ |

73 |

||||

3

Мацокин А.М. “Вычислительные методы линейной алгебры.” Конспект лекций.

Степенной метод вычисления максимального собственного значения матрицы

A |

A |

0 .................................................................................................................................. |

|

|

|

74 |

Степенной метод вычисления минимального собственного значения матрицы A |

A |

0 |

||||

........................................................................................................................................................ |

|

|

|

|

|

75 |

Применение ортогонализации и степенного метода для вычисления очередного |

|

|

||||

собственного значения................................................................................................................. |

|

|

|

75 |

||

Степенной метод вычисления границ спектра матрицы B 1A в случае A A |

0 и |

|

||||

B |

B |

0 ................................................................................................................................... |

|

|

|

76 |

Лекция 12. Метод деления пополам (бисекций) ........................................................................... |

|

78 |

||||

Идея метода бисекций вычисления |

j |

Sp (A) .................................................................. |

|

78 |

||

|

|

|

|

|

|

|

Приведение самосопряженной матрицы к трехдиагональному виду ортогональным |

|

|||||

преобразованием подобия с помощью матриц вращения........................................................ |

|

79 |

||||

Якобиевы матрицы....................................................................................................................... |

|

|

|

80 |

||

О вычислении ЧПЗ....................................................................................................................... |

|

|

|

82 |

||

О вычислении собственного вектора ......................................................................................... |

|

|

|

82 |

||

Лекция 13. Метод вращений (Якоби)............................................................................................. |

|

|

|

83 |

||

Выбор вращения........................................................................................................................... |

|

|

|

84 |

||

Сходимость собственных значений ........................................................................................... |

|

|

|

85 |

||

Сходимость собственных векторов ............................................................................................ |

|

|

|

85 |

||

Элементарная матрица унитарного вращения .......................................................................... |

|

87 |

||||

Литература |

........................................................................................................................................ |

|

|

|

89 |

|

3

Мацокин А.М. “Вычислительные методы линейной алгебры.” Конспект лекций.

Лекция 1. Традиционные задачи линейной алгебры

|

|

|

|

|

|

|

a11 |

a12 |

|

|

a1n |

|

|

|

|

|

|

|

x1 |

|

|

|

|

A |

(a |

ij |

)n |

|

a21 |

a22 |

|

|

a2n |

|

матрица , |

x |

x2 |

|

вектор |

||||||

|

|

|

|

i, j |

1 |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

||

|

|

|

|

|

|

|

an1 |

an 2 |

ann |

|

|

|

|

|

|

|

xn |

|

|

|

||

Задачи: |

|

|

|

|

|

|

|

Методы (теория определителей): |

|

|||||||||||||

решение системы уравнений |

метод Крамера: |

|

|

|

|

|

|

|||||||||||||||

|

Ax |

b |

|

|

|

|

|

|

|

|

|

|

xi |

|

i |

, |

|

det {Ai , b} |

||||

|

|

|

|

|

|

|

|

|

|

|

|

|

i |

|||||||||

вычисление обратной матрицы: |

определение столбца x( j) матрицы X : |

|||||||||||||||||||||

|

AX |

XA |

|

E |

|

|

|

|

|

|

|

Ax( j) |

ej , |

xij |

ji |

|

||||||

|

|

|

|

|

|

|

|

|

|

|

||||||||||||

вычисление определителя |

|

|

по определению |

|

|

|

|

|

||||||||||||||

|

|

det A |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

( 1)r |

a1i |

... an i |

n |

||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

1 |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

(i1 , ,in ) |

|

|

|

|

|

||||

спектральная задача: |

|

|

|

собственные значения – корни полинома |

||||||||||||||||||

|

|

|

|

|

|

|

|

|

|

|

Pn ( |

) |

det (A |

|

E) |

|

|

|

|

|||

|

Ax |

|

x |

|

|

|

|

|

|

|

собственные векторы – решения систем |

|||||||||||

|

|

|

|

|

|

|

|

|

(A |

|

E)x |

0 |

|

|

|

|

|

|||||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

||||||

|

|

|

|

|

|

|

|

|

|

|

r линейно независимых решений, где |

|||||||||||

|

|

|

|

|

|

|

|

|

|

|

r |

dim {Ker (A |

E)} |

|

|

|

||||||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|||||||

Непригодность этих методов: |

|

|

|

|

|

|

|

|

|

|

|

|||||||||||

|

|

|

|

|

|

|

|

|||||||||||||||

количество |

умножений |

при |

ошибки округления: |

|

|

|

|

|||||||||||||||

вычислении |

|

|

одного |

a |

a |

| a |, |

|

|

|

10 6 |

|

|

|

|

||||||||

определителя: |

|

|

|

|

|

если n |

6 , | ai j |

| |

10, |

1, |

|

|

||||||||||

|

(n |

1) |

n! |

|

|

|

|

|

|

|

|

|

||||||||||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|||

если |

производительность |

ЭВМ |

ai |

a1i |

... an i |

|

, то ai |

ai |

O(1) |

|

||||||||||||

|

|

|

|

|

|

|

|

|

|

|

|

1 |

|

|

|

n |

|

|

|

|

|

|

|

109 оп/сек, то |

|

|

|

|

|

|

|

n! O(1) |

O(1) |

|

|

|

|

||||||||

|

n |

|

|

|

|

|

время |

|

|

|

т.е. определитель |

вычисляется с большой |

||||||||||

|

|

|

|

|

|

|

вычисления |

|

|

|||||||||||||

|

|

|

|

|

|

|

|

|

ошибкой и, следовательно, решения |

|||||||||||||

|

10 |

|

|

|

|

|

10 4 |

сек. |

|

|

||||||||||||

|

|

|

|

|

|

|

|

поставленных задач вычисляются с такой же |

||||||||||||||

|

20 |

|

|

|

|

|

> 17 мин. |

|

|

ошибкой. |

|

|

|

|

|

|

|

|

||||

|

30 |

|

|

|

|

|

> 400 тыс. лет |

|

|

|

|

|

|

|

|

|

|

|

|

|

||

5

Мацокин А.М. “Вычислительные методы линейной алгебры.” Лекция 1.

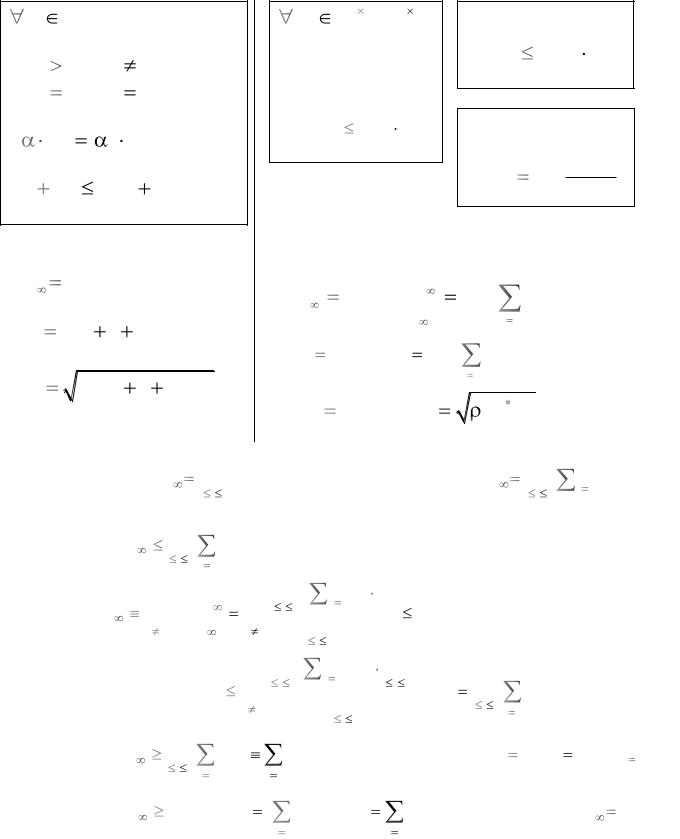

Векторные и матричные нормы

Векторные

x |

Rn (Cn ) |

|

|

|| x || |

0, |

x |

0 |

|| x || |

0, |

x |

0 |

|| |

x || | |

| || x || |

|

|| x |

y || |

|| x || |

|| y || |

Примеры:

||x || max | xi |

–кубическая или равномерная

|| x ||1 | x1 | ... | xn |

– октаэдрическая

|| x || |

| x |2 |

... | x |

n |

|2 |

2 |

1 |

|

|

–сферическая или евклидова

Матричные

A Rn n (Cn n )

аксиомы 1. – 3.

– аддитивная

4. || AB || || A || || B ||

–мультипликативная

согласованная с векторной, если

|| Ax || || A || || x ||

подчиненная векторной, если

||A || sup || Ax ||

||x ||

Примеры подчиненных матричных норм:

|

|

|

|| Ax || |

|

|

|

n |

||||||

|| A || |

sup |

|

max | ai j | |

||||||||||

|

|| x || |

|

|

|

|||||||||

|

|

|

|

|

|

|

|

i |

j 1 |

||||

|

|

|

|

|

|

|

|

|

|

|

|

||

|

|

|| Ax ||1 |

|

|

|

|

n |

|

|

||||

|| A ||1 |

sup |

max |

|

|

| ai j | |

||||||||

|| x ||1 |

i 1 |

||||||||||||

|

|

|

|

j |

|

|

|||||||

|

|

|

|

|

|

|

|

|

|

|

|

||

|

|

|

|| Ax ||2 |

|

|

|

|

|

|||||

|| A ||2 |

sup |

|

|

|

(A A) |

||||||||

|

|| x ||2 |

|

|

|

|

|

|||||||

|

|

|

|

|

|

|

|

|

|

|

|||

Вывод формул для некоторых матричных норм, подчиненных векторным нормам.

1) Векторной норме || x || |

max | xi |

| подчинена матричная норма || A || max |

n |

| ai j | . |

||||||||||

|

|

|

1 i |

n |

|

|

|

|

|

|

1 i n |

j |

1 |

|

|

|

|

|

|

|

|

|

|

|

|

||||

Действительно: |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

n |

|

|

|

|

|

|

|

|

|

|

|

во-первых; || A || |

max |

| ai j |: |

|

|

|

|

|

|

|

|

|

|||

|

1 |

i n j 1 |

|

|

|

|

|

|

|

|

|

|

|

|

|| A || sup || Ax || |

|

|

|

max | |

n |

|

ai j x j | |

|

|

|||||

|

sup 1 i |

n |

j |

1 |

|

|

|

|

||||||

|

|

|

|

|

|

|

|

|

|

|

|

|

||

x |

0 |

|

|| x || |

|

x |

0 |

|

max | xi | |

|

|

||||

|

|

|

|

|

|

|

|

1 i |

n |

|

|

|

|

|

|

max( |

n |

1 |

| ai j | max | x j | ) |

sup |

1 i n |

j |

1 j n |

|

|

|

|||

|

|

max | xi | |

||

x 0 |

|

|||

|

|

1 i n |

||

n

max | ai j |;

1 i n j 1

|

|

|

|

|

|

n |

|

|

|

|

|

|

n |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

(i |

|

) |

|

(i |

|

) |

|

|

|

ai0 j |

|

n |

во-вторых; || A || |

max |

|

|

| a |

|

|

| |

|

| a |

|

|

|

|

| , так как для вектора x |

0 |

(x |

0 |

|

|

|

) |

|||||||||||||||||||||

|

|

i j |

|

i0 j |

|

|

j |

|

|

|

| ai0 j | |

j 1 |

||||||||||||||||||||||||||||||

|

|

|

|

|

1 i n j 1 |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

||||||||||||

|

|

|

|

|

|

|

|

|

|

j 1 |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|||||

|

(i |

|

) |

|

|

(i |

|

) |

|

|

|

|

n |

|

|

|

|

|

ai0 |

j |

|

|

n |

|

|

|

|

|

|

|

|

|

|

|

(i |

|

) |

|

|

|

||

имеем || Ax |

0 |

|| |

| (Ax |

0 |

) |

|

|

| |

| |

a |

|

|

|

|

|

| |

| a |

|

|

|

| и, поскольку || x |

0 |

|| |

1, |

||||||||||||||||||

|

|

|

|

i |

0 |

i |

0 |

j |

|

|

|

|

|

i |

0 |

j |

|

|

||||||||||||||||||||||||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

| a |

|

|

| |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|||||||||

|

|

|

|

|

|

|

|

|

|

|

|

j |

1 |

|

|

|

|

i0 |

j |

j 1 |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

||||||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|||||

6

Мацокин А.М. “Вычислительные методы линейной алгебры.” Лекция 1.

|

|

|

|

|

|

|

|

|

|| Ax || |

|

|

|

|

|

|| Ax(i0 ) || |

|

|

|

n |

|

|

|

, |

|

|

|

|

|

|||||||||

|

|| A || |

|

|

sup |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

| a |

i0 j |

| |

|| A || |

|

|

|

|

|

||||||

|

|

|

|

|| x || |

|

|

|

|

|

|

|| x(i0 ) || |

|

|

|

|

|

|

|

|

||||||||||||||||||

|

|

|

|

|

|

x 0 |

|

|

|

|

|

|

|

|

|

|

|

j 1 |

|

|

|

|

|

|

|

|

|||||||||||

что завершает доказательство формулы. |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|||||||||||||||||||||

2) Векторной норме || x ||1 |

|

|

|

n |

|

|

| xi | подчинена матричная норма |

|| A ||1 |

max |

n |

| ai j | . |

||||||||||||||||||||||||||

|

|

|

|

|

|

|

|

i |

|

1 |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

1 j n |

i |

1 |

|

||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

Действительно: |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

n |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

во-первых; || A ||1 |

max |

|

| ai j |: |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|||||||||||

|

|

|

1 |

j |

n i |

1 |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

n |

|

|

|

|

|

|

n |

|

|

|

|

|

|

|

n |

|

n |

|

|

|

|

|

|

|| A ||1 |

sup |

|| Ax || |

1 |

|

sup |

|

|

i 1| |

|

|

|

j 1ai j x j | |

sup |

|

i 1( |

j 1| ai j | | x j | ) |

|

|

|||||||||||||||||||

|| x ||1 |

|

|

|

|

|

|

|

|

|

n |

| xi | |

|

|

|

|

|

|

n |

| xi | |

|

|

|

|

||||||||||||||

|

x 0 |

|

|

|

x 0 |

|

|

|

|

|

|

|

|

|

x 0 |

|

|

|

|

|

|

||||||||||||||||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

i |

1 |

|

|

|

|

|

|

|

|

|

i 1 |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

n |

|

1 |

( |

|

|

n |

| ai j | ) | x j | |

|

n |

|

|

|

|

|

|

|

|||||||

|

|

|

|

|

|

|

|

sup |

|

j |

|

|

|

|

i |

1 |

|

|

|

|

|

max |

| ai j |; |

|

|

|

|

|

|||||||||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

n |

|

|

|

|

|

|

|

|

|

|

|

||||||||||

|

|

|

|

|

|

|

|

x 0 |

|

|

|

|

|

|

|

|

| xi | |

|

|

|

|

|

1 j n i 1 |

|

|

|

|

|

|

||||||||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

i |

1 |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

n |

|

|

|

|

|

|

|

n |

|

|

|

|

|, так как для вектора x( j0 ) |

(x(jj0 ) |

j , j )nj 1 |

|||||||||||||||

во-вторых; |

|| A ||1 |

max |

|

| ai j | |

|

|

|

|

| ai j |

||||||||||||||||||||||||||||

|

|

|

1 |

j |

n i |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

0 |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

0 |

|

|

|

|

|

1 |

|

|

|

|

|

i |

1 |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

||||||||

имеем || Ax( j0 ) ||1 |

|

n |

| ai j | и, поскольку || x( j0 ) ||1 |

|

|

|

|

|

|

|

|

|

|

|

|

||||||||||||||||||||||

|

|

1, |

|

|

|

|

|

|

|

|

|

||||||||||||||||||||||||||

|

|

|

|

|

|

|

0 |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

i |

1 |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|| Ax || |

1 |

|

|

|

|| Ax( j0 ) || |

1 |

|

|

n |

|

|

|| A ||1 , |

|

|

|

|

|

|||||||||

|

|

|| A ||1 |

|

sup |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

| ai j | |

|

|

|

|

|

|

||||||||||||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|| x( j0 ) ||1 |

|

|

|

|

|

|

|

||||||||||||||||

|

|

|

|

|

|

x 0 |

|

|| x ||1 |

|

|

|

|

|

i 1 |

0 |

|

|

|

|

|

|

|

|

||||||||||||||

что завершает доказательство формулы. |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|||||||||||||||||||||

|

|

|

|

|

|

|

|

|

|

|

|

|

|||||||||||||||||||||||||

|

|

|

|

|

|

|

n |

|

| xi | 2 |

|

|

|

|||||||||||||||||||||||||

3) Векторной норме || x || 2 |

|

|

|

|

|

|

|

подчинена матричная норма || A || 2 |

(A A) . |

||||||||||||||||||||||||||||

|

|

|

|

|

|

|

|

|

|

|

i |

1 |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

||

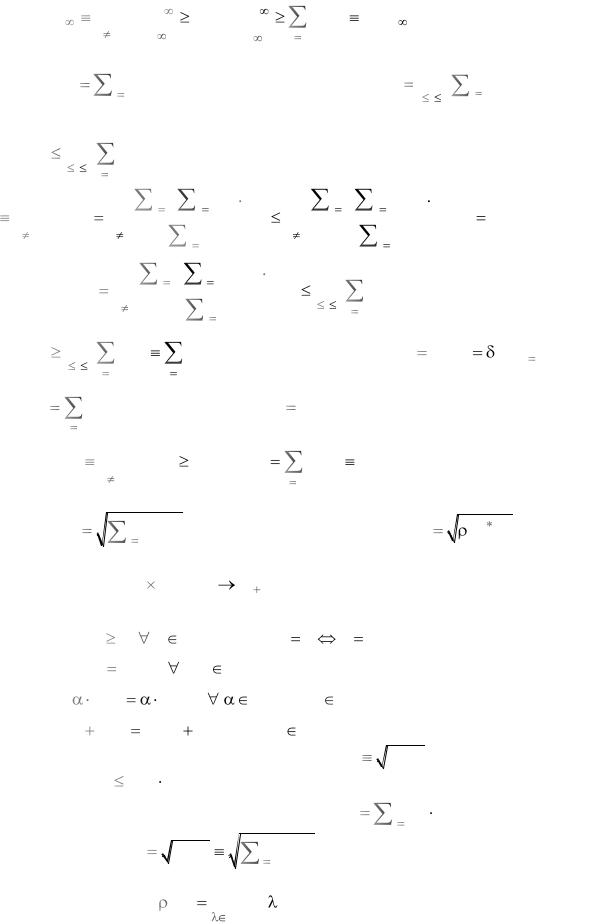

Прежде всего, напомним определения скалярного произведения и спектрального радиуса.

а) Отображение (x, y) : Cn (Rn ) |

|

Cn (Rn ) |

R называется скалярным произведением в |

|||||||||||||||||||

векторном пространстве Cn (или R n ), если |

|

|

|

|

|

|

|

|

|

|

|

|

||||||||||

1. (x, x) |

0 |

x |

|

Cn (Rn ), |

(x, x) |

0 |

|

x |

0; |

|

|

|

|

|

|

|||||||

|

|

|

|

|

|

|

|

Cn (R n ); |

|

|

|

|

|

|

|

|

|

|

||||

2. |

(x, y) |

|

(y, x) |

|

x, y |

|

|

|

|

|

|

|

|

|

|

|||||||

3. |

( |

x, y) |

|

(x, y) |

|

|

C(R), x, y |

Cn (R n ), |

|

|

|

|

|

|||||||||

4. |

(x |

y, z) |

(x, z) (y, z) |

x, y, z |

Cn (R n ) |

|

|

|

|

|

|

|

||||||||||

Скалярное произведение определяет векторную норму |

|| x || |

(x, x) |

и |

имеет место |

||||||||||||||||||

неравенство Коши: | (x, y) | |

|

|| x || |

|| y || . |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|||||

Классическое (евклидово) |

|

скалярное |

произведение (x, y) |

|

n |

1 |

x |

i |

y |

определяет |

||||||||||||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

i |

|

i |

|

||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

||||||||

|

|

|

|

|

|

|

|

|

|

|

n |

| xi | 2 . |

|

|

|

|

|

|

|

|

||

евклидову норму вектора || x || 2 |

|

|

(x, x) |

|

|

|

|

|

|

|

|

|||||||||||

|

|

|

|

|

|

|

|

|

|

|

i |

1 |

|

|

|

|

|

|

|

|

|

|

б) Обозначим через Sp(A) множество собственных значений матрицы A . Тогда число

(A) max | |

Sp(A)

называется спектральным радиусом матрицы A . 7

Мацокин А.М. “Вычислительные методы линейной алгебры.” Лекция 1.

Матрица A , сопряженная матрице |

A относительно скалярного произведения |

(x, y) , |

||||||||||||||||||||||||||||||||||||

определяется тождеством Лагранжа: |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

||||||||||||||

|

|

|

|

(Ax, y) |

|

|

(x, A y) |

|

|

|

x, y |

Cn (Rn ) . |

|

|

|

|

|

|

|

|

|

|||||||||||||||||

Напомним, |

что матрица |

A |

( (A ) |

|

a |

ji |

)n |

сопряжена матрице |

A относительно |

|||||||||||||||||||||||||||||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

i j |

|

|

|

i, j 1 |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

||||

евклидова скалярного произведения. |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

||||||||||||||

Далее, матрица |

A A самосопряжена |

(эрмитова), |

все |

её собственные |

значения |

i |

||||||||||||||||||||||||||||||||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

вещественны и неотрицательны, а из её собственных векторов x(i) |

0 : A Ax(i) |

ix(i) |

||||||||||||||||||||||||||||||||||||

можно образовать ортонормированный базис в Cn (Rn ) : (x(i) , x( j) ) |

i, j, i, j |

1, ..., n . |

||||||||||||||||||||||||||||||||||||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|||||

Теперь докажем равенство || A || 2 |

|

|

|

(A A) . |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|||||||||||||||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

||||||||

во-первых; || A || 2 |

(A A) , так как |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

||||||||||||||||

2 |

|

|| Ax || 22 |

|

|

|

|

(A Ax, x) |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

||||||||||

|| A || 2 |

sup |

|

|

|

|

sup |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

||

|| x || 22 |

|

(x, x) |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|||||||||||||||

|

x 0 |

|

x 0 |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|||||||||||||

|

|

|

|

|

sup |

|

|

|

|

|

|

1 | |

|

1 | 2 ... |

|

n | |

|

n | 2 |

max |

i |

(A A); |

|

|

|||||||||||||||

|

|

|

|

|

|

|

|

|

|

|

| |

|

1 | |

2 |

... |

| |

n | |

2 |

|

|

|

|||||||||||||||||

|

|

|

|

|

x 0, |

|

|

|

|

|

|

|

|

1 i n |

|

|

|

|

|

|

|

|

||||||||||||||||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

||||||||||||||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

x |

|

x(1) ... |

n |

x( n ) |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

||||||||

|

|

|

1 |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

||

|

|

|

|

|

|

|

|

(A A) ) для вектора x(n) имеем |

|

|||||||||||||||||||||||||||||

во-вторых; || A || 2 |

(A A) , так как (пусть |

|

n |

|

||||||||||||||||||||||||||||||||||

|

|| A || 22 |

sup |

|

(A Ax, x) |

|

|

(A Ax(n) , x(n) ) |

|

|

|

(A A) , |

|

|

|

|

|

|

|

||||||||||||||||||||

|

|

(x, x) |

|

|

|

|

(x(n) , x(n) ) |

|

|

|

n |

|

|

|

|

|

|

|

||||||||||||||||||||

|

|

|

x 0 |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

||||||||||||||||

что завершает доказательство формулы. |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|||||||||||||||||

|

|

|

|

|

|

|

|

|

|

|

||||||||||||||||||||||||||||

Теорема. |

Любые две нормы || x || |

|

и || x || |

|

в |

|

Примеры: |

x |

|

Rn (Cn ) |

||||||||||||||||||||||||||||

|

конечномерном |

|

|

|

|

|

|

|

пространстве |

|

|| x || |

|| x ||1 |

n |

|

|| x || |

|

|

|||||||||||||||||||||

|

эквивалентны: |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|||||||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|| x || |

|| x ||2 |

|

|

n |

|| x || |

|

||||||||||||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

||||||||

|

, : |

x |

|

|

|

|

|| x || |

|| x || |

|

|

|

|| x || |

|

|

|

|

|

|

|

|

||||||||||||||||||

|

|

|

|

|

|

|

|

|

|| x ||2 |

|| x ||1 |

|

n |

|| x ||2 |

|

||||||||||||||||||||||||

!!! Константы эквивалентности зависят от размерности пространства |

!!! |

|

||||||||||||||||||||||||||||||||||||

При решении системы линейных уравнений Ax |

b могут быть неточно заданы |

|||||||||||||||||||||||||||||||||||||

либо правая часть b |

b |

|

b либо матрица A |

A |

|

A , где компоненты вектора |

||||||||||||||||||||||||||||||||

b и элементы |

матрицы |

A |

малы |

по сравнению |

с соответствующими |

|||||||||||||||||||||||||||||||||

элементами исходных вектора и матрицы. |

Тогда вместо |

решения |

x |

мы |

||||||||||||||||||||||||||||||||||

получим его приближение x |

|

x |

|

|

|

x , причем компоненты вектора–ошибки |

x |

|||||||||||||||||||||||||||||||

могут быть большими.

Оценим норму ошибки через нормы возмущений правой части и матрицы системы, считая, что матричная норма подчинена векторной норме.

8

Мацокин А.М. “Вычислительные методы линейной алгебры.” Конспект лекций.

Число обусловленности

Определение. |

condA |

|

|| A || |

|| A 1 || |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|||||||||

1. cond A |

1 |

т.к. |

|

|

|

|

|

|

|

|

|

|

2. cond (AB) |

cond A cond B т.к. |

|||||||||||||||||||||||

|| x || |

|| AA 1x || |

|| A || |

|

|| A 1 || || x || |

|

|| AB|| || (AB) 1 || |

|| A || || B|| |

|| B 1 || || A 1 || |

|||||||||||||||||||||||||||||

Теорема. |

|

|

Ax |

|

b, det A |

|

|

0 |

|

|

|

|

|

|

|

|

|| |

|

x || |

cond A |

|| |

b || |

|||||||||||||||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|||||||||||||||

Док–во. |

|

|

A(x |

|

|

x) |

b |

|

|

b |

|

|

|

|

|

|

|

|

|| x || |

|

|

|

|| b || |

|

|||||||||||||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|||||||||||||||||||

|| x || |

|| A |

1 |

b || |

|| A |

1 |

|| |

|| b || |

|

|

|

|

|

|

|| |

|

x || |

|

|

|

|

|

|| |

b || |

|

|||||||||||||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|||||||||||||||||||||||

|

|

|

|

|

|

|

|

|

|

|

|

|

cond A |

. |

|||||||||||||||||||||||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|||||||

|

|

|| A || || x || |

|

|| Ax || |

|

|| b || |

|

|

|

|

|

|

|

|

|

|

|| x || |

|

|

|

|

|

|| b || |

||||||||||||||

Теорема. |

Ax |

b, |

det A |

0, |

|

(A |

|

|

|

A)(x |

|

x) |

|

b |

|

b, |

|

|| A 1 || |

|| |

A || |

1 |

|

|

||||||||||||||

|

|

|

|

|

|| |

x || |

|

|

|

|

|

cond A |

|

|| |

b || |

|| |

|

A || |

|

|

|

|

|

|

|

||||||||||||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

( |

|

|

|

|

) |

|

|

|

|

|

|

|

|||||||

|

|

|

|

|

|

|| x || |

1 |

|

cond A |

|| |

A || |

|

|| b || |

|| A || |

|

|

|

|

|

|

|

||||||||||||||||

|

|

|

|

|

|

|

|

|

|

|| A || |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|||||||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

||

Док–во. |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

1. |

(A |

A) 1 |

и || (A |

|

|

A) |

1 || |

|

|

|

|

|| A 1 |

|| |

|

|

, т.к. |

(A |

A) |

A(E |

A 1 A) |

|||||||||||||||||

|

|

|

|

|

|| A 1 || |

|

|

|

|||||||||||||||||||||||||||||

|

|

|

|

|

|

|

|

|

|

|

1 |

|| A || |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|||||||||

и

|| (E |

A 1 |

A)z || || z || |

|| A |

(E |

A 1 |

A) 1 и || (E |

A |

1 |

A z || |

(1 |

|| A 1 || || |

A ||) || z || 0 , то |

|

1 |

A) 1 || |

sup |

|| (E A 1 |

A) 1 x || |

|

|

|| x || |

||||

|

|

|

|||

|

sup |

|| z || |

|

|

|

1 |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|| (E A 1 |

A)z || 1 |

|| A 1 || || |

A || |

|

|

|

||||

Замечание. E |

X X2 |

X3 ... |

(E X) 1 |

и || (E |

X) 1 || |

(1 |

|| X ||) 1 , |

если |

|||

|| X || 1. При X |

A 1 A получаем еще одно доказательство |

(E |

A 1 |

A) 1 .) |

|||||||

2. Т.к. |

x |

(A |

A) 1[b |

|

b |

|

(A |

|

A)x] |

(A |

A) 1[ b |

|

A x], то |

|

|

||||||||||||

|| x || |

|| (A |

A) |

1 || (|| b || |

|| |

A || |

|| x ||) |

|

|| |

x || |

|

|| (A |

|

A) 1 || |

( |

|| |

b || |

|||||||||||

|

|| x || |

|

|| x || |

||||||||||||||||||||||||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

||||||

т.к. || x || |

|| b || / || A || , то |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

||||||

|

|| x || |

|

|| (A |

A) |

1 || ( || A || |

|| |

b || |

|

|| A ||) |

|

|

|

|

|

|

|

|

|

|

|

|

|

|||||

|

|| x || |

|

|

|| b || |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|||||||||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|||||

|

|

|

|

|| A 1 || |

|

( || A || |

|| |

|

b || |

|| |

A ||) |

|

|

|| A 1 || || A || |

|

|

( |

|| |

b || |

||||||||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|||||||||||||

|

1 || A |

1 || || |

A || |

|

|| b || |

|

1 || A 1 || |

|| A || |

|| |

A || |

|

|

|| b || |

||||||||||||||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|| A || |

|

|

|

|

||||||||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

||||

||A ||)

||A ||) .

||A ||

9

Мацокин А.М. “Вычислительные методы линейной алгебры.” Конспект лекций.

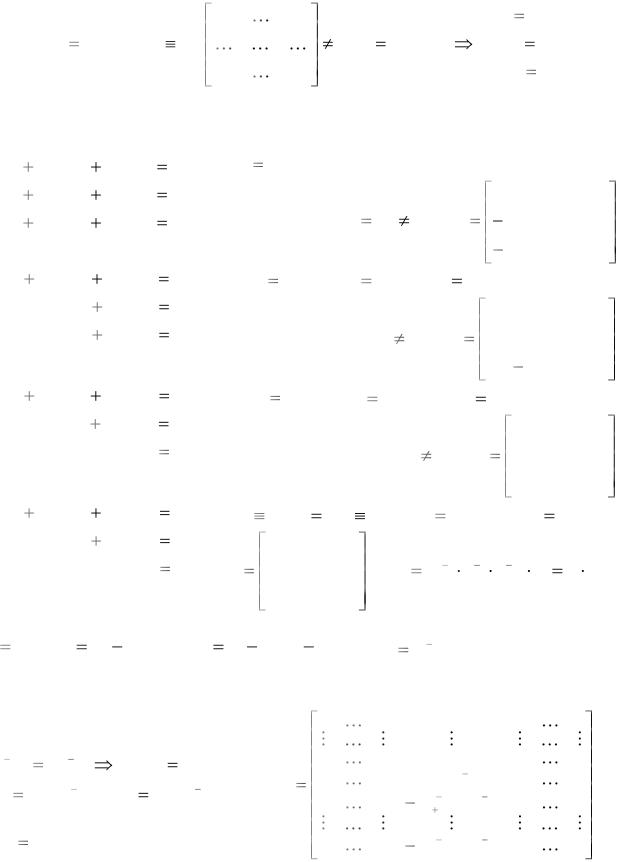

Лекция 2. Прямые методы решения линейных уравнений Метод исключения Гаусса – схема единственного деления

a11 |

a1k |

|

A |

LU |

Ax b, det Ak det |

|

0, k 1,..., n |

Ly |

b |

ak1 |

ak k |

|

Ux |

y |

Схема единственного деления на примере системы третьего порядка:

Прямой ход: |

|

|

Матричная формулировка: |

|

|

|

|

|

|

|

|

||||||||

a11x1 |

a12x2 |

a13x3 |

b1 |

Ax b, |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

a21x1 |

a2 2x2 |

a23x3 |

b2 |

|

|

|

|

|

|

|

|

|

|

|

1/ a11 |

0 0 |

|||

a31x1 |

a32x2 |

a33x3 |

b3 |

|

|

det A1 |

|

a11 |

0, |

L1 |

|

|

a21 / a11 |

1 |

0 |

||||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

a31 / a11 |

0 |

1 |

||

x1 |

u12x2 |

u13x3 |

y1 |

A(1)x |

|

b(1) , |

A(1) |

|

L A, b(1) |

|

L b |

|

|

|

|

|

|||

|

|

|

|

|

|

|

|

1 |

|

|

|

1 |

|

|

|

|

|

||

|

a(1)2 2x2 |

a(1)23 x3 |

b(1)2 |

|

|

|

|

|

|

|

|

|

|

1 |

|

|

0 |

|

0 |

|

a3(1)2 x2 |

a33(1) x3 |

b3(1) |

|

|

|

det A(1) |

0, |

L |

2 |

|

0 |

|

|

1/ a(1) |

0 |

|||

|

|

|

|

|

|

|

|

2 |

|

|

|

|

|

|

2 2 |

|

|||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

0 |

|

|

a(1) / a(1) |

1 |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

32 |

2 2 |

|

x1 |

u12x2 |

u13x3 |

y1 |

A(2) x |

|

b(2) , |

A(2) |

|

L |

A(1) , |

b(2) L |

b(1) |

|

|

|||||

|

|

|

|

|

|

|

|

2 |

|

|

|

|

|

2 |

|

|

|

|

|

|

x2 |

u23x3 |

y2 |

|

|

|

|

|

|

|

|

|

|

|

|

1 0 |

0 |

|

|

|

|

a33(2) x3 |

b3(2) |

|

|

|

det A(2) |

0, |

|

L |

3 |

|

0 |

1 |

0 |

|

|||

|

|

|

|

|

|

|

|

|

|

3 |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

0 |

0 |

1/ a |

(2) |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

33 |

|

x1 |

u12x2 |

u13x3 |

y1 |

Ux |

A(3)x |

b(3) |

y, |

A(3) |

L A(2) , |

|

b(3) |

L b(2) |

|||||||

|

|

|

|

|

|

|

|

|

|

|

|

3 |

|

|

|

|

|

3 |

|

|

x2 |

u23x3 |

y2 |

|

1 u12 |

u13 |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

x3 |

y3 |

U 0 1 u2 3 , A (L11 L21 L31) U L U |

|||||||||||||||

|

|

|

|

|

0 |

0 |

1 |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|||||||||||

Обратный ход: |

|

|

|

|

|

|

|

Матричная формулировка: |

|||||||||||

x3 |

y3 , x2 y2 |

u23x3 , x3 |

y1 u12x2 |

u13x3 |

|

x U 1y |

|

|

|

|

|

|

|

|

|||||

Формулы схемы единственного деления (доказать):

k–ый шаг прямого хода: |

|

|

|

|

|

1 |

0 |

0 |

|

0 |

0 |

|||||||||

A |

(k 1) |

x b |

(k 1) |

|

A |

(k) |

x |

b |

(k) |

, |

|

0 |

1 |

0 |

|

0 |

0 |

|||

|

|

|

|

|

|

|

0 |

0 |

1/ a |

(k 1) |

|

0 |

0 |

|||||||

|

|

|

|

|

|

|

|

|

|

|

|

|

Lk |

|

||||||

A |

(k) |

Lk A |

(k 1) |

, b |

(k) |

|

Lk b |

(k 1) |

|

|

|

k k |

|

|

|

|||||

|

0 |

0 |

(k 1) |

(k 1) |

1 |

0 |

||||||||||||||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

ak 1k |

/ ak k |

|

||||

A(n) |

U – верхняя треуг. матрица |

|

0 |

0 |

a(nk k1) |

/ a(kkk |

1) |

0 |

1 |

|||||||||||

10