- •2015 Год Содержание

- •Введение

- •Подходы к построению рейтингов

- •Метод главных компонент

- •Основные понятия и определения

- •Вычисление главных компонент

- •Матрица «нагрузок» главных компонент

- •2.6 Геометрическая интерпретация главных компонент

- •2.7 Подготовка данных

- •2.8 Возможные трудности при использовании метода главных компонент

- •3. Источники данных для применения метода главных компонент

- •3.1 База данных Института для метрической системы мер Здоровья и оценки (Institute for Health Metrics and Evaluation (ihme))

- •3.2 Федеральная служба государственной статистики (Росстат)

- •Заключение

- •Источники и литература

Метод главных компонент

Основные понятия и определения

Задача снижения размерности набора данных состоит в описании точек данных с помощью величин количеством меньшим по сравнению с размерностью пространства. Данные величины должны быть функциями исходных координат, т. е. :

ŋk=Fk(ξ1, ξ2,…, ξm), k = 1… m', m' < m.

Функции Fk задают отображение F из исходного пространства Rm в пространство Rm'.

В методе главных компонент F – некоторое линейное ортогональное нормированное отображение, т. е. :

Fk(ξ1,

ξ2,…,

ξm)

= c1k(ξ1-µ1)+…+cmk(ξm-µm),

где µj= -

-

средние по набору данных значения признаков, а на коэффициенты cij накладываются условия:

,

,

,

i,j=1…m,i≠j.

,

i,j=1…m,i≠j.

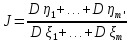

Вид критерия J:

,

где D

вычисление дисперсии случайной величины.

,

где D

вычисление дисперсии случайной величины.

Согласно этому критерию, количество сохраненной информации равно доле «объясненной» с помощью новых признаков ŋ1…ŋm дисперсии исходных признаков.

Первая главная компонента – это нормированно-центрированная линейная комбинация исходных признаков, которая среди всех прочих нормировано-центрированных линейных комбинаций обладает на данном наборе данных наибольшей дисперсией.

k-ой главной компонентой (k = 2…m) называется такая нормировано-центрированная линейная комбинация исходных признаков, которая не коррелированна с (k-1) предыдущими главными компонентами и среди всех прочих нормированно - центрированных линейных комбинаций, не коррелированных с предыдущими (k-1) главными компонентами обладает на данном наборе данных наибольшей дисперсией.

Вычисление главных компонент

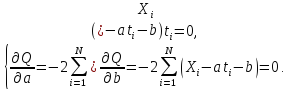

Рассмотрим итерационный алгоритм вычисления главных компонент. Возьмем прямую следующего вида:

y=at+b.

Тогда сумма квадратов расстояний от точек наблюдений до вышеуказанной прямой будет равна выражению:

Q= .

.

Пусть

a, - произвольные вектора

- произвольные вектора

Данная сумма- это критерий, минимизируемый с помощью алгоритма:

Определяем набор

:

:

Определяем новые координаты векторов a и b:

Проверяем на останов. Алгоритм прерывается в том случае, если

,

где𝛥Q

– изменение величины Q

за итерацию,

,

где𝛥Q

– изменение величины Q

за итерацию,

𝜀 – малая величина.

Этот способ вычисления первой главной компоненты обладает важным преимуществом: алгоритм обобщается в том случае, если данные содержат неполные значения. Неизвестное значение пропускается. Появляется вектор значения всех координат (иначе, «эффективный» вектор среднего):

Вектор a при полных данных задаст направление первой главной компоненты, а при неполных - «эффективную» первую главную компоненту.

Основные числовые характеристики главных компонент

EZ=E(LX)=L×EX=0

Ковариационная матрица вектора главных компонент:

L∑

в) Сумма дисперсий исходных признаков равна сумме дисперсий всех главных компонент

г) Обобщенная дисперсия исходных признаков равна обобщенной дисперсии главных компонент

д) «Матрица нагрузок» - это матрица перехода из исходного пространства переменных в пространство главных компонент.

Матрица «нагрузок» главных компонент

Матрица

«нагрузок» A

=

,i,j

= 1,2…,p,

главных компонент на исходные признаки

тоже одна из важных характеристик

главных компонент. Если анализируемые

переменные X

= (x(1),

x(2),…,x(p))T

, которые процентрированы и пронормированы,

т. е. если главные компоненты построены

для признаков X*=

(x*(1),

x*(2),…,x*(p))T,

Ex*(i)=0,

Dx*(i)=1,

i=1,2,...,p,

то элементы матрицы «нагрузок»

,i,j

= 1,2…,p,

главных компонент на исходные признаки

тоже одна из важных характеристик

главных компонент. Если анализируемые

переменные X

= (x(1),

x(2),…,x(p))T

, которые процентрированы и пронормированы,

т. е. если главные компоненты построены

для признаков X*=

(x*(1),

x*(2),…,x*(p))T,

Ex*(i)=0,

Dx*(i)=1,

i=1,2,...,p,

то элементы матрицы «нагрузок»

определяют степень тесноты линейной

связи (по парному коэффициенту корреляции)

междуx*(i)

и z(j)

и удельный вес влияния пронормированной

j-той

главной компоненты на признак x*(i).

определяют степень тесноты линейной

связи (по парному коэффициенту корреляции)

междуx*(i)

и z(j)

и удельный вес влияния пронормированной

j-той

главной компоненты на признак x*(i).

Матрица «нагрузок» А определяется соотношением вида:

,

где

,

где

=

= .

.

Свойства матрицы А:

Сумма квадратов элементов любого j-го столбца матрицы А равна дисперсии (j-ой) главной компоненты λj.

Сумма квадратов элементов любой (i-ой) строки матрицы нагрузок А равна единице.

Данные свойства применимы и для содержательной интерпретации главных компонент.

Применение главных компонент

Главные компоненты применяются в решении задач анализа данных. Основные задачи:

упрощение, сокращение размерностей анализируемых моделей статистического исследования зависимостей или классификации, что способно облегчить вычисления и интерпретацию статистических выводов;

визуализация исходных многомерных данных;

предварительная ортогонализация объясняющих переменных используется для устранения мультиколлинеарностью;

сокращение статистической информации.

Рассмотрим подробнее одно из распространенных приложений метода главных компонент – визуализацию данных.

Визуализация данных – представление данных в наглядной форме.

Первым выбором в визуализации множества данных является ортогональное проецирование на плоскость первых двух главных компонент. Плоскость проектирования является, по сути плоским двумерным «экраном», расположенным таким образом, чтобы обеспечить «картинку» данных с наименьшими искажениями. Такая проекция будет оптимальна в трех отношениях:

Минимальна сумма квадратов расстояний от точек данных до проекций на плоскость первых главных компонент, то есть экран расположен максимально близко по отношению к облаку точек.

Минимальна сумма искажений квадратов расстояний между всеми парами точек из облака данных после проецирования точек на плоскость.

Минимальна сумма искажений квадратов расстояний между всеми точками данных и их «центром тяжести».