- •Понятие информации. Общая характеристика процессов сбора, передачи, обработки и накопления информации Литература

- •Оглавление

- •1.1. Основные понятия информатики

- •1.2. Информация. Информационные процессы

- •1.3. Свойства и виды информации

- •1.4. Измерение информации

- •Вероятностный подход

- •Объемный подход

- •1.5. Системы счисления

- •Правила перевода чисел из одной системы счисления в другую

- •1.6. Логические основы эвм

- •Контрольные вопросы

1.4. Измерение информации

Определить понятие «количество информации» довольно сложно. В решении этой проблемы существуют два основных подхода. Исторически они возникли почти одновременно. В конце 40-х годов XX века один из основоположников кибернетики американский математик Клод Шеннон развил вероятностный подход к измерению количества информации, а работы по созданию ЭВМ привели к объемному подходу.

Вероятностный подход

Вероятностный подход используется в теории информации.

Пусть имеется какое-либо событие или процесс, это может быть опыт с бросанием игральной кости, вытаскивание шара определенного цвета из коробки, получение определенной оценки и т.п. Введем обозначения:

P – вероятность некоторого события

n – общее число возможных исходов данного события

k – количество событий из всех возможных, когда происходит событие

I – количество информации о событии

Тогда вероятность этого события равна P=k/n

А количество информации о

нем выражается формулой:

(вспомним, что логарифм определяет степень, в которую нужно возвести основание логарифма, чтобы получить аргумент)

Пример: испытание – подбрасывание игральной кости (кубика), событие – выпадение чётного количества очков. Тогдаn=6,k=3,P=3/6=1/2,

=log2(2)=1

=log2(2)=1

При рассмотрении вопроса о количестве информации I, вводят понятие неопределенности состоянии системы –энтропии системы (H). Получение информации о какой-либо системе всегда связано с изменением степени неосведомленности получателя о состоянии этой системы.

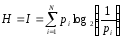

Энтропия системы, имеющейnвозможных состояний, когда различные исходы опытанеравновероятны (например, получение положительной оценки на экзамене – вероятность получения 3, 4 или 5 разная) вычисляется по формуле:

,

гдеPi– вероятностьi-го исхода.

,

гдеPi– вероятностьi-го исхода.

Это выражение называется формулой Шеннона.

Частный случай формулы Шеннона это формула Хартли, когда события равновероятны:

То есть нужно решить показательное

уравнение относительно неизвестной I: .

.

Важным при введении какой-либо величины является вопрос о том, что принимать за единицу ее измерения. Из формулы Хартли следует, что H=I=1 приN=2 (21=2). Иными словами, в качествеединицыпринимается количество информации, связанное с проведением опыта, состоящего в получении одного из двух равновероятных исходов (примером такого опыта может служить бросание монеты, при котором возможны два исхода: «орел», «решка»). Такая единица количества информации называется -бит. Сообщение, уменьшающее неопределенность знаний человека в два раза, несет для него 1 бит информации.

Рассмотрим примеры на подсчет количества информации.

Пример 1.В барабане для розыгрыша лотереи находится 32 шара. Сколько информации содержит сообщение о первом выпавшем номере (например, выпал номер 15)? Поскольку вытаскивание любого из 32 шаровравновероятно, то количество информации об одном выпавшем номере находится из уравнения:

Решение.По формуле ХартлиI=log232, следовательно, количество информацииIравняется числу, в которое нужно возвести 2, чтоб получить 32 – это 5, так как 25=32.

Ответ.I=5 бит.

Пример 2. В коробке имеется 50 шаров. Из них 40 белых и 10 черных. Определить количество информации в сообщении о выпадании белого шара и черного шара.

Решение. Обозначимpч– вероятность вытаскивания черного шара,pб- вероятность вытаскивания белого шара. Тогда

pч = 10/50 = 0,2;pб = 40/50 = 0,8.

Теперь, зная вероятности событий, можно определить количество информации в сообщении о каждом из них, используя формулу I=log2(1/p):

Iч = log2 (1/0,2) = log2 5 = 2,321928;

Iб = log2 (1/0,8) = log2 (1,25) = 0,321928.