- •Сдача зачета 19.01.12 в 1000 – 301-1к. И 20.01.12 в 900 – 301-1к. Список вопросов для магистрантов по Основам информационных технологий (11/12)

- •1. Тенденции и особ-сти развития инф-ных технологий до середины 19 века.

- •2 Тенденции и особенности развития ит после сер. 19 в.

- •2. Тенденции и особенности развития информационных технологий со второй половины 19 века

- •3 Абстрактная машина Тьюринга

- •4 Основные параметры, характеристики и свойства ис

- •5 Сущность проблемы скорости передачи данных (пд)

- •7 Системная шина пк

- •8. Энтропия источника сообщения

- •9. Особенности двоичных систем передачи информации

- •11 Сущность основных проблем современных иСиТ

- •12. Базовые технологии преобразования информации

- •13 Сущность методов избыточного кодирования информации

- •14 Методы и средства защиты ис от несанкционированного доступа

- •15 Сущность и классификация методов сжатия данных в ис.

- •16. Оценка эффективности сжатия информации.

- •17 Сжатие и распаковка информации по методу Шеннона-Фано.

- •18 Сжатие и распаковка информации по методу Хаффмана.

- •19 Сущность символ-ориентированных методов сжатия

- •20 Безопасность информационных технологий

- •21 Назначение и особенности использования криптографических методов в ис

- •22 Классификация методов шифрования данных

- •23 Особенности блокового шифрования данных

- •24 Особенности симметричных и ассиметрич. Систем шифрования данных

- •25 Подстановочные и перестановочные шифры

- •26. Особенности алгоритма rsa

- •27. Эцп и ее использование в инф-х процессах

- •28. Основные методы генерации эцп

- •29. Эцп в Беларуси

- •30 Место и роль бд в ис

- •31 Реляционная бд

- •32 Основные модели баз данных (бд)

- •33 Особенности проектирования компьютерных бд

- •34 Интегральность в бд

- •35 Операции и операторы в реляционной модели бд

- •36 Особенности языка sql.

- •37 Базовые структуры предложений языка в запросах

- •38 Генерация и обработка запросов к бд

- •39 Тенденции развития компьютерных бд

- •41. Методы борьбы с вредоносными компьютерными программами

- •43. Типы атак вирусов

- •44 Общая характеристика техник защиты от вирусов

- •45 Сканеры вирусов

- •46 Мониторы вирусов

- •47 Современные технологии противодействия компьютерным вирусам

- •48 Ит в области образования, коммерции, банковского дела

- •49 Особенности моделирования объектов и техпроцессов

- •50 Математическое моделирование

- •51 Имитационное моделирование

- •52 Формальная модель объекта

- •53 Элементы теории оптимизации

- •54 Постановка задачи оптимизации

- •55 Решение оптимизационных задач в системе ms Excel

- •56.Классификация компьютерных сетей

- •57.Базовые архитектуры компьютерных сетей

- •58.Основные топологии компьютерных сетей

- •Топология общая шина

- •59. Особенности пакетной передачи данных по компьютерным сетям

- •60. Модель iso/osi

- •61 Адресация и маршрутизация в компьютерных сетях. Мас-адрес.

- •62 Адресация и маршрутизация в компьютерных сетях. Ip − адрес

- •63 Адресация и маршрутизация в компьютерных сетях. Dns-имя

- •64 Беспроводные технологии передачи информации

7 Системная шина пк

ИС на основе РС имеют шинную организацию

(ЦПУ)СРИ

RAM

1-я стрелка шина данных; 2- шина адреса; 3- шина управления. И все это вместе системная шина.

Random Access Memory (RAM) – это опер-я память – это массив крист-х ячеек, спос-х хранить данные. Сущ-т много разл-х типов оп-й памяти, но с т.зр-я физ-го пр-па действия разл-т динамич-ю память (D RAM) и статич-ю память (S RAM).

По шине данных эти устройства обмениваются информацией (работ. по half duplex).

Шина адреса передает адрес ячейки, к кот. обращаются, чтобы записать данные, находящ. на шине либо записать данные, наход. в яч.

Шина управления передает код информации (счит. или записать).

Шина данных в современн. компе 64 бита (8 B). Все они работают от управления одного блока – тактовый генератор.

2-й важн. параметр ИС на основе РС- тактовая частота.

Основные принципы шинной архитектуры. Осн. хар. шины – разрядность – число проводников по которым передается инф-я . Шина, как правило, соединяет несколько устройств. Вся системная синхронизируется специальным устройством (системн. генератор). Тактовая частота сист. шины, например, Fш= 660 МГц.

Пропускная способность любой шины – частота этой шины, умнож. на разрядность.

Пш=Fш * R

Fш = 660МГц = 660*106 Гц, R = 64 bit.

Для первых компов R = 8 bit, Fш = сотни кГц.

Для увеличения пропускной способности шины необход. увеличить тактовую частоту и разрядность шины.

Шина адреса передает адрес, по кот. надо записать либо считать эту информацию с шины. Rш.а. = 32, каждый разряд адресует 1 байт. Количество адресов 2n; если n= 32, то >=4 GB (ячеек памяти)

Адрес, кот. устанавливается на шине принято представлять в 16-тиричной системе исчисления.

8. Энтропия источника сообщения

Алфавит

(А) – конеч-я сов-сть символов (знаков),

с пом. кот. м. предст-ть любое сообщ-е в

инф-й системе (ИС).

.

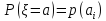

. –i-й

символ А.

–i-й

символ А.

Мощ-сть А – кол-во символов, сост-щих А (N(A)). Рус-я язык N=33.

Св-ва

симоволов А выраж-ся ч/з вероятностные

х-ки каждого символа. Вер-сть того, что

произв-й символ

произв-го док-нта будет буквой

произв-го док-нта будет буквой :

: .

.

(1).

(1).

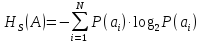

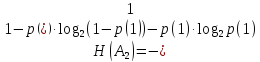

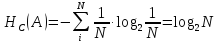

Инф-ной х-кой А (ист-ка сообщений на основе этого А) явл-ся энтропия. Ввел понятие Шеннон. Инф-ная энтропия – мера хаотичности инф-ции, неопр-сть появл-я какого-л. символа А. При отсутствии инф-ных потерь численно равна кол-ву инф-ции (бит), которое прих-ся в среднем на 1 символ перед-го сообщ-я.

(2),

где

(2),

где

,

, –i-й

символ А,

–i-й

символ А,

– вер-сть

– вер-сть .

Ед. измер-я – бит.

.

Ед. измер-я – бит.

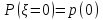

Энтропия

двоичного канала/ист-ка сообщ-й: А сост-т

из 2-х символов:

,N=2.

,N=2.

.

. .

На основ-и (2):

.

На основ-и (2):

(3)

(3)

.

.

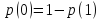

Тогда

(4)

(4)

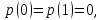

Если

то

то ,

т.е. сообщ-е не несет никакой инф-и.

,

т.е. сообщ-е не несет никакой инф-и.

Шеннон

предпол-л, что прирост инф-и равен

утраченной неопр-сти, и задал требов-я

к её измер-ю: 1) мера д.б. непрер-й; т.е.

измен-е знач-я ве-ны вер-сти на малую

в-ну должно выз-ть малое рез-щее измен-е

ф-ции; 2) в случае, когда все вар-нты

равновероятны, ув-ние кол-ва вар-нтов

(букв) должно всегда ув-ть знач-е ф-ции;

3) д.б. возм-сть сделать выбор в 2 шага, в

кот-х знач-е ф-ции конечного рез-та должно

явл-ся суммой ф-ций промеж-х рез-тов.

Поэтому ф-ция энтропии H д. удовл-ть

усл-м: 1)

![]() опр-на и непрерывна для всех

опр-на и непрерывна для всех![]() ,

где

,

где![]() для всех

для всех![]() и

и![]() .

(эта функция зависит только от распределения

вероятностей, но не от алфавита.)

.

(эта функция зависит только от распределения

вероятностей, но не от алфавита.)

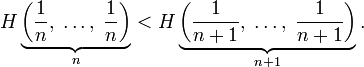

2) Для целых положительных n, должно выполняться следующее неравенство:

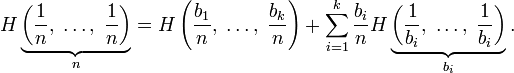

3)

Для целых положительных bi,

где

![]() ,

должно вып-ся рав-во:

,

должно вып-ся рав-во:

Шеннон показал, что единств-я ф-ция, удовл-щая этим требованиям, имеет вид:

![]() где

K – константа (нужна для выбора единиц

измер-я).

где

K – константа (нужна для выбора единиц

измер-я).

Шеннон

опр-л, что измер-е энтропии (![]() ),

прим-мое к ист-ку инф-и, м. опр-ть треб-я

к миним-й пропускной спос-сти канала,

требуемой для надёжной передачи инф-и

в виде закодир-х двоичных чисел. Для

вывода формулы необх-мо вычислить мат-е

ожид-е «кол-ва инф-и», содерж-ся в цифре

из ист-ка инф-и. Мера энтропии Шеннона

выражает неувер-сть реализ-и случ-й

переменной. Т.о., энтропия явл-ся разницей

м/ду инф-й, сод-ся в сообщ-и, и той частью

инф-и, кот-я точно известна (или хорошо

предсказуема) в сообщении. Пр. этого

явл-ся избыточ-сть языка – им-ся явные

статистич-е закон-сти в появл-и букв,

пар пос-ных букв, троек и т. д.

),

прим-мое к ист-ку инф-и, м. опр-ть треб-я

к миним-й пропускной спос-сти канала,

требуемой для надёжной передачи инф-и

в виде закодир-х двоичных чисел. Для

вывода формулы необх-мо вычислить мат-е

ожид-е «кол-ва инф-и», содерж-ся в цифре

из ист-ка инф-и. Мера энтропии Шеннона

выражает неувер-сть реализ-и случ-й

переменной. Т.о., энтропия явл-ся разницей

м/ду инф-й, сод-ся в сообщ-и, и той частью

инф-и, кот-я точно известна (или хорошо

предсказуема) в сообщении. Пр. этого

явл-ся избыточ-сть языка – им-ся явные

статистич-е закон-сти в появл-и букв,

пар пос-ных букв, троек и т. д.

Энтропия

Хартли.

Частный случай энтропии Шеннона. Вер-сть

появл-я каждого символа А одинакова.

Если задано N,

то

Хартли предложил хар-ть неопред-сть логарифмом числа n. Т.е. log n явл-ся колич-й мерой неопр-сти. Пусть имеется N сост-й системы S или N опытов с разл-ми, равновозм-ми пос-ми сост-ми системы. Если каждое сост-е системы закодир-ть, напр., двоичными кодами опр-ной длины d, то эту длину необх-мо выбрать так, чтобы число всех разл-х комбинаций было бы не меньше, чем N. Наименьшее число, при кот-м это возможно или мера разнообразия мн-ва сост-й системы зад-ся формулой Р. Хартли: H=k log а N, где k – коэф-нт пропорц-сти (масштабир-я, в зав-сти от выбранной единицы измерения меры), а - основание системы меры.

Если измерение ведётся в экспоненц-й системе, то k=1, H=lnN (нат); если измерение - в двоичной системе, то k=1/ln2, H=log2N (бит); если измерение - в десятичной системе, то k=1/ln10, H=lgN (дит).

Пример. Чтобы узнать полож-е точки в системе из 2х клеток т.е. получить некот-ю инф-ю, необх-мо задать 1 вопрос ("Левая или правая клетка?"). Узнав полож-е точки, мы ув-м суммарную инф-ю о системе на 1 бит (I=log2 2). Для системы из 4х клеток необх-мо задать 2 аналог-х вопроса, а инф-я равна 2 битам (I=log24). Если сист имеет n разл-х сост-й, то макс-е кол-во инф-и равно I=log2 n.

По Хартли, для того, чтобы мера инф-ции имела практ-ю цен-сть - она д.б. такова, чтобы отражала кол-во информации пропорционально числу выборов.

Пример. Имеются 192 монеты из кот-х одна фальшивая. Опр-м ск-ко взвеш-й нужно произвести, чтобы опр-ть ее. Если положить на весы равное кол-во монет, то получим 2 возм-сти: а) левая чашка ниже; б) правая чашка ниже. Т.о., каждое взвеш-е дает кол-во инф-и I=log22=1 и, следов-но, для опр-я фальш-й монеты нужно сделать не менее k взвеш-й, где k удовл-т условию log22k³ log2192. Отсюда, k=7. След-но, нам необходимо сделать не менее 7 взвешиваний (достаточно семи).

Формула Хартли отвлечена от качеств-х, индивид-х св-в рассм-мой системы (кач-ва инф-ции, сод-щейся в системе, в проявлениях системы с помощью рассматриваемых N состояний системы). Это основная положит-я сторона этой формулы. Но имеется и основная отриц-я сторона: формула не учит-т различимость и различность рассматриваемых N состояний системы.