- •Об авторе

- •Предисловие

- •Для кого эта книга

- •О чем эта книга

- •Что вам потребуется при чтении этой книги

- •Условные обозначения

- •От издательства

- •Глава 1. Обзор алгоритмов

- •Что такое алгоритм

- •Этапы алгоритма

- •Определение логики алгоритма

- •Псевдокод

- •Использование сниппетов

- •Создание плана выполнения

- •Введение в библиотеки Python

- •Библиотеки Python

- •Реализация Python с помощью Jupyter Notebook

- •Методы разработки алгоритмов

- •Параметры данных

- •Параметры вычислений

- •Анализ производительности

- •Анализ пространственной сложности

- •Анализ временной сложности

- •Оценка эффективности

- •Выбор алгоритма

- •«О-большое»

- •Проверка алгоритма

- •Точные, приближенные и рандомизированные алгоритмы

- •Объяснимость алгоритма

- •Резюме

- •Глава 2. Структуры данных, используемые в алгоритмах

- •Структуры данных в Python

- •Список

- •Кортеж

- •Словарь

- •Множество

- •DataFrame

- •Матрица

- •Абстрактные типы данных

- •Вектор

- •Стек

- •Очередь

- •Базовый принцип использования стеков и очередей

- •Дерево

- •Резюме

- •Глава 3. Алгоритмы сортировки и поиска

- •Алгоритмы сортировки

- •Обмен значений переменных в Python

- •Сортировка пузырьком

- •Сортировка вставками

- •Сортировка слиянием

- •Сортировка Шелла

- •Сортировка выбором

- •Алгоритмы поиска

- •Линейный поиск

- •Бинарный поиск

- •Интерполяционный поиск

- •Практическое применение

- •Резюме

- •Глава 4. Разработка алгоритмов

- •Знакомство с основными концепциями разработки алгоритма

- •Вопрос 1. Даст ли разработанный алгоритм ожидаемый результат?

- •Вопрос 2. Является ли данный алгоритм оптимальным способом получения результата?

- •Вопрос 3. Как алгоритм будет работать с большими наборами данных?

- •Понимание алгоритмических стратегий

- •Стратегия «разделяй и властвуй»

- •Стратегия динамического программирования

- •Жадные алгоритмы

- •Практическое применение — решение задачи коммивояжера

- •Использование стратегии полного перебора

- •Использование жадного алгоритма

- •Алгоритм PageRank

- •Постановка задачи

- •Реализация алгоритма PageRank

- •Знакомство с линейным программированием

- •Практическое применение — планирование производства с помощью линейного программирования

- •Резюме

- •Глава 5. Графовые алгоритмы

- •Представление графов

- •Типы графов

- •Особые типы ребер

- •Эгоцентрические сети

- •Анализ социальных сетей

- •Введение в теорию сетевого анализа

- •Кратчайший путь

- •Создание окрестностей

- •Показатели центральности

- •Вычисление показателей центральности с помощью Python

- •Понятие обхода графа

- •BFS — поиск в ширину

- •DFS — поиск в глубину

- •Практический пример — выявление мошенничества

- •Простой анализ мошенничества

- •Анализ мошенничества методом сторожевой башни

- •Резюме

- •Глава 6. Алгоритмы машинного обучения без учителя

- •Обучение без учителя

- •Обучение без учителя в жизненном цикле майнинга данных

- •Современные тенденции исследований в области обучения без учителя

- •Практические примеры

- •Алгоритмы кластеризации

- •Количественная оценка сходства

- •Иерархическая кластеризация

- •Оценка кластеров

- •Применение кластеризации

- •Снижение размерности

- •Метод главных компонент (PCA)

- •Ограничения PCA

- •Поиск ассоциативных правил

- •Примеры использования

- •Анализ рыночной корзины

- •Ассоциативные правила

- •Оценка качества правила

- •Алгоритмы анализа ассоциаций

- •Практический пример — объединение похожих твитов в кластеры

- •Тематическое моделирование

- •Кластеризация

- •Алгоритмы обнаружения выбросов (аномалий)

- •Использование кластеризации

- •Обнаружение аномалий на основе плотности

- •Метод опорных векторов

- •Резюме

- •Глава 7. Традиционные алгоритмы обучения с учителем

- •Машинное обучение с учителем

- •Терминология машинного обучения с учителем

- •Благоприятные условия

- •Различие между классификаторами и регрессорами

- •Алгоритмы классификации

- •Задача классификации

- •Оценка классификаторов

- •Этапы классификации

- •Алгоритм дерева решений

- •Ансамблевые методы

- •Логистическая регрессия

- •Метод опорных векторов (SVM)

- •Наивный байесовский алгоритм

- •Алгоритмы регрессии

- •Задача регрессии

- •Линейная регрессия

- •Алгоритм дерева регрессии

- •Алгоритм градиентного бустинга для регрессии

- •Среди алгоритмов регрессии победителем становится...

- •Практический пример — как предсказать погоду

- •Резюме

- •Глава 8. Алгоритмы нейронных сетей

- •Введение в ИНС

- •Эволюция ИНС

- •Обучение нейронной сети

- •Анатомия нейронной сети

- •Градиентный спуск

- •Функции активации

- •Инструменты и фреймворки

- •Keras

- •Знакомство с TensorFlow

- •Типы нейронных сетей

- •Перенос обучения

- •Практический пример — использование глубокого обучения для выявления мошенничества

- •Методология

- •Резюме

- •Глава 9. Алгоритмы обработки естественного языка

- •Знакомство с NLP

- •Терминология NLP

- •Библиотека NLTK

- •Мешок слов (BoW)

- •Эмбеддинги слов

- •Окружение слова

- •Свойства эмбеддингов слов

- •Рекуррентные нейросети в NLP

- •Использование NLP для анализа эмоциональной окраски текста

- •Практический пример — анализ тональности в отзывах на фильмы

- •Резюме

- •Глава 10. Рекомендательные системы

- •Введение в рекомендательные системы

- •Типы рекомендательных систем

- •Рекомендательные системы на основе контента

- •Рекомендательные системы на основе коллаборативной фильтрации

- •Гибридные рекомендательные системы

- •Ограничения рекомендательных систем

- •Проблема холодного старта

- •Требования к метаданным

- •Проблема разреженности данных

- •Предвзятость из-за социального влияния

- •Ограниченные данные

- •Области практического применения

- •Практический пример — создание рекомендательной системы

- •Резюме

- •Глава 11. Алгоритмы обработки данных

- •Знакомство с алгоритмами обработки данных

- •Классификация данных

- •Алгоритмы хранения данных

- •Стратегии хранения данных

- •Алгоритмы потоковой передачи данных

- •Применение потоковой передачи

- •Алгоритмы сжатия данных

- •Алгоритмы сжатия без потерь

- •Практический пример — анализ тональности твитов в режиме реального времени

- •Резюме

- •Глава 12. Криптография

- •Введение в криптографию

- •Понимание важности самого слабого звена

- •Основная терминология

- •Требования безопасности

- •Базовое устройство шифров

- •Типы криптографических методов

- •Криптографические хеш-функции

- •Симметричное шифрование

- •Асимметричное шифрование

- •Практический пример — проблемы безопасности при развертывании модели МО

- •Атака посредника (MITM)

- •Избежание маскарадинга

- •Шифрование данных и моделей

- •Резюме

- •Глава 13. Крупномасштабные алгоритмы

- •Введение в крупномасштабные алгоритмы

- •Определение эффективного крупномасштабного алгоритма

- •Терминология

- •Разработка параллельных алгоритмов

- •Закон Амдала

- •Гранулярность задачи

- •Балансировка нагрузки

- •Проблема расположения

- •Запуск параллельной обработки на Python

- •Разработка стратегии мультипроцессорной обработки

- •Введение в CUDA

- •Кластерные вычисления

- •Гибридная стратегия

- •Резюме

- •Глава 14. Практические рекомендации

- •Введение в практические рекомендации

- •Печальная история ИИ-бота в Твиттере

- •Объяснимость алгоритма

- •Алгоритмы машинного обучения и объяснимость

- •Этика и алгоритмы

- •Проблемы обучающихся алгоритмов

- •Понимание этических аспектов

- •Снижение предвзятости в моделях

- •Решение NP-трудных задач

- •Упрощение задачи

- •Адаптация известного решения аналогичной задачи

- •Вероятностный метод

- •Когда следует использовать алгоритмы

- •Практический пример — события типа «черный лебедь»

- •Резюме

Инструменты и фреймворки |

247 |

Функция y выглядит следующим образом:

Ее можно реализовать с помощью следующего кода Python:

def tanh(x):

numerator = 1-np.exp(-2*x) denominator = 1+np.exp(-2*x) return numerator/denominator

Перейдем теперь к функции softmax.

Softmax

Иногда нам требуется более двух уровней для вывода функции активации. В таких случаях используется функция softmax. Она лучше всего подходит для задач многоклассовой классификации. Предположим, что у нас есть n классов

ивходные значения. Входные значения отображают классы следующим образом: x = {x(1), x(2), .... x(n)}.

Softmax основана на теории вероятности. Выходная вероятность e-го класса softmax рассчитывается следующим образом:

Для бинарных классификаторов функция активации в конечном слое будет сигмоидной, а для многоклассовых классификаторов — softmax.

ИНСТРУМЕНТЫ И ФРЕЙМВОРКИ

В этом разделе мы подробно рассмотрим фреймворки и инструменты, доступные для реализации нейронных сетей.

К настоящему времени разработано множество различных фреймворков для реализации нейронных сетей. Каждый из них имеет свои сильные и слабые стороны. В этом разделе мы сосредоточимся на Keras с серверной частью TensorFlow.

248 |

Глава 8. Алгоритмы нейронных сетей |

Keras

Keras — одна из самых популярных и простых в использовании библиотек ней ронных сетей, написанная на Python. Она была создана с прицелом на простоту использования и предлагает самый быстрый способ реализации глубокого обу чения. Keras предоставляет только высокоуровневые операции и применяется на уровне модели.

Выбор серверного движка для Keras

Keras требуется библиотека глубокого обучения более низкого уровня для вы полнения манипуляций с тензорами. Эта библиотека глубокого обучения более низкого уровня называется серверным движком или бэкенд-движком (backend engine). Внутренние движки, доступные для Keras:

zz TensorFlow (www.tensorflow.org). Это самый популярный фреймворк в своем классе, с открытым исходным кодом, созданный Google;

zz Theano (https://github.com/Theano/Theano). Разработан в лаборатории MILA в Университете Монреаля;

zzMicrosoft Cognitive Toolkit (CNTK). Разработан корпорацией Microsoft.

Формат этого модульного стека технологий глубокого обучения показан на следующей схеме (рис. 8.12).

Рис. 8.12

Инструменты и фреймворки |

249 |

Преимущество модульной архитектуры глубокого обучения заключается в том, что бэкенд-движок Keras можно изменять без переписывания кода. Например, если для конкретной задачи TensorFlow подходит лучше, чем Theano, можно просто сменить серверную часть на TensorFlow.

Низкоуровневые слои стека глубокого обучения

Все три упомянутых серверных движка способны работать как на центральном процессоре (CPU), так и на графическом (GPU), используя низкоуровневые слои стека. Для CPU существует библиотека тензорных операций, называемая Eigen. Для GPU TensorFlow использует библиотеку CUDA Deep Neural Network (cuDNN) от NVIDIA.

Определение гиперпараметров

Гиперпараметр — это параметр, значение которого выбирается перед запуском процесса обучения. Сначала мы задаем значения на основе здравого смысла, а затем пытаемся их оптимизировать. Для нейронных сетей важными являются следующие гиперпараметры:

zz функция активации; zz скорость обучения;

zz количество скрытых слоев;

zzколичество нейронов в каждом скрытом слое.

Давайте выясним, как строится модель с помощью Keras.

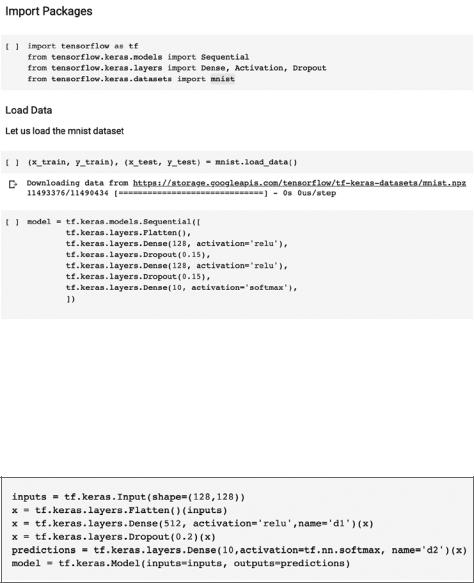

Построение модели Keras

Создание завершенной модели Keras состоит из трех этапов:

1.Конструирование слоев.

Существуют два способа построения модели с использованием Keras:

yy Последовательный API (Sequential API)1. Позволяет создавать модели для линейного стека слоев. Это типичный выбор при построении относитель но простых моделей (рис. 8.13).

1 API, application programming interface — интерфейс программирования приложе ний. — Примеч. ред.

250 |

Глава 8. Алгоритмы нейронных сетей |

|

|

|

|

Рис. 8.13

Обратите внимание, что мы создали три слоя: первые два имеют функцию активации ReLU, а третий — softmax.

yy Функциональный API (Functional API). Позволяет проектировать модели для ациклических графов. С его помощью могут быть созданы более сложные модели (рис. 8.14).

Рис. 8.14

Одну и ту же нейронную сеть можно спроектировать, используя как после довательные, так и функциональные API. Выбор того или иного подхода не влияет на производительность.