- •Введение

- •Формальный нейрон. Типология нейронов. Задача, решаемая нейроном, геометрическая интерпретация.

- •Формальный нейрон.

- •Типология нейронов.

- •Геометрическая интерпретация задачи нейрона.

- •Нейронная сеть. Слой, типология слоёв. Типология нейронных сетей. Основные классы задач, решаемых нейронными сетями.

- •задачи

- •Задача обучения нейронной сети, отличие от задачи обучения нейрона. Проблемы. Примеры алгоритмов и методов обучения.

- •Градиентные методы.

- •Математическое обоснование метода обратного распространения ошибки. Алгоритм обратного распространения ошибки.

- •Вывод формулы для расчёта адаптивного коэффициента обучения в алгоритме обратного распространения ошибки.

- •Вывод формулы для расчёта адаптивного шага обучения для нерекуррентной линейной нейронной сети.

- •Алгоритм послойного обучения. Назначение и отличие от алгоритма обратного распространения ошибки.

- •Алгоритм многократного распространения ошибки. Назначение и отличие от алгоритма обратного распространения ошибки.

- •Задача предсказания числовых последовательностей с помощью нейронных сетей. Особенности устройства нейронных сетей для предсказания числовых последовательностей.

- •Реккурентные нейронные сети. Контекстный нейрон. Обучение. Сеть Элмана. Сеть Джордана.

- •Рециркуляционные нейронные сети. Линейная рециркуляционная сеть. Задача, решаемая линейной рециркуляционной сетью (метод главных компонент).

- •Алгоритмы обучения и функционирования линейной рециркуляционной сети.

- •Релаксационные нейронные сети. Синхронная сеть Хопфилда. Непрерывное и дискретное состояние. Структура, обучение, энергия, функционирование.

- •Сеть Хэмминга. Назначение, обучение и функционирование.

- •Линейная ассоциативная память и ассоциативная память на основе сети Хопфилда. Функционирование, отличие.

- •Двунаправленная ассоциативная память. Назначение, структура, обучение и функционирование.

- •Двунаправленная ассоциативная память. Метод обучения двунаправленной ассоциативной памяти с модифицированной структурой.

- •Сеть адаптивного резонанса. Назначение, структура, обучение и функционирование.

- •СТРУКТУРА APT

- •Функционирование сети APT в процессе классификации

- •ФУНКЦИОНИРОВАНИЕ APT

- •ПРИМЕР ОБУЧЕНИЯ СЕТИ APT

- •ЗАКЛЮЧЕНИЕ

- •Устройство и структура нейронных сетей для решения задач классификации и кластеризации. Правила обучения: WTA и CWTA.

- •Структура когнитрона, неокогнитрона и свёрточных нейронных сетей, отличия. Назначение когнитрона, неокогнитрона и свёрточных нейронных сетей.

- •Обучение

- •НЕОКОГНИТРОН

- •Обобщение

- •Вычисления

- •Обучение

- •Псевдооптическая нейронная сеть. Интерферирующий нейрон, устройство. Назначение, структура и функционирование сети.

- •Машина Больцмана, назначение. Устройство и функционирование.

- •Предетекторы и детекторы. Поле (карта) детекторов. Детекторы новизны и тождества. Схема активного анализа на основе нейроподобных элементов.

- •Аппаратная реализация нейронных сетей. Процедура проектирования систолических массивов (процессоров), на основе структуры сети.

- •Систолические процессоры для двухслойной нейронной сети (первый слой – рецепторы). Эффективность. Предпочтение по эффективности.

- •Систолический массив с разнонаправленными связями. Сравнение по эффективности с процессорами с однонаправленными связями.

- •Матричный систолический процессор. Сравнение по эффективности.

- •Систолические массивы для многослойных нейронных сетей. Структура систолического массива, объединяющего различные систолические процессоры. Эффективность.

- •Систолические массивы для многослойных нейронных сетей. Структура систолического массива, объединяющего идентичные систолические процессоры. Эффективность.

- •Систолические процессоры для реализации релаксационных нейронных сетей (сети Хопфилда).

- •Методы обеспечения отказоустойчивости. Скользящее резервирование.

- •Методы обеспечения отказоустойчивости. Секционированное резервирование. Схема для неоднородного потока входных данных.

- •Нечёткие нейронные сети. Структура, функционирование, обучение.

- •Литература.

максимальную реакцию на определенные стимулирующие свойства. Некоторые из этих синапсов являются возбуждающими и стремятся увеличить выход узлов, в то время как другие являются тормозящими и уменьшают выход узла.

Рис. 40. Связи от сложных клеток одного уровня к простым клеткам следующего уровня

На рис. 40 показана полная структура синаптических связей между простым узлом и комплексными узлами в предшествующем слое. Каждый простой узел реагирует только на набор комплексных узлов внутри своей рецептивной области. Кроме того, существует тормозящий узел, реагирующий на те же самые комплексные узлы. Веса синапсов тормозящего узла не обучаются, – они выбираются таким образом, чтобы узел реагировал на среднюю величину выходов всех узлов, к которым он подключен. Единственный тормозящий синапс от тормозящего узла к простому узлу обучается, как и другие синапсы.

Псевдооптическая нейронная сеть. Интерферирующий нейрон, устройство. Назначение, структура и функционирование сети.

Существуют сети, в которых лежат физические процессы, связанные с волновыми процессами, распространением световых волн – псевдооптические нейронные сети. Они моделируют голографический процесс, сохранения и восстановления информации.

Сеть имеет 4 слоя:

Рис. 41. Структура псевдооптической нейронной сети |

|

В основу функционирования сети положен эффект интерференции |

|

электромагнитных волн, согласно закону: |

|

I1I2 *cosϕ - интерференция световых волн; |

(182) |

φ – разность фаз. Характеристики сигнала:

•начальная фаза сигнала

•временной интервал распространения

•интенсивность

•частота

Каждый сигнал имеет временную задержку. Каждый нейрон может иметь порог интенсивности. Он складывается, когда приходит сигнал. Все сигналы по фазе и частоте совпадают.

Сеть функционирует в двух режимах – режиме записи и восстановления. В режиме записи функционируют три первых слоя, в режиме восстановления – первый, третий и четвёртый.

Первый слой выступает как источник. Источник может быть точечным и состоять из одного нейрона либо линейным и состоять из 2*n нейронов. Исходный образ располагается на втором слое, который, как и последующие, имеет n нейронов. Записанное изображение располагается на третьем слое. Восстанавливается образ на четвёртом слое путём освещения третьего слоя источником. Все нейроны в слоях находятся на одинаковом расстоянии друг от друга. Второй и четвёртый слой должны находиться на одинаковом расстоянии от третьего слоя. Расстояние между нейронами влияет на фазу и скорость распространяющегося сигнала по соответствующим связям. Образ и его изображение кодируется на слоях величиной порога нейронов. Интенсивность приходящего сигнала увеличивает со временем потенциал каждого нейрона и если этот потенциал превышает порог, то нейрон начинает излучать сигнал со своей частотой. Когда сигнал достигает третьего слоя, потенциал нейронов на этом слое начинает возрастать, и процесс продолжается до тех пор, пока самый последний сигнал от источника не достигнет всех нейронов третьего слоя. Тогда значение потенциала сохраняется в качестве порога. При восстановлении процесс аналогичен. Полученные значения потенциала на четвёртом слое являются восстановленным образом. В силу дискретности модели восстановленный образ может содержать шумы.

Машина Больцмана, назначение. Устройство и функционирование.

Машина Больцмана.

P (S )= |

1 |

|

|

||

|

E |

||||

i |

|

|

− |

||

|

1+e |

i |

|||

|

|

T |

|||

T(t+1)=a(T) |

|

|

|||

T (t )= |

|

T0 |

|

|

|

1+log (t ) |

|||||

(183)

(184)

(185)

Алгоритм функционирования машины Больцмана.

1. Устанавливаются в начальное состояние нейронные элементы и температура сети t = 0.

•Случайным образом из невыбранных выбирается нейронный элемент с номером i. Добавить его в выбранные. yi = (1| random ≤ yi’; 0| random > yi’); yi’=1/(1+exp(-Si/T(t)))

2.Вычисляется Ei.

3.Если Ei < 0, то yi(t+1) = yi.

4.Если Ei ≥ 0, то с вероятностью Pi yi(t+1) = yi, иначе – yi(t+1) = yi(t);

5.Повторить с пункта 2, если остались невыбранные.

6. Проверяется условие равновесия (T(t)=0 и Ei < 0 для всех i). Если оно не выполняется, то t = t+1 и все нейроны сети невыбранные и перейти на шаг 2.

Свойства машины Больцмана широко изучались. Скорость уменьшения температуры должна быть обратно пропорциональна логарифму времени, чтобы была достигнута сходимость к глобальному минимуму. Скорость охлаждения в такой системе выражается следующим образом:

T0 |

(186) |

T (t) = log(1+ t) |

где T(t) – искусственная температура как функция времени; Т0 – начальная искусственная температура; t – искусственное время.

Этот разочаровывающий результат предсказывает очень медленную скорость охлаждения (и данные вычисления). Этот вывод подтвердился экспериментально. Машины Больцмана часто требуют для обучения очень большого ресурса времени.

Предетекторы и детекторы. Поле (карта) детекторов. Детекторы новизны и тождества. Схема активного анализа на основе нейроподобных элементов.

Допустим существует объект, с которого поступают данные и обрабатываются нейросетевой моделью (предетектором). Предетектор может уменьшать количество обрабатываемых данных, т.е. уменьшать объекты входных данных (что является полезным свойством). Предетекторы могут также осуществлять переход в пространство с более удобной структурой, т.е. скаляр, α- значения которого изменяется [-k, k], можно представить в виде

x |

= cos |

n*α |

x |

|

= sin |

n*α |

|

2 |

|

||||

1 |

k |

|

|

k |

||

|

|

|

|

|

||

Детектор – объект, к которому поступает информация от предетектора и который осуществляет детектирование.

Схема активного анализа на основе нейроподобных элементов:

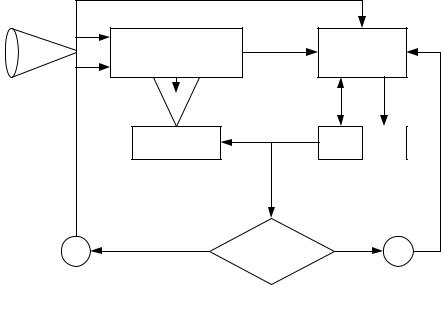

Рис. 42. Схема активного анализа на основе нейроподобных элементов

1 – набор рецепторов, которые преобразуют энергию сигнала в энергию электронных импульсов, поступающих на вход анализаторной системы 2, выделяющей отдельные признаки. 2 может содержать 1 или более признаков. Детекторы признаков посылают в память и активизируют с этими сигналами мнемические детекторы, активация которых означает, что в памяти возникает представление, какой сигнал воздействует на вход. Образ выводится в оперативную память (ОП).

В соответствии с гипотезой активизируется селектор, осуществляющий фильтрацию несущественных для гипотезы признаков. Отфильтрованные сигналы совместно с сигналами от блока гипотез (БГ) поступают на блок сравнения, который представляет собой набор детекторов новизны и тождества и формирует сигналы новизны и тождества. Если гипотеза не совпадает с фактической от анализатора, то формируется сигнал новизны, который активирует нейроны памяти, что приведет к активации другого детектора, т.е. выдвигается новая гипотеза. Если гипотеза подтверждается, то происходит выборка сигнала тождества, которая активизирует нейроны, представляющие эту гипотезу.

Детекторы новизны – нейроны, в которых те синапсы, по которым редко проходит сигнал, приобретают наибольшее значение весового коэффициента.

В нейронах тождества наоборот, если сигнал часто проходит, тогда синапс значения весового коэффициента, по которому сигнал проходит, приобретает наибольшее значение, а по тем, по которым не проходит, – малое значение.