- •Введение

- •Формальный нейрон. Типология нейронов. Задача, решаемая нейроном, геометрическая интерпретация.

- •Формальный нейрон.

- •Типология нейронов.

- •Геометрическая интерпретация задачи нейрона.

- •Нейронная сеть. Слой, типология слоёв. Типология нейронных сетей. Основные классы задач, решаемых нейронными сетями.

- •задачи

- •Задача обучения нейронной сети, отличие от задачи обучения нейрона. Проблемы. Примеры алгоритмов и методов обучения.

- •Градиентные методы.

- •Математическое обоснование метода обратного распространения ошибки. Алгоритм обратного распространения ошибки.

- •Вывод формулы для расчёта адаптивного коэффициента обучения в алгоритме обратного распространения ошибки.

- •Вывод формулы для расчёта адаптивного шага обучения для нерекуррентной линейной нейронной сети.

- •Алгоритм послойного обучения. Назначение и отличие от алгоритма обратного распространения ошибки.

- •Алгоритм многократного распространения ошибки. Назначение и отличие от алгоритма обратного распространения ошибки.

- •Задача предсказания числовых последовательностей с помощью нейронных сетей. Особенности устройства нейронных сетей для предсказания числовых последовательностей.

- •Реккурентные нейронные сети. Контекстный нейрон. Обучение. Сеть Элмана. Сеть Джордана.

- •Рециркуляционные нейронные сети. Линейная рециркуляционная сеть. Задача, решаемая линейной рециркуляционной сетью (метод главных компонент).

- •Алгоритмы обучения и функционирования линейной рециркуляционной сети.

- •Релаксационные нейронные сети. Синхронная сеть Хопфилда. Непрерывное и дискретное состояние. Структура, обучение, энергия, функционирование.

- •Сеть Хэмминга. Назначение, обучение и функционирование.

- •Линейная ассоциативная память и ассоциативная память на основе сети Хопфилда. Функционирование, отличие.

- •Двунаправленная ассоциативная память. Назначение, структура, обучение и функционирование.

- •Двунаправленная ассоциативная память. Метод обучения двунаправленной ассоциативной памяти с модифицированной структурой.

- •Сеть адаптивного резонанса. Назначение, структура, обучение и функционирование.

- •СТРУКТУРА APT

- •Функционирование сети APT в процессе классификации

- •ФУНКЦИОНИРОВАНИЕ APT

- •ПРИМЕР ОБУЧЕНИЯ СЕТИ APT

- •ЗАКЛЮЧЕНИЕ

- •Устройство и структура нейронных сетей для решения задач классификации и кластеризации. Правила обучения: WTA и CWTA.

- •Структура когнитрона, неокогнитрона и свёрточных нейронных сетей, отличия. Назначение когнитрона, неокогнитрона и свёрточных нейронных сетей.

- •Обучение

- •НЕОКОГНИТРОН

- •Обобщение

- •Вычисления

- •Обучение

- •Псевдооптическая нейронная сеть. Интерферирующий нейрон, устройство. Назначение, структура и функционирование сети.

- •Машина Больцмана, назначение. Устройство и функционирование.

- •Предетекторы и детекторы. Поле (карта) детекторов. Детекторы новизны и тождества. Схема активного анализа на основе нейроподобных элементов.

- •Аппаратная реализация нейронных сетей. Процедура проектирования систолических массивов (процессоров), на основе структуры сети.

- •Систолические процессоры для двухслойной нейронной сети (первый слой – рецепторы). Эффективность. Предпочтение по эффективности.

- •Систолический массив с разнонаправленными связями. Сравнение по эффективности с процессорами с однонаправленными связями.

- •Матричный систолический процессор. Сравнение по эффективности.

- •Систолические массивы для многослойных нейронных сетей. Структура систолического массива, объединяющего различные систолические процессоры. Эффективность.

- •Систолические массивы для многослойных нейронных сетей. Структура систолического массива, объединяющего идентичные систолические процессоры. Эффективность.

- •Систолические процессоры для реализации релаксационных нейронных сетей (сети Хопфилда).

- •Методы обеспечения отказоустойчивости. Скользящее резервирование.

- •Методы обеспечения отказоустойчивости. Секционированное резервирование. Схема для неоднородного потока входных данных.

- •Нечёткие нейронные сети. Структура, функционирование, обучение.

- •Литература.

E(yi(t)) = -∫yi(t)dSi = -yi(t)*Si(t)+∫F-1(yi(t))dyi |

(113) |

|

E(yi(t+1)) = E(yi(t+1))-E(yi(t)); |

(114) |

|

Для асинхронного режима: |

|

|

E(yi(t+1)) = -yi(t+1)*Si(t+1)+∫F-1(yi(t+1))dyi+yi(t)*Si(t)-∫F-1(yi(t))dyi |

(115) |

|

E(yi(t+1)) = -yi(t+1)*Si(t)+∫F-1(yi(t+1))dyi+yi(t)*Si(t)-∫F-1(yi(t))dyi |

(116) |

|

E(yi(t+1)) = (yi(t)-yi(t+1))*Si(t)+∫F-1(yi(t+1))dyi -∫F-1(yi(t))dyi |

(117) |

|

По теореме о среднем: |

|

|

E(yi(t+1)) = (yi(t)-yi(t+1))*(Si(t)-F-1(ε)) |

(118) |

|

Если yi(t)>yi(t+1), то Si(t)=F-1(yi(t)), и в силу монотонности функции |

||

активации: yi(t+1) ≤ ε ≤ yi(t): F-1(ε) ≤ F-1(yi(t)). |

|

Если yi(t)<yi(t+1), то Si(t)=F-1(yi(t)), и в силу монотонности функции |

|

активации: yi(t+1) ≥ ε ≥ yi(t): F-1(ε) ≥ F-1(yi(t)). |

|

Для дискретного: |

|

E(yi(t)) = -yi(t)*Si(t) |

(119) |

Для синхронного: |

|

E(yi(t)) = -yi(t-1)*Si(t) |

(120) |

Сеть Хэмминга. Назначение, обучение и функционирование.

Сеть Хемминга – это трехслойная рекуррентная структура, которую можно считать развитием сети Хопфилда. Она позиционируется как специализированное гетероассоциативное запоминающее устройство. Основная идея функционирования этой сети состоит в минимизации расстояния Хемминга между тестовым вектором, подаваемым на вход сети, и векторами обучающих выборок, закодированными в структуре сети.

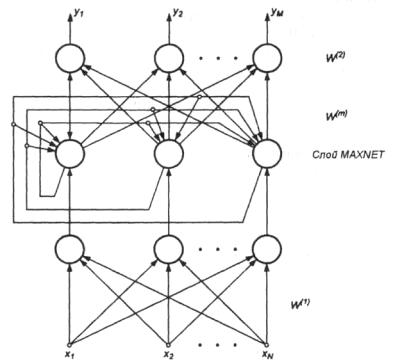

На рис. 18 представлена обобщенная схема сети Хемминга. Первый ее слой имеет однонаправленное распространение сигналов от входа к выходу и фиксированные значения весов. Второй слой, MAXNET, состоит из нейронов связанных обратными связями по принципу "каждый с каждым", при этом в отличие от структуры Хопфилда существует ненулевая связь входа нейрона со своим собственным выходом. Веса нейронов в слое MAXNET также постоянны. Разные нейроны связаны отрицательной (подавляющей) обратной связью с весом - ε, при этом обычно величина ε обратно пропорциональна количеству образов. С собственным выходом нейрон связан положительной (возбуждающей) обратной связью с весом, равным +1. Веса поляризации нейронов принимают значения, соответствующие нулю. Нейроны этого слоя функционируют в режиме WTA (Winner Takes All), при котором в каждой фиксированной ситуации активизируется только один нейрон, а остальные пребывают в состоянии покоя. Выходной однонаправленный слой формирует выходной вектор, соответствующий входному вектору. Веса нейронов этого слоя подбираются в зависимости от входных обучающих выборок.

В процессе функционирования сети можно выделить три фазы. В первой из них на ее вход подается N-элементный вектор x. После предъявления этого вектора на выходах нейронов первого слоя генерируются сигналы, задающие начальные состояния нейронов второго слоя, т.е. MAXNET'a.

Рис. 18. Структура сети Хэмминга

Во второй фазе инициировавшие MAXNET сигналы удаляются, и из сформированного ими начального состояния запускается итерационный процесс внутри этого слоя. Итерационный процесс завершается в момент, когда все нейроны, кроме одного (победителя с выходным сигналом, равным 1), перейдут в нулевое состояние. Нейрон-победитель с ненулевым выходным сигналом становится представителем класса данных, к которому принадлежит входной вектор.

В третьей фазе этот же нейрон посредством весов, связывающих его с нейронами выходного слоя, формирует на выходе сети отклик в виде вектора у, соответствующий возбуждающему вектору х.

Сеть Хемминга считается гетероассоциативным запоминающим устройством с парой связанных между собой векторов (у, x), где x и y - это соответственно входной и выходной биполярные векторы сети со значениями элементов ±1. Входные узлы сети 1, 2, ..., N принимают значения, задаваемые аналогичными компонентами вектора x. Нейроны первого слоя рассчитывают расстояние Хемминга между фактически предъявленным входным вектором x и каждым из p закодированных векторов-образцов x(i), образующих веса нейронов первого слоя. Нейроны в слое MAXNET выбирают вектор с наименьшим расстоянием Хемминга, определяя таким образом класс, к которому принадлежит предъявленный входной вектор x. Веса нейронов выходного слоя формируют вектор, соответствующий предъявленному входному вектору. При p нейронах первого слоя емкость запоминающего устройства Хемминга также равна p, поскольку каждый нейрон представляет единственный класс.

Подбор весов сети Хемминга оказывается чрезвычайно простым. Becы первого слоя соответствуют очередным векторам образов х(i), поэтому

w(1) |

= x(i) |

(121) |

ij |

j |

|

для i = 1, 2, ..., р. Аналогично веса выходного слоя соответствуют очередным

векторам образов у(i) связанным с x(i): |

|

w(2)ji = y(ji) . |

(122) |

В случае нейронов слоя MAXNET, функционирующих в режиме WTA, веса сети должны усиливать собственный сигнал нейрона и ослаблять остальные. Для

достижения этого эффекта принимается |

|

||||||

w(m) =1, |

|

|

(123) |

||||

|

ii |

|

|

|

|

||

а также |

|

|

|

||||

− |

1 |

|

< wij(m) |

< 0 |

(124) |

||

|

( p −1) |

|

|||||

|

|

|

|

|

|

||

для i ≠ j. Для обеспечения абсолютной сходимости |

алгоритма веса wij(m) |

||||||

должны отличаться друг от друга. Р. Липпманн в своей работе принял |

|||||||

wij(m) = − |

|

1 |

+ξ , |

(125) |

|||

( p −1) |

|||||||

|

|

|

|

|

|||

где ξ - случайная величина с достаточно малой амплитудой.

Нейроны различных слоев сети Хемминга функционируют по-разному. Нейроны первого слоя рассчитывают расстояния Хемминга между поданными на вход сети вектором x и векторами весов w(i) = x(i) отдельных нейронов этого слоя (i = 1, 2, ..., p). Значения выходных сигналов этих нейронов определяются по формуле [10]

$yi |

=1− |

dH (x(i) , x) |

, |

(126) |

|

N |

|||||

|

|

|

|

где dH(x(i), x) обозначает расстояние Хемминга между входными векторами x и x(i), т.е. количество битов, на которое различаются эти два вектора. Значение yˆi =1, если x = x(i) и yˆi = 0, если x=-x(i). В остальных случаях значения yˆi

располагаются в интервале [0, 1].

Сигналы yˆi нейронов первого слоя становятся начальными состояниями

нейронов слоя MAXNET на второй фазе функционирования сети. Задача нейронов этого слоя состоит в определении победителя, т.е. нейрона, уровень возбуждения которого наиболее близок к 1. Такой нейрон указывает на вектор образа с минимальным расстоянием Хемминга до входного вектора x. Процесс определения победителя – это рекуррентный процесс, выполняемый согласно формуле

yi (k) = f |

∑wij(m) yj (k −1) |

= f yi (k −1) +∑wij(m) yj (k −1) , |

|||

|

j |

|

|

j≠i |

|

при начальном значении yj(0)= yˆi . Функция активации

MAXNET задается выражением

y для y ≥ 0 f ( y) = .

0 для y < 0

(127)

f(y) нейронов слоя

(128)

Итерационный процесс (127) завершается в момент, когда состояние нейронов стабилизируется и активность продолжает проявлять только один нейрон, тогда как остальные пребывают в нулевом состоянии. Активный нейрон

становится победителем и через веса wij(2) линейных нейронов выходного слоя

представляет вектор y(i), который соответствует вектору x(i), признанному слоем MAXNET в качестве ближайшего к входному вектору x.

Важным достоинством сети Хемминга считается небольшое количество взвешенных связей между нейронами. Например, 100-входовая сеть Хопфилда, кодирующая 10 различных векторных классов, должна содержать 10000 взвешенных связей с подбираемыми значениями весов. При построении аналогичной сети Хемминга количество взвешенных связей уменьшается до 1100, из которых 1000 весов находятся в первом слое и 100 – в слое MAXNET. Выходной слой в этом случае не учитывается, поскольку сеть Хемминга, аналогичная сети Хопфилда, является ассоциативной.

В результате многочисленных экспериментов доказано, что рекуррентная сеть Хемминга дает лучшие результаты, чем сеть Хопфилда, особенно в ситуациях, когда взаимосвязанные векторы x и y являются случайными. В частности, реализованная в программе Mathlab сеть Хемминга, протестированная на 10 цифрах позволила почти безошибочно распознать все представленные зашумленные образы. Достигнутая эффективность распознавания зашумленных образов составила 100%. На рис. 19 и 20 изображены искаженные образы цифр 0- 9, поданные на вход натренированной сети Хемминга, и соответствующие им образы, распознанные этой сетью. Для цифр с рис. 19 только искаженным образам цифр 0, 3 и 6 были ошибочно приписаны другие оригиналы. Однако такое решение не может считаться результатом неправильного функционирования сети, поскольку распознанные образы соответствовали эталонам с наименьшим расстоянием Хемминга до искаженных образов (после повреждения эталонов шумом они стали подобны остальным обучающим выборкам).

Рис. 19. Тестовые (сверху) и распознанные сетью Хэмминга (снизу) образцы цифр при обработке первой группы искажёшшых входных данных