- •Литература:

- •Введение

- •Введение

- •Т → тi (тi– отображения текста)

- •ТекстАрхетипы – вещи для того, чтобы объяснить японцу, в чьем

- •Основные направления ии.

- •8. Мультиагентные с-мы (мас). Метод решения проблем

- •Основные этапы развития Интеллектуальных Систем. Направления ии. Направления

- •Развитие эс.

- •Классификация эс как приложения.

- •1. По типу приложения:

- •2. По типу проблемной области:

- •3. По стадии существования.

- •4. На какую вс ориентировано приложение.

- •Основные отличия данных от знаний

- •Обработка плохооопределеннлой информации в эс (соз)

- •Метод обработки неопределенности на основе субъективных коэффициентов уверенности (метод mycin).

- •Метод обработки неопределенности в guru

- •Обработка плохоопределенной информации с использованием Дерева Решений

- •Обработка неопределенностей лингвистического характера.

- •Операции на шкалах.

- •Извлечение знаний

- •Классификация методов извлечения знаний.

- •Методы и системы приобретения знаний.

- •Инструментальные средства. Конструирование эс

- •Классификация инструментальных средств конструирования эс (ис)

Метод обработки неопределенности на основе субъективных коэффициентов уверенности (метод mycin).

Определили 2 коэффициента:

Мд(H,E) – мера доверия гипотезеHпри условииE:

Мн(Н,Е) – мера недоверия:

К – коэффициент уверенности Н при наличии условий Е1и Е2

К(Н,Е) = МД(Н,Е) – Мн(Н,Е)

0 Мд, Мн1, то -1К1

Если Е1и Е2независимы, то справедливо:

Возможен случай с несколькими гипотезами:

{Hj}j=1…m

{Ei} i=1…n

|

Мд (Н1& Н2, Е) =min{Мд(Н1,Е), Мд(Н2,Е)} Мн(Н1& Н2, Е) =max{Мн(Н1,Е), Мн(Н2,Е)} |

Мд (Н1U Н2, Е) =max{Мд(Н1,Е), Мд(Н2,Е)} Мн (Н1U Н2, Е) =min{Мн(Н1,Е), Мн(Н2,Е)} |

Вполне возможны ситуации, когда свидетельства приходят с определенной степенью уверенности.

МдI(Н,Е) = Мд(Н,Е)·max{К(Е,А), 0}

МнI(Н,Е) = Мн(Н,Е)·max{К(Е,А), 0}

Кпор(Н,Е) = 0,2 у человека

Метод обработки неопределенности в guru

Pi = (Сi ri, ki)

k(Сi)

k(Сi)

k(ri) = f(k(Сi), ki)

a b

Сi Pi = (Сi ri, ki)

Pj = (Сj rj, kj)

|

Логика |

(&) CFJO |

(U) CFCO |

|

M: P: A: B: |

min(a,b) a·b (<M>+<P>)/2 … |

Max(a,b) a+b - a·b (<M>+<P>)/2 … |

E·FCR = TRU 0 CF 100

Пороговое значение E·ONKN=20

Пример: надежность поставщика.

P1= (С1r, 0.9)

P2= (С2r, 0.8)

P31= (С3 = кооперативr, 0.5)

.

.

.

P4= (С4r, 0.7)

P5= (С4r, 0.8)

РР итого k(r) = 0,96

MM k(r) = 0,7

RULE: R4

PRIORITY: 100

IF FIN = TR

THEN NAD+= TR сf 90

RULE: R5

PRIORITY: 100

IF FIN = F

THENNAD-=TRсf90

20.11.02

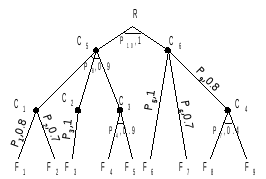

Обработка плохоопределенной информации с использованием Дерева Решений

ДР – дерево решений (целей)

![]() -

вершина типа «и»

-

вершина типа «и»

R

P,k

cicj

k(ci) k(cj)

![]()

2 Основных подхода:

1) Максиминный

K(R)=min {k(Ci), k(Cj), k}

2)Вероятностный

K(R)=k(Ci),k(Cj),k

![]()

![]() -

вершина типа «или»

-

вершина типа «или»

R

Pi,kiPj,kj

cicj

1) Максиминный

K(R)=max{ki k(Ci),kj k(Cj)}

2)Вероятностный

K(R)=k(Ci)ki+k(Cj)kj -k(Ci)k(Cj)kikj

Общая формула:

K(R)= k(Ci)ki + k(Cj)kj + k(Cr)kr –

-k(Ci) k(Cj)ki kj - k(Ci) k(Cr)ki kr - k(Cr) k(Cj)kr kj +

+ k(Ci) k(Cj) k(Cr) ki kj kr

Пример:

{Сi} – множ-во промежуточных заключений;

{Fj}– множ-во факторов;

P1 = (F1 C1, 0.8)

P2 = (F2 C1, 0.7)

P3 = (F3 C2, 1)

P4 = (F4 & F5 C3, 0.9)

P5 = (F6 C6, 1)

P6 = (F7 C6, 0.7)

P7 = (F8 & F9 C4, 0.4)

P8 = (C1 & C2 & C3 C5, 0.9)

P9 = (C4 C6 , 0.8)

P10 = (C5 & C6 R, 1)

М ожно

решить задачу оптимизации

ожно

решить задачу оптимизации

Поиск решения

S н

= (0,9; 0; 1; 0,8; 0,9; 0,1; 0,8; 0,7; 0,5)

н

= (0,9; 0; 1; 0,8; 0,9; 0,1; 0,8; 0,7; 0,5)

F1F2F3F4 F5F6F7F8 F9

а) ab,a+b–ab

б) max{a,b}{a,b},max{a,b}

Ответы:

а) k(C1) = 0,90,8 = 0,72

k(C2) = 1

k(C3) = 0,80,90,9 = 0,65

k(C4) = 0,70,50,4 = 0,14

k(C6) = 0,80,7 = 0,56

k(R) = 0,420,56 = 0,65

б) k(C1) = 0,8

k(C2) = 1

k(C3) = 0,8

k(C4) = 0,4

k(C6) = max{min(0;1); min(0,7;0,8); min(0,4;0,8)} = 0,7

k(R) =min(0,8;0,7) = 0,7

Обработка неопределенностей лингвистического характера.

Заде: L = <U,T,Р1,Р2>

– лингвистическая переменная

U – универсум - область, на к-ой проводится рассуждение (например, в случае возраста – годы: 0-150, т.е. U – некая шкала);

T – множ-во базовых понятий, не трубующих описания; для каждого базового понятия определяется нечеткое множ-во для определения степени принадлежности (например, для ЛП – возраст: молодой/старый);

Р1– нечеткие множ-во;

Р2 – операции над нечеткими множ-вами для получения небазовых понятий (например, чтобы получить из базовых понятий «молодой»/«старый» НМ для понятия «пожилой»).

Денотат может быть неопределен, например, понятие «здоровье» - его определить невозможно.

Психологи установили, что при интерпритаци лингвистических переменных используют лингвистические шкалы:

A=<U, А(U)>А(U) – степень принадлежности

Порядок бывает полный и частичный, существует древовидный порядок: